超越BEVFusion!又快又好的極簡BEV融合部署方案

本文經自動駕駛之心公眾號授權轉載,轉載請聯系出處。

寫在前面&筆者的個人理解

在算法開發中,激光雷達-相機3D目標檢測遇到了過度擬合問題,這是由于違反了一些基本規則。在數據集構建的數據標注方面,本文參考了理論補充,并認為回歸任務預測不應涉及來自相機分支的特征。通過采用“檢測即標簽”的前沿觀點,本文提出了一種新的范式,稱為DAL。使用最經典的初級算法,通過模仿數據標注過程構建了一個簡單的預測流水線。然后,本文以最簡單的方式對其進行訓練,以最小化其依賴性并增強其可移植性。盡管構造和訓練都很簡單,但所提出的DAL范式不僅在性能上取得了重大突破,而且在所有現有方法中提供了速度和精度之間的優越權衡。憑借全面的優勢,DAL會是未來工作開發和實際部署的理想基準。代碼已發布,https://github.com/HuangJunJie2017/BEVDet。

盡管構造和訓練簡單,但提出的DAL范式不僅極大地推動了性能邊界(例如,在nuScenes val集上為74.0 NDS,在nuScenes test集上為74.8 NDS),而且在所有現有方法中提供了速度和精度之間的優越權衡。本文的主要貢獻可以概括如下

- 文章提出了一個前沿的視角,即“檢測作為標注”,用于3D物體檢測中的LiDAR-相機融合。這是對現有方法的良好補充,也是未來工作應遵循的基本規則。

- 文章遵循“檢測作為標注”的觀點,構建了一個名為DAL的魯棒范例。DAL是第一個具有極其優雅的訓練管道的LiDAR-Camera融合范例。此外,它極大地推動了該問題的性能邊界,在推理延遲和準確性之間實現了優異的權衡。憑借全面的優勢,DAL是未來工作發展和實際使用的理想基線。

- 文章指出了速度分布不可避免的不平衡問題,并提出了實例級速度增益來緩解這一問題。

算法的網絡設計

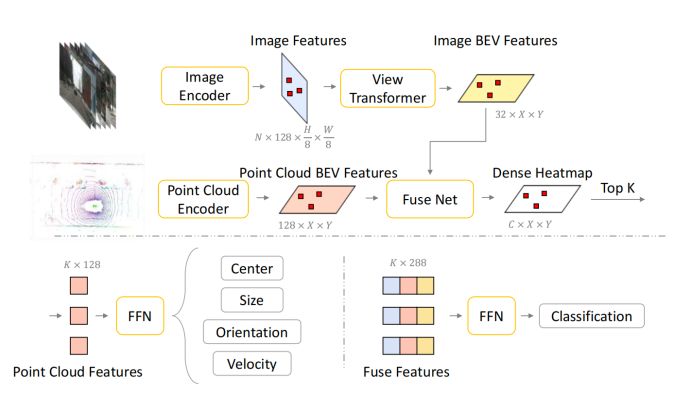

從 "檢測即標記 "的角度出發,模仿數據標注過程構建了一個預測管道,如下圖所示。提出的管道遵循從密集到稀疏的范式。密集感知階段的重點是特征編碼和候選特征生成。使用圖像編碼器和點云編碼器分別提取圖像和點云中的特征。N 表示視圖的數量。H × W 表示圖像視圖中特征的大小。X × Y 表示特征在鳥眼視圖(BEV)中的大小。特征編碼器具有經典的骨干結構(如 ResNet 和 VoxelNet)和頸部結構(如 FPN和 SECOND)。只需將密集圖像的 BEV 特征與點云的 BEV 特征進行串聯融合,并通過應用兩個額外的殘差塊來預測密集熱圖。C 表示類別的數量。最后,選出在密集熱圖中預測得分領先的 K 個候選者。這樣就模仿了數據標注中的候選生成過程。在此過程中,會同時使用圖像和點云的特征來生成一套完整的候選數據。

DAL范式的預測管道。將來自圖像和點云的BEV特征融合在一起,生成密集的熱圖。提取前K個建議及其點云特征,用于回歸任務預測。與圖像特征、圖像BEV特征和點云BEV特征融合的特征用于類別預測。根據每個建議的相應預測中心提取稀疏圖像特征。

在稀疏感知階段,首先根據候選對象在密集熱圖中的坐標收集每個候選對象的點云特征。然后使用簡單的前饋網絡(FFN)預測回歸目標(例如中心、大小、方向和速度)。在這個過程中不涉及圖像特征,以防止過擬合問題。最后,本文將圖像特征、圖像BEV特征和點云BEV特征融合在一起,生成用于類別預測的融合特征。圖像BEV特征的部分是根據候選對象在密集熱圖中的坐標提取的,而圖像特征的部分是根據預測的對象中心提取的。

除了進行一些關鍵修改外,DAL的預測管道從BEVFusion繼承了大部分結構設計。首先,點云BEV特征和圖像BEV特征在密集BEV編碼器之后進行融合,而BEVFusion在之前進行融合。本文推遲融合,以最大限度地保留LiDAR分支的回歸能力。然后,由于發現沒有必要,去除了稀疏實例和BEV特征之間的注意力。最后,回歸任務僅使用點云特征進行預測,而BEVFusion使用融合特征。

由于本文在構建預測管道時分配了適當的方式,只需要像大多數經典視覺任務一樣加載在 ImageNet 上預訓練的圖像骨干的參數。然后本文以端到端的方式訓練 DAL,只有一個階段。只使用來自目標數據集 nuScenes的數據。通過這種方式,本文以最優雅的方式訓練 DAL 模型,這在文獻中很少見。

例如,DAL與TransFusion和BEVFusion共享目標和損失的設計。除此之外,本文在圖像特征上添加了一個輔助分類頭,以加強圖像分支在搜索候選對象和區分不同類別方面的能力。這對于DAL來說非常重要,因為3D目標檢測頭中密集感知階段和稀疏感知階段的監督都有缺陷。具體來說,在密集感知階段,圖像特征會根據視圖轉換中的預測深度得分進行調整。反向傳播中的梯度也是如此。預測深度得分有缺陷是不可避免的,監督也是如此。在稀疏感知階段,損失計算中只涉及預測實例的圖像特征,而不是所有注釋目標的圖像特征。具有所有注釋目標監督的輔助分類頭可以解決上述問題,并在一定程度上加強圖像分支。在實踐中,使用注釋目標的重心來提取每個注釋目標的稀疏特征。然后,使用另一個FFN對稀疏特征進行分類,損失計算與3D目標檢測頭中的分類任務相同。不進行重新加權,本文直接將輔助損失添加到現有的損失中:

在回歸任務預測中棄用圖像特征不僅可以防止不可避免的性能退化,而且可以在圖像空間中進行更廣泛的數據增強。本文以調整大小增強為例進行解釋。基于相機的3D物體檢測根據其在圖像視圖中的大小預測目標的大小。當圖像隨機調整大小時,為了保持圖像特征與預測目標之間的一致性,需要對預測目標進行相應的調整。然后是LiDAR-相機融合的3D物體檢測中的連鎖反應中的點云。因此,現有的方法總是在圖像空間中使用小范圍的數據增強。結果,它們遠離了大多數圖像2D任務(例如分類,檢測,分割)中圖像空間大規模數據增強的好處。

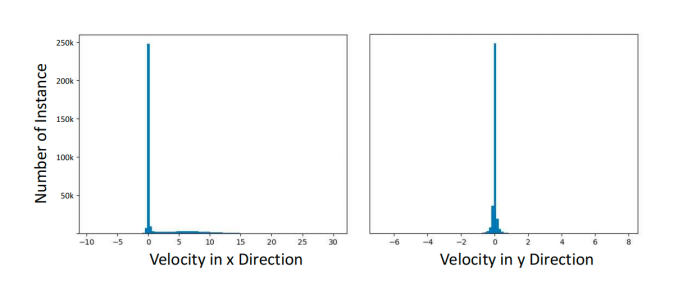

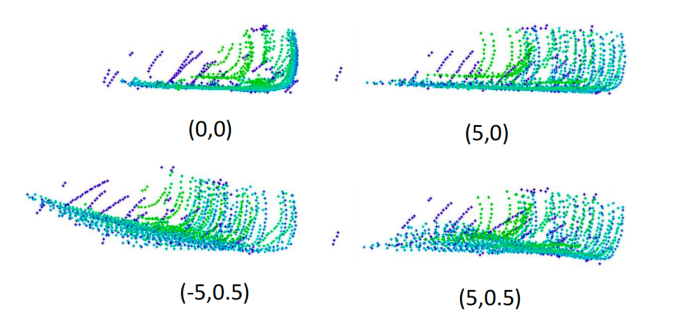

最后,本文觀察到訓練數據中速度分布極不平衡。如圖3所示,nuScenes訓練集中汽車類別的多數實例是靜態的。為了調整分布,隨機選擇了一些靜態物體,并根據預定義的速度調整其點云,如圖4所示。本文僅對靜態物體進行速度增強,因為可以從其帶注釋的邊界框中輕松地識別來自多個LiDAR幀的全套點。

圖3. nuScenes訓練集中汽車類別的速度分布。

圖4.使用不同的預定義速度(即(vx,vy))增強相同的靜態對象

相關實驗結果

數據集

本文在大規模基準nuScenes上進行全面的實驗。NuScenes是驗證許多室外任務的最新流行基準,如3D物體檢測、占用率預測、BEV語義分割、端到端自動駕駛。它包括1000個場景,其中包含來自6個相機的圖像和來自具有32束光束的LiDAR的點云。相機組具有與LiDAR一致的360度視野。這使其成為評估LiDAR-相機融合算法的首選數據集。這些場景被正式分為700/150/150個場景,用于訓練/驗證/測試。有10個類別的140萬個注釋的3D邊界框:汽車、卡車、公共汽車、拖車、工程車輛、行人、摩托車、自行車、障礙物和交通錐。

評估指標

對于3D對象檢測,本文報告了官方預定義的度量標準:平均精確度(mAP)、平均平移誤差(ATE)、平均縮放誤差(ASE)、平均方向誤差(AOE)、平均速度誤差(AVE)、平均屬性誤差(AAE)和NuScenes檢測評分(NDS)。mAP類似于2D對象檢測中的mAP,用于衡量精度和召回率,但基于地面上2D中心距離的匹配,而不是交集比(IOU)。NDS是其他指標的組合,用于綜合判斷檢測能力。其余指標用于計算相應方面的陽性結果精度(例如,平移、縮放、方向、速度和屬性)。

預測管道

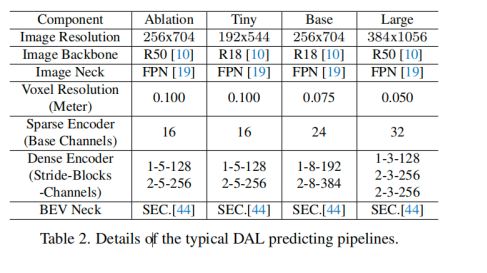

如表2所示,本文遵循兩種經典的3D對象檢測范式BEVDet-R50 和CenterPoint ,分別構建圖像分支和LiDAR分支,用于消融研究。此外,本文還提供了一些推薦的配置,在推理延遲和準確性之間實現了出色的權衡。

訓練和評估

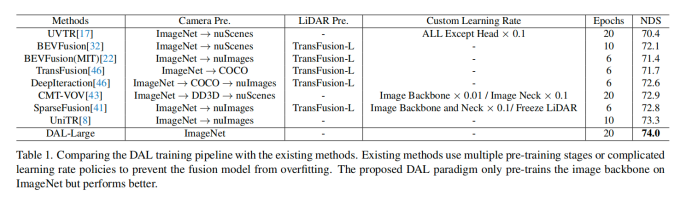

DAL模型在16個3090 GPU上以64個批處理大小進行訓練。如表1所示,

與大多數需要多個預訓練階段和復雜學習率策略的現有方法不同,DAL僅從ImageNet分類任務中加載預訓練權重,并使用CBGS對整個流水線進行20個epoch的訓練。DAL與CenterPoint共享相同的學習率策略。具體來說,學習率通過遵循循環學習率策略進行調整,初始值為2.0×10-4。在評估過程中,本文報告了單個模型在無測試時間增廣情況下的性能。默認情況下,推理速度都在單個3090 GPU上測試。BEVPoolV2 用于加速視圖變換算法LSS。

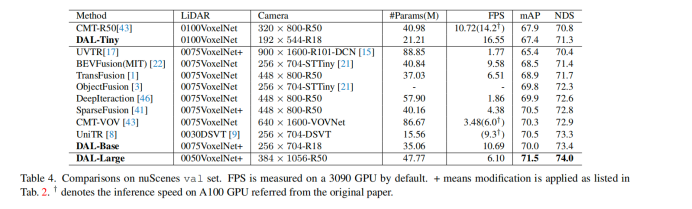

nuScenes val set的結果。如表4所示和圖1所示,提出的DAL范式不僅極大地推動了性能邊界,而且還提供了速度和精度之間的更好權衡。配置DAL-Large的分數為71.5 mAP和74.0 NDS,大大超過了現有的最佳記錄,分別增加了+1.0 mAP和+0.7 NDS。在如此高的準確度下,DAL-Large仍然以6.10 FPS的推理速度運行。另一個推薦的配置DAL-Base以與最快的方法CMT-R50 類似的推理速度運行。其準確度大大超過了CMT-R50,分別為2.1 mAP和2.6 NDS。與CMT-R50具有相似的準確度,DAL-Tiny的加速率為54%。

nuScenes測試集的結果。本文報告了DAL-Large配置在nuScenes測試集上的性能,沒有模型集成和測試時間擴展。DAL在NDS 74.8方面優于所有其他方法。

總結

本文提出了一個前沿的視角“檢測作為標注”,用于激光雷達-攝像頭融合的3D物體檢測。DAL是按照這個視角開發的模板。DAL是一個非常優雅的范例,具有簡潔的預測管道和易于訓練的過程。盡管在這些方面很簡單,但它極大地推動了激光雷達-攝像頭融合的3D物體檢測的性能邊界,并在速度和精度之間實現了最佳的平衡。因此,它對未來的工作和實際應用來說都是一個很好的里程碑。

DAL中沒有考慮超出激光雷達范圍的對象。本文嘗試過通過僅使用點云特征預測密集的熱圖,并將其與使用融合特征預測的熱圖進行比較,來區分這種情況。然后,使用另一個FFN在融合特征上預測這些實例的回歸目標。然而,這種修改對最終準確性的貢獻較小。這是因為 nuScenes 中只注釋了具有 1 個以上激光雷達點的目標。此外,在 nuScenes 評估中,范圍足夠小,確保了足夠的激光雷達點用于預測回歸方面。

此外,nuScenes數據集中的簡單分類任務限制了DAL應用SwinTransformer、DCN 和EfficientNet等高級圖像骨干。開放世界分類任務要復雜得多,因此也更加困難。因此,圖像分支在實踐中可以利用高級圖像骨干。

雖然DAL有一個無注意力的預測管道,但它只是一個揭示“檢測作為標記”價值的模板。因此,本文使用最經典的算法,而不應用注意力。然而,本文并沒有有意將其排除在DAL之外。相反,本文認為注意力是一種吸引人的機制,可以在許多方面進一步發展DAL。例如,本文可以應用像UniTR 這樣的高級DSVT主干,應用基于注意力的LiDAR-相機融合,如CMT,以及應用基于注意力的稀疏檢測范式,如DETR。

原文鏈接:https://mp.weixin.qq.com/s/NQ9LIAxsN4Azj0Nj7fV10w