350億參數、開放權重,Transformer作者創業后推出新大模型

今天,由 Transformer 作者之一 Aidan Gomez 參與創立的人工智能初創公司 Cohere 迎來了自家大模型的發布。

Cohere 推出的模型名為「Command-R」,參數量為 35B,它是一個針對大規模生產工作負載的全新大語言模型研究版本。該模型屬于「可擴展」模型類別,能夠平衡高效率和高精度, 使企業用戶超越概念驗證,進入生產階段。

作為一種生成模型,Command-R 針對檢索增強生成(RAG)等長上下文任務以及使用外部 API 和工具進行了優化。該模型旨在與自家行業領先的嵌入(Embed)和重新排序(Rerank)模型配合使用,為 RAG 應用程序提供一流的集成,并在企業用例中具有出色表現。

就其架構而言,Command-R 是一種使用優化后 transformer 架構的自回歸語言模型。在預訓練后,模型使用監督微調(SFT)和偏好訓練使自身與人類偏好保持一致,并實現有用性和安全性。

具體而言,Command-R 具有以下功能特征:

- RAG 和工具使用方面的高度準確性

- 低延遲、高吞吐量

- 更長的 128k 上下文和更低的價格

- 跨 10 種主要語言的強大功能

- HuggingFace 上提供模型權重以供研究和評估

Command-R 可以在 Cohere 的托管 API 上使用,并在不久的將來在主要云服務商上可用。Command-R 是一系列模型中的首個版本,提高了對企業大規模采用至關重要的功能。

目前,Cohere 在 Huggingface 上開放了模型權重。

Huggingface 地址:https://huggingface.co/CohereForAI/c4ai-command-r-v01

高性能檢索增強生成(RAG)

檢索增強生成(RAG)已成為大語言模型部署中的關鍵模式。通過 RAG,企業能夠讓模型訪問原本無法獲得的私有知識,搜索私有數據庫并使用相關信息形成響應,從而準確性和實用性將顯著提升。RAG 的關鍵組件是:

- 檢索:搜索與響應用戶相關的信息語料庫。

- 增強生成:使用檢索到的信息形成更明智的響應。

對于檢索,Cohere 的 Embed 模型通過搜索數百萬甚至數十億文檔來改善上下文和語義理解,顯著提高了檢索步驟的實用性和準確性。同時,Cohere 的 Rerank 模型有助于進一步提高檢索到信息的價值,優化相關性和個性化等自定義指標的結果。

對于增強生成,通過識別最相關的信息,Command-R 可以總結、分析、打包這些信息,并幫助員工提高工作效率或者創造全新的產品體驗。Command-R 的獨特之處在于:該模型的輸出帶有明確的引文,可以降低出現幻覺的風險,并能夠從源材料中呈現更多背景信息。

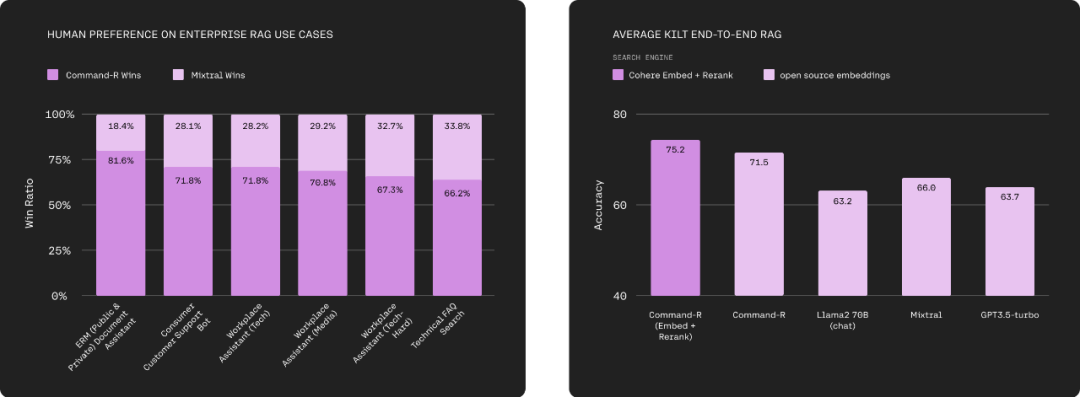

即使不使用自家的 Embed 和 Rerank 模型,Command-R 在可擴展的生成模型類別中也優于其他模型。不過當配合使用時,領先優勢顯著擴大,從而在更復雜的領域實現更高的性能。

下圖左為 Command-R 與 Mixtral 在一系列與企業相關的 RAG 應用上,進行了 Head-to-Head 整體人類偏好評估,充分考慮流暢度、答案實用性和引用。圖右為 Command-R(Embed+Rerank)、Command-R 與 Llama 2 70B(chat)、Mixtral、GPT3.5-Turbo 等模型在 Natural Questions、TriviaQA 和 HotpotQA 等基準上的比較結果。Cohere 的大模型實現了領先。

強大的工具使用能力

大語言模型應該是核心的推理引擎,可以自動執行任務并采取實際行動,而不僅僅提取和生成文本的機器。Command-R 通過使用工具(API)來實現這一目標,例如代碼解釋器和其他用戶定義的工具,使模型能夠自動執行高度復雜的任務。

Tool Use 功能使企業開發人員能夠將 Command-R 轉變為引擎,以支持需要使用「數據庫和軟件工具等內部基礎設施」以及「CRM、搜索引擎等外部工具」的任務和工作流程的自動化。這樣一來,我們可以實現跨多個系統且需要復雜推理和決策的耗時手動任務的自動化。

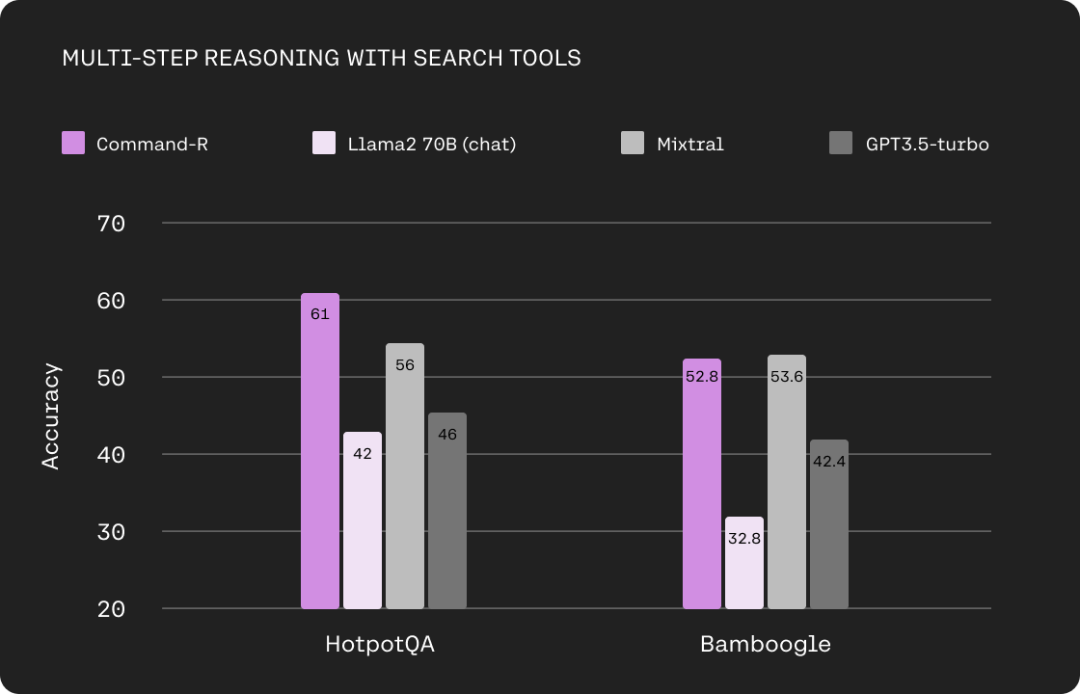

下圖為 Command-R 與 Llama 2 70B(chat)、Mixtral、GPT3.5-turbo,在使用搜索工具時的多步推理能力比較。這里使用到的數據集為 HotpotQA 和 Bamboogle。

多語言生成能力

Command-R 模型擅長全球 10 種主要商業語言,包括英語、法語、西班牙語、意大利語、德語、葡萄牙語、日語、韓語、阿拉伯語和中文。

此外,Cohere 的 Embed 和 Rerank 模型本身就支持 100 多種語言。這使得用戶能夠從大量數據源中得出答案,無論使用何種語言,都能以母語提供清晰準確的對話。

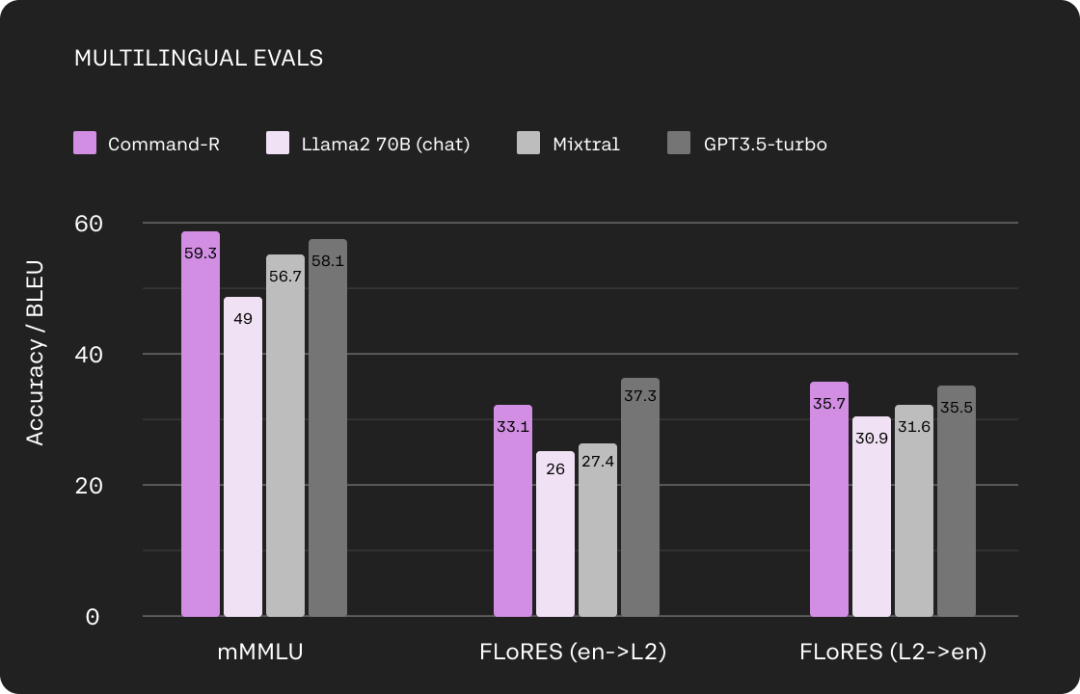

下圖為 Command-R 與 Llama 2 70B(chat)、Mixtral、GPT3.5-turbo 在多語言 MMLU 和 FLORES 上的比較。

更長的上下文和更低的價格

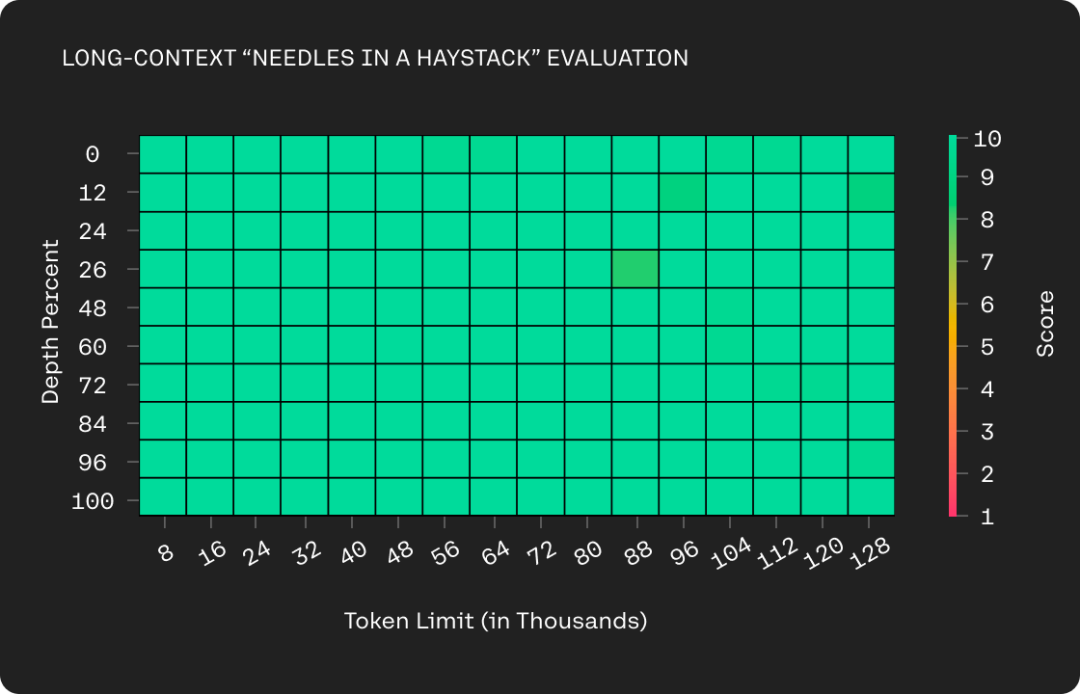

Command-R 支持了更長的上下文窗口 ——128k tokens。此次升級還降低了 Cohere 托管 API 的價格,并顯著提高了 Cohere 私有云部署的效率。通過將更長的上下文窗口與更便宜的定價相結合,Command-R 解鎖了 RAG 用例,其中附加上下文可以顯著提高性能。

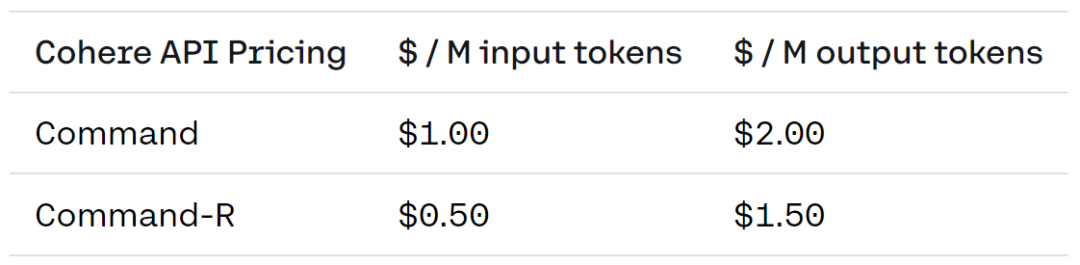

具體定價如下,其中 Command 版本 100 萬輸入 tokens 1 美元,100 萬輸出 tokens 2 美元;Command-R 版本 100 萬輸入 tokens 0.5 美元,100 萬輸出 tokens 1.5 美元。

不久后,Cohere 還將放出一份簡短的技術報告,展示更多模型細節。

博客地址:https://txt.cohere.com/command-r/