Stable Video 3D震撼登場:單圖生成無死角3D視頻、模型權重開放

Stability AI 的大模型家族來了一位新成員。

昨日,Stability AI 繼推出文生圖 Stable Diffusion、文生視頻 Stable Video Diffusion 之后,又為社區帶來了 3D 視頻生成大模型「Stable Video 3D」(簡稱 SV3D)。

該模型基于 Stable Video Diffusion 打造,能夠顯著提升 3D 生成的質量和多視角一致性,效果要優于之前 Stability AI 推出的 Stable Zero123 以及豐田研究院和哥倫比亞大學聯合開源的 Zero123-XL。

目前,Stable Video 3D 既支持商用,需要加入 Stability AI 會員(Membership);也支持非商用,用戶在 Hugging Face 上下載模型權重即可。

Stability AI 提供了兩個模型變體,分別是 SV3D_u 和 SV3D_p。其中 SV3D_u 基于單個圖像輸入生成軌道視頻,不需要相機調整;SV3D_p 通過適配單個圖像和軌道視角擴展了生成能力,允許沿著指定的相機路徑創建 3D 視頻。

目前,Stable Video 3D 的研究論文已經放出,核心作者有三位。

- 論文地址:https://stability.ai/s/SV3D_report.pdf

- 博客地址:https://stability.ai/news/introducing-stable-video-3d

- Huggingface 地址:https://huggingface.co/stabilityai/sv3d

技術概覽

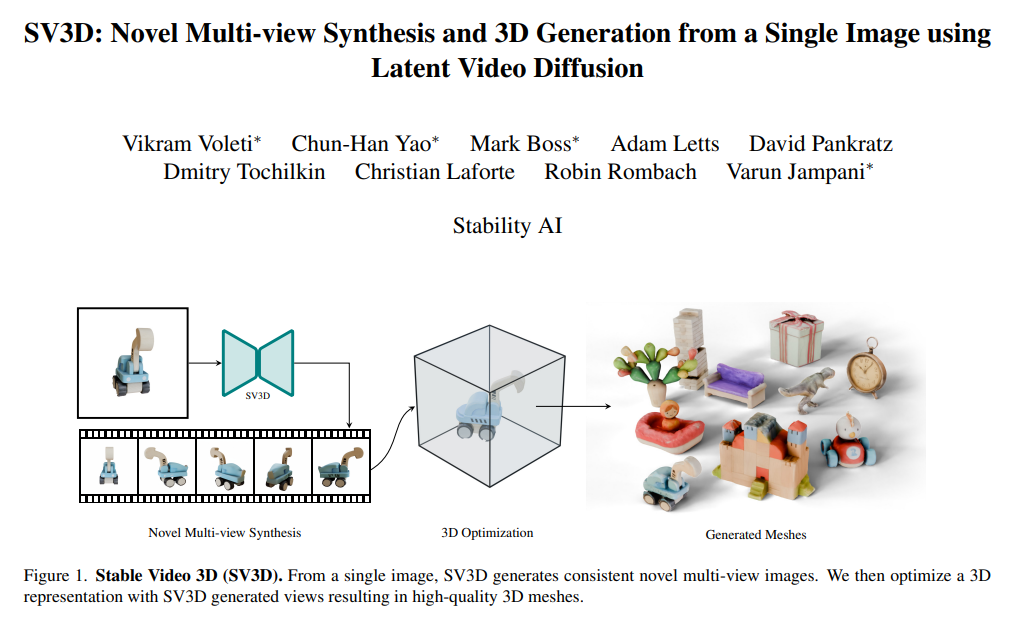

Stable Video 3D 在 3D 生成領域實現重大進步,尤其是在新穎視圖生成(novel view synthesis,NVS)方面。

以往的方法通常傾向于解決有限視角和輸入不一致的問題,而 Stable Video 3D 能夠從任何給定角度提供連貫視圖,并能夠很好地泛化。因此,該模型不僅增加了姿勢可控性,還能確保多個視圖中對象外觀的一致性,進一步改進了影響真實和準確 3D 生成的關鍵問題。

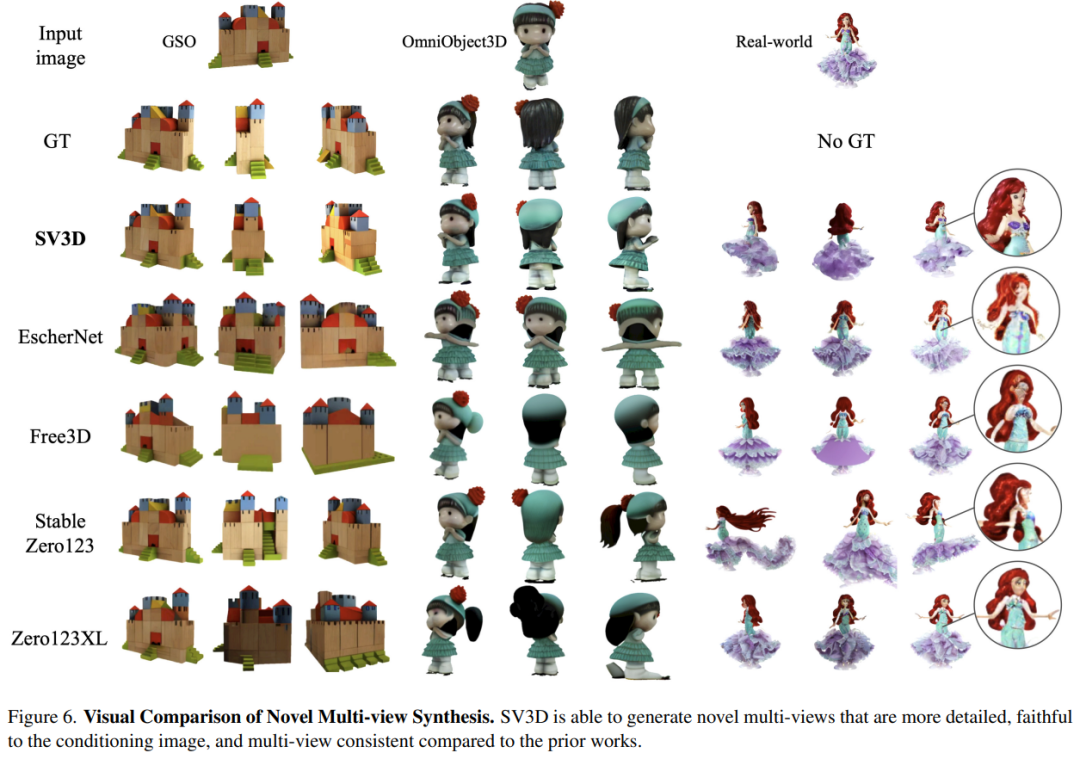

如下圖所示,與 Stable Zero123、Zero-XL 相比,Stable Video 3D 能夠生成細節更強、更忠實于輸入圖像和多視角更一致的新穎多視圖。

此外,Stable Video 3D 利用其多視角一致性來優化 3D 神經輻射場(Neural Radiance Fields,NeRF),以提高直接從新視圖生成 3D 網格的質量。

為此,Stability AI 設計了掩碼分數蒸餾采樣損失,進一步增強了預測視圖中未見過區域的 3D 質量。同時為了減輕烘焙照明問題,Stable Video 3D 采用了與 3D 形狀和紋理共同優化的解耦照明模型。

下圖為使用 Stable Video 3D 模型及其輸出時,通過 3D 優化改進后的 3D 網格生成示例。

下圖為使用 Stable Video 3D 生成的 3D 網格結果與 EscherNet、Stable Zero123 的生成結果比較。

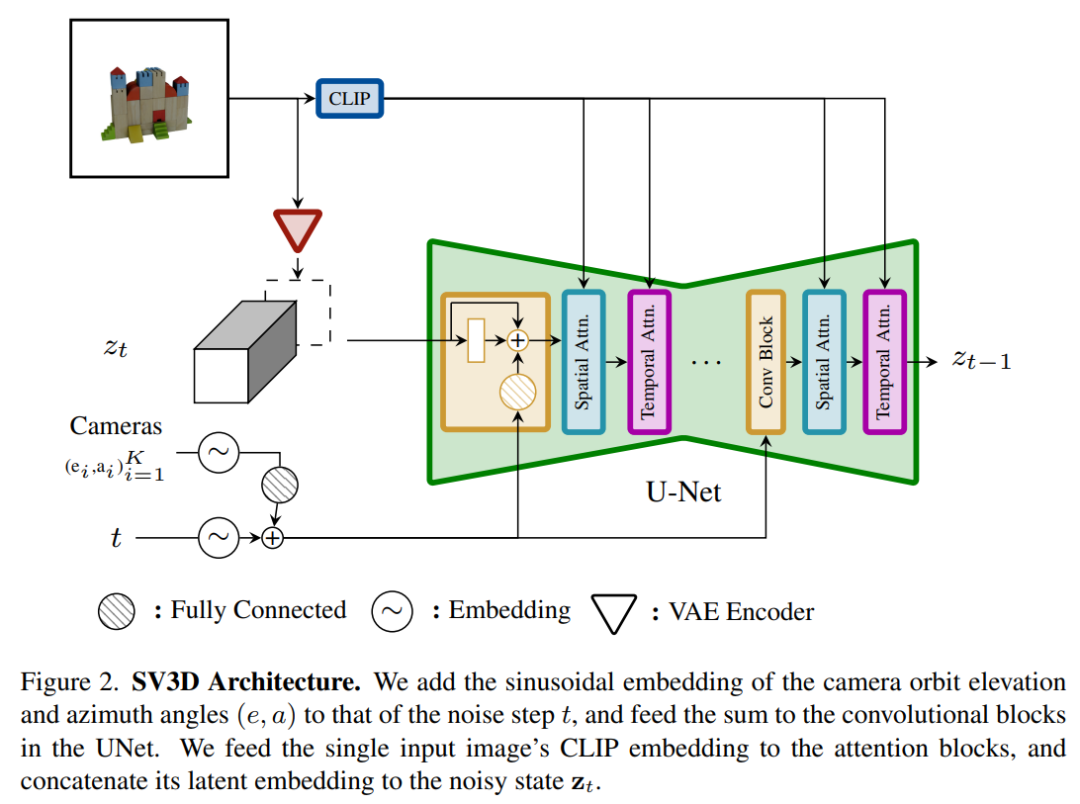

架構細節

Stable Video 3D 模型的架構如下圖 2 所示,它基于 Stable Video Diffusion 架構構建而成,包含一個具有多個層的 UNet,其中每一層又包含一個帶有 Conv3D 層的殘差塊序列,以及兩個帶有注意力層(空間和時間)的 transformer 塊。

具體流程如下所示:

(i) 刪除「fps id」和「motion bucket id」的矢量條件, 原因是它們與 Stable Video 3D 無關;

(ii) 條件圖像通過 Stable Video Diffusion 的 VAE 編碼器嵌入到潛在空間,然后在通向 UNet 的噪聲時間步 t 處連接到噪聲潛在狀態輸入 zt;

(iii) 條件圖像的 CLIPembedding 矩陣被提供給每個 transformer 塊的交叉注意力層來充當鍵和值,而查詢成為相應層的特征;

(iv) 相機軌跡沿著擴散噪聲時間步被饋入到殘差塊中。相機姿勢角度 ei 和 ai 以及噪聲時間步 t 首先被嵌入到正弦位置嵌入中,然后將相機姿勢嵌入連接在一起進行線性變換并添加到噪聲時間步嵌入中,最后被饋入到每個殘差塊并被添加到該塊的輸入特征中。

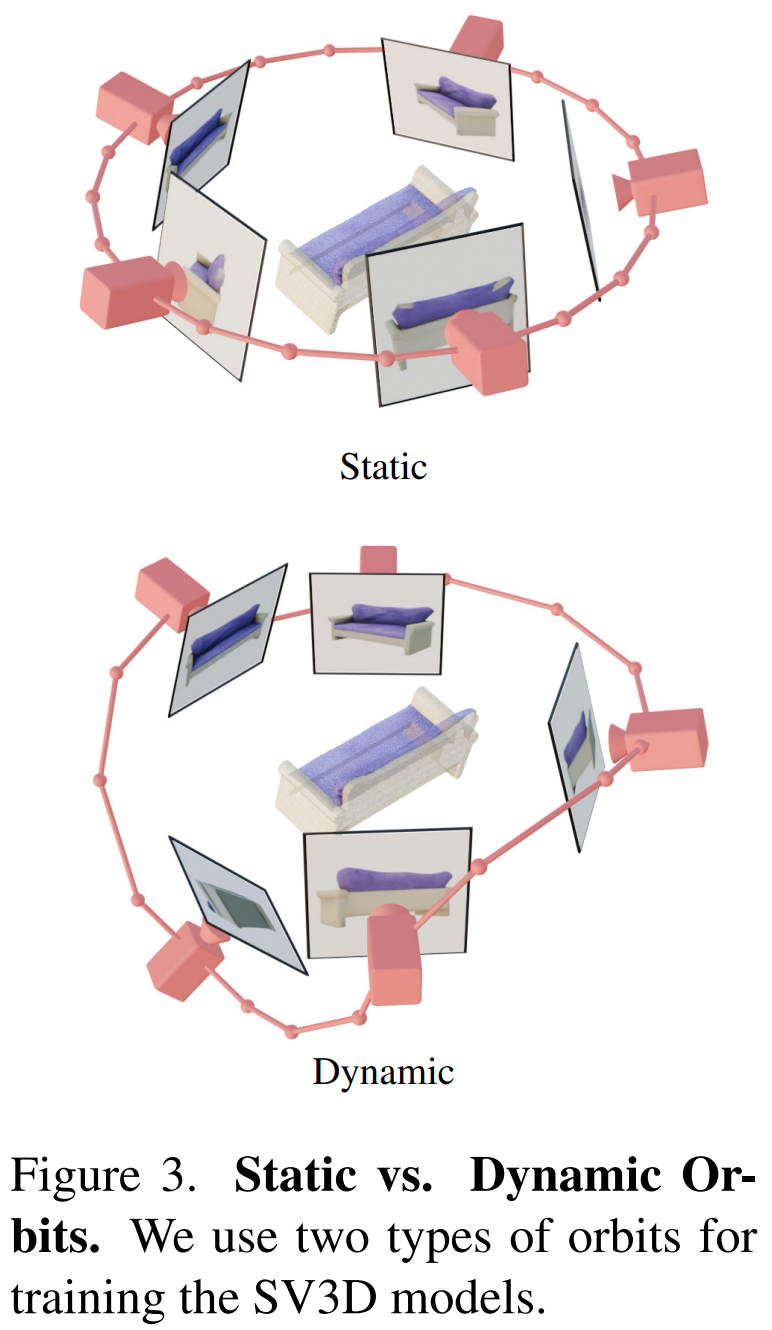

此外,Stability AI 設計了靜態軌道和動態軌道來研究相機姿勢調整的影響,具體如下圖 3 所示。

在靜態軌道上,相機采用與條件圖像相同的仰角,以等距方位角圍繞對象旋轉。這樣做的缺點是基于調整的仰角,可能無法獲得關于對象頂部或底部的任何信息。而在動態軌道上,方位角可以不等距,每個視圖的仰角也可以不同。

為了構建動態軌道,Stability AI 對靜態軌道采樣,向方位角添加小的隨機噪聲,并向其仰角添加不同頻率的正弦曲線的隨機加權組合。這樣做提供了時間平滑性,并確保相機軌跡沿著與條件圖像相同的方位角和仰角循環結束。

實驗結果

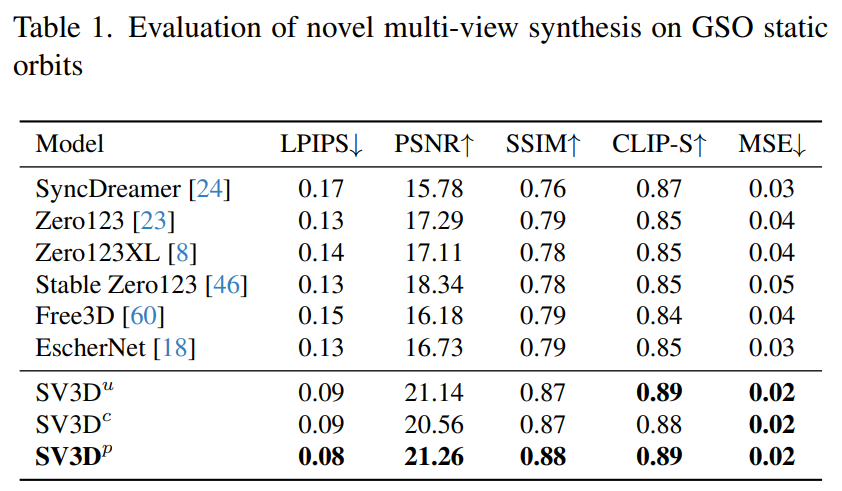

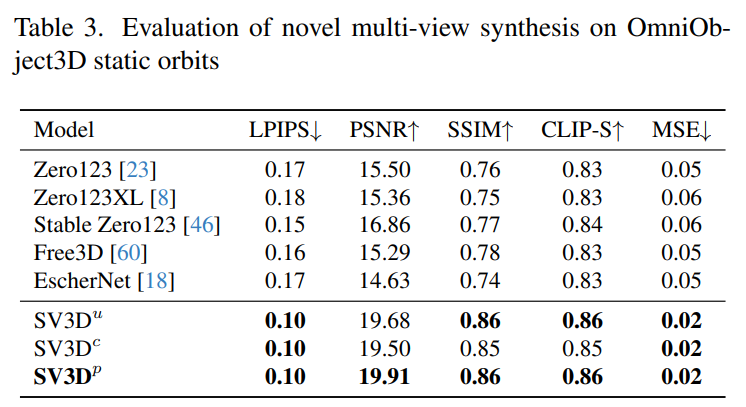

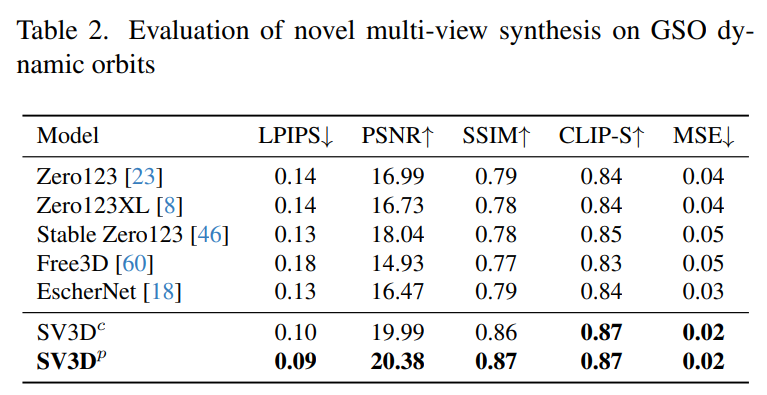

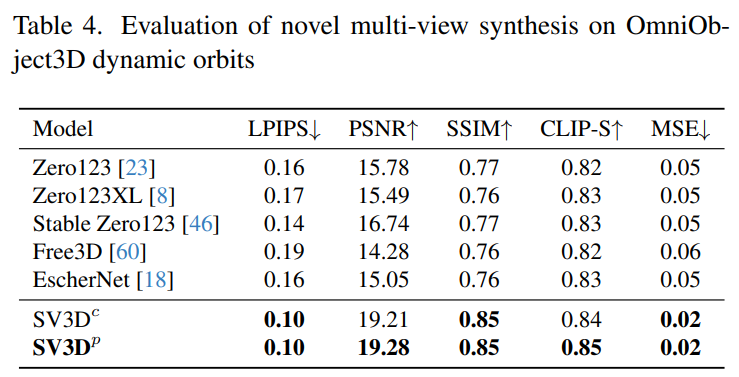

Stability AI 在未見過的 GSO 和 OmniObject3D 數據集上,評估了靜態和動態軌道上的 Stable Video 3D 合成多視圖效果。結果如下表 1 至表 4 所示,Stable Video 3D 在新穎多視圖合成方面實現了 SOTA 效果。

表 1 和表 3 顯示了 Stable Video 3D 與其他模型在靜態軌道的結果,表明了即使是無姿勢調整的模型 SV3D_u,也比所有先前的方法表現得更好。

消融分析結果表明,SV3D_c 和 SV3D_p 在靜態軌道的生成方面優于 SV3D_u,盡管后者專門在靜態軌道上進行了訓練。

下表 2 和表 4 展示了動態軌道的生成結果,包括姿勢調整模型 SV3D_c 和 SV3D_p,后者在所有指標上實現了 SOTA。

下圖 6 中的視覺比較結果進一步表明,與以往工作相比,Stable Video 3D 生成的圖像細節更強、更忠實于條件圖像、多視角更加一致。

更多技術細節和實驗結果請參閱原論文。