OpenAI藏了1年多的技術正式公開!15秒素材克隆聲音,HeyGen也在用

OpenAI雪藏的新產品——語音合成引擎Voice Engine,終于被正式揭幕。

有了它,只需15秒的語音樣本,就能克隆出一個人的聲音,而且還能跨越語言!

APP版ChatGPT中的語音對話功能,也正是由這項技術所驅動。

效果如何?先來聽段DEMO:

Salt also makes sure we stay hydrated which means there is enough water in our body for it to properly function.

鹽分也可以保持人體內的水分,確保其滿足正常功能的需要。

Voice Engine DEMO,量子位,7秒

而OpenAI通告顯示,他們在2022年底就已經開發出了這項技術,但出于安全考慮一直沒有正式發布。

這次,OpenAI終于官宣了Voice Engine,并展示了小規模測試中的幾個應用案例。

比如,一家非營利醫療機構就利用這項技術,為一名年輕的病人恢復了她的聲音。

另外值得一提的是,去年爆火的視頻翻譯軟件HeyGen,采用的語音引擎也正是Voice Engine。

那么,這次OpenAI還展現了哪些效果,下面就來一睹為快。

用AI幫助病患恢復聲音

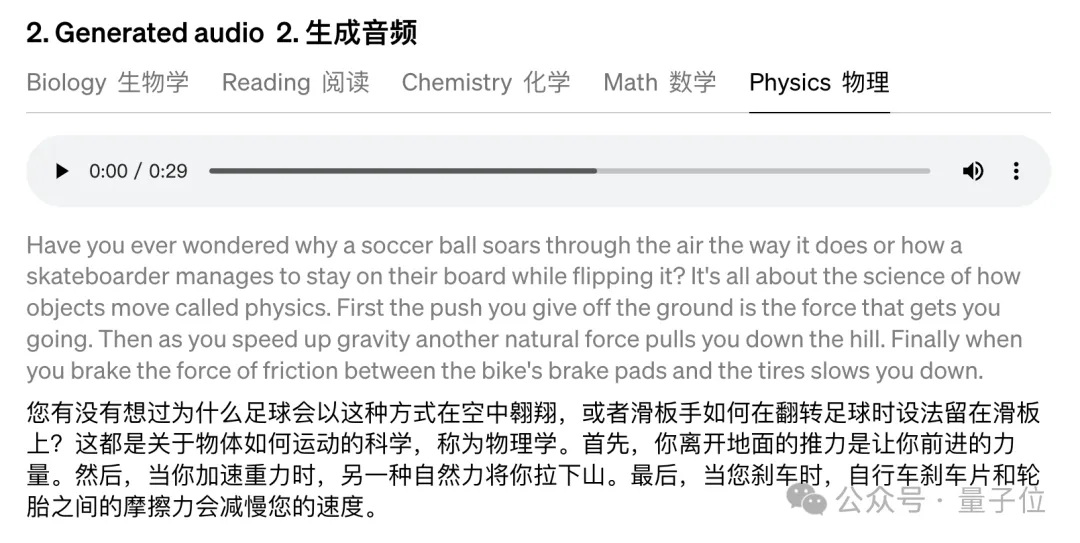

首先是利用基礎的語音合成能力,為兒童等不具備文字閱讀能力的群體提供閱讀輔助。

比如一家兒童教育技術公司,就一直在使用Voice Engine來給編寫好的畫外音內容配音。

DEMO中生成的大段內容,都是基于這樣一段15秒的樣本:

輔助閱讀-樣本,量子位,15秒

然后,就可以合成相同音色的長段語音:

輔助閱讀-合成,量子位,29秒

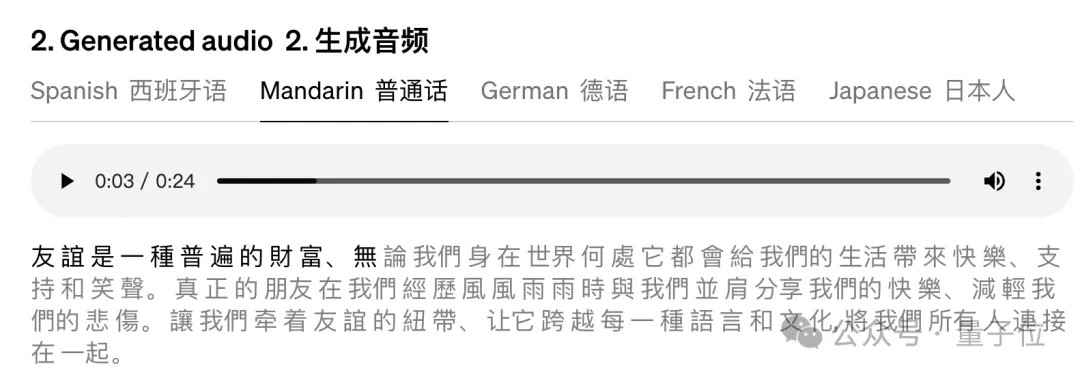

再來看看HeyGen中用到的的語音翻譯技術,原始素材是一段英語的音頻:

翻譯前-英文,量子位,16秒

它被用原始的音色,翻譯成了普通話、法語、德語等多種語言。

忽略譯文的質量,只聽聲音,中文的效果是這樣的:

翻譯后-普通話,量子位,24秒

音色保持的還算不錯,不過腔調很明顯一聽就是外國人在說中文。

至于這到底是個bug還是個feature,就見仁見智了(手動狗頭)。

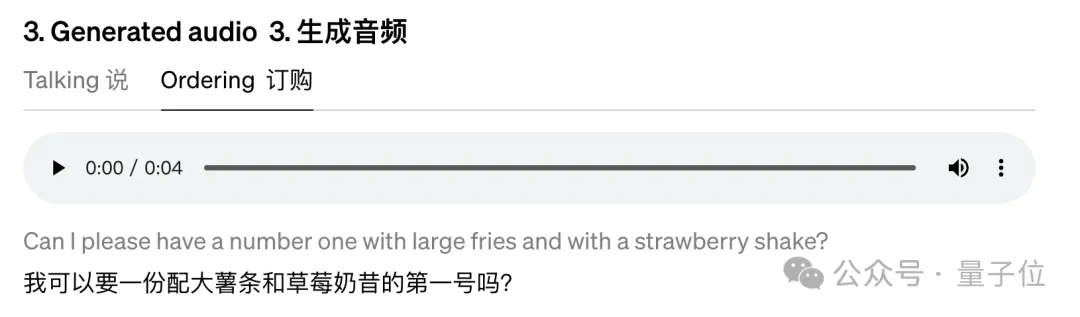

此外,一款名為Livox的殘障人士輔助應用,也利用Voice Engine為不能說話的殘障人士“發出聲音”——

在有了Voice Engine之后,TA們可以選擇專屬的真人音色,而不再是機械感明顯的合成音,并且在各種語言之間都能保持音色的一致性。

不只是幫助殘障人士擁有自己的聲音,Voice Engine還可以為因疾病導致聲音發生在重大改變的人群,恢復患病之前聲音,只要有以前的聲音樣本就能實現。

一名年輕的患者因罹患血管性腦腫瘤,失去了流利講話的能力,說話變成了這樣:

患者現在聲音,量子位,30秒

醫生從她所在學校錄制的視頻中提取到了她患病前的聲音作為樣本,在Voice Engine的幫助下為她恢復了此前的音色。

患病前聲音,量子位,15秒

恢復后效果,量子位,4秒

此次發布的案例,特別是為不便人士提供幫助的場景受到了不少好評,但也有網友對這項技術的濫用表達了擔憂。

安全問題需要全社會共同關注

實際上,安全問題也是OpenAI遲遲未將這項技術公之于眾的主要考量。

出于安全考慮,前面案例的開發者都經過了OpenAI的嚴格篩選,并且需要承諾遵守使用協議。

這些開發者被要求必須明確說明聲音是合成的,并且設定了黑名單以防止克隆公眾人物聲音。

此外,OpenAI還向合成的聲音中添加了水印,以便出現問題時可以進行檢測監控,同時呼吁人們采取措施共同應對這一問題:

- 在銀行等敏感信息的安全驗證措施中逐步淘汰語音驗證方式

- 探索AI時代下個人聲音的保護措施

- 教育公眾理解AI的局限性,并了解其被用于欺詐的可能

- 加速開發跟蹤溯源技術,讓人們能夠清晰辨別出真人和AI