一塊錢100萬token,超強MoE模型開源,性能直逼GPT-4-Turbo

開源大模型領域,又迎來一位強有力的競爭者。

近日,探索通用人工智能(AGI)本質的 DeepSeek AI 公司開源了一款強大的混合專家 (MoE) 語言模型 DeepSeek-V2,主打訓練成本更低、推理更加高效。

- 項目地址:https://github.com/deepseek-ai/DeepSeek-V2

- 論文標題:DeepSeek-V2: A Strong, Economical, and Efficient Mixture-of-Experts Language Model

DeepSeek-V2 參數量達 236B,其中每個 token 激活 21B 參數,支持 128K token 的上下文長度。

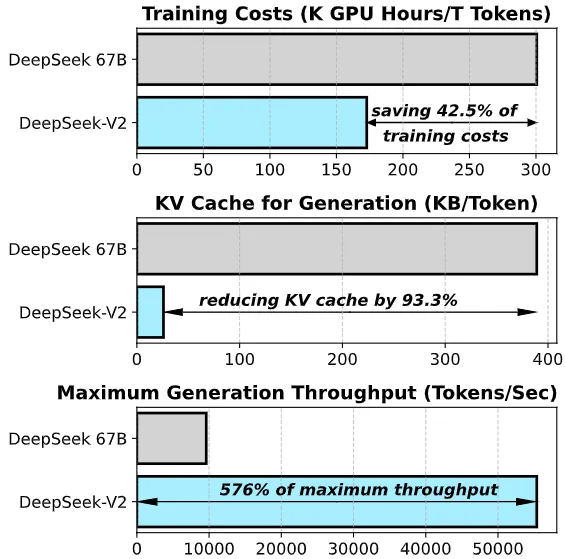

與 DeepSeek 67B (該模型去年上線)相比,DeepSeek-V2 實現了更強的性能,同時節省了 42.5% 的訓練成本,減少了 93.3% 的 KV 緩存,并將最大生成吞吐量提升 5.76 倍。

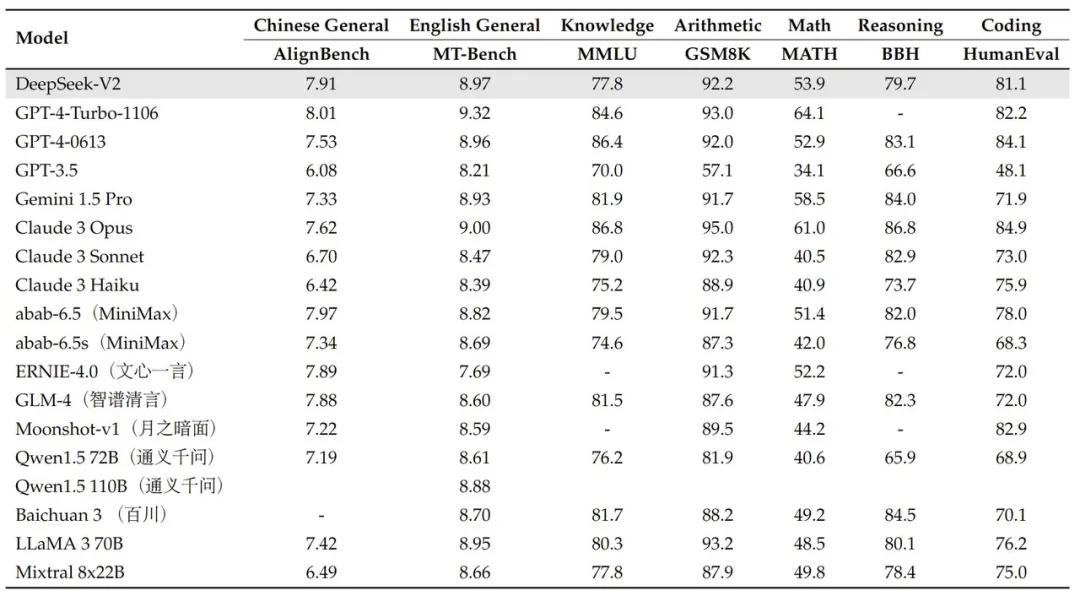

DeepSeek-V2 的模型表現非常亮眼:在 AlignBench 基準上超過 GPT-4,接近 GPT-4- turbo;在 MT-Bench 中與 LLaMA3-70B 相媲美,并優于 Mixtral 8x22B;擅長數學、代碼和推理。

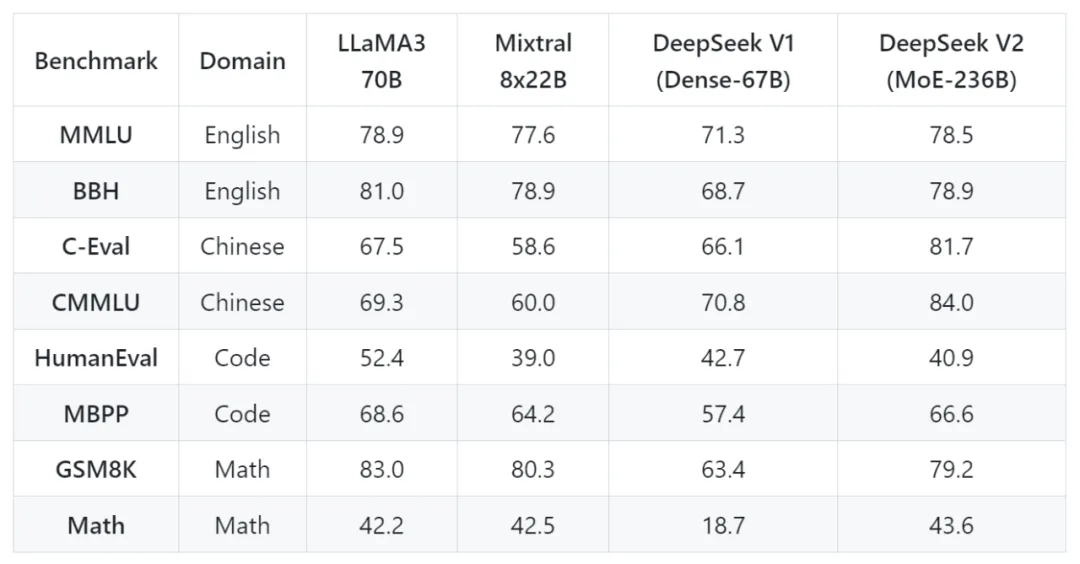

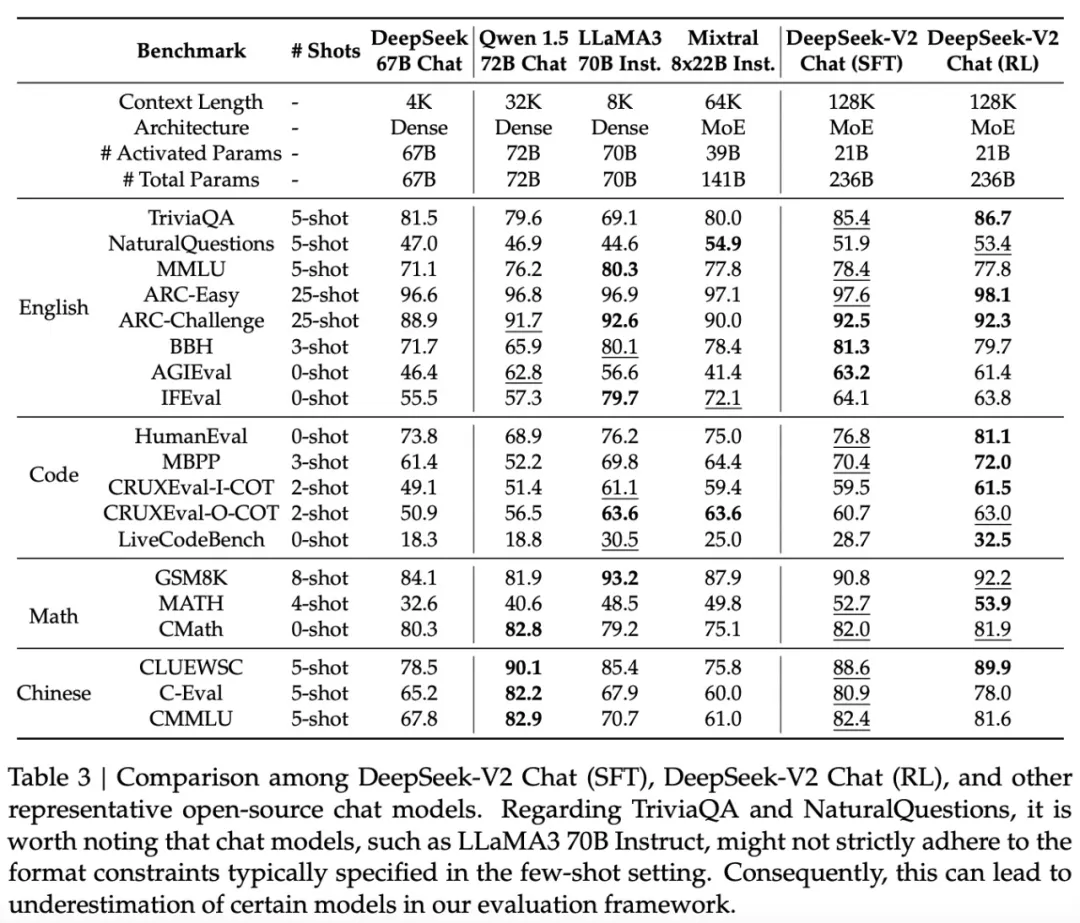

下面是 DeepSeek-V2 與 LLaMA 3 70B、Mixtral 8x22B、DeepSeek V1 (Dense-67B) 對比結果:

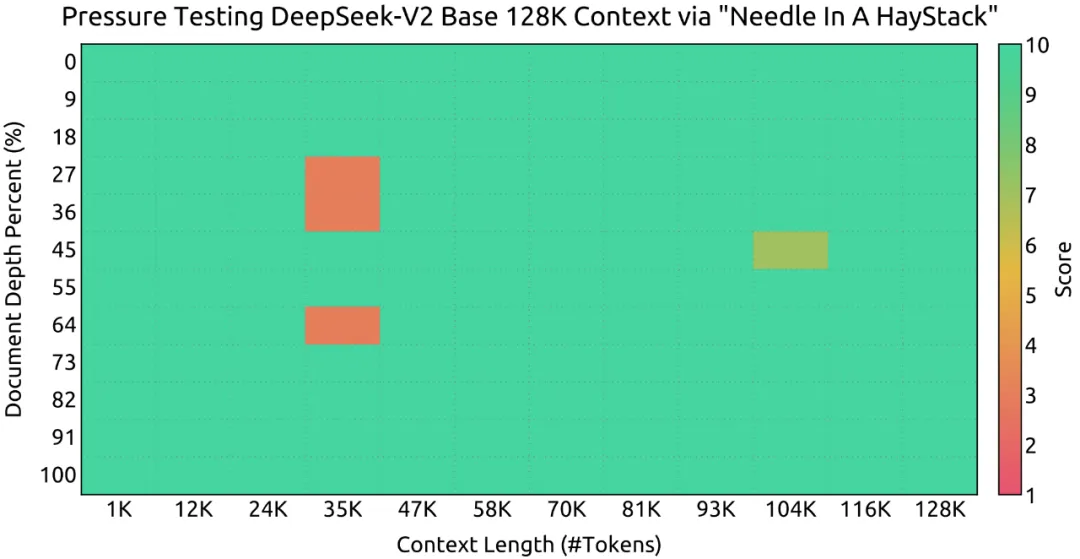

在大海撈針(NEEDLE IN A HAYSTACK)任務中,DeepSeek-V2 在上下文窗口達 128K 時表現良好。

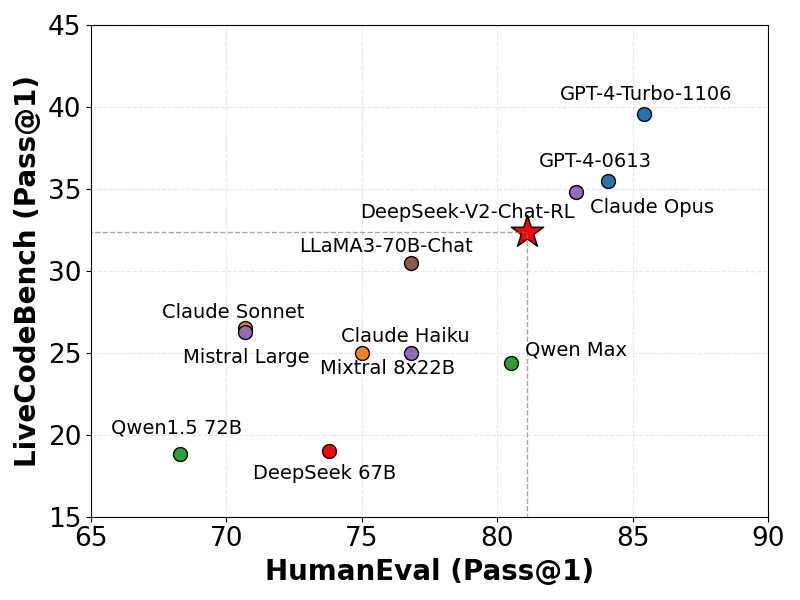

在 LiveCodeBench (0901-0401「一個專為實時編碼挑戰而設計的基準」) 上,DeepSeek-V2 獲得了較高的 Pass@1 分數。

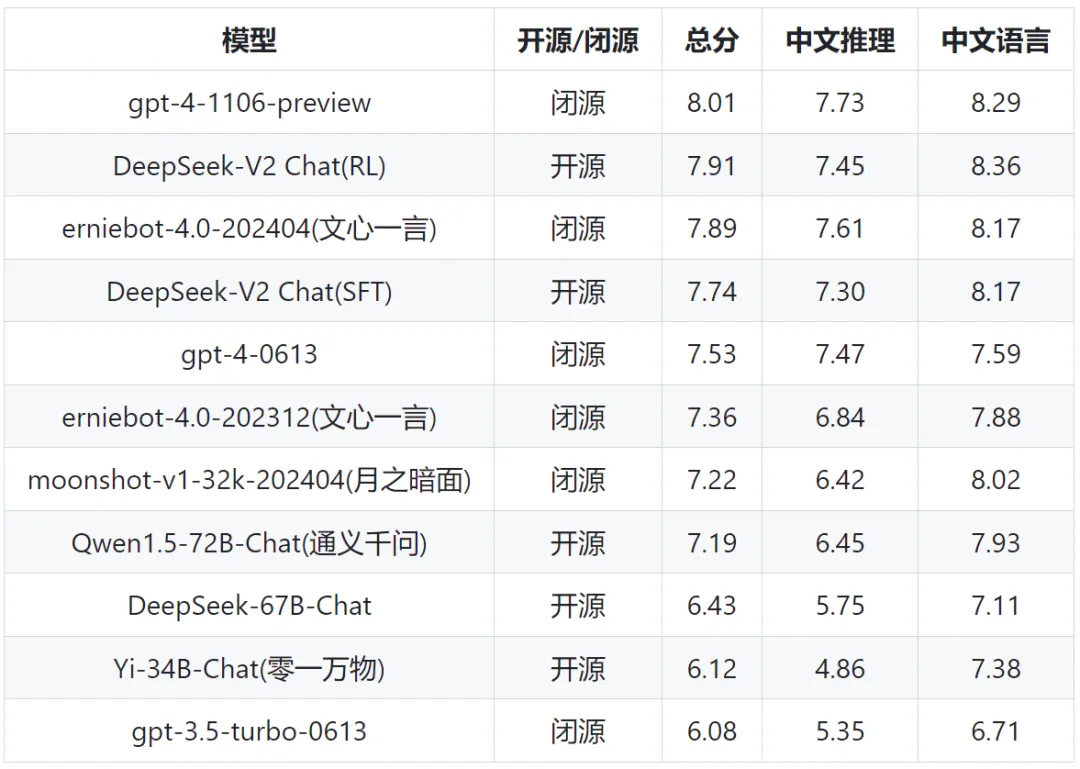

DeepSeek-V2 與不同模型在中文推理、中文語言上的表現:

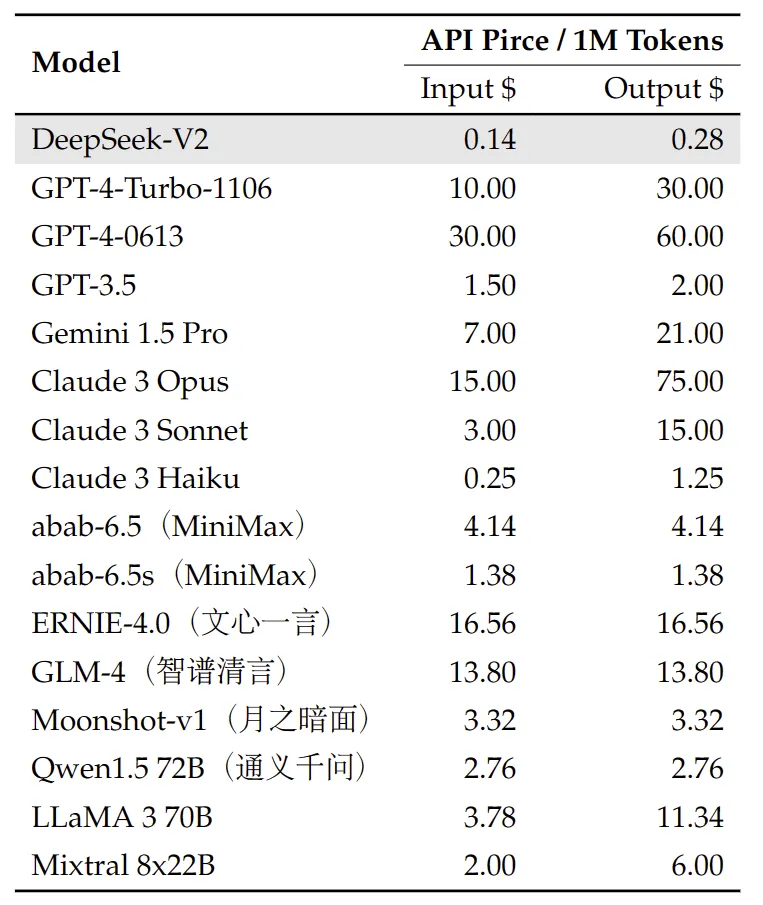

在價格方面,DeepSeek-V2 API 的定價如下:每百萬 token 輸入 0.14 美元(約 1 元人民幣)、輸出 0.28 美元(約 2 元人民幣,32K 上下文),與 GPT-4-Turbo 定價相比,價格僅為后者的近百分之一。

模型介紹

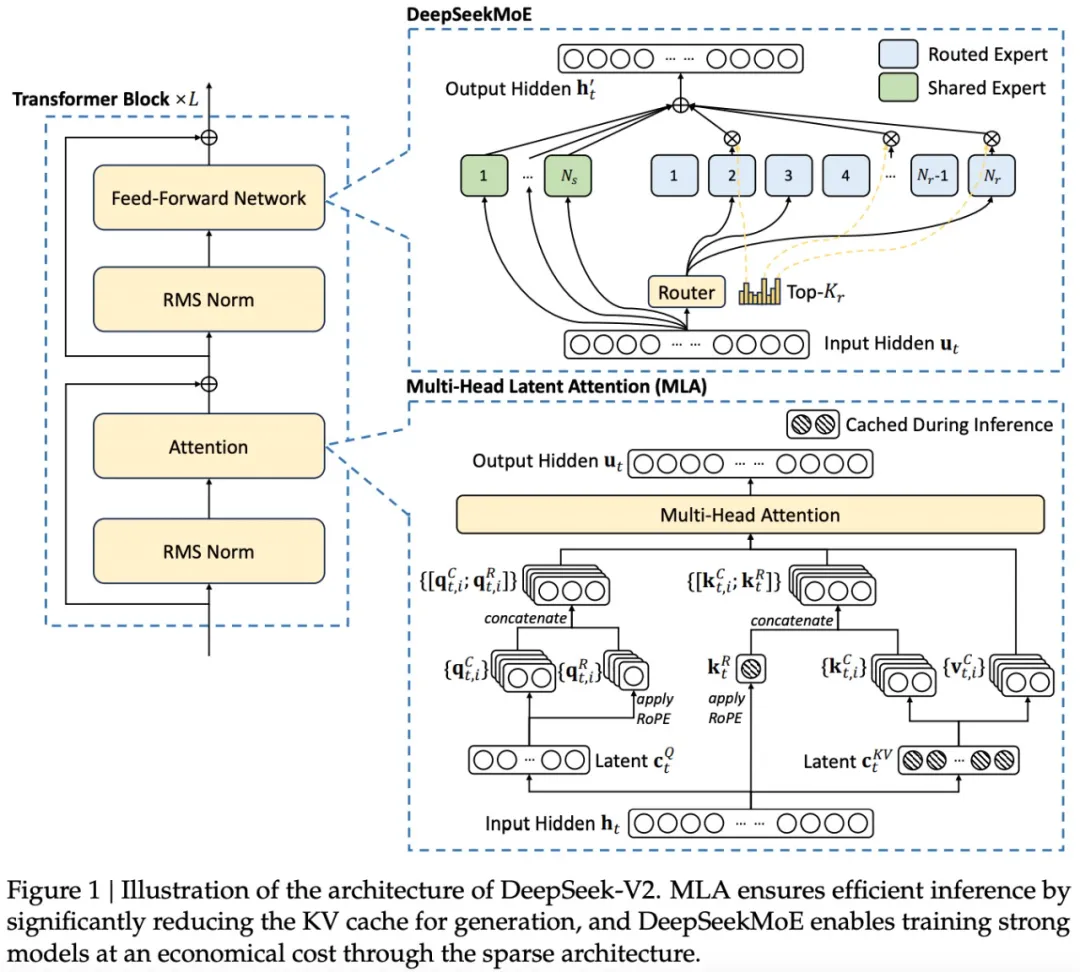

DeepSeek-V2 采用 Transformer 架構,其中每個 Transformer 塊由一個注意力模塊和一個前饋網絡(FFN)組成。然而,對于注意力模塊和 FFN,研究團隊設計并采用了創新的架構。

一方面,該研究設計了 MLA,利用低秩鍵值聯合壓縮來消除推理時鍵值緩存的瓶頸,從而支持高效推理。

另一方面,對于 FFN,該研究采用高性能 MoE 架構 —— DeepSeekMoE,以經濟的成本訓練強大的模型。

在一些細節上,DeepSeek-V2 遵循 DeepSeek 67B 的設置,DeepSeek-V2 的架構如下圖所示:

研究團隊構建了由 8.1T token 組成的高質量、多源預訓練語料庫。與 DeepSeek 67B 使用的語料庫相比,該語料庫的數據量特別是中文數據量更大,數據質量更高。

該研究首先在完整的預訓練語料庫上預訓練 DeepSeek-V2,然后再收集 150 萬個對話,涵蓋數學、代碼、寫作、推理、安全等各個領域,以便為 DeepSeek-V2 Chat 執行監督微調(SFT)。最后,該研究遵循 DeepSeekMath 采用群組相對策略優化 (GRPO) 進一步使模型與人類偏好保持一致。

DeepSeek-V2 基于高效且輕量級的框架 HAI-LLM 進行訓練,采用 16-way zero-bubble pipeline 并行、8-way 專家并行和 ZeRO-1 數據并行。鑒于 DeepSeek-V2 的激活參數相對較少,并且重新計算部分算子以節省激活內存,無需張量并行即可訓練,因此 DeepSeek-V2 減少了通信開銷。

此外,為了進一步提高訓練效率,該研究將計算和通信重疊,并為專家之間的通信、路由算法和線性融合計算定制了更快的 CUDA 內核。

實驗結果

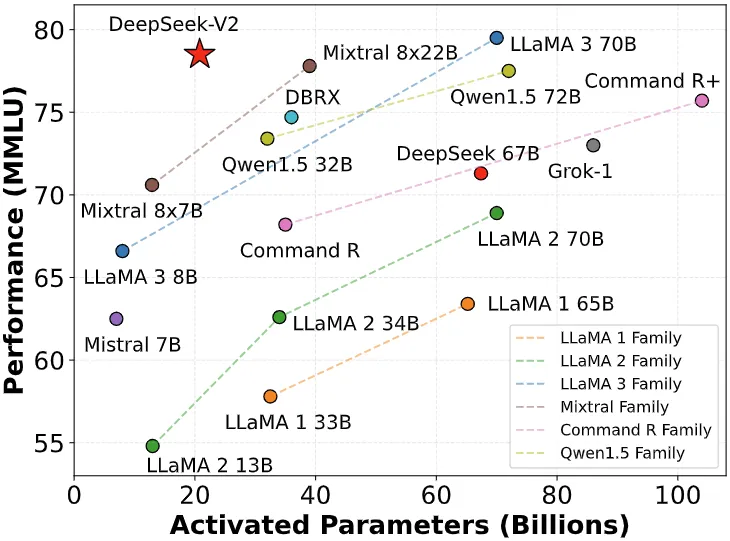

該研究在多種英文和中文基準上對 DeepSeek-V2 進行了評估,并將其與代表性的開源模型進行了比較。評估結果顯示,即使只有 21B 個激活參數,DeepSeek-V2 仍然達到了開源模型中頂級的性能,成為最強的開源 MoE 語言模型。

值得注意的是,與基礎版本相比,DeepSeek-V2 Chat (SFT) 在 GSM8K、MATH 和 HumanEval 評估方面表現出顯著改進。此外,DeepSeek-V2 Chat (RL) 進一步提升了數學和代碼基準測試的性能。

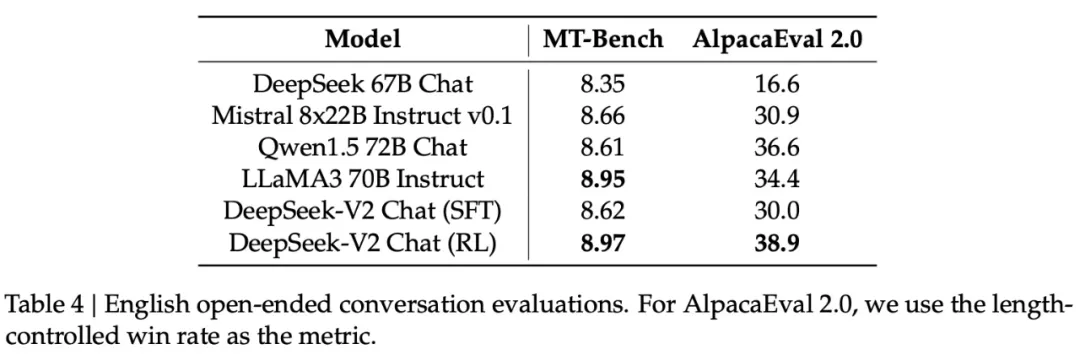

開放式生成的評估。研究團隊繼續在開放式對話基準上對模型進行額外評估。其中對于英文開放式對話生成,他們使用 MT-Bench 和 AlpacaEval 2.0 作為基準。表 4 中的評估結果表明, DeepSeek-V2 Chat (RL) 相對于 DeepSeek-V2 Chat (SFT) 具有顯著的性能優勢。這一結果展示了強化學習訓練在改進一致性方面的有效性。

與其他開源模型相比,DeepSeek-V2 Chat (RL) 在兩個基準的測試中均優于 Mistral 8x22B Instruct 和 Qwen1.5 72B Chat。與 LLaMA3 70B Instruct 相比,DeepSeek-V2 Chat (RL) 在 MT-Bench 上展現出具有競爭力的性能,并在 AlpacaEval 2.0 上的表現明顯勝出。

這些結果凸顯出了 DeepSeek-V2 Chat (RL) 在生成高質量且上下文相關的響應方面具有強大性能,尤其是在基于指令的對話任務中。

研究團隊基于 AlignBench 評估了中文大模型社區的開放式生成能力。如表 5 所示,DeepSeek-V2 Chat (RL) 比 DeepSeek-V2 Chat (SFT) 稍有優勢。尤其值得關注的是,DeepSeek-V2 Chat(SFT)大幅超越了所有開源中文模型,它在中文推理和語言方面都顯著優于第二好的開源模型 Qwen1.5 72B Chat。

此外,DeepSeek-V2 Chat (SFT) 和 DeepSeek-V2 Chat (RL) 的性能均優于 GPT-4-0613 和 ERNIEBot 4.0,鞏固了自家的模型在支持中文方面的頂級 LLM 地位。具體來說,DeepSeek-V2 Chat(RL)在中文理解方面表現出色,優于包括 GPT-4-Turbo-1106-Preview 在內的所有模型。不過 DeepSeek-V2 Chat(RL)的推理能力仍然落后于 Erniebot-4.0 和 GPT-4 等巨型模型。