MIT最新!多模態(tài)LLM真的無所不能嗎?大模型能解決一切難題嗎?

本文經(jīng)自動(dòng)駕駛之心公眾號(hào)授權(quán)轉(zhuǎn)載,轉(zhuǎn)載請(qǐng)聯(lián)系出處。

寫在前面&筆者的個(gè)人理解

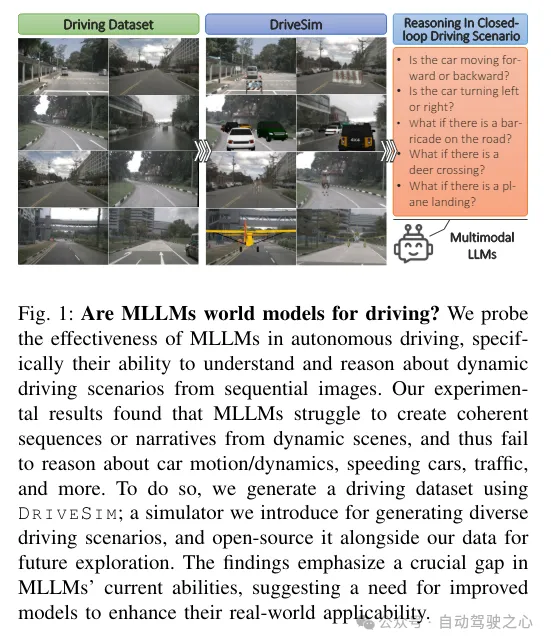

本文對(duì)自動(dòng)駕駛領(lǐng)域內(nèi)多模態(tài)大型語言模型(MLLMs)的應(yīng)用進(jìn)行了審慎的審視,并對(duì)一些常見的假設(shè)提出了質(zhì)疑/驗(yàn)證,重點(diǎn)關(guān)注它們通過閉環(huán)控制環(huán)境中的圖像/幀序列推理和解釋動(dòng)態(tài)駕駛場(chǎng)景的能力。盡管GPT-4V等MLLMs取得了顯著的進(jìn)步,但它們?cè)趶?fù)雜、動(dòng)態(tài)的駕駛環(huán)境中的性能在很大程度上仍未經(jīng)過測(cè)試,呈現(xiàn)出廣闊的探索領(lǐng)域。我們從固定車載攝像頭的角度,對(duì)各種MLLMs作為駕駛世界模型的能力進(jìn)行了全面的實(shí)驗(yàn)研究。發(fā)現(xiàn)表明,雖然這些模型能夠熟練地解釋單個(gè)圖像,但在合成描述動(dòng)態(tài)行為的幀之間的連貫敘述或邏輯序列時(shí)卻遇到了很大的困難。實(shí)驗(yàn)顯示出在預(yù)測(cè)(i)基本車輛動(dòng)力學(xué)(前進(jìn)/后退、加速/減速、右轉(zhuǎn)或左轉(zhuǎn)),(ii)與其他道路參與者(例如,識(shí)別超速車輛或重交通)的交互,(iii)軌跡規(guī)劃,以及(iv)開放集動(dòng)態(tài)場(chǎng)景推理時(shí)存在相當(dāng)大的不準(zhǔn)確性,這表明模型訓(xùn)練數(shù)據(jù)存在偏差。為了進(jìn)行這項(xiàng)實(shí)驗(yàn)研究,本文介紹了一個(gè)專門設(shè)計(jì)的模擬器DR I V ESI M,用于生成各種駕駛場(chǎng)景,為評(píng)估MLLMs在駕駛領(lǐng)域提供了平臺(tái)。此外,還貢獻(xiàn)了完整的開源代碼和一個(gè)新的數(shù)據(jù)集“EVAL-LLM-DRIVE”,用于評(píng)估駕駛中的MLLMs。結(jié)果凸顯了當(dāng)前最先進(jìn)的MLLMs在現(xiàn)有能力方面的關(guān)鍵差距,強(qiáng)調(diào)了需要增強(qiáng)的基礎(chǔ)模型來提高它們?cè)诂F(xiàn)實(shí)世界動(dòng)態(tài)環(huán)境中的應(yīng)用性。

主要貢獻(xiàn)

為此,在這項(xiàng)工作中,研究了MLLMs在駕駛場(chǎng)景中的推理能力,旨在衡量它們?cè)陂]環(huán)駕駛中理解復(fù)雜、動(dòng)態(tài)環(huán)境以及通過整合從安裝在駕駛車輛上的固定攝像頭捕獲的視覺數(shù)據(jù)序列來做出適當(dāng)決策的能力,就像MLLM是駕駛員一樣。

? 一項(xiàng)全面的實(shí)驗(yàn)研究,以評(píng)估不同MLLMs在涉及閉環(huán)駕駛和決策制定的場(chǎng)景中推理/理解場(chǎng)景的能力。測(cè)試涵蓋了環(huán)境交互的多個(gè)方面,包括自身車輛的駕駛動(dòng)態(tài)、其他道路參與者的動(dòng)態(tài)互動(dòng)、軌跡規(guī)劃以及開放集駕駛場(chǎng)景推理;更多細(xì)節(jié)見第I-A節(jié)。

? DRIVESIM;一個(gè)專門設(shè)計(jì)的模擬器,用于生成各種駕駛場(chǎng)景,從而提供了一個(gè)平臺(tái),用于從固定車內(nèi)攝像頭視角(與駕駛員視角相同)測(cè)試、評(píng)估/基準(zhǔn)測(cè)試MLLMs在理解和推理現(xiàn)實(shí)世界駕駛場(chǎng)景方面的能力。

? 令人驚訝的發(fā)現(xiàn)表明,包括GPT-4V和Claude3在內(nèi)的領(lǐng)先MLLMs在解釋、推理以及在動(dòng)態(tài)場(chǎng)景中采取正確行動(dòng)方面存在困難,即,在閉環(huán)駕駛設(shè)置中的幀序列存在重大不準(zhǔn)確性。這個(gè)問題在各種最先進(jìn)的(SOTA)模型中均有觀察到,很可能是由于它們的訓(xùn)練數(shù)據(jù)存在偏差。

? DRIVESIM的開源代碼,以及一個(gè)新的數(shù)據(jù)集“EVAL-LLM-DRIVE”,用于評(píng)估MLLMs作為駕駛世界模型的能力。

主要驗(yàn)證目標(biāo)

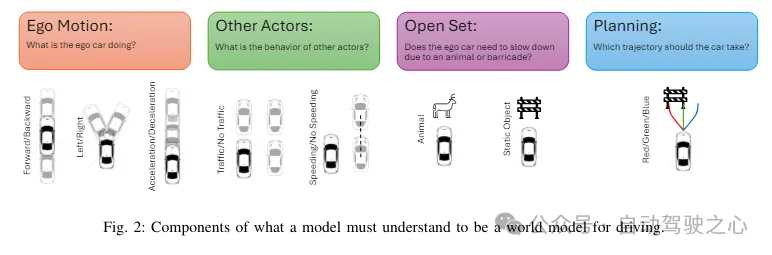

一個(gè)駕駛世界模型應(yīng)該包含環(huán)境交互和場(chǎng)景推理的多個(gè)方面,定義并測(cè)試如下:

(i)自身車輛動(dòng)態(tài):首先,仔細(xì)審查模型捕捉基本駕駛動(dòng)態(tài)的能力,如方向性(前進(jìn)或后退運(yùn)動(dòng))、速度變化(加速或減速)以及道路調(diào)整(右轉(zhuǎn)或左轉(zhuǎn))。

(ii)其他道路參與者的動(dòng)態(tài)互動(dòng):在掌握基礎(chǔ)之后,進(jìn)一步挑戰(zhàn)模型去推理其他道路參與者的動(dòng)態(tài)互動(dòng):檢測(cè)快速行駛的車輛、識(shí)別交通擁堵以及其他場(chǎng)景。

(iii)規(guī)劃能力:接著,檢查了模型規(guī)劃準(zhǔn)確駕駛軌跡的能力,檢查它們是否能夠有效避開沿途的障礙物。

(iv)開放集場(chǎng)景推理:適應(yīng)性的最終測(cè)試體現(xiàn)在開放集推理中,我們的測(cè)試打破了傳統(tǒng)的駕駛預(yù)期。它構(gòu)造了諸如飛機(jī)在道路上緊急降落或動(dòng)物突然出現(xiàn)的不可預(yù)測(cè)場(chǎng)景,挑戰(zhàn)了MLLMs在這個(gè)精心設(shè)計(jì)的世界模型中能夠預(yù)期和正確互動(dòng)的邊界。

DRIVESIM作為世界模型的GT

為了測(cè)試MLLMs作為駕駛世界模型的能力,需要理解圖2中展示的各個(gè)組件,我們提供了DR I V ESI M作為基準(zhǔn)駕駛世界模型,它能夠通過模擬廣泛的駕駛場(chǎng)景來探究MLLMs在(i)到(iv)各方面的推理能力,這些方面包括從基本車輛動(dòng)態(tài)到與其他道路使用者的交互以及意外事件,為測(cè)試MLLMs系統(tǒng)創(chuàng)建了一個(gè)豐富、動(dòng)態(tài)的環(huán)境。令人驚訝的是,在閉環(huán)設(shè)置下的動(dòng)態(tài)駕駛場(chǎng)景中評(píng)估MLLMs的能力在很大程度上仍未被探索,這可能是由于缺乏合適的模擬器或數(shù)據(jù)集。駕駛場(chǎng)景的復(fù)雜性,包括其連續(xù)運(yùn)動(dòng)和不可預(yù)測(cè)的事件,使得準(zhǔn)確模擬現(xiàn)實(shí)世界條件變得困難。DRIVESIM填補(bǔ)了這一空白,它提供了一個(gè)多功能的平臺(tái),能夠模擬從標(biāo)準(zhǔn)場(chǎng)景到意外事件的廣泛駕駛情況,同時(shí)允許對(duì)自車動(dòng)態(tài)進(jìn)行詳細(xì)的操控,并將(開放集)角色如動(dòng)物、路障和車輛添加到模擬中,豐富了可測(cè)試場(chǎng)景的種類,并增強(qiáng)了平臺(tái)在探測(cè)模型方面的實(shí)用性。這個(gè)模擬環(huán)境對(duì)于測(cè)試MLLMs隨時(shí)間推理、解釋序列和與動(dòng)態(tài)世界交互的能力至關(guān)重要。

通過在模擬器上進(jìn)行嚴(yán)格測(cè)試獲得的廣泛實(shí)驗(yàn)結(jié)果揭示了當(dāng)前MLLMs狀態(tài)的一個(gè)悖論。雖然這些模型在理解單個(gè)圖像方面顯示出強(qiáng)大的能力,但在將描繪動(dòng)態(tài)行為的一系列幀合成連貫的敘述或邏輯方面卻存在顯著的困難。

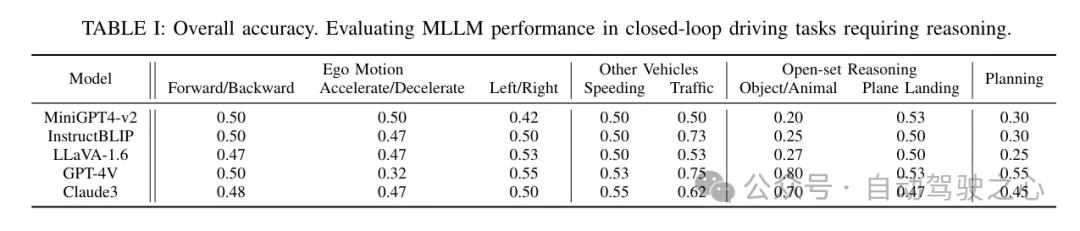

這種缺陷在它們嘗試推理車輛運(yùn)動(dòng)時(shí)尤為明顯,比如識(shí)別一輛車是向前還是向后移動(dòng);例如,GPT-4V將所有生成的場(chǎng)景都預(yù)測(cè)為向前行駛,達(dá)到了50%的準(zhǔn)確率!在加速或減速方面,它達(dá)到了35%的準(zhǔn)確率(甚至低于隨機(jī)猜測(cè)!),并明顯偏向于減速,而在確定轉(zhuǎn)彎方向時(shí),它達(dá)到了53%的準(zhǔn)確率,并且在右轉(zhuǎn)和左轉(zhuǎn)場(chǎng)景中都是隨機(jī)猜測(cè)的方式。在交通檢測(cè)方面,GPT-4V能夠達(dá)到75%的準(zhǔn)確率,但有一個(gè)明顯的限制,即它更可能報(bào)告沒有交通。最后,GPT-4V在識(shí)別超速車輛方面表現(xiàn)極差,它僅在30個(gè)包含超速車輛的場(chǎng)景中檢測(cè)到了兩個(gè)。這些結(jié)果在所有最先進(jìn)的MLLMs中都是一致的,包括Claude3、LLaVa-1.6、InstructBLIP等。

此外,實(shí)驗(yàn)研究中還提供了開放集推理實(shí)驗(yàn)——仍然展示了當(dāng)前最先進(jìn)的MLLMs的局限性。可能的原因是MLLMs訓(xùn)練數(shù)據(jù)中的偏差,因?yàn)橥ǔ\囕v都是向前移動(dòng)的,而且在駕駛中讓車輛減速比加速更安全。總之,這些實(shí)驗(yàn)突顯了模型在將離散視覺信息隨時(shí)間連接起來以推斷運(yùn)動(dòng)方面的關(guān)鍵差距,表明它們?cè)诋?dāng)前狀態(tài)下在理解現(xiàn)實(shí)世界動(dòng)態(tài)中固有的流動(dòng)性和連續(xù)性方面存在限制。

方法介紹

為了滿足實(shí)驗(yàn)設(shè)置的要求,這需要一個(gè)受控環(huán)境和反事實(shí)測(cè)試(即生成與原始數(shù)據(jù)集不同的反事實(shí)數(shù)據(jù),而不是MLLMs的反事實(shí)推理),在nuScenes數(shù)據(jù)集的基礎(chǔ)上開發(fā)了一個(gè)數(shù)據(jù)驅(qū)動(dòng)的模擬器。這種方法有效地平衡了傳感器逼真度、閉環(huán)模擬和場(chǎng)景設(shè)置可控性,使其成為我們用例的理想選擇。在隨后的部分中,將概述模擬器的關(guān)鍵特性,并闡述它們對(duì)我們理解駕駛場(chǎng)景中MLLMs推理過程的實(shí)證研究的重要性。

閉環(huán)傳感器合成與控制。實(shí)驗(yàn)方法的核心涉及通過閉環(huán)執(zhí)行決策制定來探究MLLMs的推理過程,具體提出的問題包括:

? 如果車輛采取與數(shù)據(jù)集中不同的行動(dòng),結(jié)果會(huì)如何?

要解決這個(gè)問題,需要實(shí)施傳感器合成以適應(yīng)假設(shè)的“如果...會(huì)怎樣”的場(chǎng)景。從自車的初始位置開始,利用車輛動(dòng)力學(xué)進(jìn)行閉環(huán)控制,并將輸入空間特征化如下:(i)使用自行車模型表示加速和轉(zhuǎn)向速度,(ii)通過自行車模型的集成版本表示速度和轉(zhuǎn)向角,以及(iii)相對(duì)于局部坐標(biāo)系進(jìn)行直接姿態(tài)調(diào)整(用于無動(dòng)力學(xué)的運(yùn)動(dòng)規(guī)劃)。為了促進(jìn)傳感器合成,結(jié)合實(shí)際傳感器測(cè)量和重仿真技術(shù),結(jié)合地圖信息(這對(duì)于后續(xù)部分中的對(duì)象/行為者合成和行為建模也至關(guān)重要)。從高層次上講,地圖信息包括相互連接的車道段和其他幾何元素,這些元素定義了各種道路組成部分,如停車線和交通標(biāo)志。沿著每個(gè)車道段,都有與傳感器測(cè)量值(如相機(jī)圖像)相關(guān)聯(lián)的樣本點(diǎn)。通過車輛動(dòng)力學(xué)導(dǎo)出的姿態(tài)與地圖上的最近樣本點(diǎn)進(jìn)行匹配,結(jié)合傳感器的方向,為渲染和行為建模提供了局部坐標(biāo)系。對(duì)于渲染,首先通過應(yīng)用于RGB圖像和稀疏LiDAR點(diǎn)的深度完成技術(shù)來獲取深度信息。隨后,使用針孔相機(jī)模型將RGB像素投影到3D空間中,創(chuàng)建一個(gè)可以從不同視點(diǎn)渲染的3D網(wǎng)格。利用基于局部坐標(biāo)系到用于重仿真的目標(biāo)RGB圖像和用戶定義的相機(jī)內(nèi)參計(jì)算出的外參,我們可以對(duì)最終圖像進(jìn)行渲染。

場(chǎng)景中的對(duì)象和角色合成。'如果...會(huì)怎樣'實(shí)驗(yàn)設(shè)置的另一個(gè)方面涉及處理如“如果一只鹿突然出現(xiàn)在路邊?”這樣的場(chǎng)景。這需要具備在場(chǎng)景中模擬合成對(duì)象或角色的能力。基于前面描述的3D重建流程,我們將所需對(duì)象和角色的3D網(wǎng)格無縫集成到場(chǎng)景中。這些網(wǎng)格可以高效地通過利用LLMs對(duì)Objaverse數(shù)據(jù)集上注釋的文本理解能力來獲取。例如,可以識(shí)別出表明相應(yīng)網(wǎng)格代表動(dòng)物的注釋。利用地圖的幾何和語義信息,將網(wǎng)格放置在合理的位置和方向上。示例包括自車所在車道的旁邊、交通燈下方、停車線上方等。

角色的行為建模。在添加了合成角色之后,這些角色的行為或移動(dòng)對(duì)于MLLMs的推理過程變得至關(guān)重要。這引入了探索以下場(chǎng)景的必要性:

? “如果一架飛機(jī)在頭頂飛過或降落在路上怎么辦?”或者 ? “如果汽車因?yàn)榻煌ǘ氯鴾p速怎么辦?”

對(duì)于地面車輛的行為,采用比例-積分-微分(PID)控制器進(jìn)行轉(zhuǎn)向控制,以跟蹤從地圖或運(yùn)動(dòng)計(jì)劃中獲取的參考路徑;對(duì)于加速控制,使用智能駕駛員模型(IDM),該模型專注于在自車前方最近且可能導(dǎo)致與自車碰撞的移動(dòng)物體。對(duì)于運(yùn)動(dòng)規(guī)劃,采用帶有五次多項(xiàng)式軌跡生成的狀態(tài)網(wǎng)格規(guī)劃器,其中目標(biāo)狀態(tài)網(wǎng)格被確定為在當(dāng)前車道或相鄰車道中自車前方特定距離的位置。為了模擬其他角色的行為,通過在預(yù)定義的起始和結(jié)束姿態(tài)之間進(jìn)行樣條插值來創(chuàng)建軌跡。重點(diǎn)是模擬合成角色對(duì)自車、自身以及場(chǎng)景中其他已存在角色或?qū)ο蟮姆磻?yīng)行為,而不是已存在實(shí)體的行為。

實(shí)驗(yàn)研究

這里展示了SOTA MLLMs(大規(guī)模語言模型)作為DR I V ESI M提出的關(guān)鍵場(chǎng)景中的世界模型的性能,這些場(chǎng)景與圖2中展示的類別相對(duì)應(yīng)。我們使用第I-A節(jié)中解釋的范式來測(cè)試MLLMs作為駕駛世界模型的能力,具體來說,測(cè)試它們確定自車運(yùn)動(dòng)的能力:車輛是前進(jìn)還是后退?是在加速還是減速?是左轉(zhuǎn)還是右轉(zhuǎn)?所有這些都是以分類的方式進(jìn)行的。然后,評(píng)估街道上其他因素的推理能力,以確定它是否檢測(cè)到超速車輛(是否有超速車輛?)或交通擁堵(是否有交通擁堵?)。此外,測(cè)試MLLMs在開放(甚至異常)環(huán)境(如提供突然出現(xiàn)動(dòng)物或靜態(tài)物體甚至飛機(jī)降落的圖像)中的決策能力(自車是否能在同一車道內(nèi)繼續(xù)行駛?)。最后,可以測(cè)試MLLMs在嘗試保持在車道內(nèi)的同時(shí)選擇最佳軌跡繞過障礙物的能力(應(yīng)該遵循哪條軌跡?)。在表I中,展示了Claude3、GPT-4V、LLaVA-1.6、InstructBLIP和MiniGPT4-v2在這些情況下的表現(xiàn)。

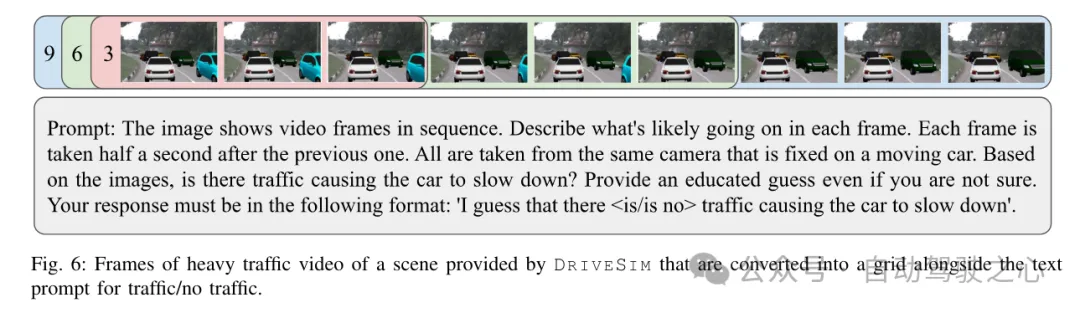

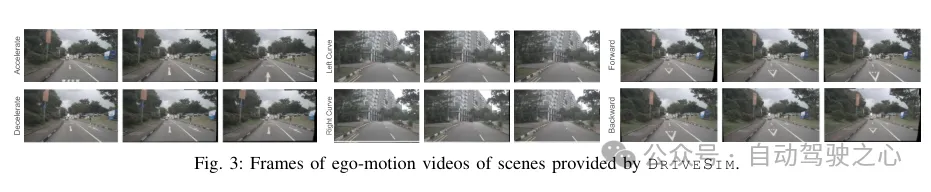

視頻場(chǎng)景表示。我們的目標(biāo)是為模型提供由DR I V ESI M生成的視頻輸入,以模擬真實(shí)世界駕駛場(chǎng)景中的攝像頭視角。我們提供不同級(jí)別的視頻信息,以便評(píng)估時(shí)序推理。這種設(shè)置如圖6所示。使用模擬的視頻數(shù)據(jù)創(chuàng)建了一個(gè)視頻幀網(wǎng)格,其中每個(gè)幀之間相隔半秒。測(cè)試了不同數(shù)量的幀:三個(gè)、六個(gè)和九個(gè)。這種輸入格式是為了避免模型在采用多查詢方法解析圖像時(shí)可能遇到的問題,同時(shí)避免在提供大量幀時(shí)遇到上下文長(zhǎng)度限制。

Prompting。除了這些幀之外,還必須提供一個(gè)適當(dāng)?shù)奈谋咎崾疽垣@得響應(yīng)。提示必須告知模型圖像的格式,即幀來自安裝在移動(dòng)汽車上的攝像頭,并獲得對(duì)相關(guān)問題的響應(yīng)。這在圖6中的示例提示中有所展示,該提示詢問自車是否正在經(jīng)歷交通擁堵或無交通擁堵。當(dāng)提示自車動(dòng)作和其他角色行為場(chǎng)景時(shí),遵循類似的格式。要求描述每一幀中可能正在發(fā)生的事情,以確保模型理解它正在解析視頻并遵循正確的幀順序,然后可以手動(dòng)驗(yàn)證每一幀的解釋。

評(píng)估。將從MLLM獲得的結(jié)果與DRIVESI M提供的真實(shí)情況進(jìn)行比較。為了進(jìn)一步擴(kuò)展表I中給出的這一評(píng)估過程的結(jié)果,深入探討了自車運(yùn)動(dòng)、其他角色行為、開放集和規(guī)劃推理的具體內(nèi)容。由于GPT-4V和Claude3作為當(dāng)前可用的最大模型之一以及在評(píng)估中觀察到的高水平推理能力,這里提供了一個(gè)更復(fù)雜的分析,重點(diǎn)關(guān)注這兩個(gè)模型。

1)自車運(yùn)動(dòng)推理

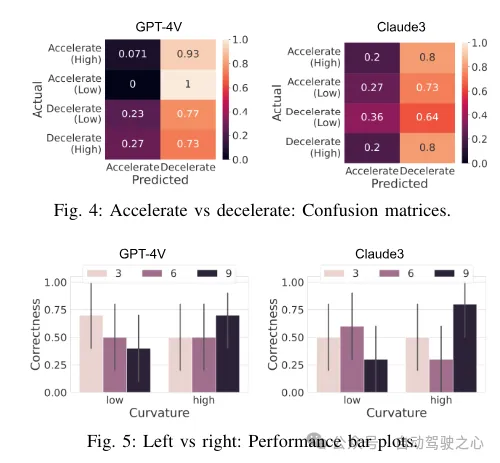

評(píng)估了高加速率、低加速率、高減速率和低減速率的情況

如表I所示,對(duì)于大多數(shù)模型,性能大約為50%,尤其是GPT-4V,表現(xiàn)較差,僅為32%。在圖4中探索了GPT-4V和Claude3的性能。這些混淆矩陣是在我們向模型提供高和低加速率以及減速率場(chǎng)景時(shí)得到的。請(qǐng)注意,在這些測(cè)試中,GPT-4V偏向于減速的響應(yīng)。有趣的是,與真實(shí)情況是加速相比,當(dāng)真實(shí)情況是減速時(shí),模型預(yù)測(cè)為加速的情況更多。對(duì)于Claude3,雖然仍然偏向于減速,但其程度沒有GPT-4V那么極端。

2)他車運(yùn)動(dòng)推理

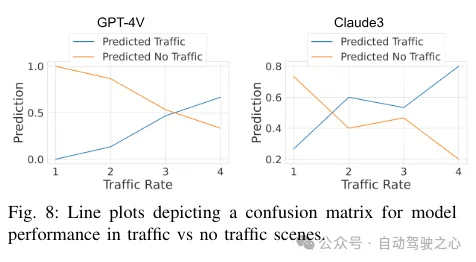

交通與無交通是基于其他道路使用者行為的一種常見情況。交通的產(chǎn)生主要有兩個(gè)來源:道路上的其他車輛數(shù)量以及給定其他車輛的情況下,自車能夠移動(dòng)的速度。因此,幾何理解對(duì)于觀察場(chǎng)景中的其他車輛數(shù)量是必要的,而幾何和時(shí)序推理的結(jié)合則用于判斷交通流的速度。在我們的模擬器中,我們提供了四個(gè)級(jí)別的交通情況。(i) 最低級(jí)別,即無交通標(biāo)簽,表示與自車在同一車道上沒有其他車輛,允許自車自由行駛。(ii) 次低級(jí)別,同樣標(biāo)記為無交通,是指雖然有其他車輛與自車在同一車道上,但這些車輛的速度足夠快,不會(huì)阻礙自車的期望速度。(iii) 下一級(jí)別,我們將其標(biāo)記為交通,是指有大量其他車輛,但交通流是緩慢且穩(wěn)定的。(iv) 最高級(jí)別,我們也將其標(biāo)記為交通,是指大量車輛都以非常慢的速度移動(dòng)。圖6展示了一個(gè)最高級(jí)別交通狀況的視頻。即使只是匆匆一瞥,由于其他車輛的密度和自車的緩慢移動(dòng),人類也能清晰地分辨出交通狀況的程度。

為了消除查詢模型時(shí)的歧義,我們必須明確“交通”的含義。因此,我們?cè)谔崾镜南鄳?yīng)部分中指定了:“是否有交通導(dǎo)致車輛減速?”(如圖6中的提示所示)。在使用此提示進(jìn)行評(píng)估時(shí),發(fā)現(xiàn)與自車運(yùn)動(dòng)案例相比,這種情況下的準(zhǔn)確率普遍更高,如表I所示。進(jìn)一步在圖8中探索了GPT-4V和Claude3的結(jié)果,該圖顯示了當(dāng)我們將高低不同交通流量的場(chǎng)景提供給模型時(shí),描述混淆矩陣的折線圖。預(yù)測(cè)總體上與交通水平呈正相關(guān),其中Claude3在識(shí)別高交通水平時(shí)更為成功,而GPT-4V在識(shí)別無交通時(shí)特別成功。盡管不是完美的,但模型在識(shí)別交通方面的能力是在自車運(yùn)動(dòng)和其他行為者場(chǎng)景中取得的最高成功率。

3)開集推理

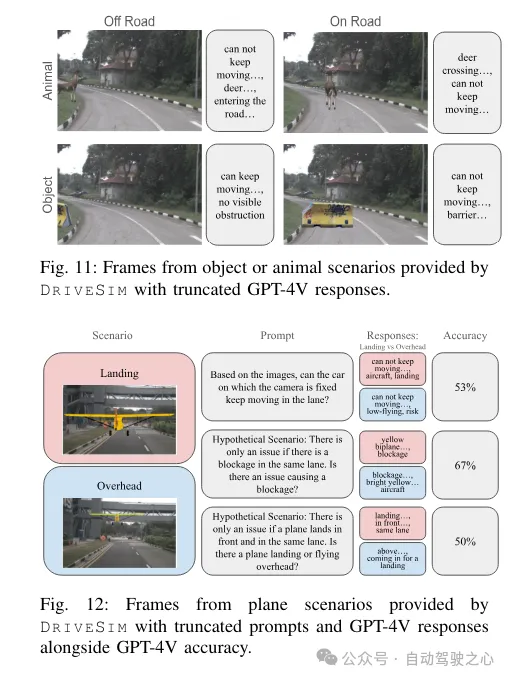

場(chǎng)景中動(dòng)物和靜態(tài)物體的看似隨機(jī)的放置是DRIVESIM能夠評(píng)估多語言大型模型(MLLMs)的開放集場(chǎng)景之一。作為人類駕駛員,你已經(jīng)準(zhǔn)備好應(yīng)對(duì)這些意外情況。如果靜態(tài)物體在路上,你會(huì)減速或避開它,但如果它不在路上,你的駕駛方式就不會(huì)改變。然而,對(duì)于動(dòng)物來說,存在它是否會(huì)移動(dòng)的不確定性,因此無論如何,你都必須減速或避開它。因此,從人類的角度來看,圖11中呈現(xiàn)的場(chǎng)景中應(yīng)該怎么做是很清楚的。我們可以看到,大型模型GPT-4V和Claude3在這些情況下的推理相當(dāng)成功,如表I所示,以及圖11中GPT-4V的響應(yīng)所示。

飛機(jī)著陸與頭頂飛過是一個(gè)我們能夠通過DRIVESIM探索的引人入勝的開放集場(chǎng)景。人類駕駛員可能不知道如何應(yīng)對(duì)這樣的極端情況,但我們可以觀察多語言大型模型(MLLMs)的行為。圖12中的幀展示了一個(gè)飛機(jī)著陸或頭頂飛過的場(chǎng)景。在用于編制表I結(jié)果的主要提示中,我們觀察到,無論飛機(jī)是否著陸,模型都建議你不能繼續(xù)行駛,因?yàn)榇嬖陲L(fēng)險(xiǎn):這是一個(gè)合理的反應(yīng)。因此,我們探索了一些假設(shè)場(chǎng)景,這些場(chǎng)景真正考驗(yàn)了模型對(duì)飛機(jī)運(yùn)動(dòng)的幾何和時(shí)序理解,這與其他駕駛場(chǎng)景完全不同。

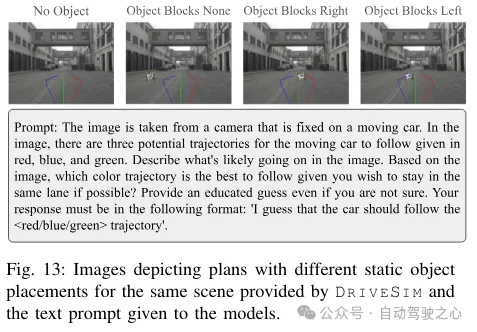

4)規(guī)劃推理

最后,我們展示了我們的規(guī)劃實(shí)驗(yàn)。通過DRIVESIM,我們能夠生成到地圖上某個(gè)點(diǎn)的規(guī)劃,并在相機(jī)視圖中進(jìn)行可視化。我們還可以將靜態(tài)物體引入場(chǎng)景中,并評(píng)估多語言大型模型(MLLMs)是否能夠選擇繞過這些障礙物的規(guī)劃。在圖13中,我們展示了針對(duì)給定場(chǎng)景的四種規(guī)劃評(píng)估方法:(1) 無障礙物,(2) 物體不阻擋任何軌跡,(3) 物體阻擋中間和右側(cè)軌跡,(4) 物體阻擋中間和左側(cè)軌跡。考慮到保持在同一車道內(nèi)的目標(biāo),并且給出了三種軌跡選擇,人類駕駛員在每個(gè)例子中都會(huì)有明確的選擇:(1) 綠色,(2) 綠色,(3) 藍(lán)色,和(4) 紅色。為了運(yùn)行評(píng)估,我們需要使用不同風(fēng)格的提示來在單張圖像中選擇軌跡。因此,我們使用了圖13中顯示的提示,其中我們還指定了保持在同一車道內(nèi)的目標(biāo),因此總是有一個(gè)正確的選擇。從表I中我們可以看到,較大的模型GPT-4V和Claude3的準(zhǔn)確率顯著優(yōu)于其他模型。然而,它們的成功率仍然只有大約50%,這對(duì)于旨在用于閉環(huán)規(guī)劃的模型來說并不理想。因此,需要進(jìn)一步探究以找出限制的來源。我們通過在提示中添加“同時(shí)避開障礙物”將Claude3的性能從45%提高到55%。這一改進(jìn)揭示了多語言大型模型作為世界模型在提高準(zhǔn)確率方面的失敗。

結(jié)論

這項(xiàng)工作展示了包括GPT-4V和Claude3在內(nèi)的當(dāng)前最先進(jìn)的多語言大型模型(SOTA MLLMs)作為駕駛世界模型的現(xiàn)有能力。盡管它們?cè)趩蝹€(gè)圖像分析方面表現(xiàn)出色,但通過我們廣泛的實(shí)驗(yàn)結(jié)果,它們?cè)诳缍鄠€(gè)駕駛場(chǎng)景幀進(jìn)行推理方面的局限性已經(jīng)變得顯而易見。我們觀察到,無法處理各種場(chǎng)景明顯是由于預(yù)期車輛運(yùn)動(dòng)的偏差所致,例如在道路上行駛時(shí)的向前運(yùn)動(dòng)。盡管許多準(zhǔn)確率水平似乎隨機(jī),但DRIVESIM允許我們深入探究預(yù)測(cè)背后的推理能力,揭示偏差的詳細(xì)信息。雖然在理解現(xiàn)實(shí)世界動(dòng)態(tài)方面存在局限性,但明確的前進(jìn)道路展示了如何改進(jìn)它們。未來的工作可以利用DRIVESIM為微調(diào)MLLMs提供數(shù)據(jù),結(jié)合先進(jìn)的仿真功能(如路徑規(guī)劃),以增強(qiáng)對(duì)下一代MLLMs的評(píng)估。