按需搭配一鍵疊穿,效果拿下新SOTA!中山大學(xué)&字節(jié)智創(chuàng)數(shù)字人團(tuán)隊(duì)提出虛擬試穿新框架

多件衣服按指定穿法一鍵虛擬試穿!

中山大學(xué)&字節(jié)智創(chuàng)數(shù)字人團(tuán)隊(duì)提出了一個(gè)名為MMTryon的虛擬試穿框架,可以通過(guò)輸入多個(gè)服裝圖像及指定穿法的文本指令來(lái)生成高質(zhì)量的組合試穿結(jié)果。

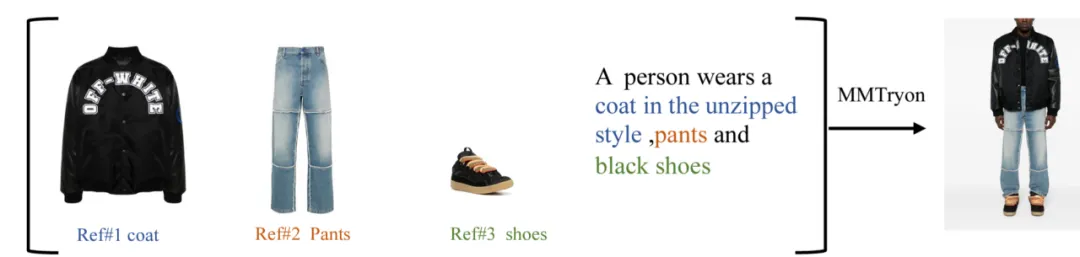

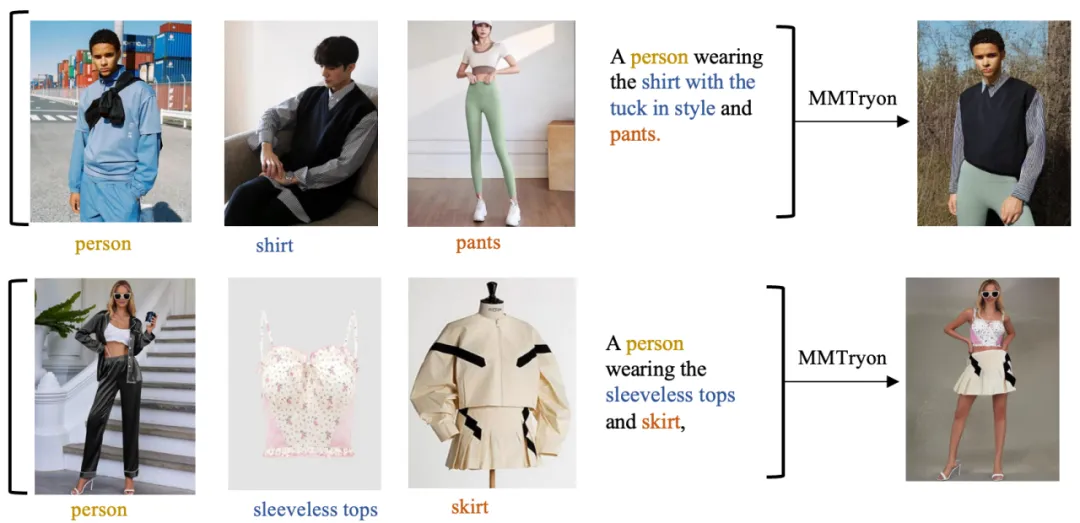

比如選中一件大衣、一條褲子,再配一個(gè)包,用語(yǔ)言描述穿法,“啪”的一鍵就穿到了人像上:

無(wú)論是真人圖像又或是漫畫(huà)人物,都能一鍵按照搭配試穿衣服:

對(duì)于單圖換裝,MMTryon有效利用了大量的數(shù)據(jù)設(shè)計(jì)了一個(gè)表征能力強(qiáng)大的服裝編碼器,使得該方案能處理復(fù)雜的換裝場(chǎng)景及任意服裝款式;

對(duì)于組合換裝,MMTryon消除了傳統(tǒng)虛擬換裝算法中對(duì)服裝精細(xì)分割的依賴,可依靠一條文本指令從多張服裝參考圖像中選擇需要試穿的服裝及對(duì)應(yīng)的穿法,生成真實(shí)自然的組合換裝效果。

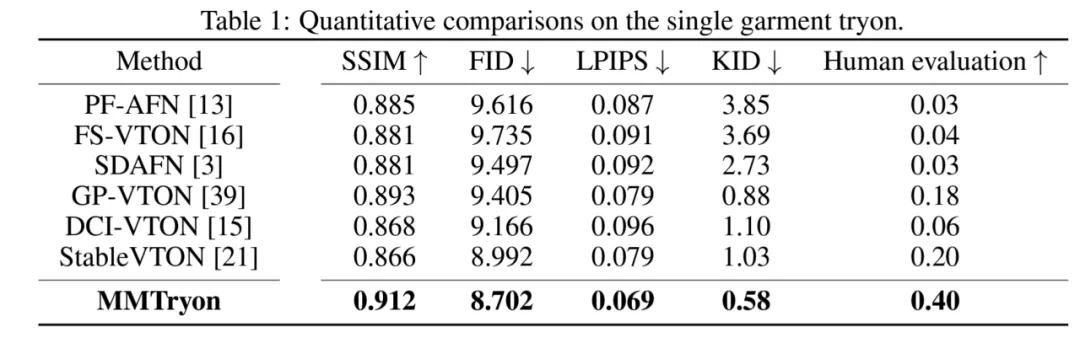

在基準(zhǔn)測(cè)試中,MMTryon拿下新SOTA。

多模態(tài)多參考注意機(jī)制加持,效果更精確靈活

虛擬換裝技術(shù)旨在將模特所穿服飾或者衣服的平鋪圖穿到目標(biāo)人物身上,達(dá)到換裝的效果,但是之前虛擬試穿的方案存在一些技術(shù)難點(diǎn)沒(méi)有解決。

首先,現(xiàn)有的方法通常是為單件試穿任務(wù)(上衣/下衣、連衣裙)而設(shè)計(jì)的,并且無(wú)法自定義著裝風(fēng)格,例如,外套拉上/拉開(kāi)拉鏈、上衣塞入/塞出等。

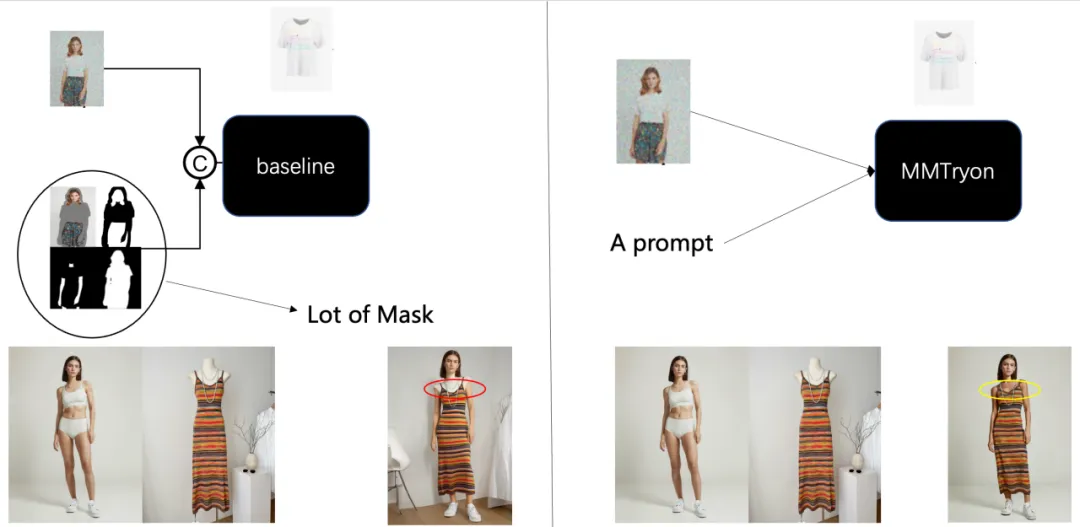

另外,之前的方案嚴(yán)重依賴特定于類(lèi)別的分割模型來(lái)識(shí)別試穿區(qū)域,如下圖所示如果分割錯(cuò)誤則將直接導(dǎo)致試穿結(jié)果中出現(xiàn)明顯的試穿錯(cuò)誤或者偽影等情況。

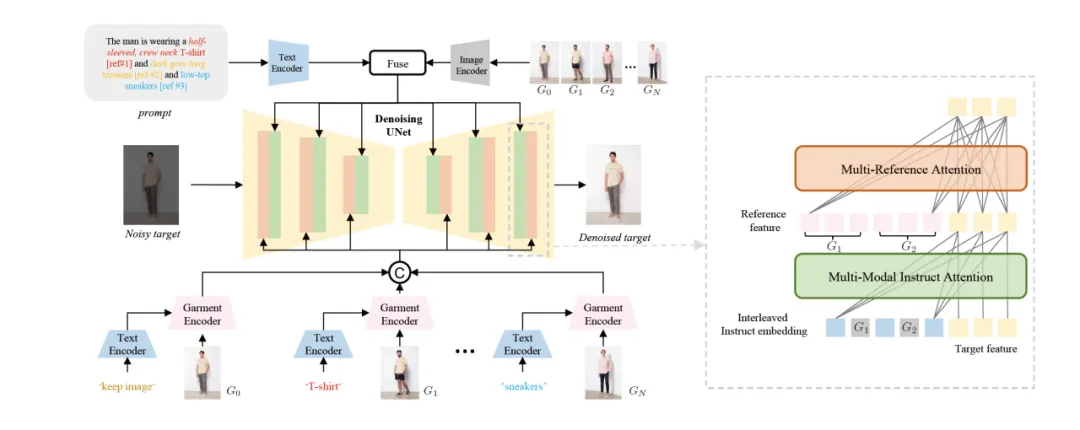

為了解決這些問(wèn)題,研究團(tuán)隊(duì)提出了MMTryon,將參考圖像中的服裝信息與文本指令中的著裝風(fēng)格信息通過(guò)一種新穎的多模態(tài)和多參考注意機(jī)制來(lái)進(jìn)行表示,這使得該方案支持組合式換裝以及多樣的試穿風(fēng)格。

此外,為了消除對(duì)分割的依賴性,MMTryon使用了表征能力豐富的服裝編碼器,并利用新穎的可擴(kuò)展的數(shù)據(jù)生成流程增強(qiáng)現(xiàn)有的數(shù)據(jù)集,這樣在推理階段,MMtryon無(wú)需任何分割,僅僅通過(guò)文本以及多個(gè)試穿對(duì)象即可實(shí)現(xiàn)高質(zhì)量虛擬換裝。

在開(kāi)源的數(shù)據(jù)集以及復(fù)雜場(chǎng)景下進(jìn)行的大量實(shí)驗(yàn)在定性和定量上證明了MMTryon優(yōu)于現(xiàn)有SOTA方法。

接下來(lái)是更具體的方法。

首先研究團(tuán)隊(duì)預(yù)訓(xùn)練了一個(gè)服裝編碼器,在這一stage中MMTryon利用文本作為query,將得到的特征與grouding dino+SAM所得到的mask計(jì)算一個(gè)query損失。

目標(biāo)是經(jīng)過(guò)text query 后僅激活文本對(duì)應(yīng)區(qū)域的特征,這樣可以擺脫對(duì)于服裝分割的依賴。同時(shí),利用大量的pair對(duì)更好的編碼服裝特征。

之后,為了更穩(wěn)定的訓(xùn)練組合換裝,需要多件服裝組合式換裝的pair圖,但是這樣的pair圖采集成本很高。

為此,研究團(tuán)隊(duì)提出了一個(gè)基于大模型的數(shù)據(jù)擴(kuò)增模式,利用視覺(jué)語(yǔ)言模型以及grouding dino+SAM去得到了不同區(qū)域的mask,來(lái)保護(hù)對(duì)應(yīng)的上衣或者下衣區(qū)域,利用stable diffusion XL去重繪保護(hù)區(qū)域外剩下的內(nèi)容,構(gòu)建了100w的增強(qiáng)數(shù)據(jù)集,訓(xùn)練中將增強(qiáng)數(shù)據(jù)集與90w原始數(shù)據(jù)一起加入訓(xùn)練。

基于增強(qiáng)的數(shù)據(jù)集以及服裝編碼器,MMTryon設(shè)計(jì)了多參考圖像注意力模塊和多模態(tài)圖文注意力模塊,其中多參考圖圖像注意力模塊用于將多件衣服的特征注入到目標(biāo)圖像來(lái)控制多件衣服的試穿,多模態(tài)圖文注意力模塊利用詳細(xì)的文本與圖像的clip編碼來(lái)控制多樣的試穿風(fēng)格。

可以看到,MMtryon 由于服飾編碼器豐富的表征能力,對(duì)于各種類(lèi)型的換裝都可以有真實(shí)的虛擬試穿效果:

無(wú)論是真人圖像還是掛臺(tái)服飾,只需要多張服裝參考圖像及文本,就可以組合式換裝并控制換裝風(fēng)格。

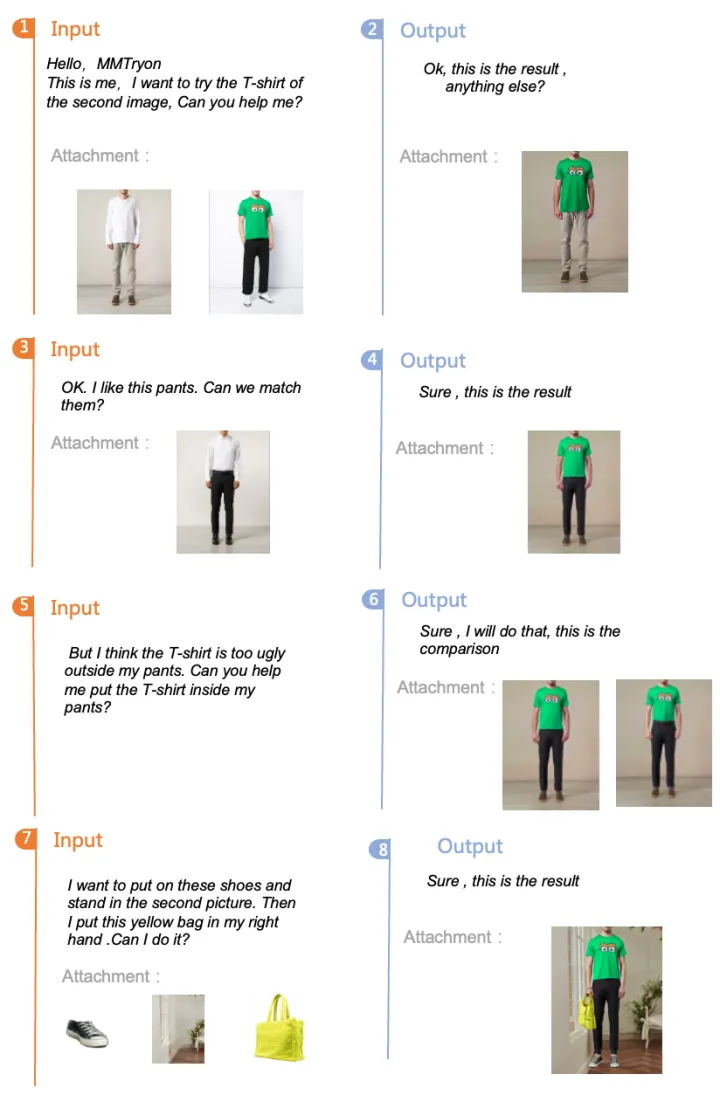

甚至還能作為一個(gè)fashion換裝輔助設(shè)計(jì)來(lái)幫你買(mǎi)衣服:

在量化指標(biāo)上,MMTryon優(yōu)于其他baseline的的效果,在開(kāi)源數(shù)據(jù)集測(cè)試集合的Human evaluation中,MMTryon也超過(guò)其它baseline模型

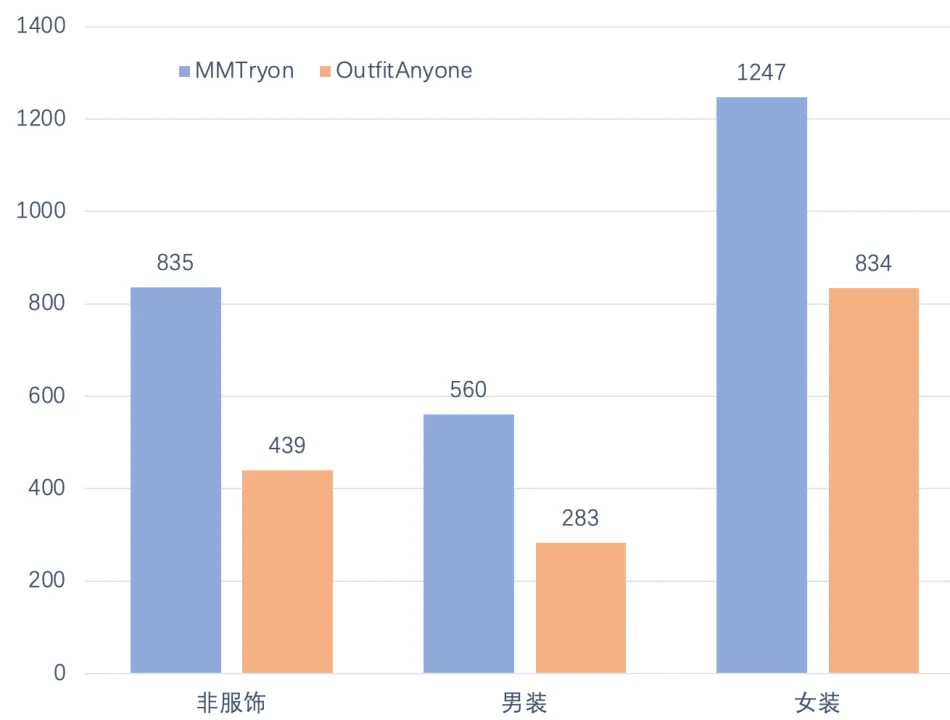

在復(fù)雜場(chǎng)景的Human evaluation中,MMTryon也超越了目前的社區(qū)模型outfit anyone。

研究人員收集了復(fù)雜場(chǎng)景女裝圖片142張,男裝圖片57張,非服裝圖片87張,共邀請(qǐng)15位參與者參與評(píng)測(cè),選擇更喜歡的方案結(jié)果。從圖表中可以看出,MMTryon的效果更受測(cè)試者的喜歡。

更多細(xì)節(jié),感興趣的家人們可以查看論文~

論文鏈接:https://arxiv.org/abs/2405.00448