專治大模型“刷題”!賈佳亞團隊新基準讓模型只挑錯不做題,GPT-4得分不到50

大模型測試能拿高分,實際場景中卻表現不佳的問題有解了。

賈佳亞團隊聯合多家知名高校提出了一種全新的測評方法,讓一些模型立馬現出了原型。

這下不用擔心大模型“刷題”太多,測試集無法體現真實水平了。

這個新的測評數據集叫做MR-Ben,利用的是GSM8K、MMLU等數據集中的現有題目。

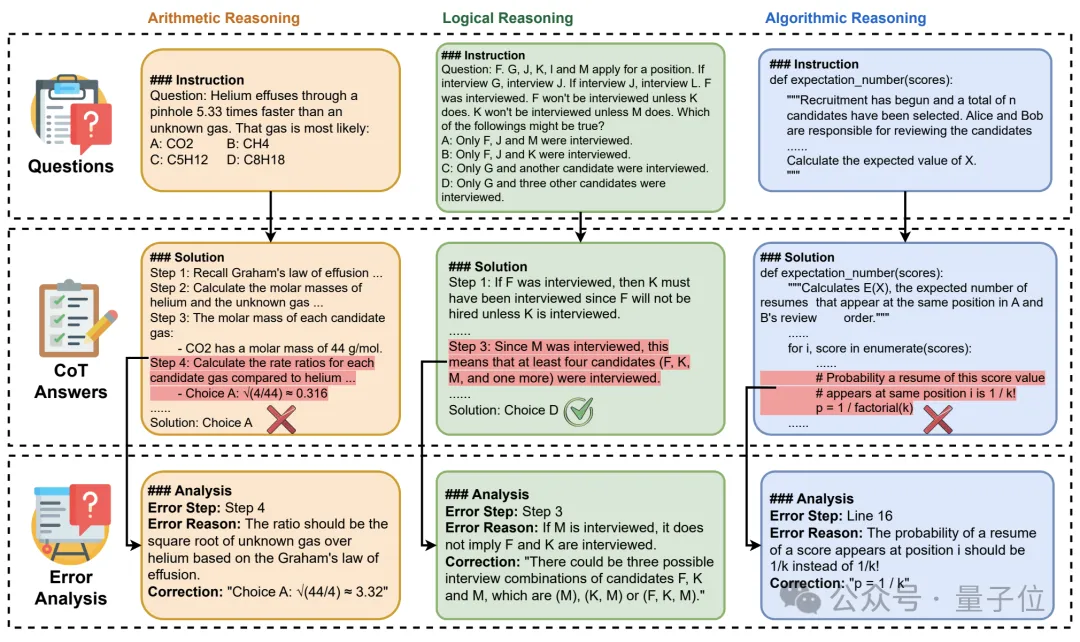

只不過,大模型在測試中的身份從“答題學生”變成了“閱卷老師”,任務是要給已有的解答步驟指出錯誤。

這樣一來,模型無法再通過背誦或猜測撞對題目,測試題泄露也無需擔心了。

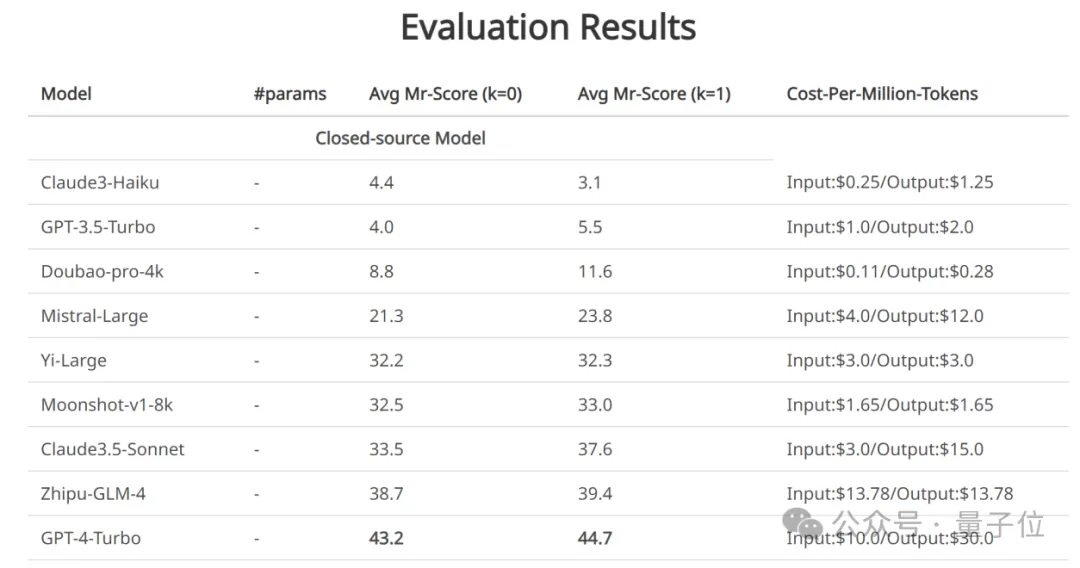

利用MR-Ben,賈佳亞團隊評測了GPT4-Turbo、Cluade3.5-Sonnet、GLM4、Qwen2-70B等許多開源和閉源模型。

目前,該數據集涉及的所有代碼和數據均已開源。

熟悉的試題,全新的任務

目前,大模型測試的主流方向是使用人類的標準化考試——選擇題和填空題的方式去進行大模型評測。

這套測試方式的優點是標準明確、指標直觀,且量化結果天然具有話題性。

但作者認為,由于現在的大模型普遍采用逐步作答的思維鏈方式生成最終答案,導致這種方式并不“靠譜”。

預訓練模型在預訓練時早已見過數以萬億級別的token,很難判斷被評測的模型是否早已見過相應的數據,從而通過“背題”的方式回答正確。

而因為評測的方式主要靠檢查最終的答案,因此模型是否是基于正確的理解推理選出正確的選項,也不得而知。

盡管學術界不斷地對諸如GSM8K、MMLU等數據集進行升級改造,如在GSM8K上引入多語言版本的MGSM數據集,在MMLU的基礎上引入更難的題目等,依然無法擺脫選擇或填空的窠臼。

并且,這些數據集都已面臨著嚴重的飽和問題,大語言模型在這些指標上的數值已經見頂,并逐漸喪失了區分度。

為此,賈佳亞團隊聯合MIT、清華、劍橋等多家知名高校,與國內頭部標注公司合作,標注了一個針對復雜問題推理過程的評測數據集MR-Ben。

MR-Ben基于GSM8K、MMLU、LogiQA、MHPP等大模型預訓練必測數據集的題目,進行了“閱卷式”的范式改造,生成的新數據集更難、更有區分度,更能真實地反映模型推理能力!

不用重新找題出卷,也不用把題目變形來測試模型的魯棒性,MR-Ben直接讓模型從“答題者”變成“閱卷者”,對數據集中已有的答題過程進行評判,通過讓大模型當老師來測試它對知識點的掌握情況!

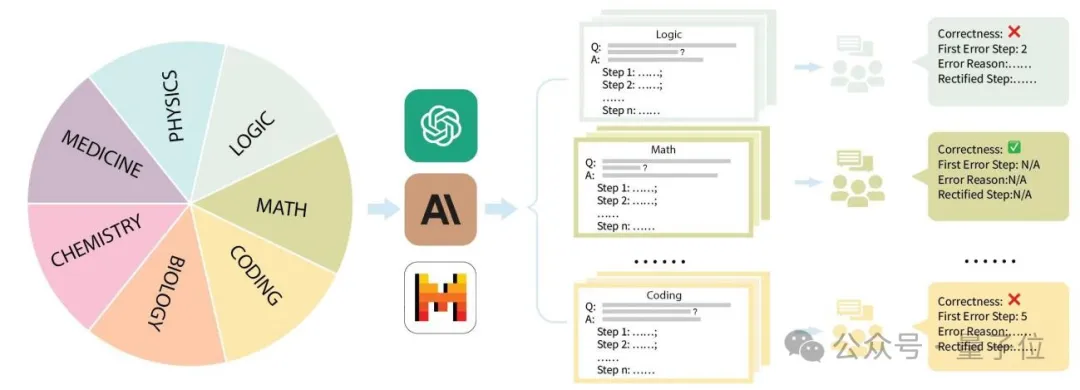

具體來說,賈佳亞團隊針對市面上主流的評測數據集GSM8K、MMLU、LogiQA、MHPP等數據集進行整理,并分成了數理化生、代碼、邏輯、醫藥等多個類別,同時區分了不同的難度等級。

針對每個類別、收集到的每個問題,團隊精心收集了對應的分步解題過程,并經由專業的碩博標注者進行培訓和標注。

標注過程中,解題過程是否正確、出錯的位置、出錯的原因都會被細致指出,比對大模型的閱卷結果和人類專家的閱卷結果,就能知道模型對知識點的掌握情況。

從評測方式來看,MR-Ben所提出的方法,需要模型對于解題過程的每一個步驟的前提、假設、邏輯都進行細致分析,并對推理過程進行預演來判斷當前步驟是否能導向正確答案。

這種“閱卷”式的評測方式從難度上遠超于僅答題的評測方式,但可有效避免模型背題所導致的分數虛高問題。而只會背題的學生很難成為一名合格的閱卷老師。

GPT4-Turbo表現最佳

賈佳亞團隊針對目前幾款知名的大模型進行了評測,部分模型有多個版本參與測試。

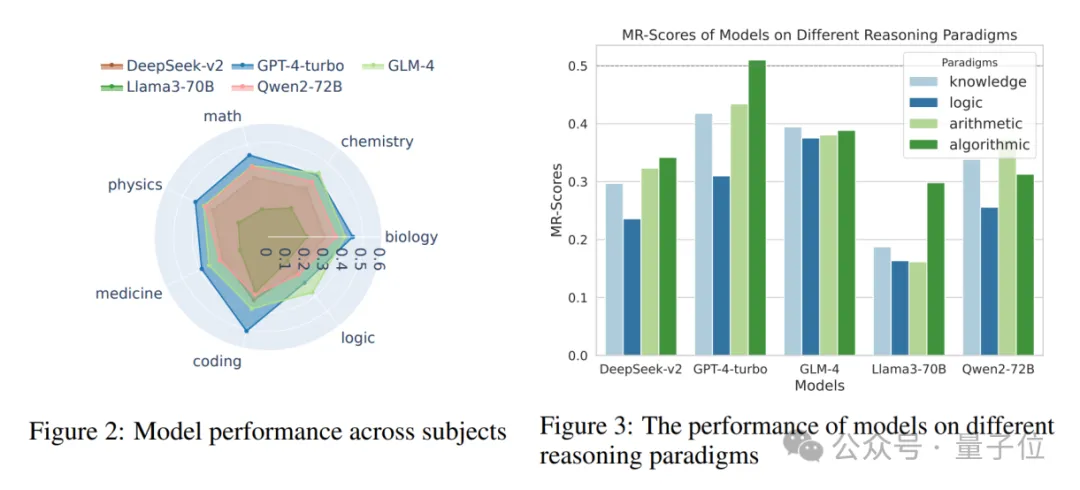

可以看到,閉源模型中,GPT4-Turbo的表現最佳(雖然在“閱卷”時未能發現計算錯誤),在絕大部分的科目里,有demo(k=1)和無demo(k=0)的設置下都領先于其他模型。

智譜團隊的GLM模型表現在榜單中位列第二,超過了Claude最新的3.5-Sonnet。

不過不同模型間的區分度較大,最強的GPT4-Turbo在MR-Ben數據集上獲得的成績也不到50分,可以看出其表現仍未飽和。

另外,一些表現較強的開源模型,效果已經趕上了部分商用模型。

除此之外,MR-Ben團隊在工作過程中還發現了一些有意思的現象,例如:

- 低資源場景下,小模型也有不少亮點,MR-Ben評測中Phi-3-mini在一眾小模型里脫穎而出,甚至高于或持平幾百億參數的大模型,展現出了微調數據的重要性。

- MR-Ben場景包含復雜的邏輯解析和逐步推斷,Few-shot模式下過長的上下文反而會使得模型困惑,造成水平下降的后果。

- MR-Ben評測了不少生成-反思-重生成的消融實驗,查看不同提示策略的差異,發現對低水平的模型沒有效果,對高水平的模型如GPT4-Turbo效果也不明顯。反而對中間水平的模型因為總把錯的改對,對的改錯,效果反而略有提升。

- 將MR-Ben評測的科目粗略劃分成知識型、邏輯型、計算型、算法型后,不同的模型在不同的推理類型上各有優劣。

賈佳亞團隊已在github上傳一鍵評測的方式,測試一次消耗的token量大約為12M,開發者可以在自家的模型上評測并提交,MR-Ben團隊會及時更新相應的leaderboard。

論文地址:https://arxiv.org/abs/2406.13975

項目主頁:https://randolph-zeng.github.io/Mr-Ben.github.io/

Github Repo:https://github.com/dvlab-research/Mr-Ben