性能提升44%!浙大提出LiCROcc:Radar Occ的春天來了?

本文經自動駕駛之心公眾號授權轉載,轉載請聯系出處。

寫在前面 & 筆者的個人理解

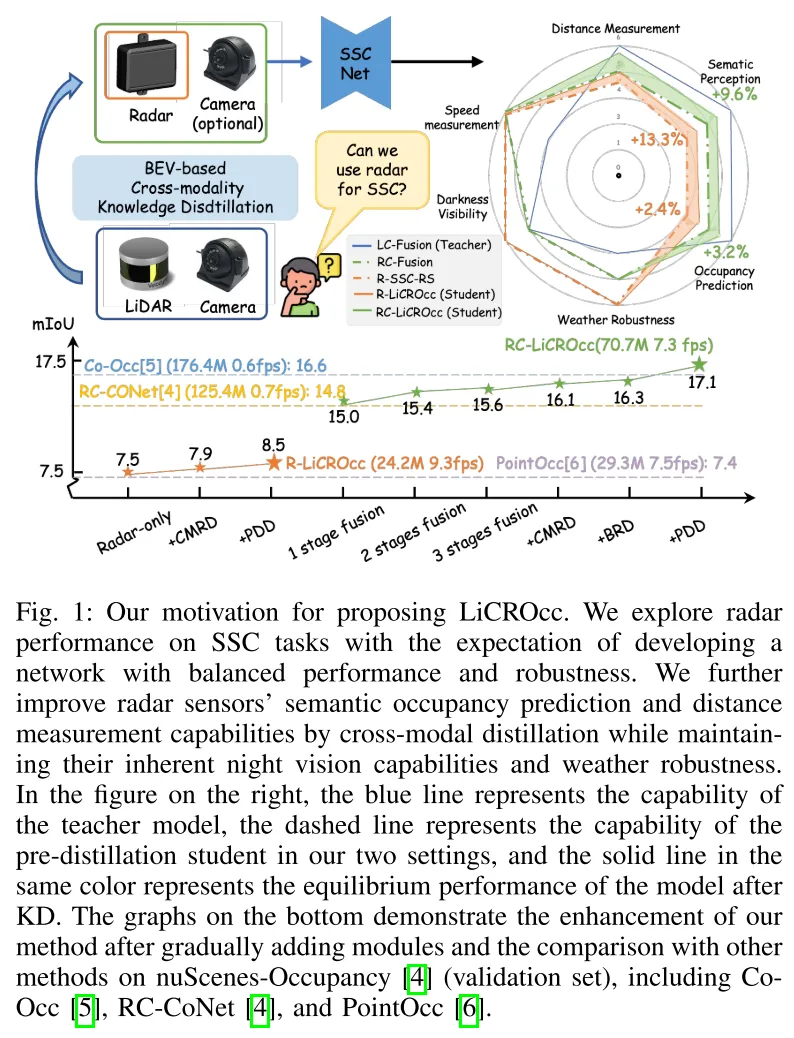

語義場景補全(SSC)是自動駕駛感知中至關重要的技術,經常面臨天氣和照明變化的復雜性。現有策略包括融合多模態信息以增強系統的魯棒性。雷達作為3D目標檢測中重要的傳感器,逐漸在自動駕駛應用中取代激光雷達,并且可以提供更魯棒的感知替代方案。本文們專注于3D雷達在語義場景補全中的潛力,開創了跨模態細化技術,以提高對天氣和照明變化的魯棒性,并增強SSC性能。

在模型架構方面,本文提出了一種三階段的緊密融合方法在BEV上實現點云和圖像的融合框架。基于此基礎設計了三個跨模態蒸餾模塊—CMRD、BRD和PDD。我們的方法通過將激光雷達和相機的豐富語義和結構信息蒸餾到 radar-only(R-LiCROcc)和雷達-相機(RC-LiCROcc)的配置中,增強了性能。最后本文提出的LC-Fusion(教師模型)、R-LiCROcc和RC-LiCROcc在nuScenes-Occupancy數據集上取得了最佳性能,其中mIOU分別超過基線22.9%、44.1%和15.5%。

源碼鏈接: https://hr-zju.github.io/LiCROcc/

相關工作回顧

語義場景補全(SSC)作為自動駕駛中的一項關鍵技術,因其能夠提供詳細的3D場景信息而受到了廣泛關注。相機和激光雷達是用于SSC任務最普遍的傳感器,每種都有其優勢和局限性。相機提供了豐富的語義上下文,但缺乏深度信息,并且容易受到光照和天氣條件的影響。而激光雷達提供了精確的3D幾何信息,但在處理高度稀疏輸入時表現不佳,并且由于密集激光雷達傳感器的高成本而限制了其廣泛應用。另一方面,雷達作為一種在自動駕駛中越來越受歡迎的、能夠抵抗惡劣天氣條件的傳感器,因其車規級設計和可負擔性而受到重視。盡管雷達在多樣化的天氣和光照條件下具有魯棒性,但其稀疏和嘈雜的測量結果對于大規模戶外場景的SSC來說是一個重大挑戰。

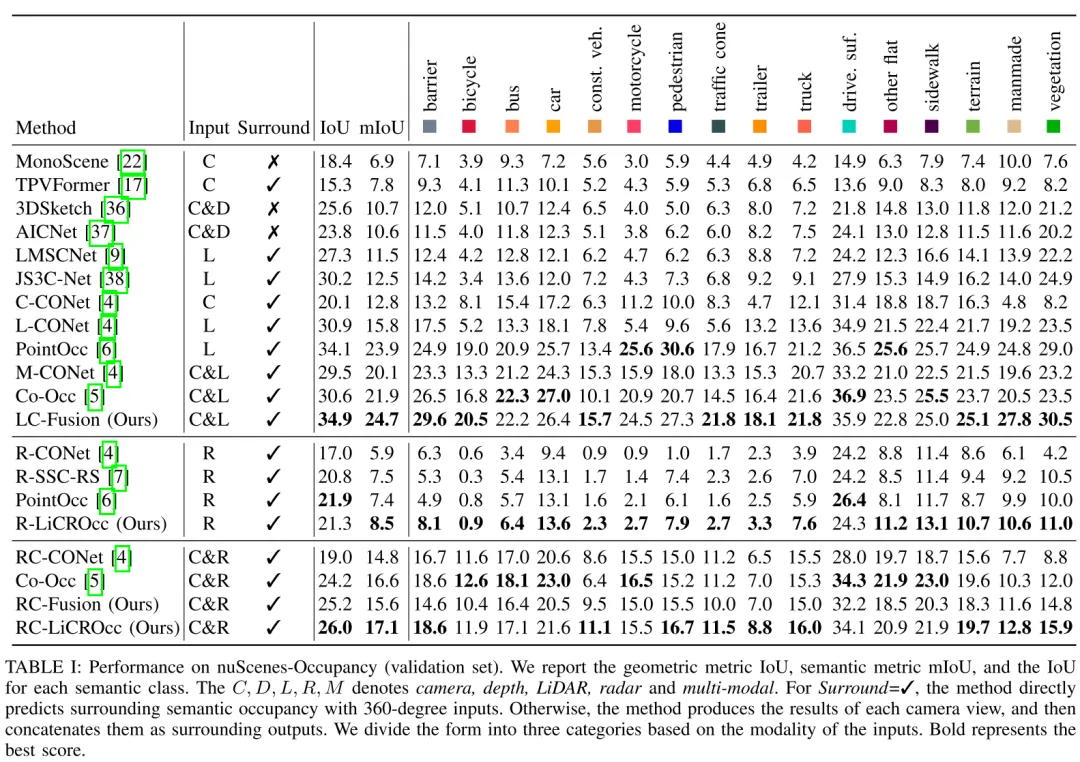

最近的大多數研究主要集中在基于雷達的檢測上。僅有少數研究探索了雷達傳感器在SSC任務中的應用。然而,它們只能使用雷達預測極少數類別的占用情況或作為多模態輸入的補充。此外,我們發現盡管雷達在對抗不利天氣條件和光照變化方面具有固有的優勢,如表I和圖1所示,但基于雷達的和基于激光雷達/相機的SSC方法之間仍然存在顯著的性能差距。為了解決上述挑戰,在這項工作中,我們探索將雷達作為SSC的核心傳感器,并設定了新的性能標準。

最開始我們建立了基于雷達的基線R-SSC-RS。然而由于缺乏復雜細節,僅依靠雷達傳感器無法實現高度精確和魯棒的SSC。為了進一步提高基于雷達的SSC性能,我們設計了一個相機-雷達融合網絡,以有效地將RGB圖像的豐富語義上下文融合到BEV空間中的雷達中。通過這種方式雷達SSC得到了顯著改進。

此外,我們發現到激光雷達-相機融合在室外SSC中實現了更優的性能,如圖1和表I所示,為雷達特征學習提供了寶貴的指導。因此,我們提出了一種基于融合的知識蒸餾方法,從激光雷達-相機融合網絡(教師)中提取有信息量的線索,并將它們轉移到基于雷達的基線RSSC-RS和雷達-相機融合網絡中,從而產生了我們的方法R-LiCROcc和RC-LiCROcc。

我們對激光雷達-相機和雷達-相機融合網絡采用了相同的架構。對于基于融合的知識蒸餾模塊,我們結合了跨模態殘差蒸餾(CMRD)、BEV關系蒸餾(BRD)和預測分布蒸餾(PDD),以分層方式強制學生模型學習教師模型的特征表示和分布。通過這個提出的基于融合的知識蒸餾模塊,我們的LiCROcc僅使用雷達(RLiCROcc)實現了與基于相機的方法相當的成果。此外,LiCROcc通過結合雷達和相機輸入(RC-LiCROcc)接近基于激光雷達的方法的性能,同時在不利的天氣條件和夜間視覺能力方面保持了魯棒性。

總結來說,本文的主要貢獻如下:

- 我們旨在提高雷達在語義場景補全中的性能,同時保持現實世界中的實用性,利用雷達對各種天氣條件的彈性。我們還從基于激光雷達的方法中建立了基于雷達的基準,促進了基于雷達的SSC研究,并考慮了一個相機-雷達融合網絡以提高性能。

- 我們提出了一個新的框架LiCROcc,它結合了CMRD、BRD和PDD模塊,分層強制學生模型學習教師模型的特征表示和分布。

- 在大規模的nuScenesOccupancy上進行的廣泛實驗證明了我們提出方法的有效性。

LiCROcc詳解

概述

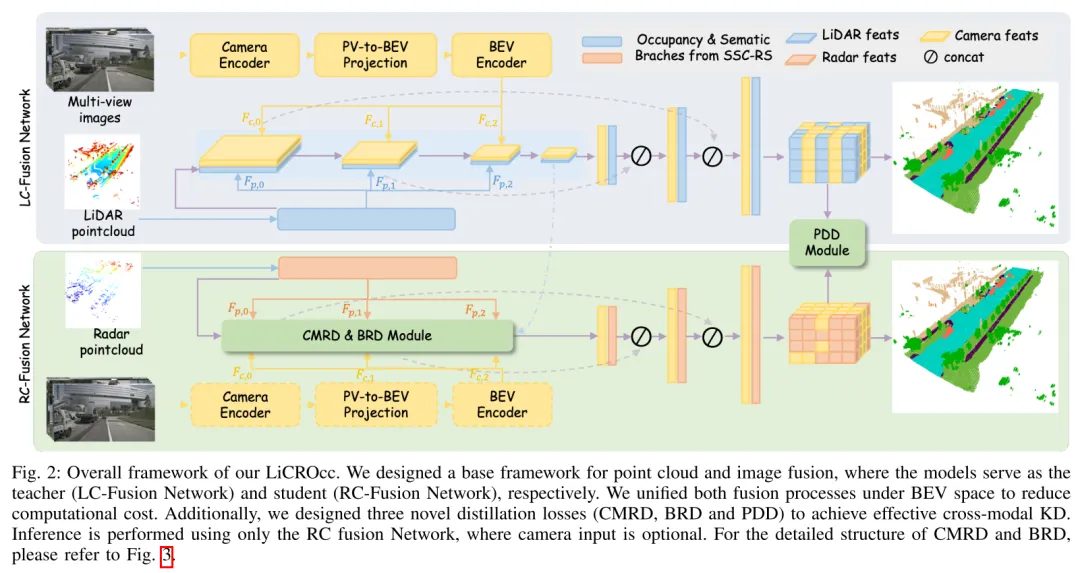

如上所述,我們構建了基于雷達的基線,并設計了雷達-相機融合網絡(圖2的底部)以提升基線性能。為了利用激光雷達-相機融合中詳細的幾何結構和點表示的指導,我們進一步使用基于融合的知識蒸餾將知識從激光雷達-相機融合網絡(圖2的頂部)傳遞到基于雷達的基線和雷達-相機融合網絡。我們采用相同的架構,即多模態融合網絡,來建立上述兩個融合網絡。

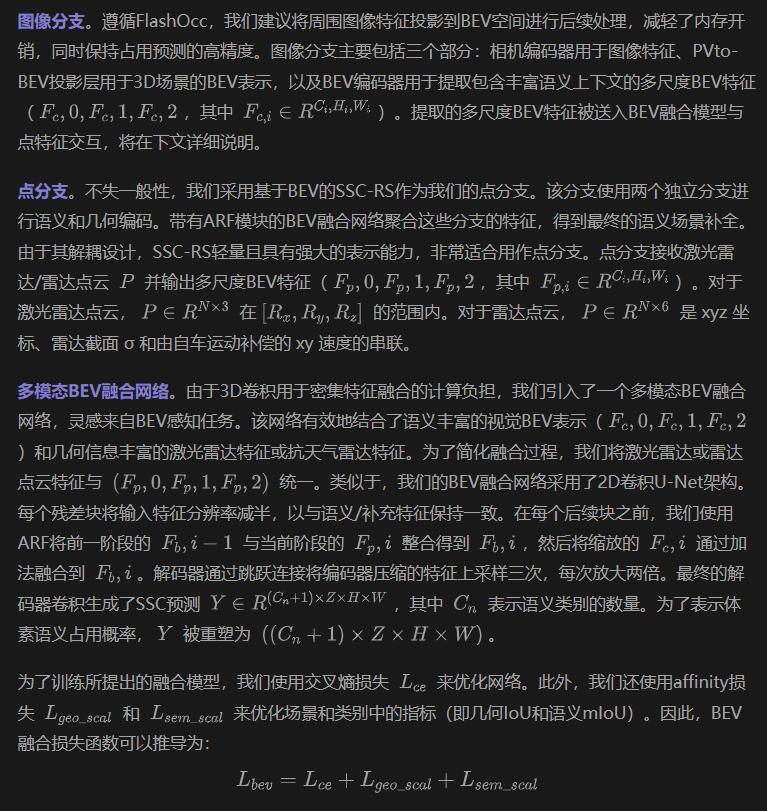

多模態融合網絡

多模態融合網絡主要由圖像分支提取圖像特征、點分支編碼激光雷達/雷達點,以及多模態BEV融合網絡高效整合點和圖像特征。

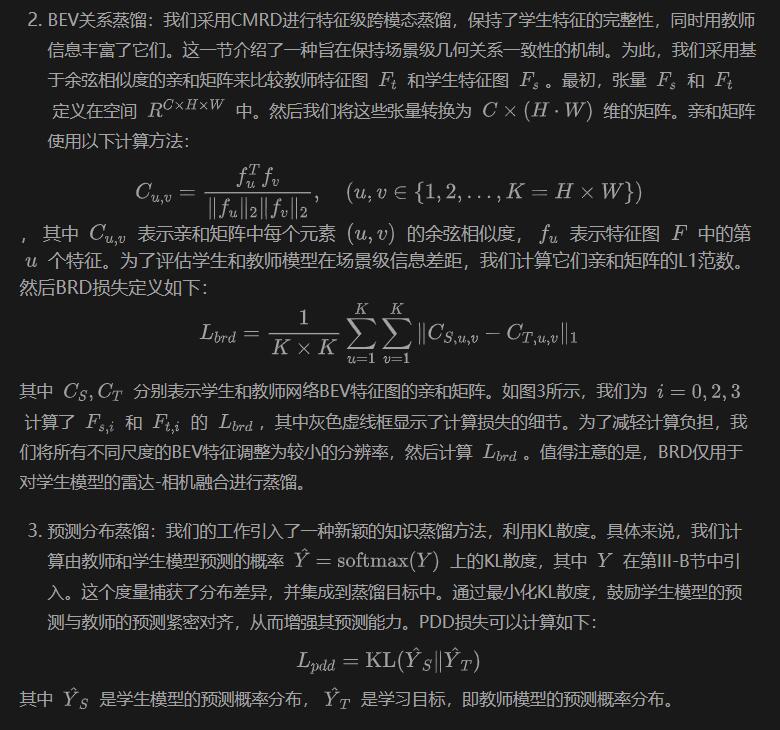

基于融合的知識蒸餾模塊

整體損失函數

實驗分析

在本節中,我們將詳細介紹評估數據集和指標、實施詳情,以及與最先進方法的性能比較。此外,我們還進行了消融研究,以證明申報融合模塊的有效性和蒸餾模塊。最后,我們提供了實驗來消除觀察距離的影響和雷達在語義場景完成任務方面的獨特優勢。

實驗細節

對于激光雷達輸入,我們將10個激光雷達掃描合并為一個關鍵幀。ResNet50作為圖像主干來處理輸入分辨率為256×704的相機圖像。在訓練期間,我們將點云投影到相機視圖上,以提供LSS的深度監督。對于雷達輸入,我們采用CRN中的預處理過程,使用汽車上的5個雷達傳感器拼接雷達掃描。對于數據增強,我們對圖像隨機應用水平和垂直翻轉以及裁剪。點云通過在x軸和y軸上隨機翻轉進行增強。我們使用AdamW優化器,權重衰減為0.01,初始學習率為2e-4。我們使用余弦學習率調度器,在前500次迭代中進行線性預熱。所有實驗都在8個NVIDIA A100 GPU上進行,總批量大小為32,訓練24個周期。

定量結果

表I展示了與SOTA的比較結果。與所有先前方法相比,我們的LiCROcc在相同配置下取得了最佳性能。例如,我們的激光雷達-相機融合模型LCFusion顯示出顯著的改進,與基線(M-CONet)相比,mIoU增加了23%,IoU增加了18%。同時,LC-Fusion在mIoU和IoU得分上分別比PointOCC提高了3.3%和2.3%,這強調了我們提出的多模態BEV融合的有效性。

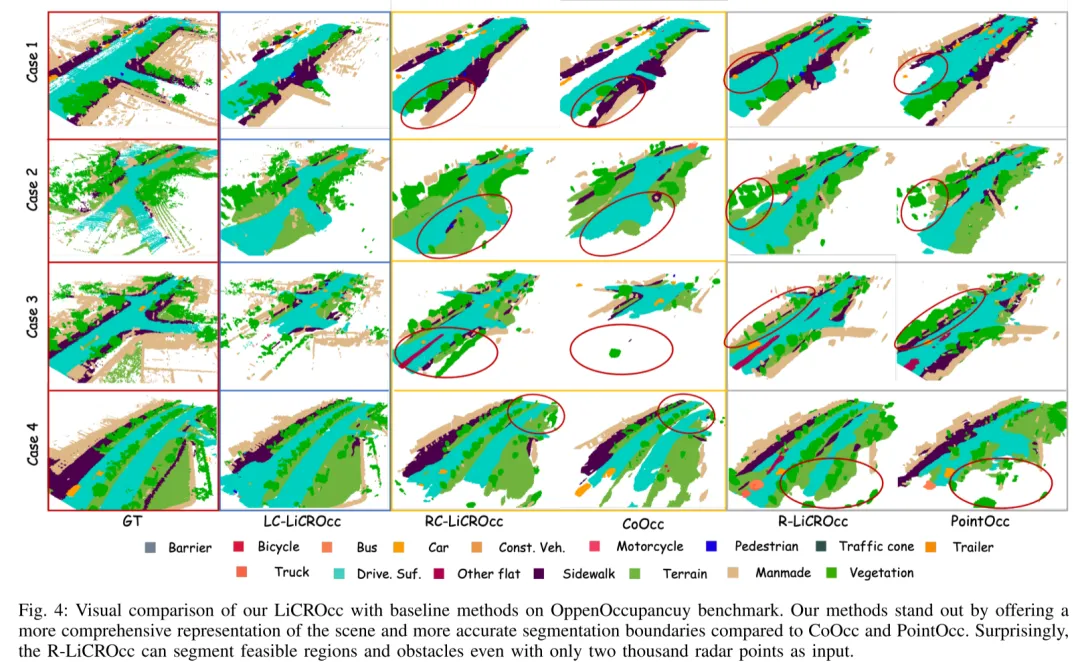

為了全面評估我們提出的方法的有效性,我們修改了幾種現有的基于激光雷達和多模態方法(CONet [4],SSC-RS,PointOcc和CoOCC),以適應雷達輸入,作為我們的比較。如表I的第二部分所示,我們的R-LiCROcc在mIoU得分上超過了次好的方法(PointOcc)和基線(R-SSC-RS)13.3%,證明了我們提出的基于融合的知識蒸餾的有效性。我們發現R-LiCROcc的IoU得分略低于PointOcc。我們解釋說,這可以歸因于PointOcc在三個平面上投影特征并使用更大的模型,這對于占用預測可能更有利。對于雷達-相機融合,我們以CONet和CoOCC作為基線。結果顯示在表I的第三部分,表明我們提出的雷達-相機融合版本RC-Fusion已經達到了與這些基線相當的性能。提出的基于融合的知識蒸餾進一步提高了性能,mIoU和IoU分別提高了1.5和0.8。我們還提供了可視化結果,在圖4中展示了我們的RC-LiCROcc和R-LiCROcc如何實現更完整的場景補全和更精確的目標分割。

消融實驗

我們進行了一系列實驗來驗證所提出的模塊以及雷達作為語義場景補全任務傳感器的潛力。所有實驗都在相同的訓練配置下進行,并根據nuScene-Occupancy [4]驗證數據集進行評估。

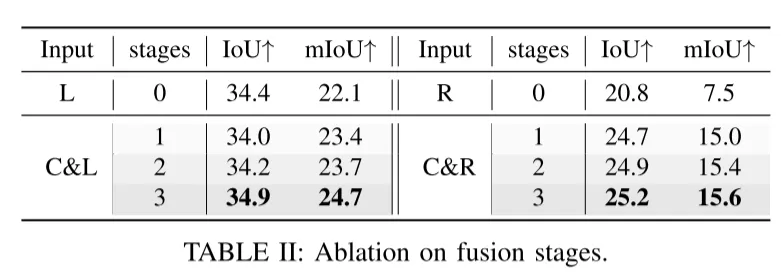

- 融合模塊的效果: 我們研究了在第III-B節中提出的多模態BEV融合網絡中不同融合階段的影響。相應的結果顯示在表II中。"Stages=0"意味著僅使用點云作為輸入,這作為基于點的基線。從表II中,我們可以看到多階段融合策略在不同尺度上融合BEV特征,并有效提高了語義場景補全的準確性。

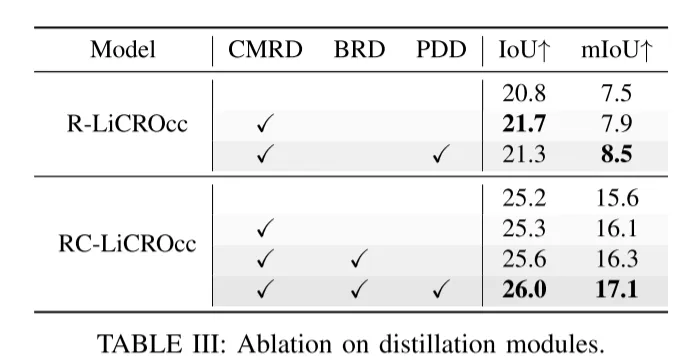

- 蒸餾模塊的效果: 在本節中,我們深入研究了我們提出的基于融合的知識蒸餾中不同蒸餾組件的各自貢獻。詳細的結果在表III中說明。我們通過將它們納入兩個不同的配置:R-LiCROcc(表III的第一部分)和RC-LiCROcc(表III的第二部分),系統地評估了這些模塊的影響。

表III的兩部分結果都表明CMRD、BRD和PDD組件顯著增強了性能。其中,PDD在跨模態知識蒸餾中具有最關鍵的作用,為R-LiCROcc貢獻了7.6%的mIoU改進,為RC-LiCROcc貢獻了4.9%的mIoU改進。

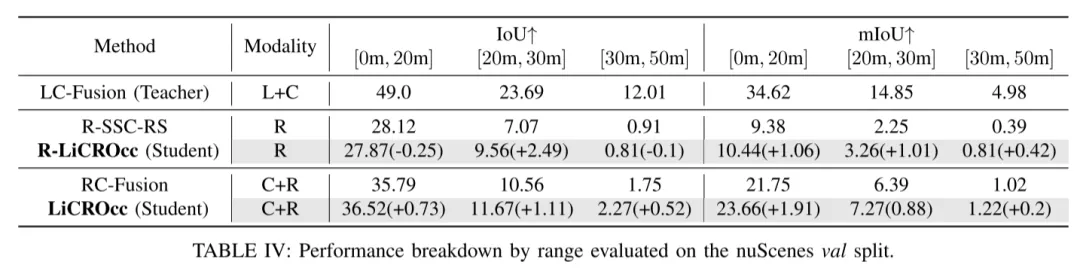

- KD的視覺場優勢: 雷達的固有能力是能夠穿透物體并繞過前景障礙物,這使其比激光雷達和相機傳感器提供了更廣的視野。然而,雷達點云的稀疏性隨著距離的增加而增加,這對于SSC特別不利,如表IV的第2行和第3行所示。

為了進一步分析LiCROcc帶來的改進,我們進行了統計分析,以評估系統在不同距離范圍內對語義場景補全的有效性,詳細見表IV。我們分別在[0m, 20m]、[20m, 30m]和[30m, 50m]的語義場景補全中測量了教師模型、學生模型和R-LiCROcc的IoUs和mIoUs。表IV揭示了知識蒸餾(KD)顯著增強了學生模型的性能,特別是在短距離區域。有趣的是,我們發現當從激光雷達-相機融合到基于雷達的模型執行KD時,遠程區域的mIoU得分改進遠小于近程和中程區域。這一觀察表明,由于其相對較短的視覺范圍,激光雷達-相機融合的優勢隨著距離的增加而喪失。值得注意的是,教師和學生模型在遠程區域的性能都嚴重下降,特別是在mIoU得分上。例如,教師模型在20米內比RC-LiCROcc高出10.96 mIoU。然而,當范圍在[30m, 50m]時,這一優勢急劇下降到3.76點(幾乎減少了65%)。

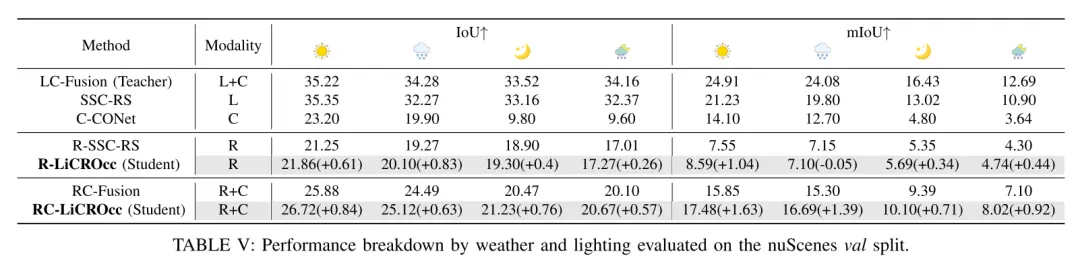

- 雷達的天氣魯棒性: 本研究評估了雷達在各種天氣條件下的性能。詳細結果在表V中揭示了模型的性能隨天氣場景(晴朗的白天、雨天、夜晚和雨夜)的變化而波動。

首先,如表V所示,三種傳感器類型的天氣屬性顯示出不同程度的魯棒性。雷達的mIoU從晴朗的一天到雨夜僅下降了3.25,而激光雷達和相機的mIoU分別下降了10.33和10.46點。這表明雷達對不利天氣和照明條件最為彈性。特別是,在晴朗的白天,教師模型在mIoU得分上比R-LiCROcc高出16.32,比RC-LiCROcc高出7.43。然而,在雨夜條件下,這種優勢縮小到7.95和5.26,主導性能分別下降了51.3%和29.2%。此外,很明顯nuScenes數據集中的雨并不特別大,導致對激光雷達點云的影響沒有預期的那么顯著。在更廣泛的天氣條件下檢查雷達性能是我們未來工作的重點。

在晴朗的白天條件下,蒸餾效果帶來了最佳性能。R-LiCROcc模型與學生模型相比,在IoU上提高了2.8%,在mIoU上提高了13.8%。同樣,RC-LiCROcc模型在IoU上增加了3.2%,在mIoU上增加了10.3%。這種增強歸因于教師模型在晴朗條件下的最佳性能。相反,在雨天和夜晚,激光雷達和相機的能見度受到損害,導致學生模型的增強效果不那么明顯。事實上,R-LiCROcc模型在雨天的性能略有下降。

結論

在本文中,我們探討了雷達在語義場景補全(SSC)任務中的應用。我們首先開發了一個融合網絡,該網絡整合了點云和圖像,并輔以三個蒸餾模塊。通過利用雷達的優勢并在SSC任務上增強其性能,我們的方法在不同設置下取得了優異的成果。