美政府欲阻天網降臨,GPT-5先做「末日測試」!

雖然OpenAI經常被曝出財務狀況不佳,5月就發布的Her也一直鴿到現在,但這些都不影響他們的「頂流」地位。

不僅最近要開啟新一輪融資,而且活躍用戶數相比去年11月已經增長了一倍,每周有超過2億人使用ChatGPT。

雖然2022年底ChatGPT推出后,谷歌、微軟和Meta都推出了各自的AI聊天應用,紛紛要在這個競爭激烈的市場中分一杯羹,但OpenAI的用戶數量依舊不斷增長。

根據The Information今天的報道,Meta的AI助手擁有4000萬日活躍用戶、至少4億月活躍用戶,相比OpenAI還是有不小的差距。

除了個人用戶,OpenAI還表示,92%的財富500強公司正在使用他們的產品。自7月份GPT-4o mini模型發布以來,API的使用量也翻了一番。

5月份的時候,GPT-4o剛發布,四大會計事務所之一普華永道就和OpenAI達成了合作協議,成為了ChatGPT的「經銷商」,負責將相關軟件轉售給其他企業,10萬名普華永道員工也將在工作中使用ChatGPT。

此外,Salesforce、Snap、Quizlet、Shopify等科技公司也和OpenAI展開了合作,以OpenAI提供的API為基礎,或者與ChatGPT進行整合,構建自己的AI功能,涉及的應用程序包括Slack、SnapChat、Shopify等。

管理咨詢巨頭Bain也表示,他們與OpenAI合作,將包括ChatGPT在內的技術集成到自己開發的管理系統、研究和流程中。這個AI系統已經被可口可樂用上了。

奧特曼在給科技媒體Axios的聲明中寫道,「使用OpenAI的工具已經成為人們日常生活的一部分,這些產品正在醫療保健和教育等領域產生真正的影響,無論是協助完成日常任務、解決難題或是釋放創造力。」

奧特曼特意cue到醫療健康領域,讓人不禁聯想到他本人和OpenAI的創業基金正在大力支持的初創Thrive AI Health,旨在提供個性化的AI健康教練。

然而,就在Axios的作者Shaun Ralston發推特宣布OpenAI的這一成就時,下面的置頂評論竟然是——「AI統治世界的邪惡計劃即將來臨」。

雖然「頂流」地位難以撼動,但這一年來,關于OpenAI的安全丑聞和非議就沒消停過。

最近曝出的一則新聞,還扯進了Anthropic這個向來「勢不兩立」的老對手。

OpenAI和Anthropic的「末日測試」

OpenAI和Anthropic分別簽署了一項史無前例的協議——在發布模型之前,會先拿給美國政府進行安全測試。

奧特曼也在今天發推確認了這項合作。

我們很高興與美國人工智能安全研究所達成協議,對我們未來的模型進行預發布測試。

出于多種原因,我們認為這在國家層面很重要。美國需要繼續領先!

美國商務部下轄的國家標準與技術研究所(NIST)在新聞稿中表示,Anthropic和OpenAI均簽署了一份諒解備忘錄,達成與美國人工智能安全研究所的「AI安全研究、測試和評估的正式合作」。

NIST表示,這是建立在AI公司對拜登政府做出的自愿安全承諾的基礎之上。

根據這項協議,AI安全研究所將在新模型公開發布之前及之后獲得訪問權限,并和相關公司展開合作研究。

這將確保AI領域的公共安全不只依賴于科技公司對安全風險的評估能力,以及緩解這些風險的方法。

美國AI安全研究所還將與英國的AI安全研究所合作,共同審查模型以標記潛在安全風險,向OpenAI和Anthropic提供關于其模型的潛在安全改進的反饋。

研究所主任Elizabeth Kelly稱這些協議為「幫助負責任地引導AI未來發展的重要里程碑,在她看來,安全是推動突破性技術創新的關鍵。

這一協議的出臺正值加州準備通過SB 1047法案,反映了美國各級政府和立法者對AI安全的日益關注。

Anthropic聯創:AI 安全對創新「至關重要」

SB 1047旨在規范AI在加州的開發和部署,已于周三在民主黨控制的州參議院上以壓倒性多數通過投票。

由于進行過修改,參議院還將在本周再次投票,決定是否通過修正案,但這被認為只是「走個過場」。實際上,SB 1047只待州長批準,即可在2026年1月1日正式生效施行。

然而,加州州長Gavin Newsom尚未表明自己對法案的立場,在技術高管、風險投資家、學者和議員們展開的激烈游說中,他必須在9月30日前做出決定。

該法案最具爭議的方面之一,是要求AI公司內置一個「緊急停止開關」,以防止模型引入對公共安全的新威脅,尤其是模型「在人類有限監督或干預」運行時。

據路透社報道,Anthropic是謹慎支持該法案的AI公司之一,聲稱在最后一輪修訂后,法規的潛在好處可能超過成本。

Anthropic CEO聯創兼CEO Dario Amodei在上周致州長的信中闡明了自己支持的理由。

他表示,盡管還不確定法案中「看起來令人擔憂或模棱兩可」的方面,但由于最近對法案的修改,Anthropic最初對該法案阻礙創新的擔憂已大大減少。

Anthropic的聯合創始人Jack Clark也對路透社表示,「安全、可信賴的AI對技術的正面影響至關重要。」

與Anthropic正好相反,OpenAI加入了反對者的陣營,并已經展開了游說。

在致法案共同發起人、加州參議員Scott Wiener的信中,OpenAI的首席戰略官Jason Kwon表示,在對前沿AI模型的監管中,應該由美國政府率先帶頭,以考慮對國家安全和競爭力的影響。

可以看出,雖然Anthropic和OpenAI對SB 1047有截然不同的態度,但對于加強AI安全監管似乎有相似的立場,這也能解釋為何這兩家公司會率先與美國AI安全研究所達成協議。

正如Jason Kwon對路透社所說的,「在負責任的AI開發方面,該研究所發揮著關鍵作用,希望我們的合作能為世界其他地區提供一個可借鑒的框架。」

加州AI法案,讓科技圈「虎軀一震」

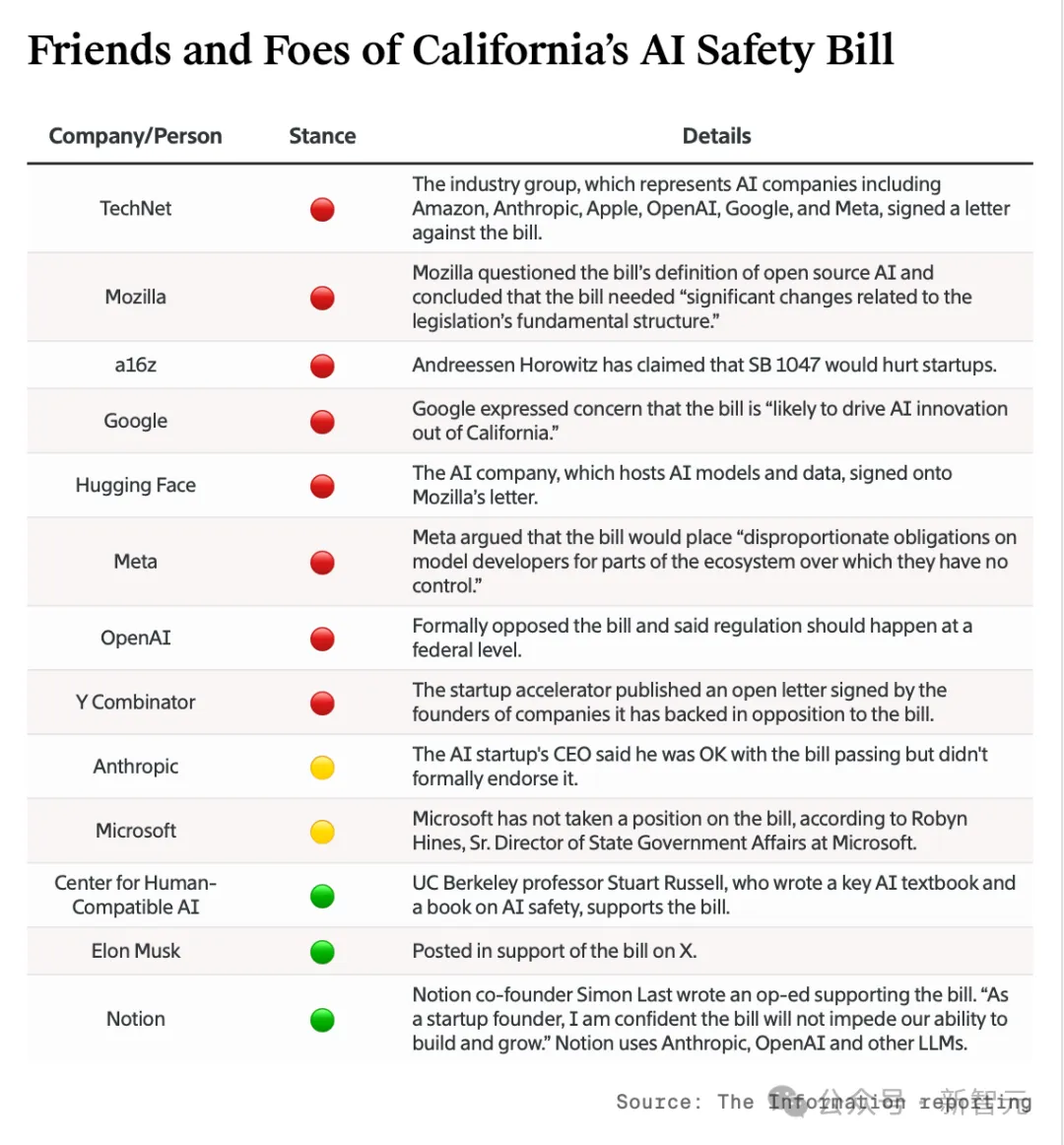

被卷入SB 1047的利益相關方紛繁復雜,絕不止Anthropic和OpenAI這兩家公司,他們各自擔心和反對的理由也不盡相同。

除了Anthropic,該法案的其他支持者包括馬斯克、「圖靈三巨頭」之二Yoshua Bengio和Geoffrey Hinton、Gary Marus、UCB教授Stuart Russell以及其他一些警告AI失控風險的團體。

反對者的陣營同樣強大,不僅有OpenAI、谷歌、Meta、HuggingFace等科技公司和各種風投資本,還有AI社區的知名學者/KOL吳恩達和李飛飛。

SB 1047之所以舉足輕重,讓全美的科技圈都坐立不安,不僅是因為加州在AI行業的地位,更是由于美國的立法傳統——加州通過的法案有時會影響其他州的立法者。

不同于OpenAI的反對理由,很多批評者認為,該法案過于「杞人憂天」——用所謂的「緊急開關」預防世界末日出現,卻對Deepfake和虛假信息等眾多現有的安全風險視而不見。

因此,該法案不僅會阻礙AI的創新,而且對當今AI的安全性也沒有幫助。

更有爭議的一點是,SB 1047要求開發者監控客戶對AI技術的使用情況,并在造成傷害時承擔巨額罰款——例如,如果有人入侵自動駕駛系統并導致事故,開發該系統的公司將被追責。

此外,法案中存在定義模糊的問題——AI模型「造成關鍵傷害,或實質上提供關鍵傷害的能力」時,需要為此負責。

其中,「關鍵傷害」被描述為大量傷亡、超過5億美元的損失或其他「同等嚴重」的傷害;但開發者究竟在什么條件下會被追責、要承擔什么樣的責任,這些方面都是語焉不詳。

致力于支持小型科技初創的私人風投a16z的普通合伙人Martin Casado敦促州長否決法案,希望他能聽取眾多專家的意見,因為法案的發起人Scott Wiener「基本上忽視了他們」。

吳恩達最近頻頻撰文呼吁,「還有時間阻止加州的SB 1047成為法律」。他認為該法案的監管重點出現了偏差,「我們應該監管有害的AI應用,而不是通用AI模型。」

開源界十分擔憂

科技巨頭、風投資本為自己的利益據理力爭時,也有批評者站出來說,SB 1047對開源且不以盈利為目的的開發者同樣不公平。

一個開源軟件組織的聯合創始人Chris Lengerich表示,這種不確定性意味著重大的財務影響,因為法案要求開發者雇用專門的審計員來檢查他們的工作。

「公司將花費大量資金和時間去理解這些術語的含義,但實際上沒有人真正清楚。」

法案的規定適用于花費超過1億美元訓練的AI模型,或花費超過1000萬美元微調現有模型的開發者——很多小型的科技公司就會落入后者的范疇。

如果技術導致「對他人造成死亡或人身傷害」、「對財產造成損害」等,AI開發者將面臨的罰款將是開發費用10%~30%。

一家開源AI公司的政策研究員總結道,「這意味著對財產造成任何損害都可能導致數千萬美元的罰款,而不僅限于災難性事件」。比如,黑客可能利用AI激活消防灑水器并造成水資源浪費。

除此之外,法案還要求開發者評估其模型的衍生產品并防止它們可能造成的任何傷害,包括客戶微調模型、以其他方式修改模型(如越獄)或將其與其他軟件組合的情況。

但問題在于,一旦開源軟件發布,開發者通常無從得知其他開發者或客戶的具體操作,因為人們可以直接將模型下載到個人設備上。