突破視頻多模態(tài)大模型瓶頸!「合成數(shù)據(jù)」立大功,項目已開源

本文作者來自字節(jié)跳動,南洋理工大學(xué) S-Lab 和北京郵電大學(xué)。其中第一作者為南洋理工大學(xué) S-Lab 的博士生 Yuanhan Zhang (https://zhangyuanhan-ai.github.io/),主要研究領(lǐng)域為將基礎(chǔ)模型適配于開放世界。本文的指導(dǎo)老師為 Ziwei Liu 教授 ((https://liuziwei7.github.io/) 和 Chunyuan Li 博士 (https://chunyuan.li/), 其中 Chunyuan Li 領(lǐng)導(dǎo)了這個項目。本文其他作者包括北京郵電大學(xué) Jinming Wu,南洋理工大學(xué) S-Lab 的博士生 Bo Li, 字節(jié)跳動研究員 Wei Li, Zejun Ma.

視頻多模態(tài)大模型(LMMs)的發(fā)展受限于從網(wǎng)絡(luò)獲取大量高質(zhì)量視頻數(shù)據(jù)。為解決這一問題,我們提出了一種替代方法,創(chuàng)建一個專為視頻指令跟隨任務(wù)設(shè)計的高質(zhì)量合成數(shù)據(jù)集,名為 LLaVA-Video-178K。

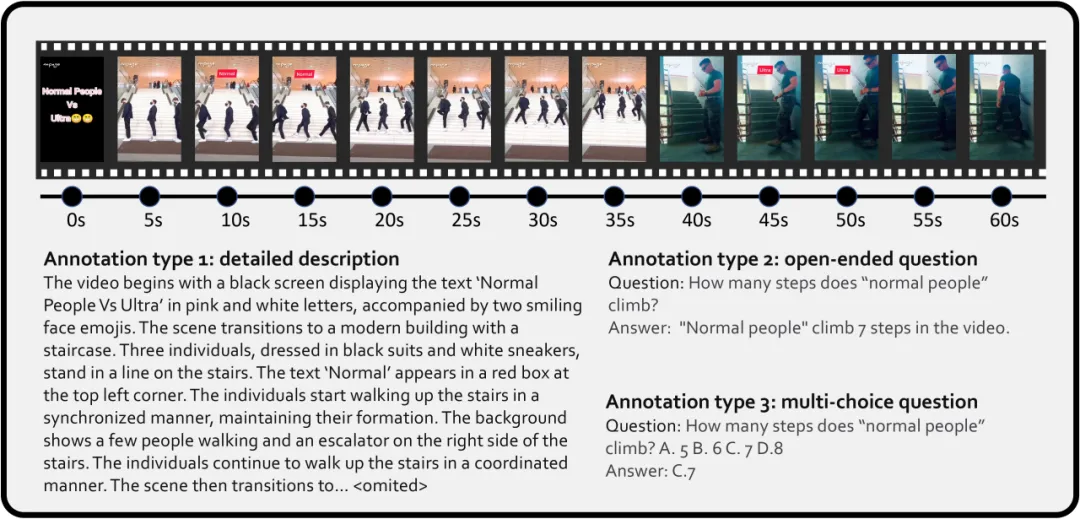

該數(shù)據(jù)集包含詳細的視頻的描述、開放式問答(QA)、和多項選擇題。通過在該數(shù)據(jù)集和現(xiàn)有的視覺指令微調(diào)數(shù)據(jù)上訓(xùn)練模型,我們推出了新的視頻 LMM——LLaVA-Video。實驗表明,LLaVA-Video 在多個視頻基準上表現(xiàn)出色,展示了該數(shù)據(jù)集的有效性。

- 論文標題:VIDEO INSTRUCTION TUNING WITH SYNTHETIC DATA

- 論文鏈接:https://arxiv.org/pdf/2410.02713

- 項目主頁:https://llava-vl.github.io/blog/2024-09-30-llava-video/

先來看一組交互性演示,了解 LLaVA-Video 在真實世界中與人交互:

1.LLaVA-Video 教我下載 "TikTok":

2.LLaVA-Video 描述我的客廳,并指導(dǎo)我找健康飲料:

視頻指令跟隨數(shù)據(jù)合成

一個高質(zhì)量的視頻指令跟隨數(shù)據(jù)集對于開發(fā)有效的視頻語言模型至關(guān)重要。我們確定了構(gòu)建此類數(shù)據(jù)集的關(guān)鍵因素:確保視頻內(nèi)容和語言注釋的豐富性和多樣性。我們對現(xiàn)有的視頻基準進行了全面調(diào)查,涵蓋了各種公共視頻描述和問答數(shù)據(jù)集,然后確定了十個獨特的視頻來源,這些來源為超過 40 個視頻語言基準提供了數(shù)據(jù)。從每個來源中,我們選擇具有顯著時間動態(tài)的視頻。為了保持注釋的多樣性,我們建立了一條能夠生成任何長度視頻的詳細描述的流水線。此外,我們定義了 16 種問題類型,指導(dǎo) GPT-4o 生成問答對,以訓(xùn)練視頻語言模型的感知和推理能力。

視頻來源

我們注意到,盡管不同的視頻語言數(shù)據(jù)集側(cè)重于各種視頻理解任務(wù),但大多數(shù)都來源于十個主要視頻來源,這些來源提供了廣泛的來自不同網(wǎng)站、拍攝視角和題材的視頻。下圖展示了這十個我們選擇的視頻數(shù)據(jù)集與其他現(xiàn)有視頻語言數(shù)據(jù)集之間的關(guān)系。進一步,我們從這些來源中選擇了動態(tài)視頻,詳細的選擇邏輯在論文中描述。

我們使用的 10 個視頻來源與其他現(xiàn)有視頻語言數(shù)據(jù)集的關(guān)系。

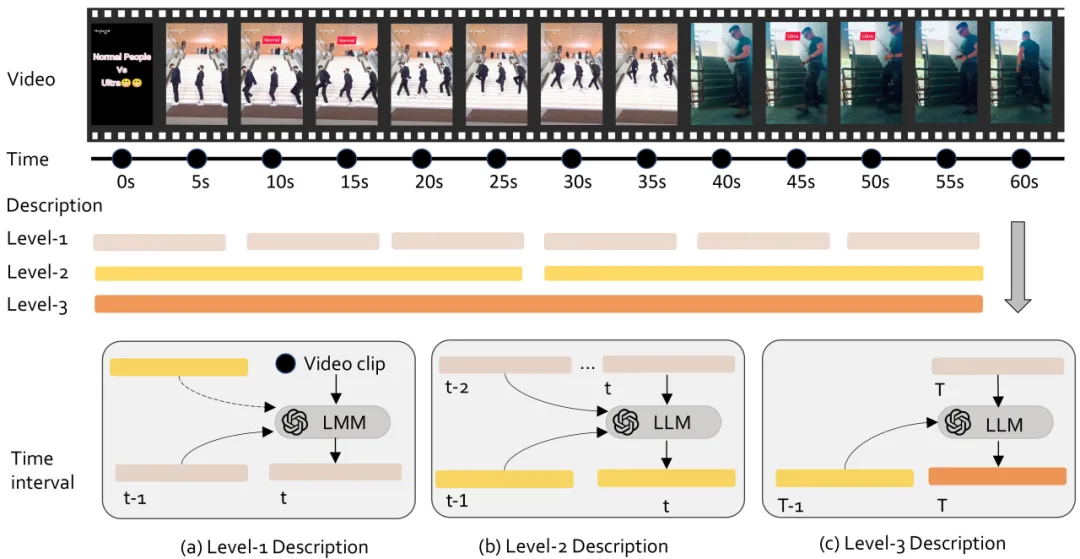

自動生成視頻詳細描述

對于選定的視頻,我們使用 GPT-4o 系統(tǒng)地描述其內(nèi)容。我們從每秒一幀的頻率開始采樣視頻。然而,由于 GPT-4o 的輸入大小限制,我們無法一次性使用視頻中所有采樣的幀。因此,我們按順序描述視頻,如下圖所示。我們在三個不同級別上創(chuàng)建描述,詳細如下,簡單來說,第一個層級(leve-1)指的是針對 10s 區(qū)間的視頻描述,第二個層級(level-2)指的是針對 30s 區(qū)間的視頻描述,第三個層級(level-3)指的是針對整個視頻的描述。

視頻描述的生成流程:通過遞歸方法對三個不同的視頻描述層級(leve-1,level-2,level-3)進行描述。`t` 是時間區(qū)間在其自身層級的索引,`T` 是最后一個時間區(qū)間的索引。(a) 我們根據(jù) level-1 的 `t` 內(nèi)收集的幀、level-1 的 `t-1` 的描述,以及最近的一次 level-2 描述(如果有的話),來生成 level-1 時間區(qū)間 `t` 的視頻描述。(b) 我們使用 level-2 的 `t-1` 的描述,以及最近的三個 level-1 描述,生成 level-2 的時間區(qū)間 `t` 的描述, (c) 我們基于最近一次 level-2 的描述和最近的一次 level-1 的描述,生成 level-3 的 `T` 的描述。

自動生成視頻問答

除了詳細的視頻描述,我們的數(shù)據(jù)集中還包含設(shè)計用于復(fù)雜交互的各種問答對。這種設(shè)置提高了視頻理解模型處理現(xiàn)實問題的能力。我們參考公共視頻問答基準,將這些問題組織為 16 種特定類別,如圖 3 所示。給定詳細的視頻描述,我們使用 GPT-4o 為每種問題類型最多生成一個問答對。有關(guān)問題類型和生成過程的更多細節(jié),請參閱論文。

數(shù)據(jù)創(chuàng)建中用于生成視頻問答對的問題類型。對于每種類型,我們提供其名稱和示例問題。

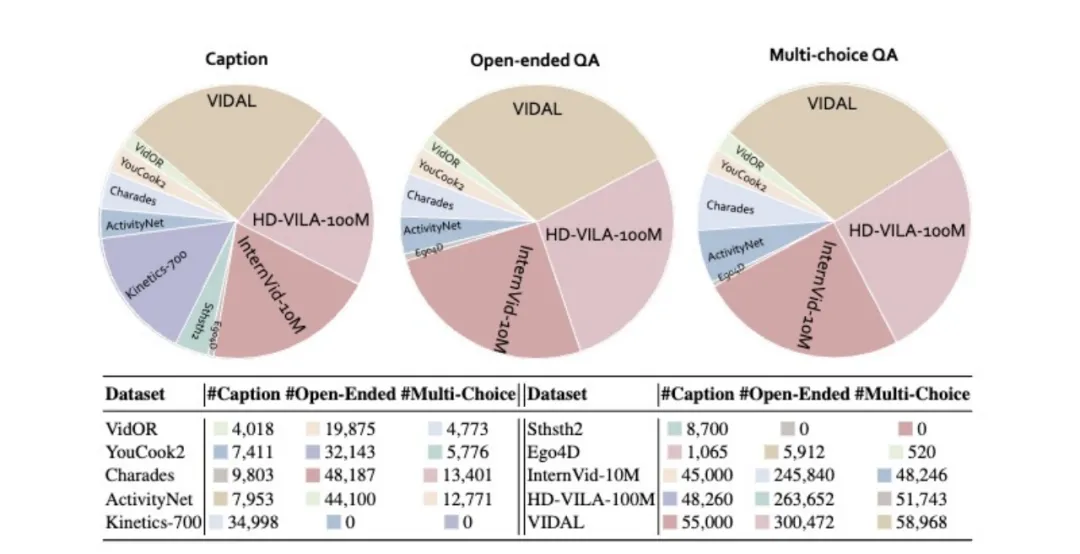

數(shù)據(jù)集統(tǒng)計

我們從收集到的數(shù)據(jù)源中精心挑選,以形成一個平衡且全面的集合,最終得到總共 178K 個視頻和 1.3M 個指令跟隨樣本。這包括 178K 個視頻描述、960K 個開放式問答和 196K 個多項選擇問答。

不同數(shù)據(jù)集和問題類型(描述、開放式 Q&A、多項選擇 Q&A)中的數(shù)據(jù)分布。

一個用于說明 LLaVA-Video-178K 中視頻指令跟隨數(shù)據(jù)的示例。

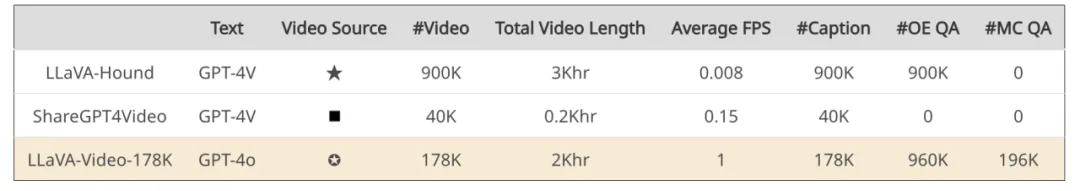

數(shù)據(jù)集比較

LLaVA-Video-178K 和其他視頻語言數(shù)據(jù)集的比較。平均 FPS 代表用于提示 GPT-4o/GPT-4V 進行注釋的每秒幀數(shù)。★:VIDAL, WebVid, ActivityNet。?:Panda-70M, Pexels, Pixabay, Mixkit, BDD100K, Ego4d。?:HD-VILA-100M, Kinetics-700M, Ego4D, VidOR, InternVid, YouCook2, ActivityNet, Sth-sthv2, VIDAL, Charades。

我們提供了和其他高質(zhì)量指令跟隨視頻語言數(shù)據(jù)集的比較,LLaVA-Video-178K 展現(xiàn)了如下優(yōu)勢

1. 廣泛的動態(tài)視頻集合:在視頻來源方面,雖然 LLaVA-Hound 包含最多的視頻,但其 44% 的視頻數(shù)據(jù)來自 [WebVid](https://ak.picdn.net/shutterstock/videos/21179416/preview/stock-footage-aerial-shot-winter-forest.mp4),其中大多數(shù)視頻是靜態(tài)的。ShareGPT4Video 的 30% 視頻來自 [Pexels](https://www.pexels.com/video/a-bird-is-standing-on-the-beach-27916646/)、[Pixabay](https://pixabay.com/videos/plane-modelling-miniature-lockheed-134519/) 和 [Mixkit](https://mixkit.co/free-stock-video/a-young-woman-clad-in-snugly-black-sportswear-doing-lunges-52112/)。這些視頻美學(xué)效果很好,但是同時存在視頻本身較為靜態(tài)的弊病。此外,其大部分視頻來自 Panda-70M,這些是從較長視頻中剪輯的短片,其情節(jié)較為簡單。相比之下,我們精心選擇了動態(tài),情節(jié)復(fù)雜的視頻,這對于開發(fā)強大的視頻理解模型至關(guān)重要。

2. 高幀率:關(guān)于采樣的幀的頻率,LLaVA-Video-178K 考慮了 1 FPS,而其他數(shù)據(jù)集考慮的 FPS 較低。LLaVA-Hound 從任意長度的視頻中均勻采樣 10 幀。平均 FPS 為 0.008,這樣會錯過一些細節(jié)。ShareGPT4Video 使用 CLIP 基于幀的獨特性選擇關(guān)鍵幀。此方法可能也會錯過視頻中的細微變化,因為 CLIP 的特征無法很好地捕捉細粒度動態(tài)。我們的方法以 FPS=1 進行采樣,不使用關(guān)鍵幀選擇算法,確保詳細的時間信息能夠在注釋中得到高覆蓋率的表達。

3. 多樣化的任務(wù):所提出的數(shù)據(jù)集考慮了三種常見的任務(wù)類型,包括描述、自由形式和封閉形式問答,而現(xiàn)有的數(shù)據(jù)集僅考慮了其中的一部分。同時,我們數(shù)據(jù)集的樣本質(zhì)量和數(shù)量更高。

該數(shù)據(jù)集聚焦動態(tài)視頻, 高幀率, 和多樣化的任務(wù), 讓視頻多模態(tài)大模型洞察每一瞬精彩。

視頻表示

基于經(jīng)典的 SlowFast 視頻表示方法,我們開發(fā)了 LLaVA-Video_SlowFast,以在視頻表示中,平衡幀數(shù)和視覺 token 的數(shù)量,同時考慮 LLM 的上下文窗口限制和 GPU 內(nèi)存的限制。

具體來說,我們根據(jù)擊中率 s 將幀分為兩組,每隔 s 幀均勻選出形成 * 慢 * 幀組,剩下的幀被認為是 * 快 * 幀組。需要注意的是,當(dāng) s=1 時,只有一組幀,這種情況下 SlowFast 表示就簡化為原始的簡單表示。對于每組幀,我們使用 PyTorch 函數(shù) avg_pool2d}() 應(yīng)用不同的池化率。我們對慢幀使用 pXp 池化,對快幀使用 2pX2p 池化。

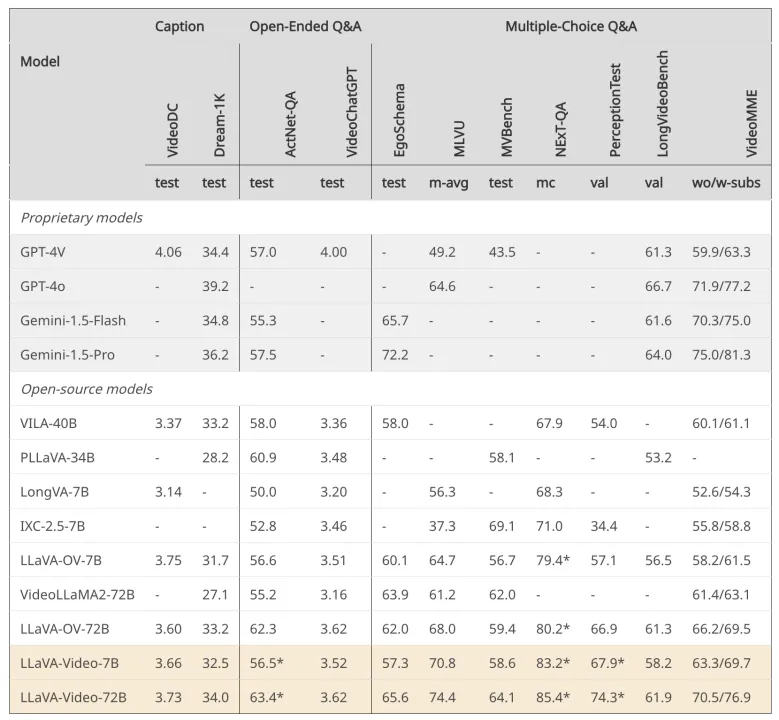

基準性能

LLaVA-Video 的表現(xiàn)。對于 VideoDC 和 VideoChatGPT 的,我們使用 5 分制度打分,其他評測集結(jié)果以準確率打分。所有結(jié)果均為 0-shot 準確率。* 表示該評測集的訓(xùn)練集已在我們的訓(xùn)練集中使用。

我們在視頻和圖像數(shù)據(jù)的聯(lián)合數(shù)據(jù)集上微調(diào)了 LLaVA-OneVision (SI)。具體而言,我們添加了來自 LLaVA-Video-178K 數(shù)據(jù)集和四個公共數(shù)據(jù)集的視頻數(shù)據(jù):ActivityNet-QA、NExT-QA、PerceptionTest 和 LLaVA-Hound-255K,此外,我們還使用了來自 LLaVA-OneVision 模型的 110 萬個圖像語言對。如表格所示,LLaVA-Video 展現(xiàn)了出色的性能。

結(jié)論

本研究介紹了高質(zhì)量的專為視頻語言指令任務(wù)設(shè)計的 LLaVA-Video-178K 數(shù)據(jù)集。它的特點是在較長的未修剪視頻中進行密集的幀采樣,覆蓋了包括字幕制作、開放式和多項選擇問答等多種任務(wù)。通過將 LLaVA-Video-178K 數(shù)據(jù)集與現(xiàn)有的視覺指令數(shù)據(jù)結(jié)合起來,我們開發(fā)了一系列新的模型,LLaVA-Video。這些模型改進了視頻表現(xiàn),更有效地利用了 GPU 資源,使我們能夠在訓(xùn)練過程中處理更多幀。實驗結(jié)果證明了所提出的合成數(shù)據(jù)集的有效性,LLaVA-Video 模型在各種視頻基準測試中都表現(xiàn)出色。