你真的了解預訓練嗎?預訓練與微調的區別是什么?

“ 預訓練是按部就班的學習,微調就是強化訓練”

在學習大模型的過程中,預訓練與微調是其中非常重要的兩個階段,一個模型效果好不好并不是由神經網絡模型的好壞決定的,而是由預訓練和微調來決定的。

大家都知道openAI的GPT模型采用的是Transformer技術架構,但市面上其它采用transformer架構的模型,卻很難達到GPT模型的效果,其中很大一部分原因就是在于預訓練與微調。

今天就來深度了解一下預訓練與微調。

什么是預訓練與微調?

預訓練

預訓練是一種深度學習模型訓練的策略,通常在大規模數據集上進行。預訓練的目標是通過在一個相關但較大的任務上訓練模型,使得模型學習到通用的特征表示。

這樣的預訓練模型在其它具體任務上的表現通常會更好,因為它已經學習到了普適的特征。

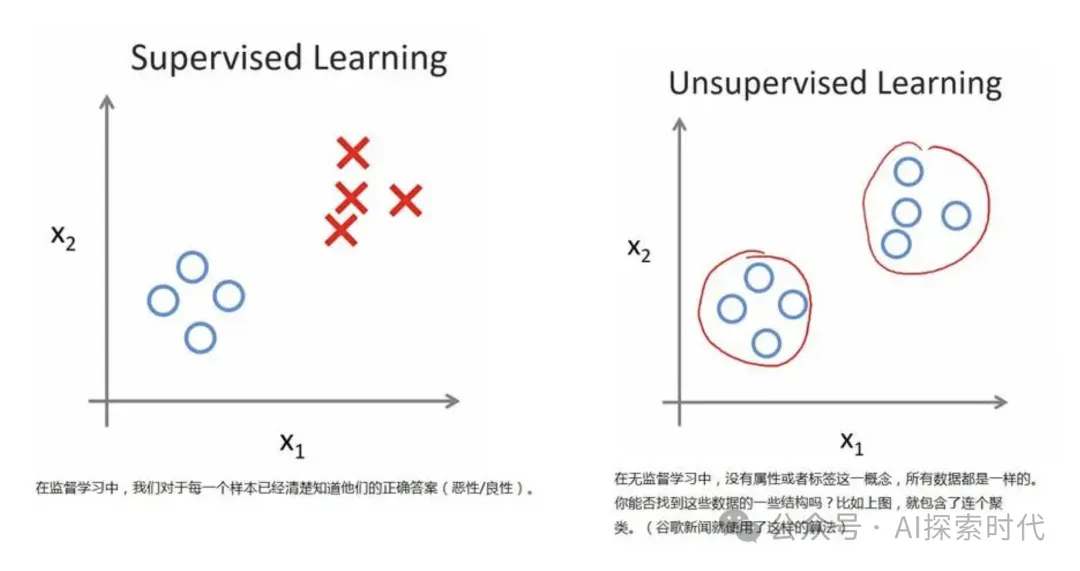

在深度學習中,預訓練可以分為兩種主要類型:無監督預訓練和有監督預訓練。

無監督訓練

在無監督訓練中,模型在沒有標簽的大規模數據上進行預訓練。常見的無監督預訓練方法包括自編碼器,變分自編碼器,對比預訓練等。

預訓練后模型的參數會被調整到一種更有用的表示形式,使得它能夠從輸入數據中提取有意義的特征。

有監督訓練

在有監督預訓練中,模型在一個與最終任務相關的較大數據集上進行預訓練。然后可以使用這些預訓練的權重作為最終任務的初始參數。這種方法通常能夠加速任務的訓練過程,特別是在目標任務數據較少時。

預訓練的好處

預訓練的好處在于,通過利用大規模數據進行訓練,模型可以學習到更泛化的特征表示,從而在具體任務上表現更好。

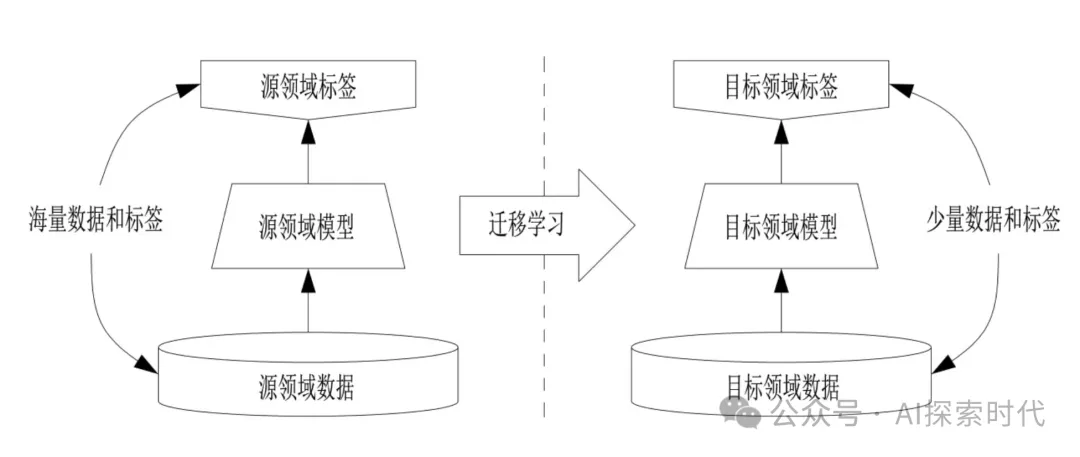

這對于數據較少的任務或計算資源有限的情況下特別有用;預訓練的模型也經常用于遷移學習,可以將預訓練模型的部分或全部用于新的任務,以提高模型的性能。

微調

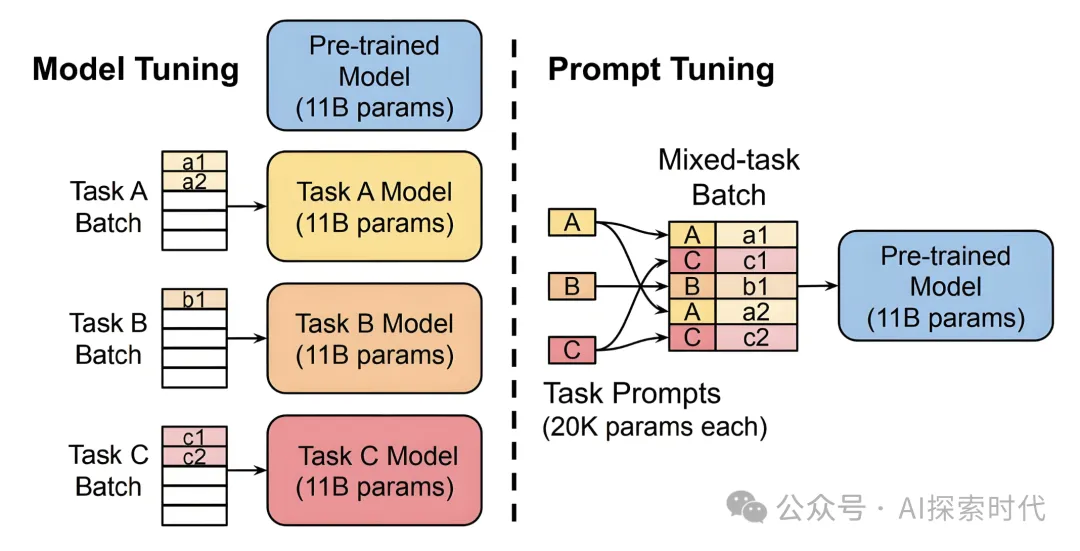

微調是指在預訓練模型的基礎之上,利用預訓練模型的參數,使用少量數據對模型參數進行部分適當調整,以此獲得在具體任務上的良好表現。

微調一般是采用凍結預訓練模型的大部分參數,只對小部分參數進行調整。

預訓練一般是使用大規模無標簽數據集上進行訓練(小部分也會采用有標簽數據集),也就是無監督學習;但微調是為了解決特定任務,因此微調主要使用的是小規模有標簽數據集。

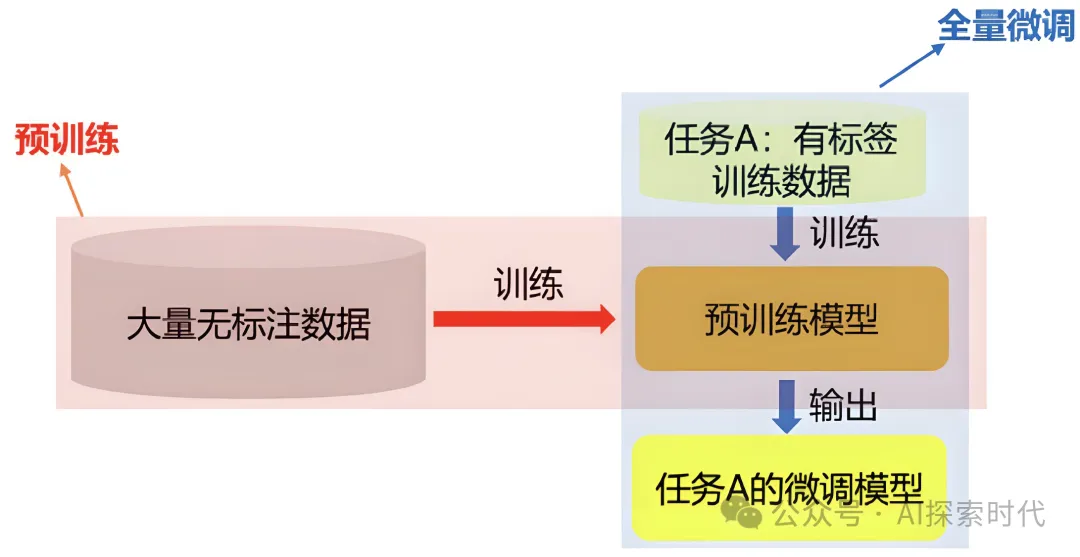

微調分為全量微調(全參數量調整)和高效微調(部分參數調整)等多種微調方式;全量微調和預訓練的區別就是,微調采用的是監督學習的方式,且預訓練之前的模型參數是隨機初始化的,而微調模型使用的是預訓練完成的模型參數。

預訓練的作用

預訓練的作用主要有以下幾點:

加速微調的過程

通過預訓練在大規模數據集上學習到的通用特征表示可以作為初始化參數,加速模型在特定任務上的訓練過程;這是因為預訓練的參數已經接近最優解,并且已經捕捉到了輸入數據中的一些通過模型,這樣在目標任務上的優化過程也更容易收斂。

提高性能

預訓練的模型通常在具體任務上表現更好。這是因為在預訓練階段,模型學習到了大量的數據中的通用特征,這些特征對于許多任務都是有用的,在目標任務中,預訓練模型能夠更好的利用這些通用特征,從而提高性能。

解決數據不足問題

在許多實際任務中,數據往往是有限的,特別是深度學習模型需要大量的數據進行訓練。通過預訓練,可以利用大規模數據集進行通用特征的學習,然后將這些學到的特征應用于目標任務,從而克服數據不足的問題。

遷移學習

預訓練的模型可以作為遷移學習的基礎,將預訓練模型的參數應用于新的相關任務,可以利用預訓練模型在大規模數據上學習到的通用特征,從而在新任務上提高性能。

提高泛化能力

預訓練有助于提高模型的泛化能力,即在未見過的數據上表現良好;通過在大規模數據上學習通用特征,模型更能夠從輸入數據中捕捉普遍的模式,而不是過度擬合訓練集。

預訓練與微調的區別

階段與目標

- 預訓練階段:在預訓練階段,模型使用大規模的數據集(通常是無標簽數據集)進行訓練,目標是學習通用的特征表示。這些通用特征可以應用于各種任務,因為它們反映了數據中的一般模式,而不是特定任務的信息。

- 訓練階段:在訓練階段,模型使用特定任務的有標簽數據集進行訓練,目標是根據該任務的特定目標函數調整模型參數,使其在該任務上表現良好。

數據集

- 預訓練階段:預訓練通常使用大規模無標簽數據集,因為其目標是學習通用特征表示,無需特定標簽信息。

- 訓練階段:訓練使用特定任務的有標簽數據集,因為需要根據任務的特定標簽進行監督式學習,優化模型在該任務上的性能

特征表示

- 預訓練階段:預訓練的目標是學習數據的通用特征表示,使得模型能夠捕捉數據中的一般模式和結構。

- 訓練階段:在訓練階段,預訓練的模型參數(通用特征表示)可以作為初始化參數,然后根據特定任務的目標函數進一步微調模型參數,使其更適應該任務。

任務目標

- 預訓練階段:預訓練的目標是促使模型學習更加泛化的特征,使其能夠在各種任務上有良好的表現。

- 訓練階段:訓練的目標是針對特定任務,最小化損失函數并優化模型參數,使其能夠在該任務上達到最佳性能。

總結

總之,預訓練和微調是兩個不同的階段,它們的目標、數據集和特征表示等方面都有所區別。

預訓練提供了一種有效的方式來初始化模型參數,并使模型受益于大規模數據的通用特征表示,而微調是讓模型在少量數據集上進行監督學習,從而在特定任務上表現更好。

本文轉載自公眾號AI探索時代 作者:DFires

原文鏈接:??https://mp.weixin.qq.com/s/CDdL6PtQNd-rCTVJSI8h-w??