人人都是音樂家!中科大&科大訊飛重磅開源OpenMusic:音樂生成更高質量,更有樂感 精華

文章鏈接:https://arxiv.org/pdf/2405.15863

代碼鏈接:https://github.com/ivcylc/qa-mdt

Huggingface鏈接:https://huggingface.co/spaces/jadechoghari/OpenMusic

Demo鏈接:https://qa-mdt.github.io/ (chatgpt * 30, musiccaps * 30)

亮點直擊

- 提出了一種質量感知訓練范式,使模型在訓練過程中能夠感知數據集的質量,從而在音樂性(美學角度)和音頻質量方面實現卓越的音樂生成效果。

- 創新性地將masked擴散Transformer引入到音樂信號中,展示了其在建模音樂潛在空間上的獨特效果,以及其在質量控制感知方面的卓越能力,從而進一步提升了生成音樂的質量和音樂性。

- 解決了大型音樂數據集中文本與音頻低相關性的問題,有效提高了文本對齊度和生成的多樣性。

背景

近年來,基于擴散的文本到音樂(TTM)生成方法逐漸受到重視,提供了一種創新的方法,將文本描述合成音樂內容。要在這一生成過程中實現高準確性和多樣性,必須依賴大量高質量的數據,包括高保真音頻波形和詳細的文本描述,但這些通常僅占現有數據集中的一小部分。在開源數據集中,低質量音樂波形、標簽錯誤、弱標簽和無標簽數據等問題顯著阻礙了音樂生成模型的發展。為了解決這些挑戰,今天和大家分享一種全新的高質量音樂生成范式,該范式結合了質量感知訓練策略,使生成模型能夠在訓練過程中辨別輸入音樂波形的質量。利用音樂信號的獨特特性,首先針對TTM任務調整并實現了一個掩碼擴散Transformer(MDT)模型,展現出其在質量控制和音樂性增強方面的獨特能力。此外,還通過字幕優化數據處理方法解決了TTM中低質量字幕的問題。實驗結果表明,在MusicCaps和Song-Describer數據集上取得了當前最先進的(SOTA)性能。

當前音樂生成(音效生成)領域的問題為質量低,具體來說分為三個方面:

- 大部分的開源數據集音質低(FMA,AudioSet,MSD),旋律雜亂

- 音樂性(美學角度)差

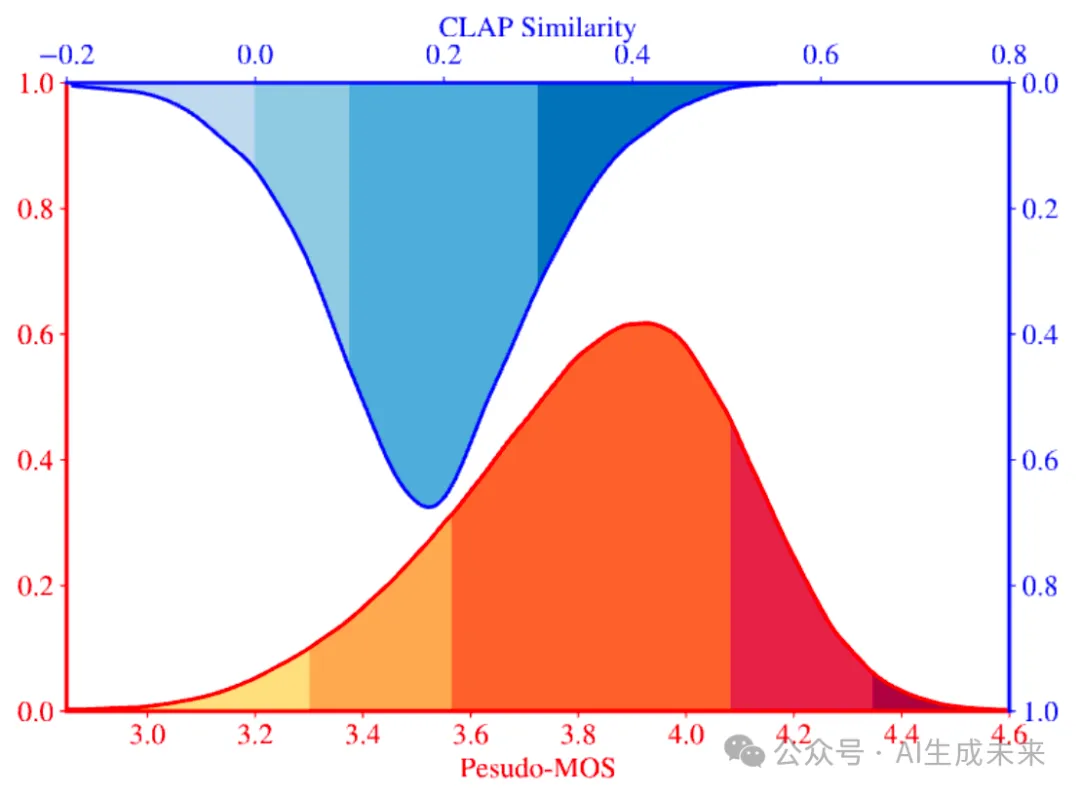

- 文本對齊度低,大多數的音頻處于少標簽,弱標簽,錯標簽。其中, 第1點可以由下圖藍色分布CLAP分數表征,2,3點可以由數據集的平均MOS分布表征(顏色由 分割)

創新方法及思路

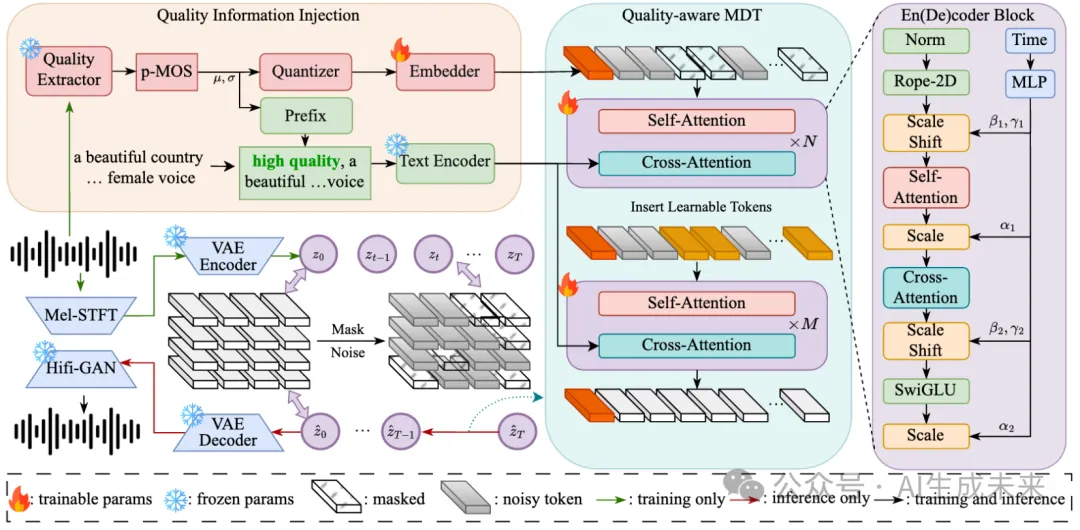

質量信息注入

解決: 引入質量感知訓練策略。采用主觀數據集中的MOS分訓練出的質量評分模型,在訓練過程中注入(偽MOS分)音頻質量信息。

兩種注入方法:

- 利用text encoder對分級后的 low quality, medium quality, high quality 質量文本進行cross attn嵌入 【粗粒度,適配unet架構和transformer類架構】

- 參考U-ViT內 時間信息和label信息的融入方式,以量化(閾值由 決定)后轉換為quality embedding, 以token 形式進行控制注入,【細粒度,并且只適配transformer類架構】

結論:質量感知策略允許了在推理階段以高質量文本和質量token進行引導,從而生成顯著高于訓練集平均質量的音頻。

以類似解耦的方式在訓練中感知音頻的質量(類似TTS中分離出音色訓練),從而更好地促進了模型的訓練(大幅降低FAD,KL,并提升IS,REL,CLAP等指標)。

我們還發現,粗粒度文本控制和細粒度token控制相結合,更有助于模型訓練中解耦,感知,并控制更高質量音頻的生成,從而解決訓練數據集影響的問題

質量感知型 masked擴散Transformer

解決:從音樂性建模角度,我們發現 U-ViT/DiT 類架構對頻譜隱空間建模也具有圖像上表達的scale ability,并能更好建模諧波,音色等方面(反應在主觀評分)

優化:

- 對頻譜切片而言,此類結構的收斂速度慢。消融數據集中,20w步時依然不能很好控制收斂,推測來源于時域/頻域相關性弱。故在預訓練階段加入掩碼,加速訓練速度和頻譜關聯性。微調階段以高質量數據進一步強化模型(5W步就有收斂跡象)。

- 相比于U-Net,transformer based架構對text encoder的質量信息感知能力增強,并且U-ViT 式 token 質量融入策略顯著有效進一步提升質量并降低客觀指標

- 圖像中切塊未考慮 overlap,探究了overlap策略在合成中的作用(大幅降低FAD,但在主觀聽感上有trade off)

優化音樂標注描述

解決:首次在音樂生成領域使用預訓練標注模型(LP-Musiccaps)進行大規模標注優化:

- 考慮到標注模型的不充分訓練導致錯標,以CLAP文本-音頻分數+閾值篩選低分數據

- 考慮到原始標注中有些詞(例如說American,R&B等標注器不一定能標注出的詞)。使用CLAP分數過濾出生成的與原始的文本相似度低低數據,利用語言模型 融合原始標注中有用信息。

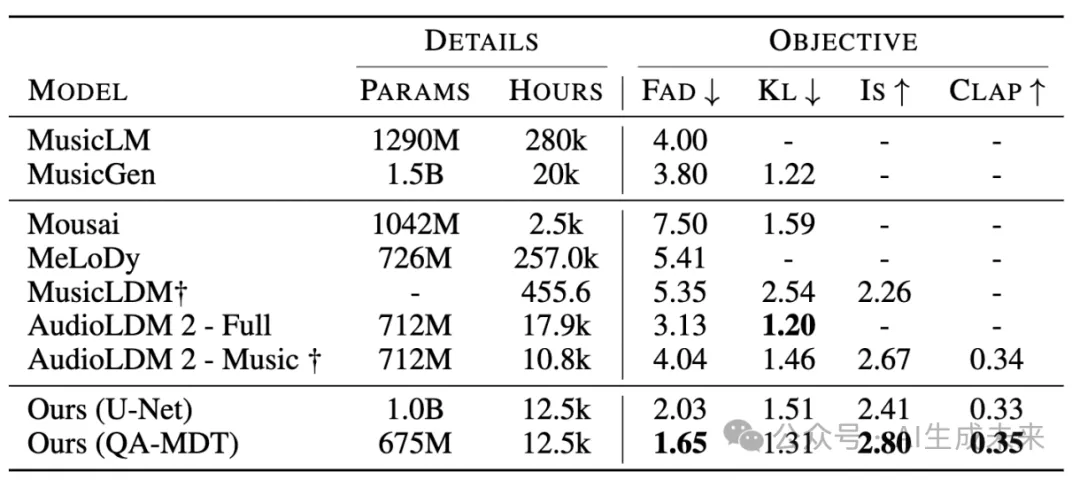

實驗

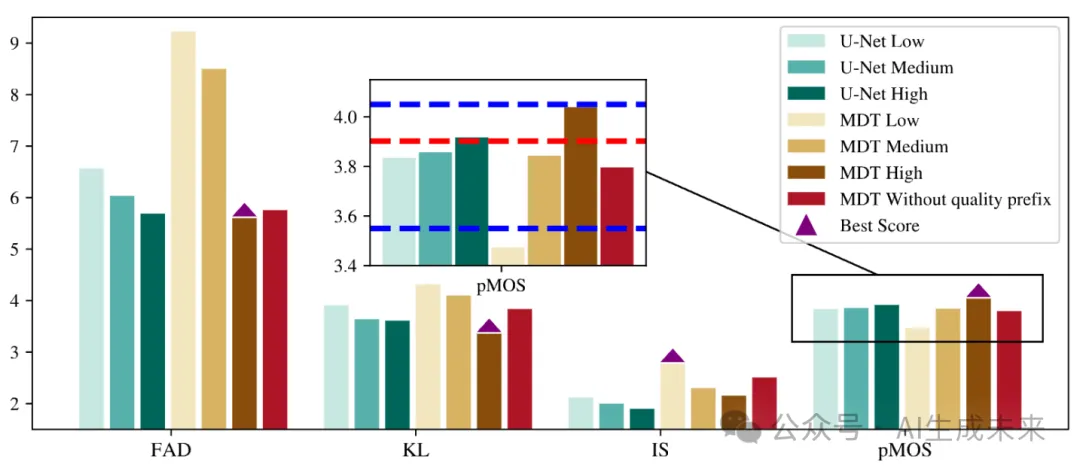

總體對比與,對比U-net架構和transformer based架構

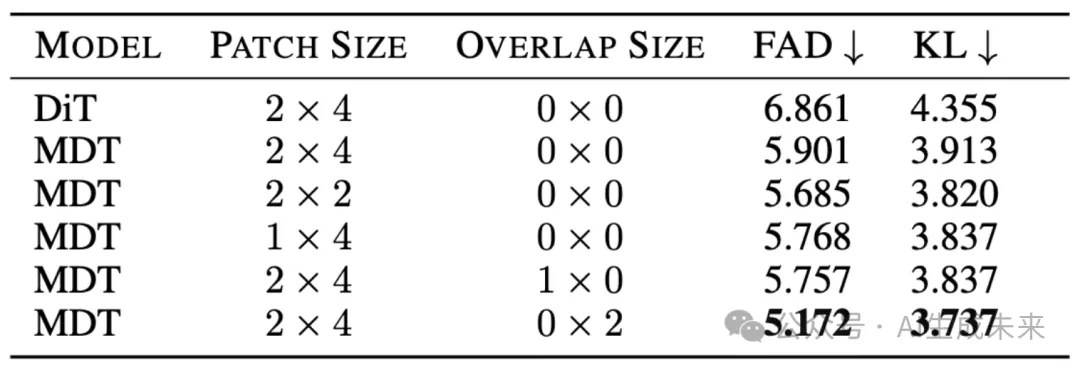

對比overlap策略和patch size

質量感知消融

此圖證明了相比于無質量感知,大幅提升了生成質量和客觀指標。并且,MDT(我們的架構)比 U-Net 在文本質量控制感知上的獨特優勢(生成質量更高,總體客觀指標更好)

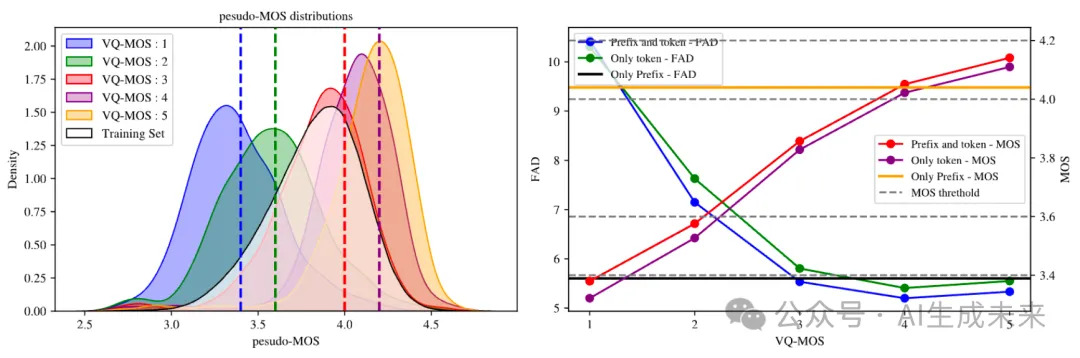

左圖展示了 token as control 的準確感知控制生成能力,生成的高質量數據(黃色區域)顯著高于訓練集MOS分。

右圖展示了文本質量控制和token質量控制的結合效果與單純token和文本控制的對比。

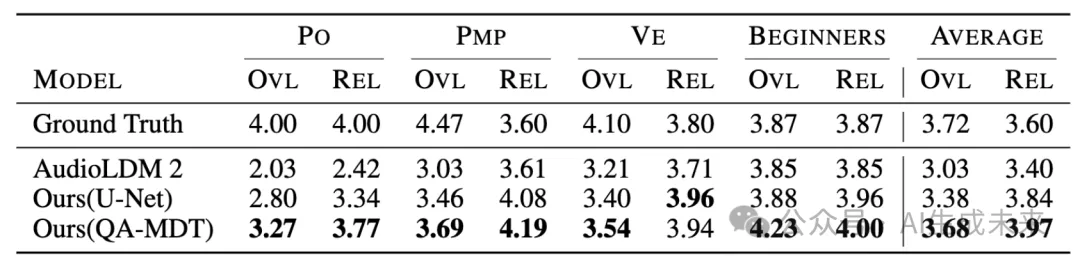

主觀評測結果

- PO:產品運營

- PMP:專業音樂制作人

- VE:視頻編輯人

- BEGINNERS:不懂音樂的小白

各個人的評分下,均有優勢。

結論與展望

本研究識別出大規模音頻質量不均和文本標注未對齊所帶來的挑戰,這些挑戰阻礙了基于擴散的文本到音樂(TTM)生成的發展。通過采用基于p-MOS的新型質量感知學習方法,以及以masked擴散Transformer作為擴散過程的主干,在音樂生成中實現了更高的生成質量和音樂性。

本文轉自 AI生成未來 ,作者:AI生成未來