修得快,還修得準!新一代視頻修復技術FloED性能超越所有擴散模型! | 港科大&達摩院

文章鏈接:https://arxiv.org/pdf/2412.00857

項目鏈接:https://nevsnev.github.io/FloED/

開源地址:https://github.com/NevSNev/FloED-main

亮點直擊

- 新穎的視頻修復模型。提出了一種專用的雙分支架構,通過流適配器(flow adapters)集成光流引導,從而增強時空一致性并生成協調的結果。

- 高效的去噪過程。引入了一種無需訓練的隱空間插值技術,利用光流加速多步去噪過程。結合流注意力緩存機制,FloED 有效降低了由光流引入的額外計算成本。

- 領先的性能表現。在物體移除(OR)和背景修復(BR)任務上進行了廣泛的實驗,包括定量和定性評估,驗證了 FloED 在性能與效率上均優于其他最先進的文本引導擴散方法。

總結速覽

解決的問題

- 時空一致性不足:現有基于擴散模型的視頻修復方法在生成內容時難以保持幀間時序連貫性,導致紋理、光照等出現不和諧(如CoCoCo)。

- 計算效率低:擴散模型的多步去噪過程本身計算成本高,而引入光學流(估計、補全、融合)進一步增加了額外開銷。

- 任務適應性差:現有方法在背景修復(BR)和物體移除(OR)任務中表現不佳,難以同時滿足文本語義對齊和時空一致性需求。

提出的方案

- 雙分支架構:

- 主修復分支:基于擴散模型完成視頻修復。

- 時間無關的光學流分支:先修復損壞的光學流,再通過多尺度流適配器(flow adapters)將運動信息注入主分支的U-Net解碼器。

- 高效加速技術:

- 訓練自由的隱空間插值:利用光流引導的變形操作(warping)加速早期去噪階段的多步采樣。

- 流注意力緩存機制:在剩余去噪階段緩存注意力計算結果,減少流適配器和流分支的重復計算。

- 錨幀策略:結合高質量圖像修復模型提升關鍵幀質量,以改善整體視頻修復效果。

應用的技術

- 擴散模型:基于AnimateDiff微調運動模塊,適配視頻修復任務。

- 光學流引導:

- 通過流分支補全損壞的光學流,提供運動一致性約束。

- 多尺度流適配器將光流特征融合到U-Net中。

- 加速技術:

- 光流變形(warping)實現隱空間特征插值。

- 注意力緩存減少冗余計算。

- 基準構建:針對BR和OR任務建立首個全面的擴散模型視頻修復評測基準。

達到的效果

- 性能提升:

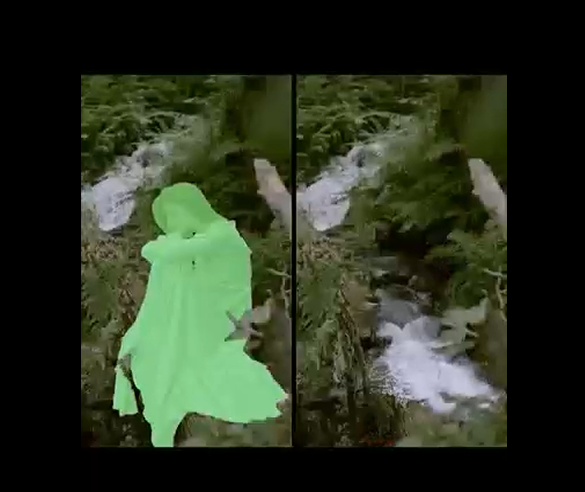

- 在BR和OR任務中,時空一致性和文本對齊性優于CoCoCo等SOTA方法(如圖1所示)。

- 修復區域與上下文視頻的紋理、光照更協調。

- 效率優化:

- 隱空間插值和注意力緩存顯著降低計算成本,加速多步去噪過程。

- 通用性:

- 框架適用于不同場景(如動態背景修復、物體移除),且無需額外訓練即可適配現有擴散模型。

方法

網絡概述

下圖2展示了本文提出的模型 FloED 的總體架構。FloED 采用預訓練的Stable Diffusion Inpainting主干網絡作為主分支,并集成了基于AnimateDiff v3初始化的運動模塊。FloED 的訓練過程分為兩個階段:

- 第一階段:微調運動模塊,使其時間建模能力適配視頻修復任務。

- 第二階段:

- 引入專用的流分支補全從掩碼幀估計的損壞光流。

- 通過多尺度流適配器將分層運動信息注入主修復分支。

- 采用錨幀策略利用圖像修復擴散模型的優勢提升視頻修復質量。

- 提出一種無需訓練的去噪加速技術,利用光流進行隱空間特征插值,并結合流注意力緩存機制顯著降低光流引入的計算開銷。

視頻修復中的光流引導

流補全分支:

- 該分支結構與主修復主干對齊,通過選擇性聚合主分支各塊的初始ResNet 模塊確保通道兼容性。

- 移除 ResNet 的時間步輸入,構建時間無關的流補全分支,使流特征不受擴散過程影響。

- 如圖2所示,補全后的光流通過多尺度流適配器注入主 UNet 分支的上采樣塊,提供全局運動指導。

流適配器:

- 受IP-Adapter啟發,流適配器由獨立的交叉注意力層構成,將重建的光流特征輸入交叉注意力以實現運動引導。

- 關鍵設計:流適配器置于文本交叉注意力層和運動模塊之間,通過光流先驗動態調整文本驅動的隱空間特征,解決生成內容與時空上下文的錯位問題。

錨幀策略

FloED高效推理

基于擴散模型的多步采樣特性,本文提出無需訓練的隱空間特征插值技術,利用光流加速去噪過程,并輔以流注意力緩存機制優化推理效率。

流注意力緩存

- 流分支獨立于時間步,推理階段僅在首步執行光流補全,后續步驟復用補全光流。

- 針對多尺度流適配器:通過首步計算鍵值對(K/V)并存入內存庫(圖2右側),后續步驟直接調用緩存,避免重復計算。

免訓練去噪加速基于相鄰隱空間特征具有相似運動模式且擴散模型在早期去噪階段生成高層內容的特性,本研究通過光流引導的插值實現加速。該技術完全無需額外訓練,具體流程如下圖3所示:

- 初始化階段:標準去噪流程補全光流并緩存流注意力。

- 交替處理:從第t-1步開始:

- 偶數幀(紅色)執行去噪

- 奇數幀(綠色)通過雙向光流變形(warping)生成

- 將噪聲隱空間特征z按奇偶索引劃分:

- 迭代優化:下一步僅對插值幀(綠色)去噪,紅色幀通過變形生成。由于變形操作耗時極低,每步僅需處理半數幀隱空間特征,使去噪延遲減半。

約束條件

- 插值操作限制在初始S步(對應圖像結構建立階段)

- 僅對相鄰幀執行變形以避免光流誤差累積

- 采用遮擋處理技術緩解光流變形可能導致的遮擋問題

實驗

實現細節

數據集與基準測試。本文采用Open-Sora-Plan數據集,通過場景切割獲得421,396個高質量視頻片段及其對應字幕。進一步構建了包含100個全新視頻的評估基準,素材來自Pexels和Pixabay平臺,其中50個用于物體移除(OR)任務,50個用于背景修復(BR)任務。針對BR任務,本研究使用聚焦背景的合成隨機掩碼;對于OR任務,通過Segment-Anything(SAM)模型逐幀生成物體掩碼。所有視頻均經人工篩選以確保運動幅度和攝像機移動速度的多樣性,同時保證4K分辨率與100幀的總長度。字幕方面,采用VideoGPT生成初始視頻提示詞,并對OR任務人工修正背景描述文本。

訓練與推理細節。本文采用512分辨率的16幀視頻序列進行兩階段訓練,通過隨機方向與形狀的掩碼序列模擬BR和OR任務。第一階段在8張NVIDIA A800 GPU上訓練5個epoch(批次大小8),第二階段在相同硬件上通過梯度累計實現批次大小128的30個epoch訓練(λ值設為0.1)。推理階段使用DDIM采樣器,經實驗將加速步長S設為5(總步數25步)。

對比實驗

與開源文本引導擴散方法全面對比,包括VideoComposer、CoCoCo、DiffuEraser。

定性比較。如下圖4所示,VideoComposer、CoCoCo和DiffuEraser在物體移除(OR)任務中表現出持續局限性,頻繁出現視覺偽影和內容幻覺,破壞與場景上下文的語義一致性。相比之下,FloED能夠用兼容內容填充掩碼區域,展現出精確的文本條件生成能力,在背景修復(BR)和物體移除任務中均實現更優的時間連貫性與整體協調性。

定量比較。通過指標評估和用戶研究進行量化對比:(1)指標評估:針對BR任務,采用PSNR、VFID和SSIM量化基礎質量,并結合光流扭曲誤差與時間一致性(TC)評估時序連貫性(TC通過CLIP-Image特征空間中連續幀的余弦相似度計算)。對于OR任務,由于缺乏真實數據支撐傳統指標,采用同樣基于CLIP分數的文本對齊度(TA)作為評估標準。所有指標均在512×512分辨率下測試。如下表1所示,FloED在所有指標上超越其他方法,展現最先進性能。

(2)用戶研究:鑒于CLIP分數與人類感知存在偏差,組織15名標注者對BR和OR任務(共100個視頻)的修復結果進行綜合評估,從時序連貫性、文本對齊度和上下文兼容性三個維度對四種方法進行優選。如下圖6所示,本研究的模型以BR任務62.27%和OR任務56.40%的優選率獲得最高評價。

消融實驗

光流相關消融研究。通過下圖5所示的實驗驗證運動引導機制的有效性:

(1) 光流補全。以物體移除場景為例,補全后的光流結果顯示受損區域實現了與周邊環境保持時空一致性的上下文感知修復(B與C對比)。重建結果進一步驗證了時序無關光流分支的補全能力。 (2) 光流適配器。這些重建光流通過多尺度適配器為修復主分支提供關鍵運動引導,有效提升場景兼容性并增強視頻連貫性(D與E對比)。實驗表明,多尺度光流適配器注入的運動指引能顯著改善生成內容的環境一致性,從而提升時序連貫性與整體質量。下表2的架構消融實驗顯示,相較于關鍵幀策略,多尺度光流適配器對框架性能提升更具優勢,證實了其在FloED中的核心作用。

效率實驗。本節在NVIDIA H800 GPU的FP16精度環境下進行效率測試,FloED的去噪過程采用25步采樣步數,分類器無關引導尺度(CFG)>1。

(1)隱空間插值步數。本文僅在去噪初期階段應用隱空間插值。下圖7的加速步數研究表明:當加速步數S超過去噪過程早期階段時,性能會出現斷崖式下跌。實驗證明,在前5步采用光流引導的隱空間插值,可在僅輕微影響性能的前提下最大化降低去噪耗時。

(2)效率消融研究。下表3顯示,相較于不含光流模塊的基礎版本,本研究對比了不同效率優化策略。由于訓練時光流分支具有時序無關性,測試階段僅需在首步去噪時運行光流分支完成破損光流修復并緩存記憶庫,后續步驟可直接使用已修復光流進行隱空間插值,并調用緩存的K/V鍵值對實現流引導。最終確定最優方案:前5步(第2-6步)執行隱空間插值,剩余步驟采用流緩存補充,在432×240分辨率下實現13.4%加速。相比完全不使用光流補全與注意力機制的基準版本,這些優化幾乎抵消了額外計算開銷。

(3)效率對比。下表4數據表明,在相同去噪步數下,FloED在所有分辨率下均優于CoCoCo、DiffuEraser等基于擴散模型的方法,展現出最先進的運算效率。

討論本文聚焦于文本引導的視頻修復,主要與基于擴散模型的方法對比。本文的隱空間插值技術可直接擴展至CoCoCo等其他擴散模型實現加速處理。但需指出,預修復破損光流的策略可能限制其跨場景遷移能力。

結論

本文提出FloED,一種通過光流引導增強時序一致性與計算效率的視頻修復框架。該雙分支架構首先生成修復光流,繼而通過多尺度適配器指導修復過程。無需訓練的隱空間插值技術與流注意力緩存機制,顯著降低了光流整合的典型計算開銷。實驗證明FloED在背景修復與物體移除任務中均達到最先進水平,展現出卓越的時序一致性與內容連貫性保持能力。

本文轉自AI生成未來 ,作者:AI生成未來