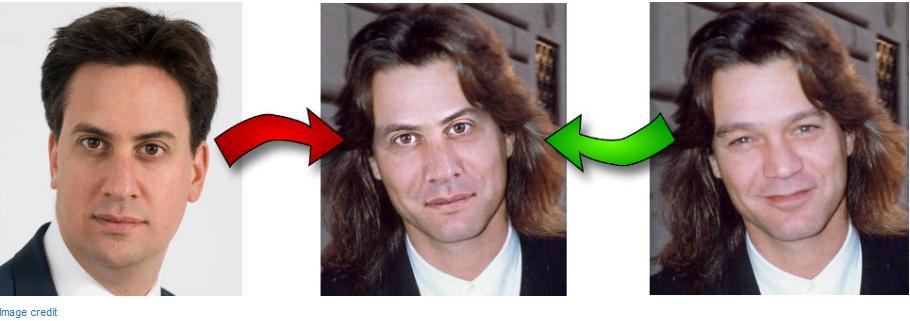

如何用200行Python代碼“換臉”

介紹

本文將介紹如何編寫一個只有200行的Python腳本,為兩張肖像照上人物的“換臉”。

這個過程可分為四步:

-

檢測面部標記。

-

旋轉、縮放和轉換第二張圖像,使之與***張圖像相適應。

-

調整第二張圖像的色彩平衡,使之與***個相匹配。

-

把第二張圖像的特性混合在***張圖像中。

完整的源代碼可以從這里下載: https://github.com/matthewearl/faceswap/blob/master/faceswap.py

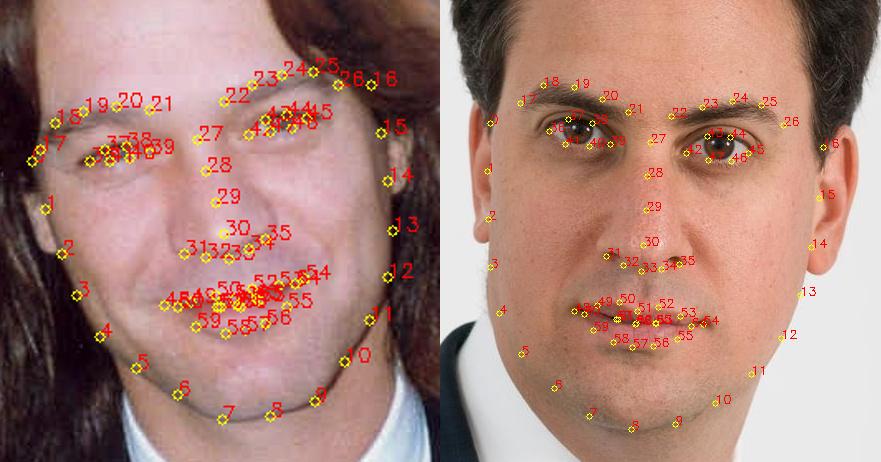

1.使用dlib提取面部標記

該腳本使用dlib的Python綁定來提取面部標記:

用Dlib實現了論文One Millisecond Face Alignment with an Ensemble of Regression Trees中的算法(http://www.csc.kth.se/~vahidk/papers/KazemiCVPR14.pdf,作者為Vahid Kazemi 和Josephine Sullivan) 。算法本身非常復雜,但dlib接口使用起來非常簡單:

- PREDICTOR_PATH = "/home/matt/dlib-18.16/shape_predictor_68_face_landmarks.dat"

- detector = dlib.get_frontal_face_detector()

- predictor = dlib.shape_predictor(PREDICTOR_PATH)

- def get_landmarks(im):

- rects = detector(im, 1)

- if len(rects) > 1:

- raise TooManyFaces

- if len(rects) == 0:

- raise NoFaces

- return numpy.matrix([[p.x, p.y] for p in predictor(im, rects[0]).parts()])

get_landmarks()函數將一個圖像轉化成numpy數組,并返回一個68 x2元素矩陣,輸入圖像的每個特征點對應每行的一個x,y坐標。

特征提取器(predictor)要一個粗糙的邊界框作為算法輸入,由傳統的能返回一個矩形列表的人臉檢測器(detector)提供,其每個矩形列表在圖像中對應一個臉。

為了構建特征提取器,預訓練模型必不可少,相關模型可從dlib sourceforge庫下載(http://sourceforge.net/projects/dclib/files/dlib/v18.10/shape_predictor_68_face_landmarks.dat.bz2)。

2.用普氏分析(Procrustes analysis)調整臉部

現在我們已經有了兩個標記矩陣,每行有一組坐標對應一個特定的面部特征(如第30行給出的鼻子的坐標)。我們現在要搞清楚如何旋轉、翻譯和規模化***個向量,使它們盡可能適合第二個向量的點。想法是,可以用相同的變換在***個圖像上覆蓋第二個圖像。

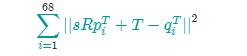

把它們更數學化,尋找T,s和R,令下面這個表達式的結果最小:

R是個2 x2正交矩陣,s是標量,T是二維向量,pi和qi是上面標記矩陣的行。

事實證明,這類問題可以用“常規普氏分析法” (Ordinary Procrustes Analysis) 解決:

- def transformation_from_points(points1, points2):

- points1 = points1.astype(numpy.float64)

- points2 = points2.astype(numpy.float64)

- c1 = numpy.mean(points1, axis=0)

- c2 = numpy.mean(points2, axis=0)

- points1 -= c1

- points2 -= c2

- s1 = numpy.std(points1)

- s2 = numpy.std(points2)

- points1 /= s1

- points2 /= s2

- U, S, Vt = numpy.linalg.svd(points1.T * points2)

- R = (U * Vt).T

- return numpy.vstack([numpy.hstack(((s2 / s1) * R,

- c2.T - (s2 / s1) * R * c1.T)),

- numpy.matrix([0., 0., 1.])])

代碼分別實現了下面幾步:

-

將輸入矩陣轉換為浮點數。這是之后步驟的必要條件。

-

每一個點集減去它的矩心。一旦為這兩個新的點集找到了一個***的縮放和旋轉方法,這兩個矩心c1和c2就可以用來找到完整的解決方案。

-

同樣,每一個點集除以它的標準偏差。這消除了問題的組件縮放偏差。

-

使用Singular Value Decomposition計算旋轉部分。可以在維基百科上看到關于解決正交普氏問題的細節(https://en.wikipedia.org/wiki/Orthogonal_Procrustes_problem)。

-

利用仿射變換矩陣(https://en.wikipedia.org/wiki/Transformation_matrix#Affine_transformations)返回完整的轉化。

之后,結果可以插入OpenCV的cv2.warpAffine函數,將圖像二映射到圖像一:

- def warp_im(im, M, dshape):

- output_im = numpy.zeros(dshape, dtype=im.dtype)

- cv2.warpAffine(im,

- M[:2],

- (dshape[1], dshape[0]),

- dst=output_im,

- borderMode=cv2.BORDER_TRANSPARENT,

- flags=cv2.WARP_INVERSE_MAP)

- return output_im

圖像對齊結果如下:

COLOUR_CORRECT_BLUR_FRAC = 0.6

LEFT_EYE_POINTS = list(range(42, 48))

RIGHT_EYE_POINTS = list(range(36, 42))

如果我們試圖直接覆蓋面部特征,很快就會看到一個問題:

兩幅圖像之間不同的膚色和光線造成了覆蓋區域的邊緣不連續。我們試著修正:

- COLOUR_CORRECT_BLUR_FRAC = 0.6

- LEFT_EYE_POINTS = list(range(42, 48))

- RIGHT_EYE_POINTS = list(range(36, 42))

- def correct_colours(im1, im2, landmarks1):

- blur_amount = COLOUR_CORRECT_BLUR_FRAC * numpy.linalg.norm(

- numpy.mean(landmarks1[LEFT_EYE_POINTS], axis=0) -

- numpy.mean(landmarks1[RIGHT_EYE_POINTS], axis=0))

- blur_amount = int(blur_amount)

- if blur_amount % 2 == 0:

- blur_amount += 1

- im1_blur = cv2.GaussianBlur(im1, (blur_amount, blur_amount), 0)

- im2_blur = cv2.GaussianBlur(im2, (blur_amount, blur_amount), 0)

- # Avoid divide-by-zero errors.

- im2_blur += 128 * (im2_blur <= 1.0)

- return (im2.astype(numpy.float64) * im1_blur.astype(numpy.float64) /

- im2_blur.astype(numpy.float64))

結果是這樣:

此函數試圖改變圖像2的顏色來匹配圖像1。它通過用im2除以im2的高斯模糊,然后乘以im1的高斯模糊。這里的想法是用RGB縮放校色,但是不是用所有圖像的整體常數比例因子,每個像素都有自己的局部比例因子。

用這種方法兩圖像之間光線的差異只能在某種程度上被修正。例如,如果圖像1是從一邊照亮,但圖像2是均勻照明的,色彩校正后圖像2也會出現未照亮邊暗一些的現象。

也就是說,這是一個相當粗糙的辦法,而且解決問題的關鍵是一個適當的高斯內核大小。如果太小,***個圖像的面部特征將顯示在第二個圖像中。過大,內核之外區域像素被覆蓋,并發生變色。這里的內核用了一個0.6 *的瞳孔距離。

4.把第二張圖像的特性混合在***張圖像中

用一個遮罩來選擇圖像2和圖像1的哪些部分應該是最終顯示的圖像:

值為1(白色)的地方為圖像2應該顯示出的區域,值為0(黑色)的地方為圖像1應該顯示出的區域。值在0和1之間為圖像1和圖像2的混合區域。

這是生成上面那張圖的代碼:

- LEFT_EYE_POINTS = list(range(42, 48))

- RIGHT_EYE_POINTS = list(range(36, 42))

- LEFT_BROW_POINTS = list(range(22, 27))

- RIGHT_BROW_POINTS = list(range(17, 22))

- NOSE_POINTS = list(range(27, 35))

- MOUTH_POINTS = list(range(48, 61))

- OVERLAY_POINTS = [

- LEFT_EYE_POINTS + RIGHT_EYE_POINTS + LEFT_BROW_POINTS + RIGHT_BROW_POINTS,

- NOSE_POINTS + MOUTH_POINTS,

- ]

- FEATHER_AMOUNT = 11

- def draw_convex_hull(im, points, color):

- points = cv2.convexHull(points)

- cv2.fillConvexPoly(im, points, color=color)

- def get_face_mask(im, landmarks):

- im = numpy.zeros(im.shape[:2], dtype=numpy.float64)

- for group in OVERLAY_POINTS:

- draw_convex_hull(im,

- landmarks[group],

- color=1)

- im = numpy.array([im, im, im]).transpose((1, 2, 0))

- im = (cv2.GaussianBlur(im, (FEATHER_AMOUNT, FEATHER_AMOUNT), 0) > 0) * 1.0

- im = cv2.GaussianBlur(im, (FEATHER_AMOUNT, FEATHER_AMOUNT), 0)

- return im

- mask = get_face_mask(im2, landmarks2)

- warped_mask = warp_im(mask, M, im1.shape)

- combined_mask = numpy.max([get_face_mask(im1, landmarks1), warped_mask],

- axis=0)

我們把上述代碼分解:

-

get_face_mask()的定義是為一張圖像和一個標記矩陣生成一個遮罩,它畫出了兩個白色的凸多邊形:一個是眼睛周圍的區域,一個是鼻子和嘴部周圍的區域。之后它由11個像素向遮罩的邊緣外部羽化擴展,可以幫助隱藏任何不連續的區域。

-

這樣一個遮罩同時為這兩個圖像生成,使用與步驟2中相同的轉換,可以使圖像2的遮罩轉化為圖像1的坐標空間。

-

之后,通過一個element-wise***值,這兩個遮罩結合成一個。結合這兩個遮罩是為了確保圖像1被掩蓋,而顯現出圖像2的特性。

***,應用遮罩,給出最終的圖像:

output_im = im1 * (1.0 - combined_mask) + warped_corrected_im2 * combined_mask