利用aiohttp制作異步爬蟲

簡介

asyncio可以實現單線程并發IO操作,是Python中常用的異步處理模塊。關于asyncio模塊的介紹,筆者會在后續的文章中加以介紹,本文將會講述一個基于asyncio實現的HTTP框架——aiohttp,它可以幫助我們異步地實現HTTP請求,從而使得我們的程序效率大大提高。

本文將會介紹aiohttp在爬蟲中的一個簡單應用。

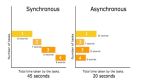

在原來的項目中,我們是利用Python的爬蟲框架scrapy來爬取當當網圖書暢銷榜的圖書信息的。在本文中,筆者將會以兩種方式來制作爬蟲,比較同步爬蟲與異步爬蟲(利用aiohttp實現)的效率,展示aiohttp在爬蟲方面的優勢。

同步爬蟲

首先,我們先來看看用一般的方法實現的爬蟲,即同步方法,完整的Python代碼如下:

- '''

- 同步方式爬取當當暢銷書的圖書信息

- '''

- import time

- import requests

- import pandas as pd

- from bs4 import BeautifulSoup

- # table表格用于儲存書本信息

- table = []

- # 處理網頁

- def download(url):

- html = requests.get(url).text

- # 利用BeautifulSoup將獲取到的文本解析成HTML

- soup = BeautifulSoup(html, "lxml")

- # 獲取網頁中的暢銷書信息

- book_list = soup.find('ul', class_="bang_list clearfix bang_list_mode")('li')

- for book in book_list:

- info = book.find_all('div')

- # 獲取每本暢銷書的排名,名稱,評論數,作者,出版社

- rank = info[0].text[0:-1]

- name = info[2].text

- comments = info[3].text.split('條')[0]

- author = info[4].text

- date_and_publisher = info[5].text.split()

- publisher = date_and_publisher[1] if len(date_and_publisher) >= 2 else ''

- # 將每本暢銷書的上述信息加入到table中

- table.append([rank, name, comments, author, publisher])

- # 全部網頁

- urls = ['http://bang.dangdang.com/books/bestsellers/01.00.00.00.00.00-recent7-0-0-1-%d' % i for i in range(1, 26)]

- # 統計該爬蟲的消耗時間

- print('#' * 50)

- t1 = time.time() # 開始時間

- for url in urls:

- download(url)

- # 將table轉化為pandas中的DataFrame并保存為CSV格式的文件

- df = pd.DataFrame(table, columns=['rank', 'name', 'comments', 'author', 'publisher'])

- df.to_csv('E://douban/dangdang.csv', index=False)

- t2 = time.time() # 結束時間

- print('使用一般方法,總共耗時:%s' % (t2 - t1))

- print('#' * 50)

輸出結果如下:

- ##################################################

- 使用一般方法,總共耗時:23.522345542907715

- ##################################################

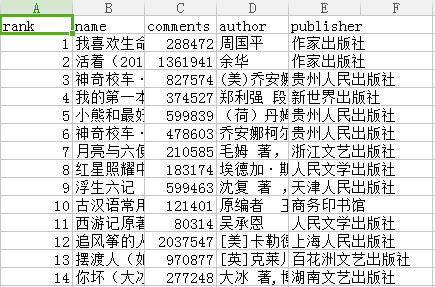

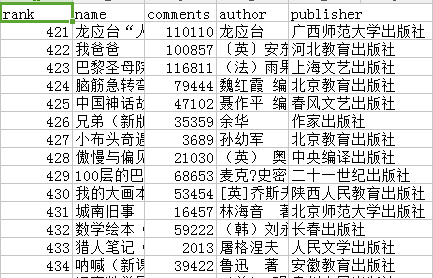

程序運行了23.5秒,爬取了500本書的信息,效率還是可以的。我們前往目錄中查看文件,如下:

異步爬蟲

接下來我們看看用aiohttp制作的異步爬蟲的效率,完整的源代碼如下:

- '''

- 異步方式爬取當當暢銷書的圖書信息

- '''

- import time

- import aiohttp

- import asyncio

- import pandas as pd

- from bs4 import BeautifulSoup

- # table表格用于儲存書本信息

- table = []

- # 獲取網頁(文本信息)

- async def fetch(session, url):

- async with session.get(url) as response:

- return await response.text(encoding='gb18030')

- # 解析網頁

- async def parser(html):

- # 利用BeautifulSoup將獲取到的文本解析成HTML

- soup = BeautifulSoup(html, "lxml")

- # 獲取網頁中的暢銷書信息

- book_list = soup.find('ul', class_="bang_list clearfix bang_list_mode")('li')

- for book in book_list:

- info = book.find_all('div')

- # 獲取每本暢銷書的排名,名稱,評論數,作者,出版社

- rank = info[0].text[0:-1]

- name = info[2].text

- comments = info[3].text.split('條')[0]

- author = info[4].text

- date_and_publisher = info[5].text.split()

- publisher = date_and_publisher[1] if len(date_and_publisher) >=2 else ''

- # 將每本暢銷書的上述信息加入到table中

- table.append([rank,name,comments,author,publisher])

- # 處理網頁

- async def download(url):

- async with aiohttp.ClientSession() as session:

- html = await fetch(session, url)

- await parser(html)

- # 全部網頁

- urls = ['http://bang.dangdang.com/books/bestsellers/01.00.00.00.00.00-recent7-0-0-1-%d'%i for i in range(1,26)]

- # 統計該爬蟲的消耗時間

- print('#' * 50)

- t1 = time.time() # 開始時間

- # 利用asyncio模塊進行異步IO處理

- loop = asyncio.get_event_loop()

- tasks = [asyncio.ensure_future(download(url)) for url in urls]

- tasks = asyncio.gather(*tasks)

- loop.run_until_complete(tasks)

- # 將table轉化為pandas中的DataFrame并保存為CSV格式的文件

- df = pd.DataFrame(table, columns=['rank','name','comments','author','publisher'])

- df.to_csv('E://douban/dangdang.csv',index=False)

- t2 = time.time() # 結束時間

- print('使用aiohttp,總共耗時:%s' % (t2 - t1))

- print('#' * 50)

我們可以看到,這個爬蟲與原先的一般方法的爬蟲的思路和處理方法基本一致,只是在處理HTTP請求時使用了aiohttp模塊以及在解析網頁時函數變成了協程(coroutine),再利用aysncio進行并發處理,這樣無疑能夠提升爬蟲的效率。它的運行結果如下:

- ##################################################

- 使用aiohttp,總共耗時:2.405137538909912

- ##################################################

2.4秒,如此神奇!!!再來看看文件的內容:

總結

綜上可以看出,利用同步方法和異步方法制作的爬蟲的效率相差很大,因此,我們在實際制作爬蟲的過程中,也不妨可以考慮異步爬蟲,多多利用異步模塊,如aysncio, aiohttp。另外,aiohttp只支持3.5.3以后的Python版本。

當然,本文只是作為一個異步爬蟲的例子,并沒有具體講述異步背后的故事,而異步的思想在我們現實生活和網站制作等方面有著廣泛的應用,本文到此結束,歡迎大家交流~