連肌肉顫動(dòng)都清晰可見(jiàn)!3D人體模型自動(dòng)生成算法,一作北大圖靈班

本文經(jīng)AI新媒體量子位(公眾號(hào)ID:QbitAI)授權(quán)轉(zhuǎn)載,轉(zhuǎn)載請(qǐng)聯(lián)系出處。

我們?cè)诖蛴螒颉⒖磩?dòng)漫的時(shí)候,遇到過(guò)不少這樣的情況:

感覺(jué)哪里不太對(duì)……

現(xiàn)在,這些3D人體模型可以得到改進(jìn)了~體態(tài)更逼真、褶皺更自然、肌肉更飽滿:

連情緒都顯得更投入了……

甚至肌肉顫動(dòng)也清晰可見(jiàn):

這么一對(duì)比,差距很明顯了~

不僅動(dòng)畫(huà)質(zhì)量更高,這種新方法還大量減少了人工參與,制作速度更快了。

要知道,以前的動(dòng)畫(huà)需要繁瑣的步驟,比如:搭建骨骼、蒙皮、刷權(quán)重等等……動(dòng)畫(huà)師往往要為此修煉數(shù)年,效果還常常不盡人意。

現(xiàn)在,只需一個(gè)神經(jīng)網(wǎng)絡(luò)就能搞定。

不僅如此,它還可以從形象中預(yù)測(cè)骨骼,并綁定權(quán)重,更容易地用運(yùn)動(dòng)捕捉來(lái)制作動(dòng)畫(huà)。

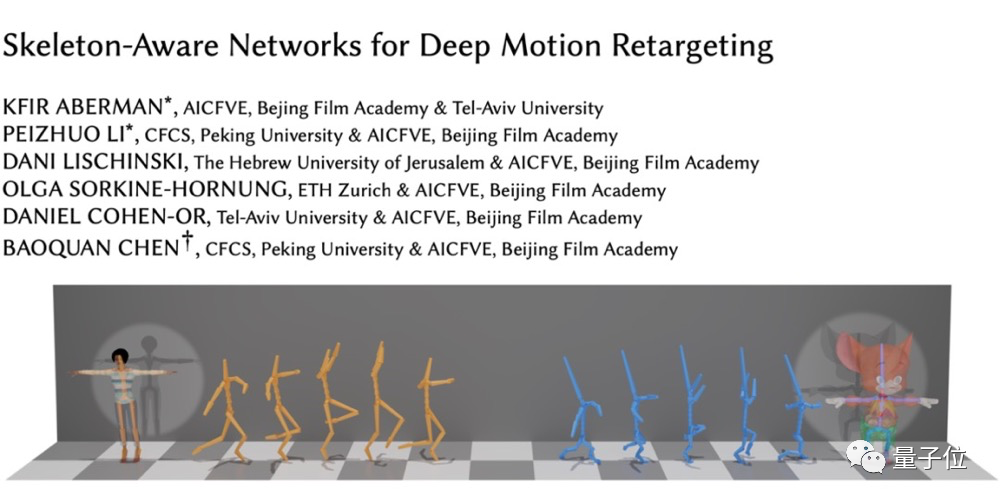

這一研究成果,由北京大學(xué)、北京電影學(xué)院等高校和機(jī)構(gòu)合作完成。

相關(guān)論文《Learning Skeletal Articulations with Neural Blend Shapes》在SIGGRAPH 2021上發(fā)表,代碼現(xiàn)已開(kāi)源。

提出神經(jīng)融合形狀技術(shù)

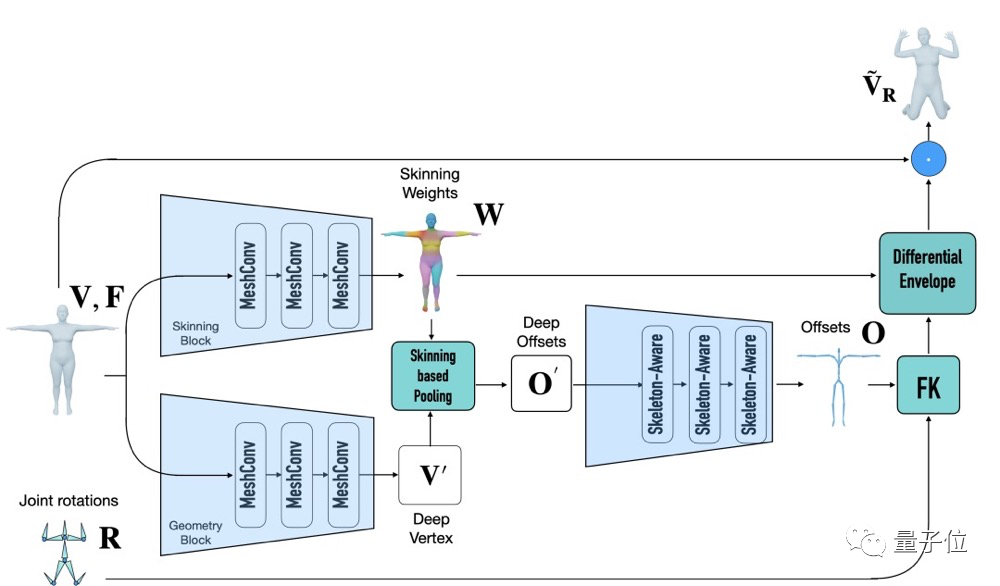

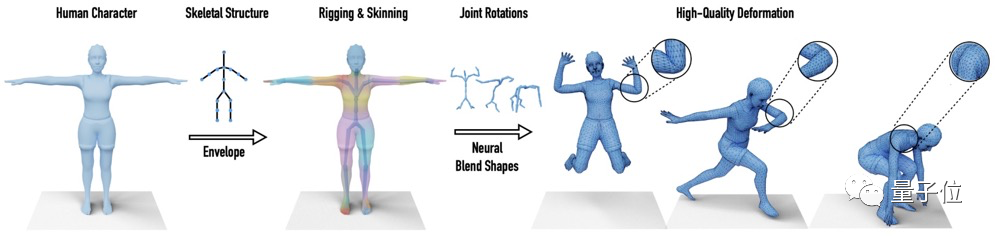

團(tuán)隊(duì)開(kāi)發(fā)了一套神經(jīng)網(wǎng)絡(luò),用來(lái)生成具有指定結(jié)構(gòu)的骨骼,并且精準(zhǔn)綁定骨骼的蒙皮權(quán)重。

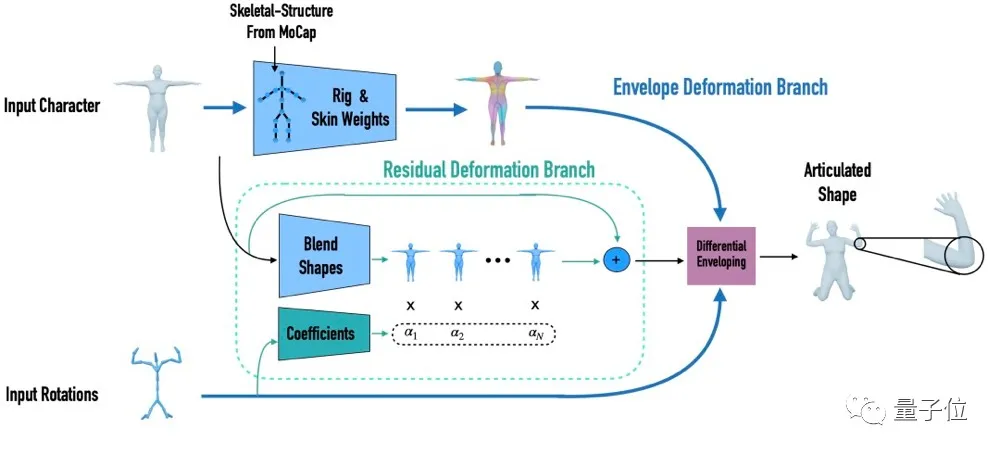

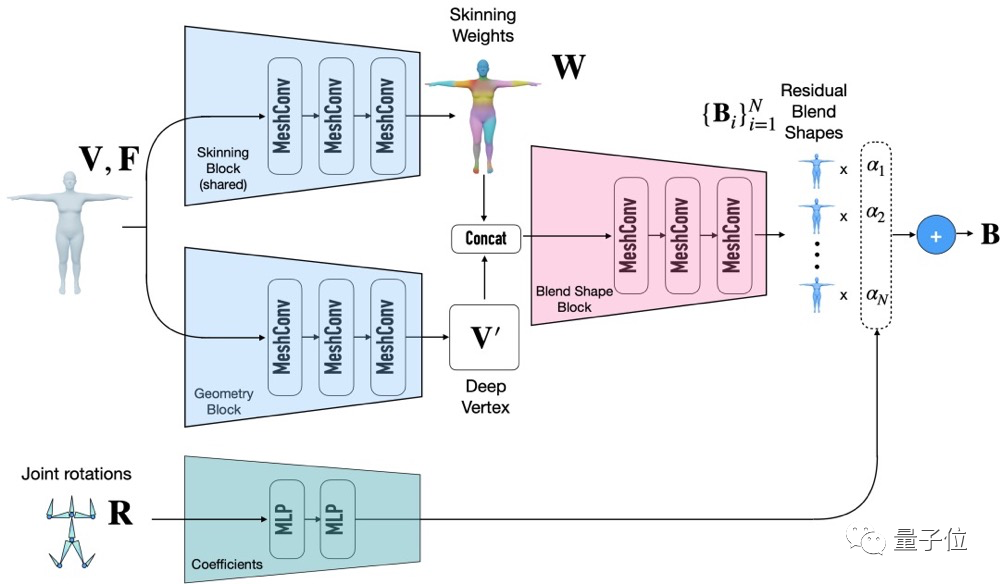

它由兩個(gè)部分組成:包裹變形分支(envelope deformation branch)和補(bǔ)償變形分支(residual deformation branch)。

其中,包裹變形分支通過(guò)間接監(jiān)督,學(xué)習(xí)由偏移量組成的特定骨架層次的裝配參數(shù),最后從輸入角色中預(yù)測(cè)出骨架、蒙皮和權(quán)重綁定。

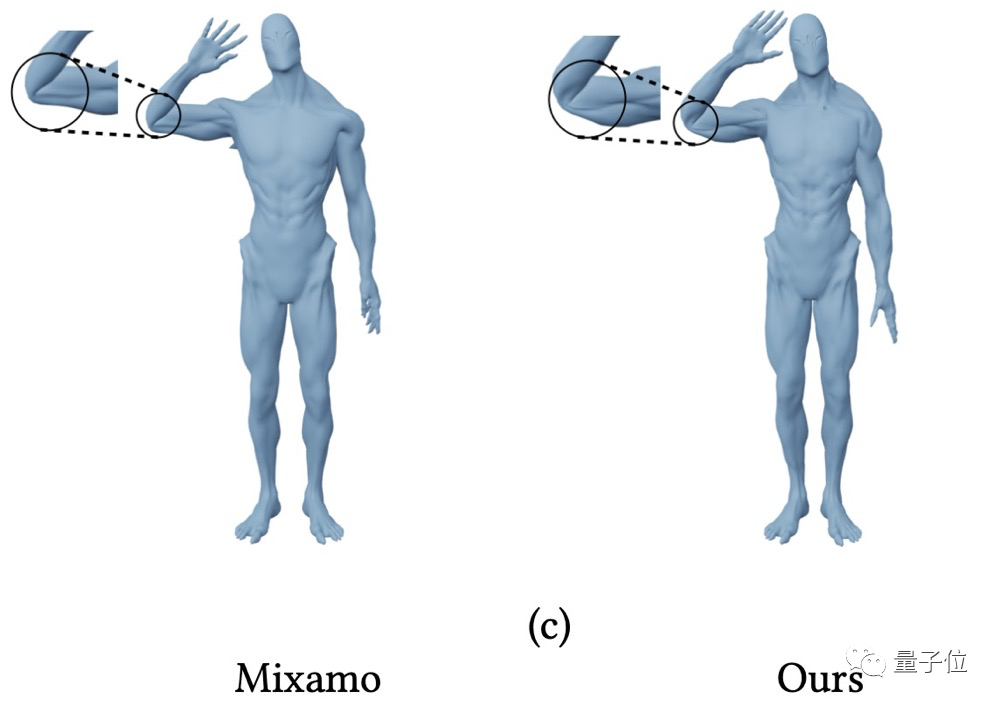

你可能會(huì)說(shuō),常用的動(dòng)畫(huà)制作工具M(jìn)ixamo中,也有綁定和蒙皮。

但是新方法能做的不只這些,它還可以準(zhǔn)確預(yù)測(cè)與模型高度匹配的骨骼,并綁定權(quán)重。

從而更容易進(jìn)行動(dòng)作捕捉,制作動(dòng)畫(huà):

并且,利用一種神經(jīng)融合形狀(neural blend shapes)技術(shù),補(bǔ)償變形分支可以根據(jù)輸入的網(wǎng)格連接,來(lái)預(yù)測(cè)對(duì)應(yīng)的融合形狀(blend shapes)。

與此同時(shí),根據(jù)關(guān)節(jié)旋轉(zhuǎn)預(yù)測(cè)融合系數(shù),然后基于此插值得到補(bǔ)償變形。

比如,神經(jīng)混合形狀會(huì)糾正肌肉的形狀,準(zhǔn)確保留鼓起的肌肉:

與LBS(線性混合蒙皮)算法的效果相比,細(xì)節(jié)處理得更好:

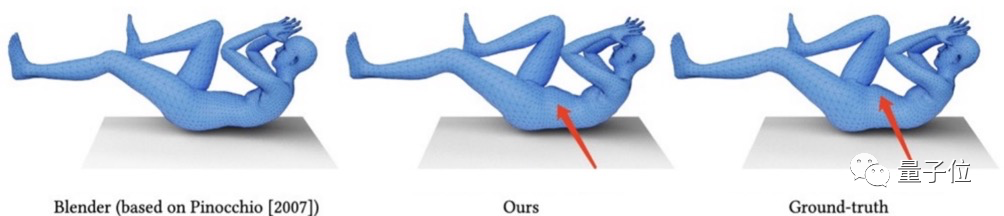

與三維動(dòng)畫(huà)制作軟件Blender的效果對(duì)比:(小肚腩被完美保留了)

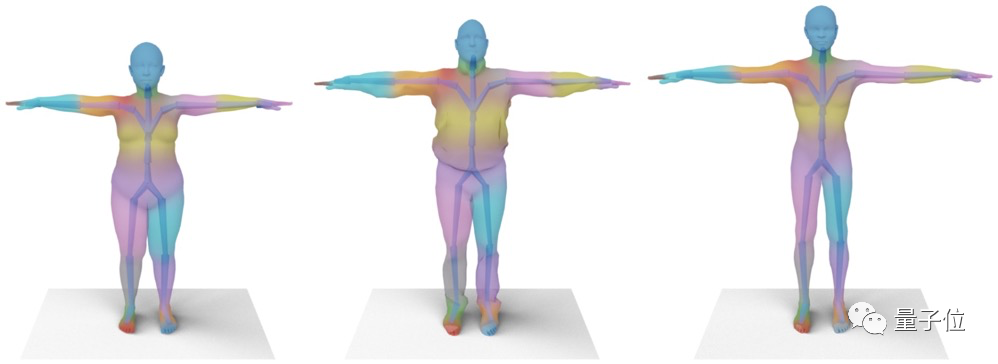

除此之外,研究團(tuán)隊(duì)還對(duì)神經(jīng)混合形狀系數(shù)進(jìn)行了可視化,可以看到左側(cè)輸出的形象,與右側(cè)相應(yīng)的姿勢(shì)綁定。

并且,通過(guò)顏色變化,表現(xiàn)各關(guān)節(jié)的混合形狀系數(shù)激活程度。

利用這一方法,神經(jīng)網(wǎng)絡(luò)只需觀察變形后的人物模型進(jìn)行間接學(xué)習(xí),而不需要對(duì)訓(xùn)練數(shù)據(jù)集的變形方法有任何限制,極大擴(kuò)大了適用范圍。

最終實(shí)現(xiàn)了,實(shí)時(shí)、高質(zhì)量的三維人物模型動(dòng)畫(huà)端到端自動(dòng)生成。

一作來(lái)自北大圖靈班

團(tuán)隊(duì)由來(lái)自北京大學(xué)陳寶權(quán)教授研究團(tuán)隊(duì)、北京電影學(xué)院未來(lái)影像高精尖創(chuàng)新中心、Google Research、特拉維夫大學(xué),以及蘇黎世聯(lián)邦理工學(xué)院的研究人員組成。

論文一作,是來(lái)自北大圖靈班的一名本科生——李沛卓。

他畢業(yè)于重慶一中,曾入選信息學(xué)競(jìng)賽省隊(duì),2017年高考以687分考入北大。

目前,李沛卓師從陳寶權(quán)教授,研究方向是深度學(xué)習(xí)和計(jì)算機(jī)圖形學(xué),正在北京大學(xué)視覺(jué)計(jì)算與學(xué)習(xí)實(shí)驗(yàn)室和北京電影學(xué)院未來(lái)影像高精尖創(chuàng)新中心(AICFVE)實(shí)習(xí)。

此前,他已有論文登上SIGGRAPH。在與量子位交流時(shí),他曾表示對(duì)圖形學(xué)特別感興趣。

論文的更多細(xì)節(jié),感興趣的小伙伴,可以戳鏈接了解詳情。

項(xiàng)目主頁(yè):

https://peizhuoli.github.io/neural-blend-shapes/

論文地址:

https://peizhuoli.github.io/neural-blend-shapes/papers/neural-blend-shapes-camera-ready.pdf