聽不懂梗怎么辦?谷歌5400億參數新模型可以給你解釋笑點,還能通過emoji表情猜電影

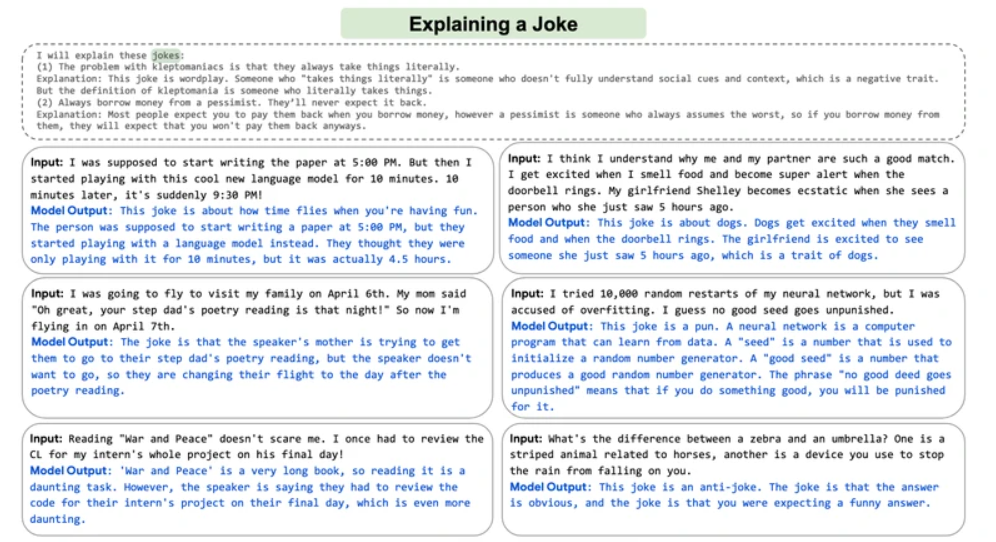

?來看一個笑話。

我本該在下午5點開始寫論文。 但后來我就開始玩這個很酷的新語言模型,玩了10分鐘,10分鐘后,突然就晚上9點半了!

這個笑話可能比較簡單,大家一聽就懂,不就是說“快樂的時光總是覺得很短暫”嘛。

不過,你能想象這里面說的“很酷的新語言模型”,居然也能聽懂這個笑話?

不僅能聽懂,它甚至還能一本正經地解釋這個笑話:

這個笑話是關于當你開心的時候,時間過得多么快。 這個人本來應該在下午5點開始寫一篇論文,但他們卻開始玩語言模型。 他以為自己只玩了1分鐘,但實際上是4.5小時。

這個能力的背后就是谷歌的新模型——Pathways Language Model (PaLM),一個可以解釋笑話的模型,有了它,世界上就再也沒有難懂的梗了。

論文地址:https://arxiv.org/pdf/2204.02311v2.pdf

1 PaLM,5400億參數,讓世上沒有難懂的梗

當然了,PaLM的設計之初,肯定不會只是想解釋解釋笑話。

去年,Google Research宣布了對PaLM的設想,PaLM會是一個單一的模型,可以在高效率的情況下推廣到各個領域和任務。

在“PaLM: Scaling Language Modeling with Pathways”論文中,Google Research詳細介紹了 Pathways Language Model (PaLM) ,這是一個5400億參數的Transformer模型。

PaLM可以實現在多個TPU v4 Pods中高效地訓練單個模型。Google Research在數百個語言理解和生成任務上對PaLM進行了評估,發現它在大多數任務上都達到了最先進的few-shot性能,在許多情況下都有很大的優勢。

這其中就包括解釋笑話的笑點在哪里。

事實上,解釋笑話并非易事,這需要對多步邏輯推理、綜合知識和深層語言理解的復雜組合的場景生成明確的解釋。

但是憑借著強大的語言處理能力,PaLM還是很好地勝任了這項任務。

甚至是冷笑話(),PaLM也能很好地識別出來。比如別人問你,“斑馬和雨傘有什么區別?”你可能會期待什么有意思的回答,但是答案是“一個是和馬有關的有條紋的動物,另一個是你用來阻止雨水落到你身上的裝置。”

這種無厘頭的冷笑話,PaLM給出的解釋是:

這個笑話是一個冷笑話(anti-joke)。笑話是答案是顯而易見的,笑點在于你期待一個有趣的答案。

2 PaLM甚至能從emoji中猜出電影名字

除了解釋笑話,PaLM在許多非常困難的任務上顯示出突破能力。

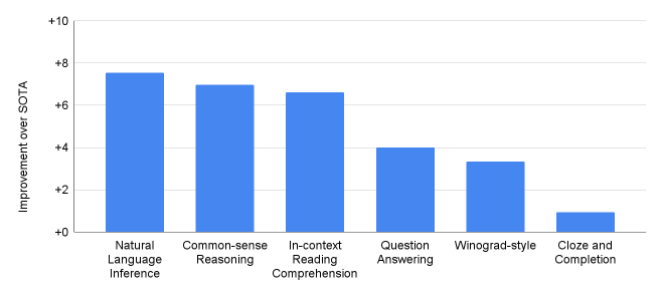

Google Research對29項廣泛使用的英語自然語言處理(NLP)任務進行了評估。在29個任務中的28個任務中,PaLM 540B超過了之前的大型模型,如GLaM、 GPT-3、Megatron-Turing NLG、 Gopher、 Chinchilla和LaMDA,這些任務包括問答任務、完形填空和句子完成任務、 Winograd-style任務、上下文閱讀理解任務、常識推理任務、 SuperGLUE任務和自然語言推理任務。

除了英語自然語言處理任務外,PaLM 在多語言自然語言處理基準(包括翻譯)方面也表現出色,盡管只有22%的學習語料是非英語的。

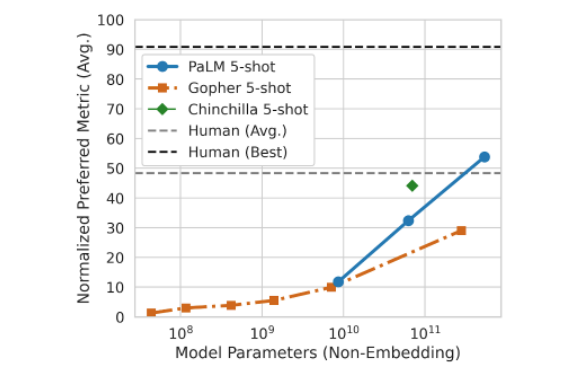

另外,研究人員還在最近發布的包含150多個新語言建模任務的Beyond the Imitation Game Benchmark(BIG-bench)上探討了PaLM的能力,并發現PaLM實現了突破性的性能。

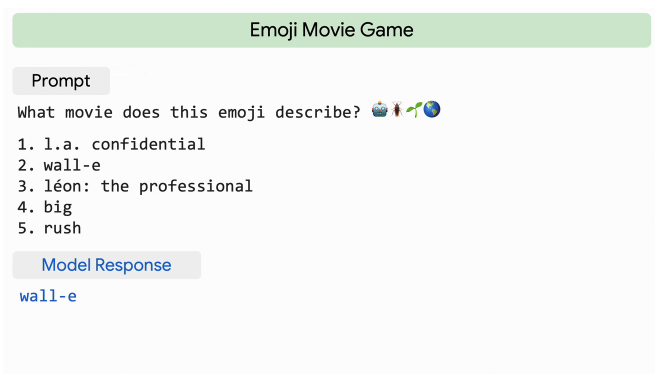

PaLM在幾個BIG-bench任務上展示了令人印象深刻的自然語言理解能力和生成能力。例如,該模型可以區分因果關系,在適當的背景下理解概念組合,甚至可以從emoji中猜出電影名字。

對于發展PaLM的未來愿景,Google AI Blog在報道中寫道,希望實現“一個單一的人工智能系統能夠概括成千上萬的任務,理解不同類型的數據,并以非凡的效率完成這些工作”。