谷歌機器人邁入「交互語言」新紀元!開放命令正確率高達93.5%,開源數據量提升十倍

注意看,眼前的這個男人正在對著一個機器人不斷發出自然語言指令,如「把綠色的星推到紅色塊之間」、「把藍色的方塊移動到左下角」,機器人對每一次輸入的指令都可以實時完成。

自上世紀60年代開始,機器人專家就開始嘗試讓機器人聽懂人的「自然語言指令」,并執行具體的行動。

理想情況下,未來的機器人將對用戶能夠用自然語言描述的任何相關任務做出實時反應。

特別是在開放的人類環境中,用戶可能需要在機器人行為發生時自定義行為,提供快速糾正,比如「停止,將手臂向上移動一點」或是指定限制「慢慢向右移動」。

此外,實時語言可以使人和機器人更容易在復雜的長期任務中進行協作,人們可以迭代和交互式地指導機器人操作,偶爾會有語言反饋。

目前的相關工作大體可以分為以下三部分:

1、機器人本體需要存在于現實世界;

2、能夠響應大量且豐富的自然語言命令;

3、能夠執行交互式的(interactive)語言命令,即機器人需要在任務執行的過程中接受新的自然語言指令。

對于第三點來說,目前機器人領域在交互式方面的發展速度仍然非常緩慢,也讓機器人缺乏「生命感」。

最近Google發表了一篇論文,提出了一個全新的框架,可以生產真實世界的、實時交互的、執行自然語言指令的機器人,并且相關數據集、環境、基準測試和策略都已開放使用。

論文鏈接:https://arxiv.org/pdf/2210.06407.pdf

項目主頁:https://interactive-language.github.io/

通過對幾十萬個語言標注軌跡的數據集進行行為克隆訓練,產生的策略可以熟練地執行比以前的工作實現了多一個數量級的命令。在現實世界中,研究人員估計該方法在87000個不同的自然語言字符串上有93.5%的成功率。

并且同樣的策略能夠被人類通過自然語言進行實時引導,以解決廣泛的精確的長距離重新排列目標,例如 「用積木做一個笑臉」等。

隨論文共同發布的數據集包括近60萬個語言標記的軌跡,比之前的可用數據集也要大一個數量級。

交互式語言:與機器人實時對話

想要讓機器人融入現實世界中,最重要是能夠處理開放式的自然語言指令,但從機器學習的角度來看,讓機器人學習開放詞匯表語言是一個巨大的挑戰。

開放代表模型需要執行大量任務,包括小的糾正指令等。現有的多任務學習設置利用精心設計的模仿學習數據集或復雜的強化學習獎勵功能來驅動每個任務的學習,通過這種方式設計的預定義集合注定不會很大。

因此,在開放詞匯表任務中一個關鍵的問題是: 應該如何擴展機器人數據的收集過程,使其能夠涵蓋真實環境中成千上萬的行動,以及如何將所有這些行為與最終用戶可能實際提供的自然語言指令聯系起來?

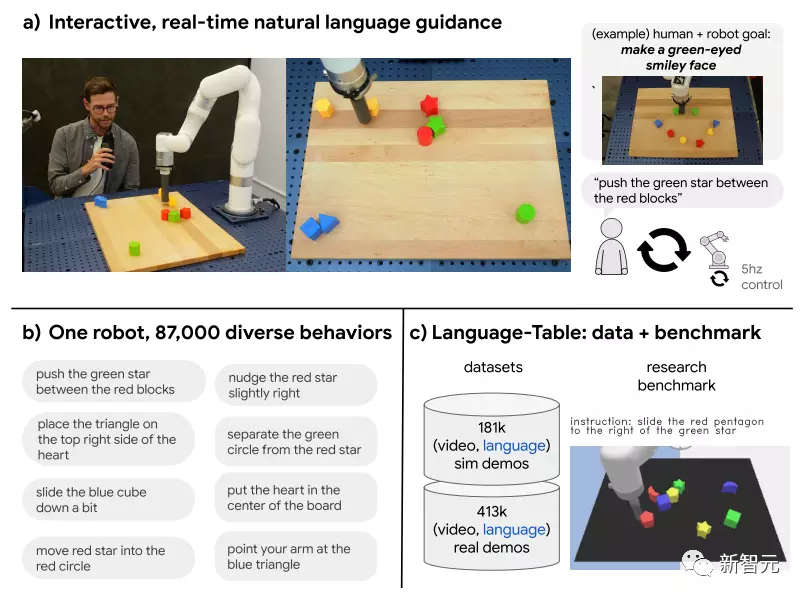

在交互式語言中,Google提出的大規模仿真學習框架關鍵是創建大型、多語言條件的機器人演示數據集的可伸縮性。

和以前設置中需要定義所有的技能,然后收集每個技能策劃的示范不同的是,研究人員不斷在跨多個機器人在無場景重置(scene resets)或低級別技能分割(low level skill segmentation)的情況下收集數據。

所有的數據,包括失敗的數據(如把塊從桌子上敲下來 knocking blocks off a table),都要經過一個hindsight language relabeling的過程才能與文本配對。

在這個過程中,標注人員需要觀看長長的機器人視頻來識別盡可能多的行為,標記每個行為的開始和結束時間,并使用無限制形式的自然語言來描述每個片段。

最重要的是,與之前設置的引導相比,所有用于訓練的技能都是從數據本身自下而上顯示出來的,而非由研究人員預先確定的。

研究人員有意將學習方法和架構盡可能簡化,機器人策略網絡是一個交叉注意力Transformer,將5赫茲的視頻和文本映射到5赫茲的機器人動作,在沒有輔助損失(auxiliary losses)的情況下使用標準的監督式學習行為克隆目標。

在測試時,新的自然語言命令可以通過speech-to-text以高達5赫茲的速率發送到策略網絡中。

開源基準

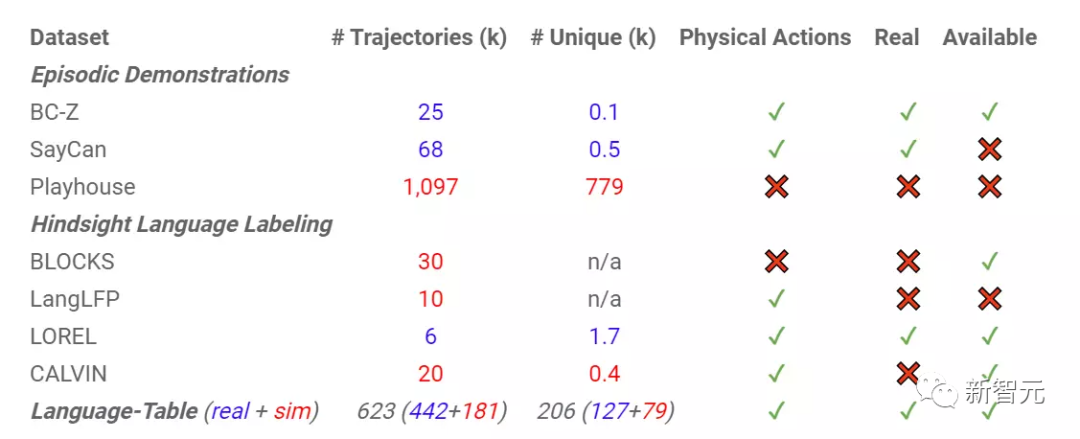

在標注過程中,研究人員收集了一個Language-Table數據集,其中包含超過44萬實際和18萬模擬的機器人執行自然語言命令的演示,以及機器人在演示過程中采取的動作順序。

這也是當下最大的基于語言條件的機器人演示(language-conditioned robot demonstration)數據集,直接提升了一個數量級。

Language-Table 推出了一個模擬仿真學習基準,可以用它來進行模型選擇,或者用來評估不同方法訓練得到的機器人執行指令的能力。

實時語言行為學習

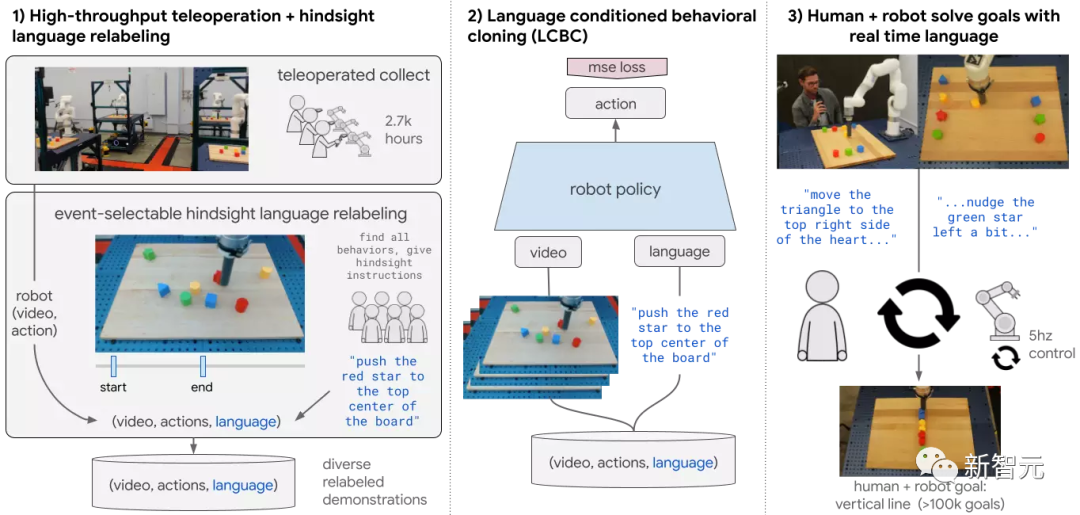

在實驗中,研究人員發現,當機器人能夠跟隨實時輸入的自然語言指令時,機器人的能力就會顯得特別強大。

在項目網站中,研究人員展示了用戶可以僅使用自然語言就能引導機器人通過復雜的長視野序列(long-horizon sequences)來解決需要較長時間才能精確協調控制的目標。

比如在桌子上有許多blcoks,命令可以是「用綠眼睛做一個笑臉」或者「把所有的放在一條垂直線上」等。

因為機器人被訓練去跟隨開放的詞匯語言,所以在實驗中能夠看到機器人可以對一系列不同的口頭修正做出反應,如「輕輕地向右移動紅色的星星」。

最后,研究人員探索了實時語言的優勢,例如可以讓機器人數據采集變得更加高效,一個人類操作員可以同時使用口頭語言控制四個機器人,有可能在未來擴大機器人數據收集的規模,而不需要為每個機器人配備一個標注員。

結論

雖然該項目目前僅限于桌面上的一套固定的物體,但交互式語言的實驗結果可以初步表明,大規模模仿學習確實可以生產出實時交互式機器人,能夠遵循自由形式的終端用戶命令。

為了推動物理機器人實時語言控制技術的進步,研究人員開源了Language-Table,也是目前最大的基于語言條件下的真實世界機器人演示數據集,也可以作為相關的模擬基準。

研究人員認為,這個數據集的作用可能不僅僅局限于機器人控制領域,而且可能為研究語言和動作條件視頻預測、機器人視頻條件語言建模,或者在更廣泛的機器學習環境中研究其他許多有趣的活躍問題提供一個新起點。