Meta-Transformer 多模態(tài)學(xué)習(xí)的統(tǒng)一框架

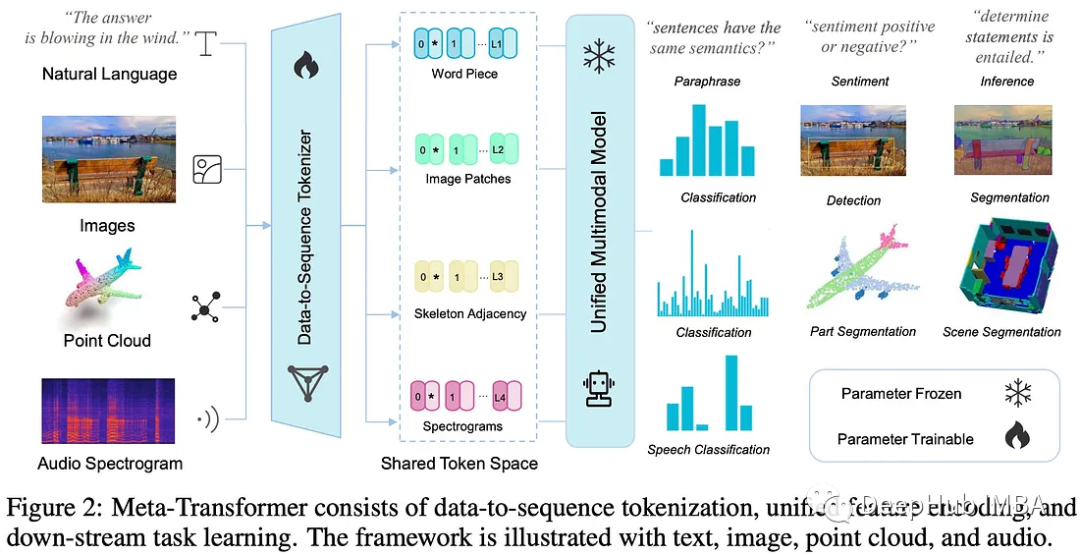

Meta-Transformer是一個用于多模態(tài)學(xué)習(xí)的新框架,用來處理和關(guān)聯(lián)來自多種模態(tài)的信息,如自然語言、圖像、點(diǎn)云、音頻、視頻、時間序列和表格數(shù)據(jù),雖然各種數(shù)據(jù)之間存在固有的差距,但是Meta-Transformer利用凍結(jié)編碼器從共享標(biāo)記空間的輸入數(shù)據(jù)中提取高級語義特征,不需要配對的多模態(tài)訓(xùn)練數(shù)據(jù)。該框架由統(tǒng)一的數(shù)據(jù)標(biāo)記器、模式共享編碼器和用于各種下游任務(wù)的任務(wù)頭組成。它是在不同模式下使用未配對數(shù)據(jù)執(zhí)行統(tǒng)一學(xué)習(xí)的第一次努力。實驗表明,它可以處理從基礎(chǔ)感知到實際應(yīng)用和數(shù)據(jù)挖掘的廣泛任務(wù)。

Meta-Transformer

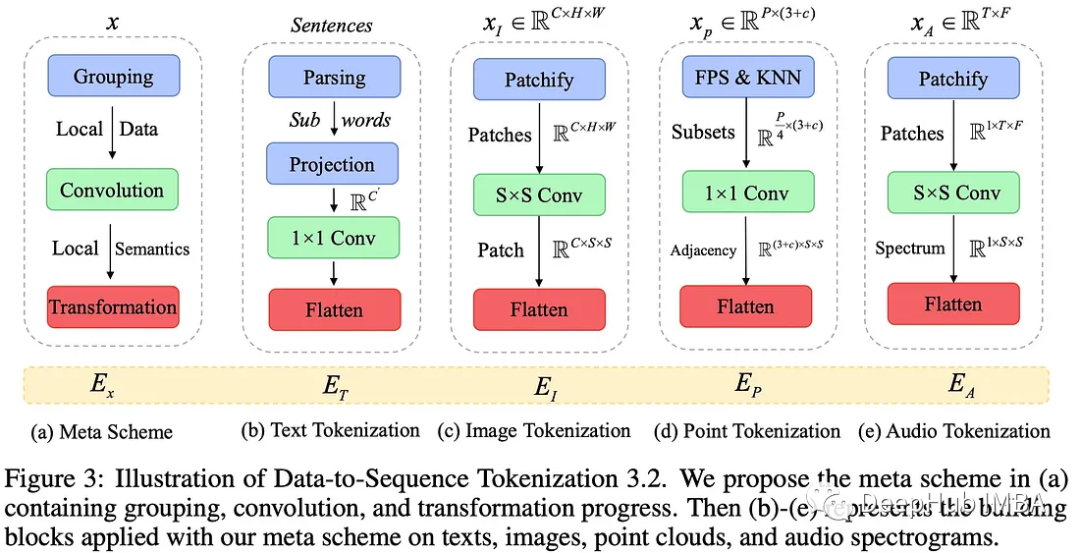

數(shù)據(jù)到序列的令牌標(biāo)記

研究人員提出了一種元標(biāo)記化方案,將來自不同模式(如文本、圖像、點(diǎn)云和音頻)的數(shù)據(jù)轉(zhuǎn)換為共享空間中的標(biāo)記嵌入。

對于自然語言,他們使用了帶有30000個標(biāo)記詞匯表的WordPiece 嵌入,它將單詞分割成子單詞,并將每個輸入文本轉(zhuǎn)換成一組標(biāo)記嵌入。

對于圖像,他們將圖像重塑為一系列平坦的2D補(bǔ)丁,然后利用投影層投影嵌入維度。該操作也可用于紅外圖像,而線性投影用于高光譜圖像。他們用3D卷積代替2D卷積層用于視頻識別。

對于點(diǎn)云,采用最遠(yuǎn)點(diǎn)采樣(FPS)操作將原始點(diǎn)云從原始輸入空間轉(zhuǎn)換為標(biāo)記嵌入空間,以固定采樣比對原始點(diǎn)云的代表性骨架進(jìn)行采樣。然后,使用k -最近鄰(KNN)對相鄰點(diǎn)進(jìn)行分組,并構(gòu)建鄰接矩陣來捕獲3D物體和場景的結(jié)構(gòu)信息。

對于音頻頻譜圖,使用Mel濾波器組和Hamming窗口對音頻波形進(jìn)行預(yù)處理,以將波分割成間隔。然后將頻譜圖從時間和頻率維度分割成補(bǔ)丁,然后將其平面化為標(biāo)記序列。

統(tǒng)一的編碼器

在將原始輸入從各種模式轉(zhuǎn)換為標(biāo)記(令牌)嵌入后,研究人員使用了一個統(tǒng)一的Transformer 編碼器,其中包含了固定的參數(shù)來編碼這些令牌。基于ViT模型的編碼器在LAION-2B數(shù)據(jù)集上進(jìn)行對比學(xué)習(xí)預(yù)訓(xùn)練,提高編碼器的通用標(biāo)記編碼能力。對于文本理解,他們使用來自CLIP的預(yù)訓(xùn)練文本標(biāo)記器將句子轉(zhuǎn)換為子詞,然后轉(zhuǎn)換為詞嵌入。

論文中作者提到的“模態(tài)不可知學(xué)習(xí)”,一個可學(xué)習(xí)的標(biāo)記(xCLS)被添加到標(biāo)記嵌入序列的開始。該令牌的最終隱藏狀態(tài)充當(dāng)輸入序列的摘要表示,通常用于識別任務(wù)。位置嵌入也會被添加到標(biāo)記嵌入中。

Transformer 編碼器由多個堆疊的多頭自關(guān)注層和MLP塊組成,對這些嵌入序列進(jìn)行處理。作者指出,添加更復(fù)雜的2d感知位置嵌入并不能顯著提高圖像識別性能。

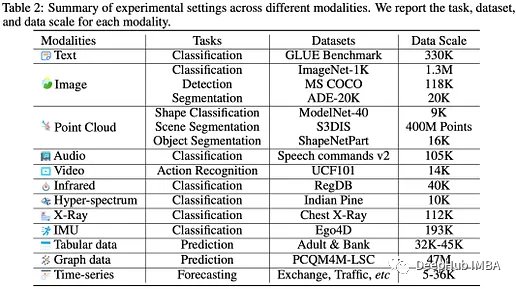

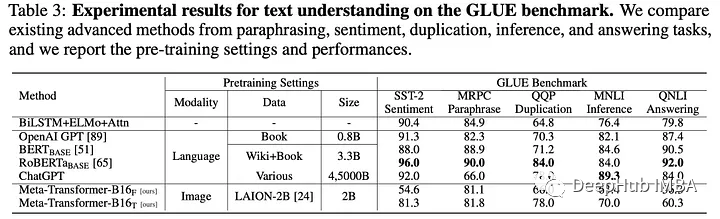

實驗結(jié)果

Meta-Transformer模型在各種語言和圖像理解任務(wù)中雖然并不總是優(yōu)于其他先進(jìn)的方法,但也表現(xiàn)出了很好的效果。

在GLUE基準(zhǔn)測試的文本理解任務(wù)中,Meta-Transformer在情感、釋義、復(fù)制、推理和回答任務(wù)方面得分相對較高。雖然它的表現(xiàn)不如BERT、RoBERTa和ChatGPT等模型,但它在理解自然語言方面表現(xiàn)出了新的希望,尤其是在微調(diào)之后。

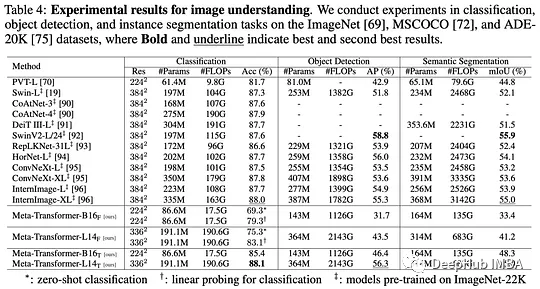

在圖像理解任務(wù)上,Meta-Transformer在幾個方面優(yōu)于Swin Transformer系列和interimage等模型。當(dāng)與CLIP文本編碼器相結(jié)合時,它在零樣本分類方面提供了強(qiáng)有力的結(jié)果。它在目標(biāo)檢測和語義分割任務(wù)上也優(yōu)于其他模型,顯示了它在圖像理解方面的熟練程度。

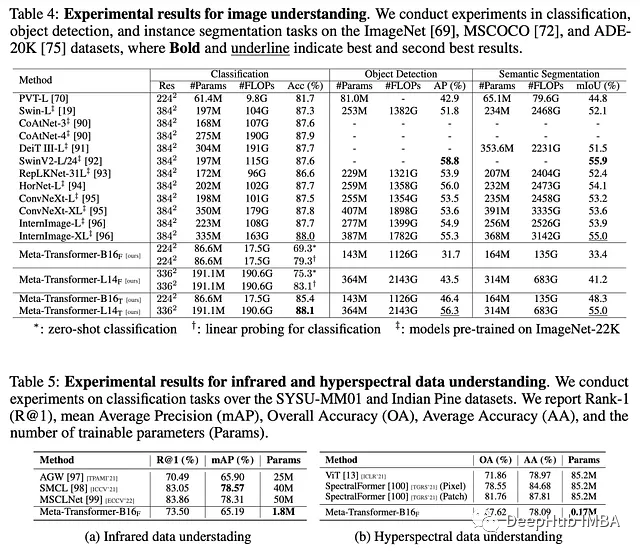

Meta-Transformer在處理紅外和高光譜圖像識別任務(wù)方面也被證明是有效的,分別在RegDB和Indian Pine數(shù)據(jù)集上進(jìn)行了測試。盡管Meta-Transformer沒有登頂排行榜,但其結(jié)果也很不錯,展示了處理與紅外圖像和高光譜圖像相關(guān)的挑戰(zhàn)的潛力。

在x射線圖像處理方面,Meta-Transformer取得了94.1%的性能,表明其在醫(yī)學(xué)圖像分析方面的實用性。

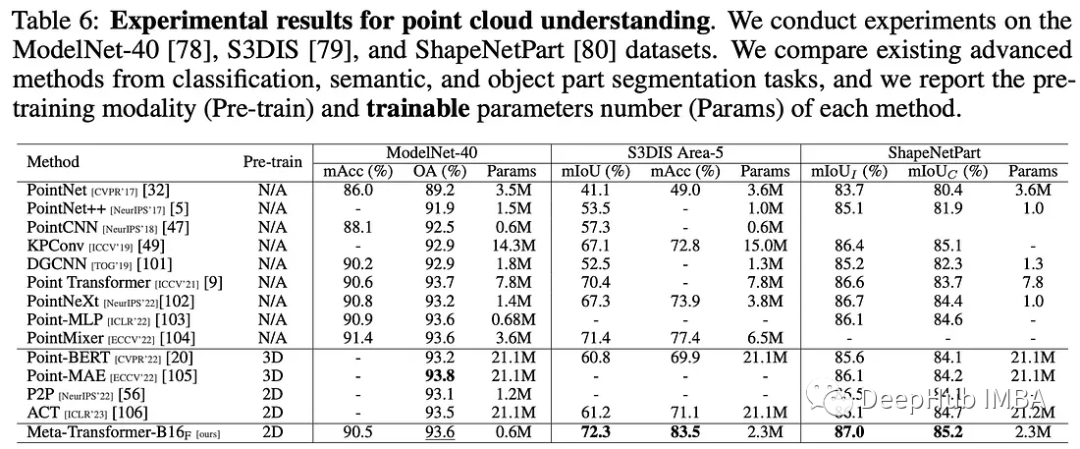

在點(diǎn)云理解任務(wù)中,Meta-Transformer在ModelNet-40、S3DIS和ShapeNetPart數(shù)據(jù)集上與其他模型相比,它在可訓(xùn)練參數(shù)較少的情況下獲得了較高的準(zhǔn)確率分?jǐn)?shù),強(qiáng)調(diào)了它在這一領(lǐng)域的效率。

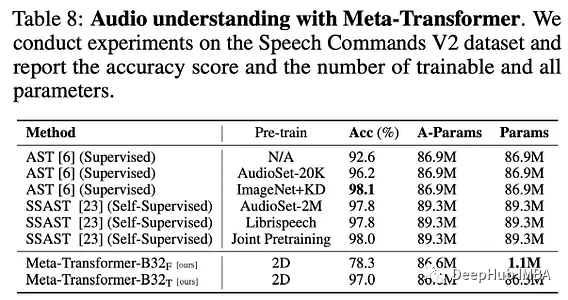

在音頻識別任務(wù)中,Meta-Transformer具有與AST和SSAST等現(xiàn)有音頻Transformer模型競爭的優(yōu)勢,在調(diào)整參數(shù)時達(dá)到97.0%的高精度。盡管AST的性能很好,但像AST這樣的模型具有更多可訓(xùn)練的參數(shù)。

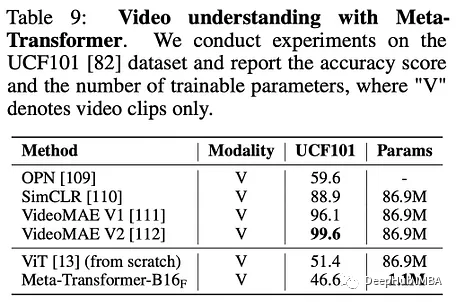

在視頻理解任務(wù)中,正如在UCF101數(shù)據(jù)集上測試的那樣,Meta-Transformer在準(zhǔn)確性方面并不優(yōu)于其他最先進(jìn)的方法。但是它的突出之處在于其明顯較少的可訓(xùn)練參數(shù),這表明了統(tǒng)一的多模式學(xué)習(xí)和較低的體系結(jié)構(gòu)復(fù)雜性的潛在好處。

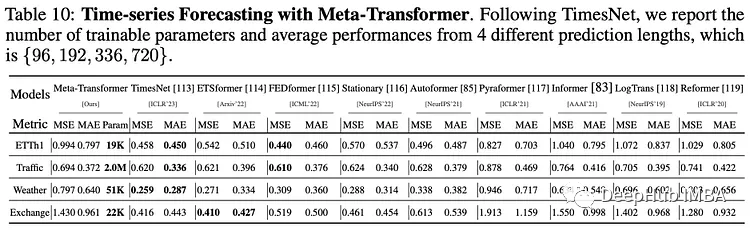

在時間序列預(yù)測任務(wù)中,Meta-Transformer在ETTh1、Traffic、Weather和Exchange數(shù)據(jù)集等基準(zhǔn)測試上優(yōu)于幾種現(xiàn)有方法,同時只需要很少的可訓(xùn)練參數(shù)。

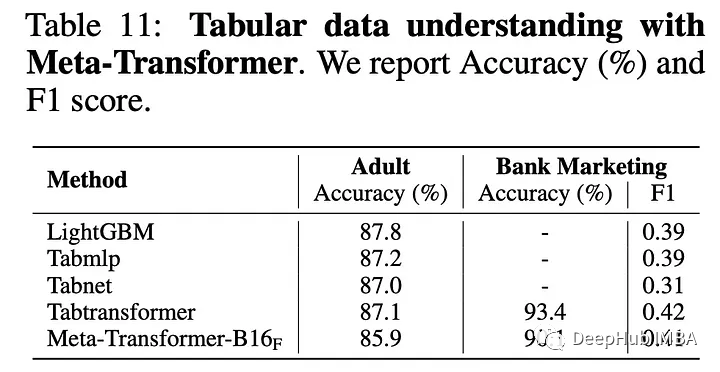

在表格數(shù)據(jù)理解任務(wù)中,Meta-Transformer在成人普查和銀行營銷數(shù)據(jù)集上表現(xiàn)出色。它在銀行營銷數(shù)據(jù)集上的表現(xiàn)優(yōu)于其他模型,這表明它在理解復(fù)雜數(shù)據(jù)集方面具有潛力。

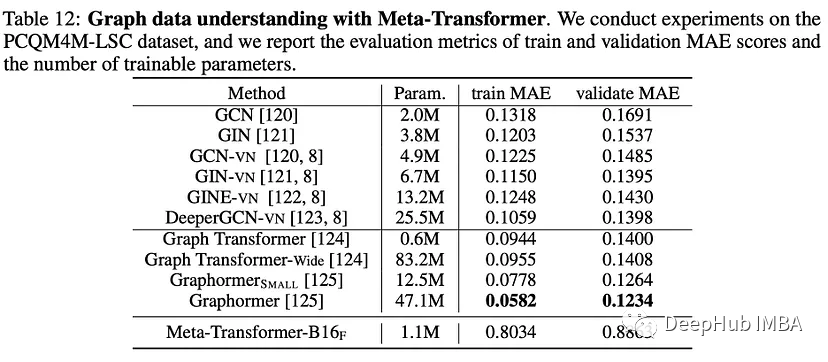

在PCQM4M-LSC數(shù)據(jù)集的圖理解任務(wù)中,當(dāng)前的Meta-Transformer架構(gòu)在結(jié)構(gòu)數(shù)據(jù)學(xué)習(xí)方面表現(xiàn)并不好,graphhormer模型的表現(xiàn)優(yōu)于它,這方面還要改進(jìn)。

在Ego4D數(shù)據(jù)集的分類任務(wù)中,Meta-Transformer的準(zhǔn)確率達(dá)到73.9%。總的來說,這些發(fā)現(xiàn)突出了Meta-Transformer在不同領(lǐng)域的多功能性和有效性。

上面有幾個結(jié)果都表明Meta-Transformer的參數(shù)少,模型效率更高,它的其中一個主要的限制是計算復(fù)雜度為O(n2x D)。