OCR-Omni來了!字節&華師提出統一的多模態生成模型TextHarmony

本文經AIGC Studio公眾號授權轉載,轉載請聯系出處。

在人工智能領域,賦予機器類人的圖像文字感知、理解、編輯和生成能力一直是研究熱點。目前,視覺文字領域的大模型研究主要聚焦于單模態生成任務。盡管這些模型在某些任務上實現了統一,但在 OCR 領域的多數任務上仍難以達成全面整合。

字節&華師提出統一的多模態生成模型TextHarmony:能夠熟練地理解和生成視覺文本

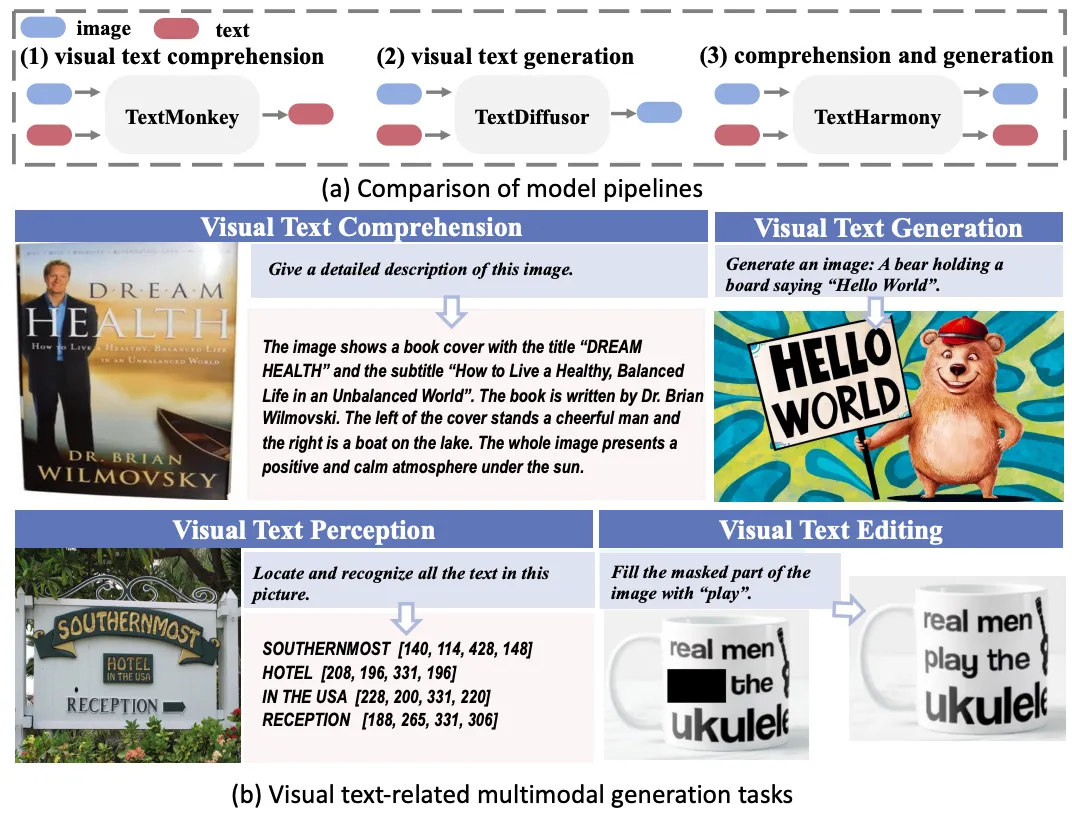

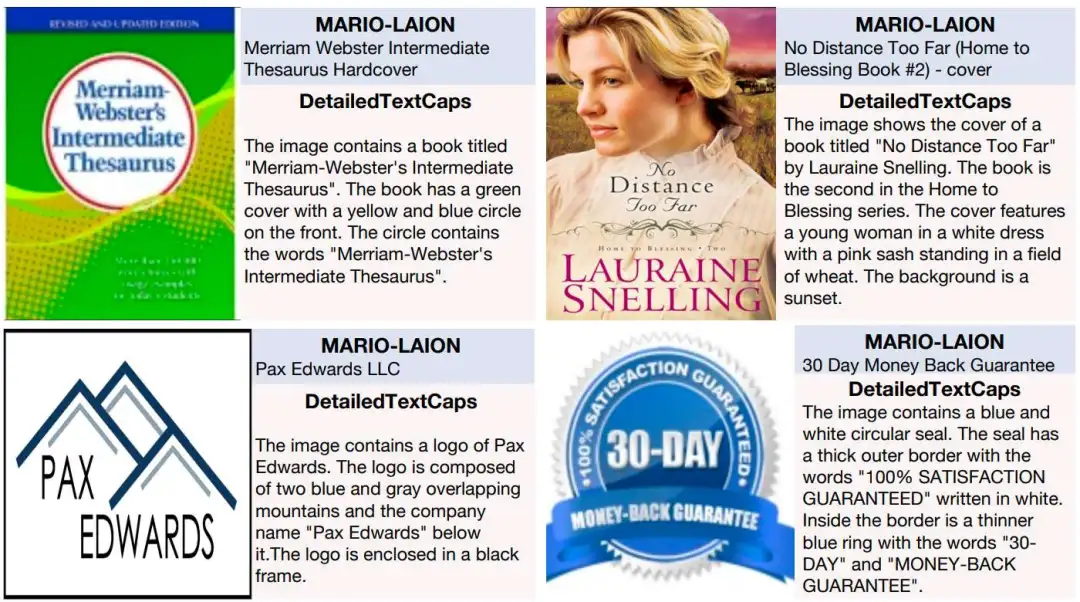

圖 (a) 說明了不同類型的圖像文本生成模型:視覺文本理解模型只能生成文本,視覺文本生成模型只能生成圖像,而 TextHarmony 可以生成文本和圖像。圖 (b) 說明了 TextHarmony 在為各種以文本為中心的任務生成不同模態方面的多功能性。

相關鏈接

論文鏈接: https://arxiv.org/abs/2407.16364

代碼開源: https://github.com/bytedance/TextHarmony

論文閱讀

摘要

在這項工作中,我們提出了 TextHarmony,這是一種統一且通用的多模態生成模型,能夠熟練地理解和生成視覺文本。由于視覺和語言模態之間固有的不一致,同時生成圖像和文本通常會導致性能下降。

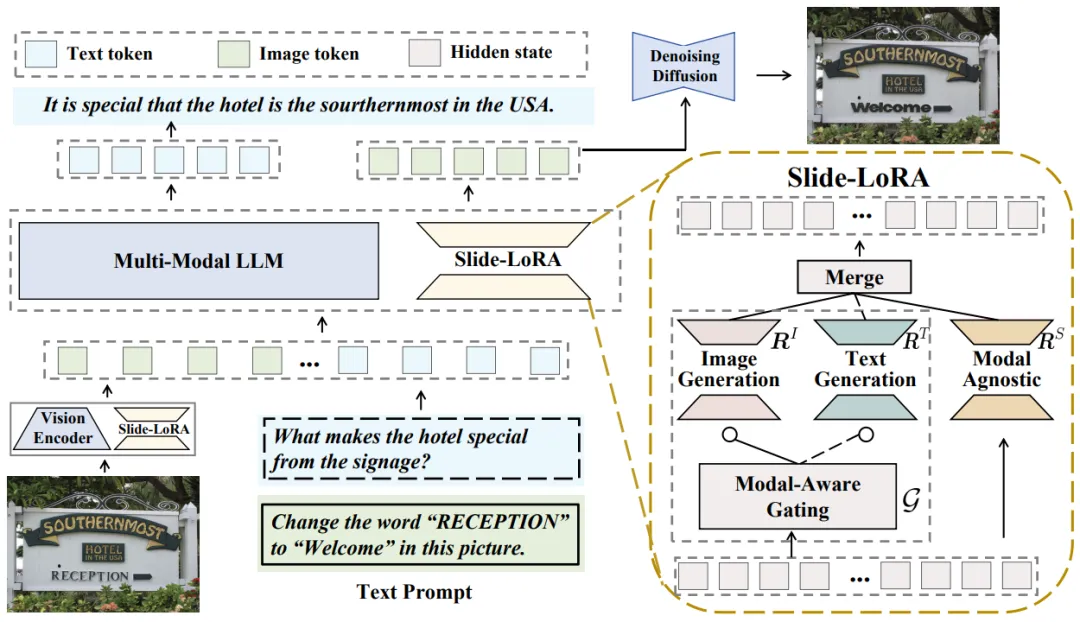

為了克服這一挑戰,現有方法依靠特定模態的數據進行監督微調,這需要不同的模型實例。我們提出了 Slide-LoRA,它動態地聚合了特定模態和模態無關的 LoRA 專家,部分解耦了多模態生成空間。Slide-LoRA 在單一模型實例中協調視覺和語言的生成,從而促進了更統一的生成過程。此外,我們開發了一個高質量的圖像標題數據集 DetailedTextCaps-100K,并與復雜的閉源 MLLM 合成,以進一步增強視覺文本生成能力。在各種基準上進行的全面實驗證明了所提出方法的有效性。

在 Slide-LoRA 的支持下,TextHarmony 僅增加了 2% 的參數,就實現了與特定模態微調結果相當的性能,并且在視覺文本理解任務中平均提高了 2.5%,在視覺文本生成任務中平均提高了 4.0%。我們的工作描述了在視覺文本領域內采用集成方法進行多模態生成的可行性,為后續研究奠定了基礎。

方法

TextHarmony 的管道。TextHarmony 通過連接視覺編碼器、LLM 和圖像解碼器來生成文本和視覺內容。提出的 Slide-LoRA 模塊通過部分分離參數空間來緩解多模式生成中的不一致問題。

TextHarmony 的管道。TextHarmony 通過連接視覺編碼器、LLM 和圖像解碼器來生成文本和視覺內容。提出的 Slide-LoRA 模塊通過部分分離參數空間來緩解多模式生成中的不一致問題。

實驗

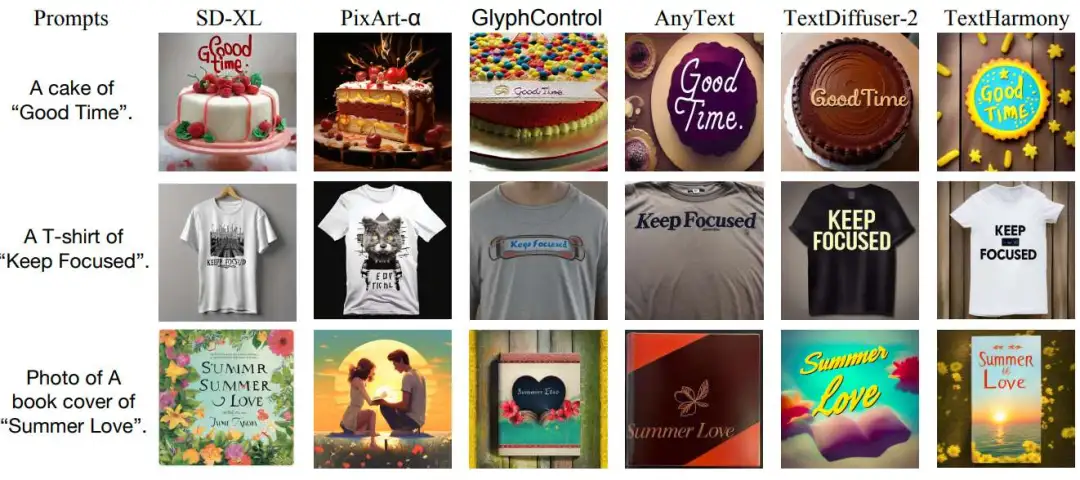

可視化文本生成結果。

可視化文本生成結果。

可視化文本編輯結果。

可視化文本編輯結果。

DetailedTextCaps-100K 的更多示例。

DetailedTextCaps-100K 的更多示例。

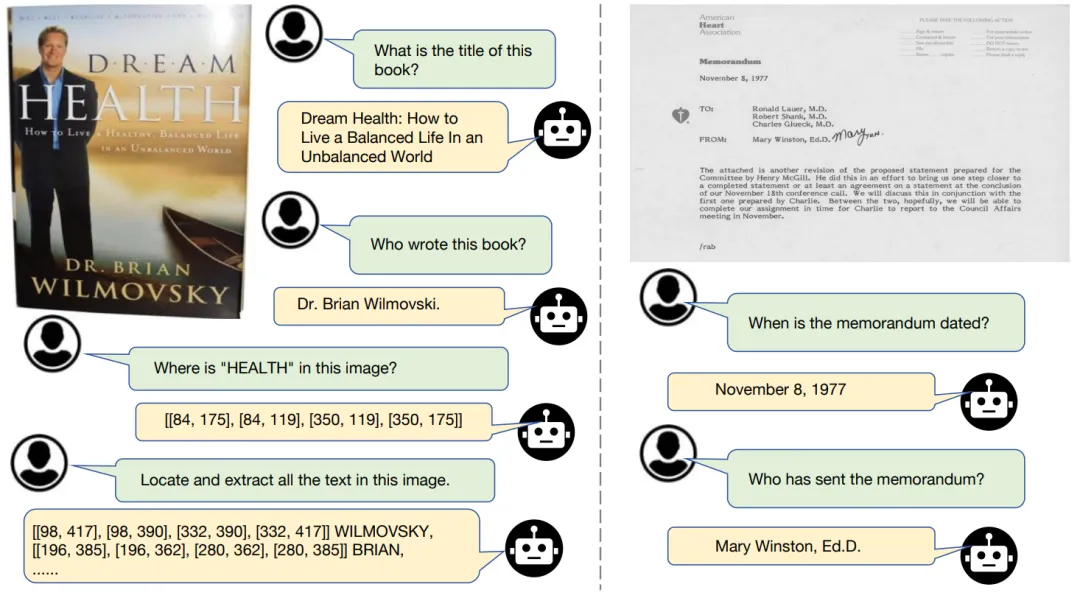

TextHarmony 視覺文本理解和感知能力的可視化。

TextHarmony 視覺文本理解和感知能力的可視化。

結論

TextHarmony是一種多功能多模態生成模型,擅長協調視覺文本理解和生成的不同任務。利用所提出的 Slide-LoRA 機制,TextHarmony 在單一模型實例中同步視覺和語言模態的生成過程,有效地解決了不同模態之間固有的不一致問題。該模型架構擅長執行涉及處理和生成圖像、蒙版、文本和布局的任務,特別是在光學字符識別 (OCR) 和文檔分析領域。TextHarmony 的成就預示著在視覺文本領域內綜合多模態生成模型的巨大潛力。TextHarmony 的適應性表明,類似性質的模型可以有效地應用于各種應用程序,為依賴視覺文本理解和生成復雜相互作用的行業帶來革命性的前景。