帶你穿越清明上河圖!DragNUWA驚艷亮相:一拖一拽讓靜圖秒變視頻

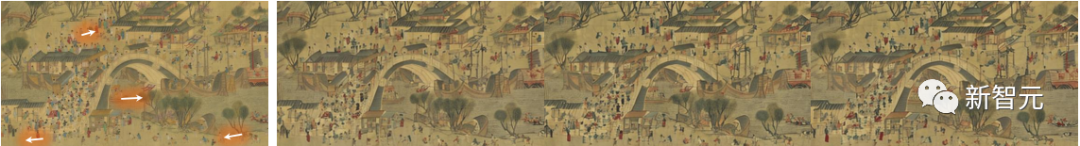

微軟開(kāi)發(fā)的視頻生成模型DragNUWA讓清明上河圖動(dòng)起來(lái)了!

只要用拖動(dòng)的方式給出運(yùn)動(dòng)軌跡,DragNUWA就能讓圖像中的物體對(duì)象按照該軌跡移動(dòng)位置并生成連貫的視頻。

DragNUWA能同時(shí)控制攝像機(jī)和多個(gè)對(duì)象的移動(dòng)以及復(fù)雜的軌跡,從而生成具有現(xiàn)實(shí)世界場(chǎng)景和藝術(shù)繪畫特色的視頻。

近年來(lái),可控視頻生成技術(shù)備受關(guān)注。但現(xiàn)有可控視頻生成仍存在兩大局限:

1. 現(xiàn)有的大多數(shù)工作都集中在文本、圖像或基于軌跡的控制上,導(dǎo)致無(wú)法在視頻中實(shí)現(xiàn)細(xì)粒度控制。

2. 軌跡控制的研究仍處于早期階段,大多數(shù)實(shí)驗(yàn)都是在Human3.6M等簡(jiǎn)單數(shù)據(jù)集上進(jìn)行的。這種局限性限制了模型處理開(kāi)域圖像和有效處理復(fù)雜曲線軌跡的能力。

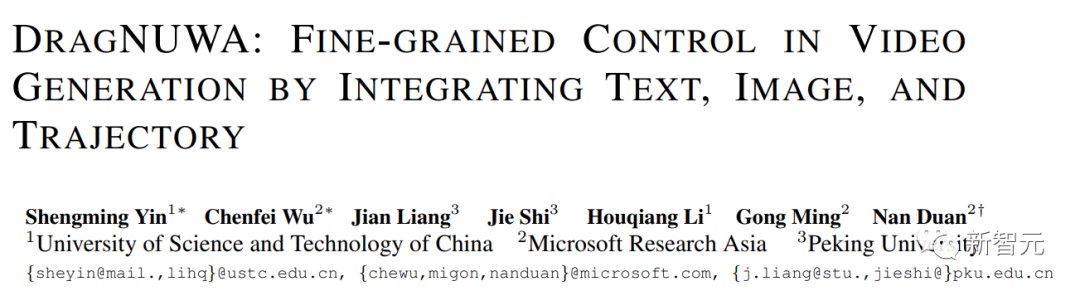

來(lái)自微軟的研究人員提出了基于開(kāi)域擴(kuò)散的視頻生成模型: DragNUWA。

論文地址:https://arxiv.org/abs/2308.08089

DragNUWA針對(duì)現(xiàn)有研究中控制粒度不足的問(wèn)題,同時(shí)引入了文本、圖像和軌跡信息,從語(yǔ)義、空間和時(shí)間角度對(duì)視頻內(nèi)容進(jìn)行精細(xì)控制。

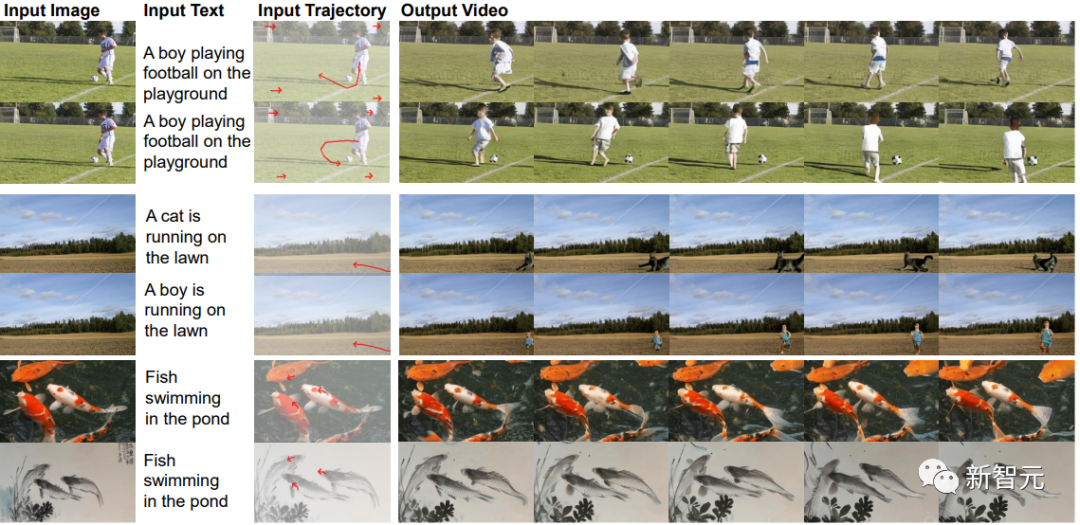

第一組展示了對(duì)復(fù)雜軌跡的控制,包括復(fù)雜運(yùn)動(dòng)(紅色彎曲箭頭和攝像機(jī)移動(dòng)(紅色向右箭頭)。

第二組展示了語(yǔ)言控制的影響,將不同的文字與相同的圖像和軌跡配對(duì),以達(dá)到在圖像中引入新對(duì)象的效果。

第三組展示了圖像控制的影響,展示了真實(shí)世界和藝術(shù)視頻的生成。

為了解決目前研究中開(kāi)域軌跡控制有限的問(wèn)題,研究人員從三個(gè)方面提出了軌跡建模:

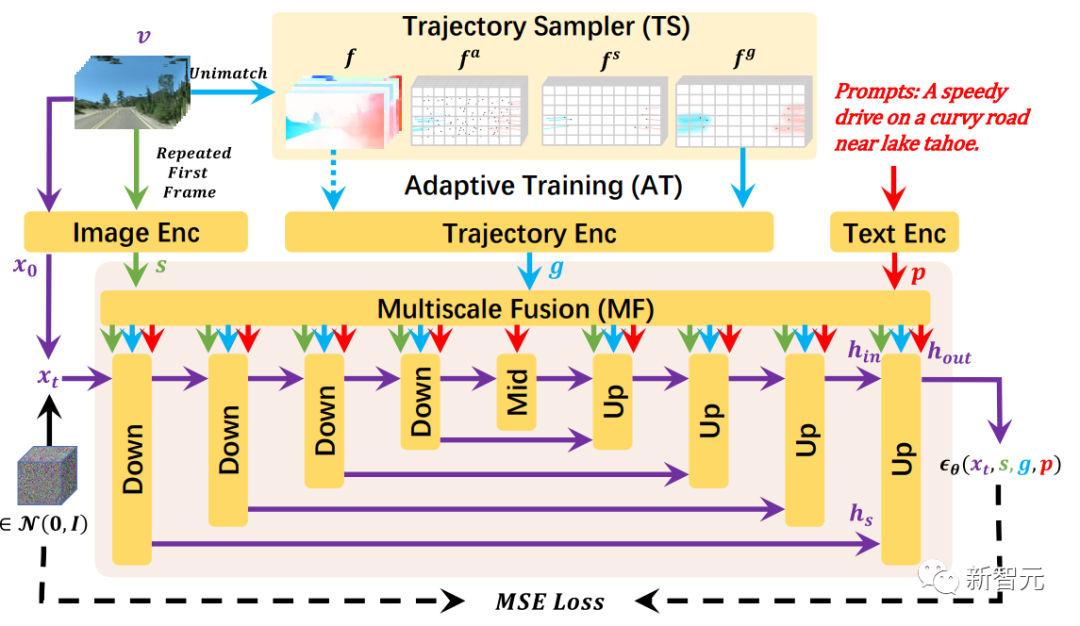

首先,通過(guò)軌跡采樣器(TS)實(shí)現(xiàn)對(duì)任意軌跡的開(kāi)域控制;其次,通過(guò)多尺度融合(MF)控制不同粒度的軌跡;最后,通過(guò)自適應(yīng)訓(xùn)練(AT)策略以根據(jù)軌跡生成一致的視頻。

工作原理

DragNUWA支持三種可選輸入:文本p、圖像s和軌跡g,并側(cè)重于從三個(gè)方面設(shè)計(jì)軌跡。

首先,軌跡采樣器(TS)從開(kāi)域視頻流中動(dòng)態(tài)采樣軌跡。

其次,多尺度融合(MF)將軌跡與文本和圖像深度融合到UNet 架構(gòu)的每個(gè)區(qū)塊中。

最后,自適應(yīng)訓(xùn)練(AT)可根據(jù)光流條件調(diào)整模型,使軌跡更友好。

最終,DragNUWA 能夠處理包含多個(gè)物體及其復(fù)雜軌跡的開(kāi)域視頻。

DragNUWA的訓(xùn)練過(guò)程概覽

為了驗(yàn)證軌跡控制的有效性,研究人員從攝像機(jī)移動(dòng)和復(fù)雜軌跡兩個(gè)方面對(duì)DragNUWA進(jìn)行了測(cè)試。

在視頻制作中,攝像機(jī)移動(dòng)在為觀眾創(chuàng)造動(dòng)態(tài)和引人入勝的視覺(jué)效果方面發(fā)揮著重要作用。

不同類型的鏡頭移動(dòng)有助于敘述故事或強(qiáng)調(diào)場(chǎng)景中的元素。常見(jiàn)的鏡頭移動(dòng)不僅包括水平和垂直移動(dòng),還包括放大和縮小。

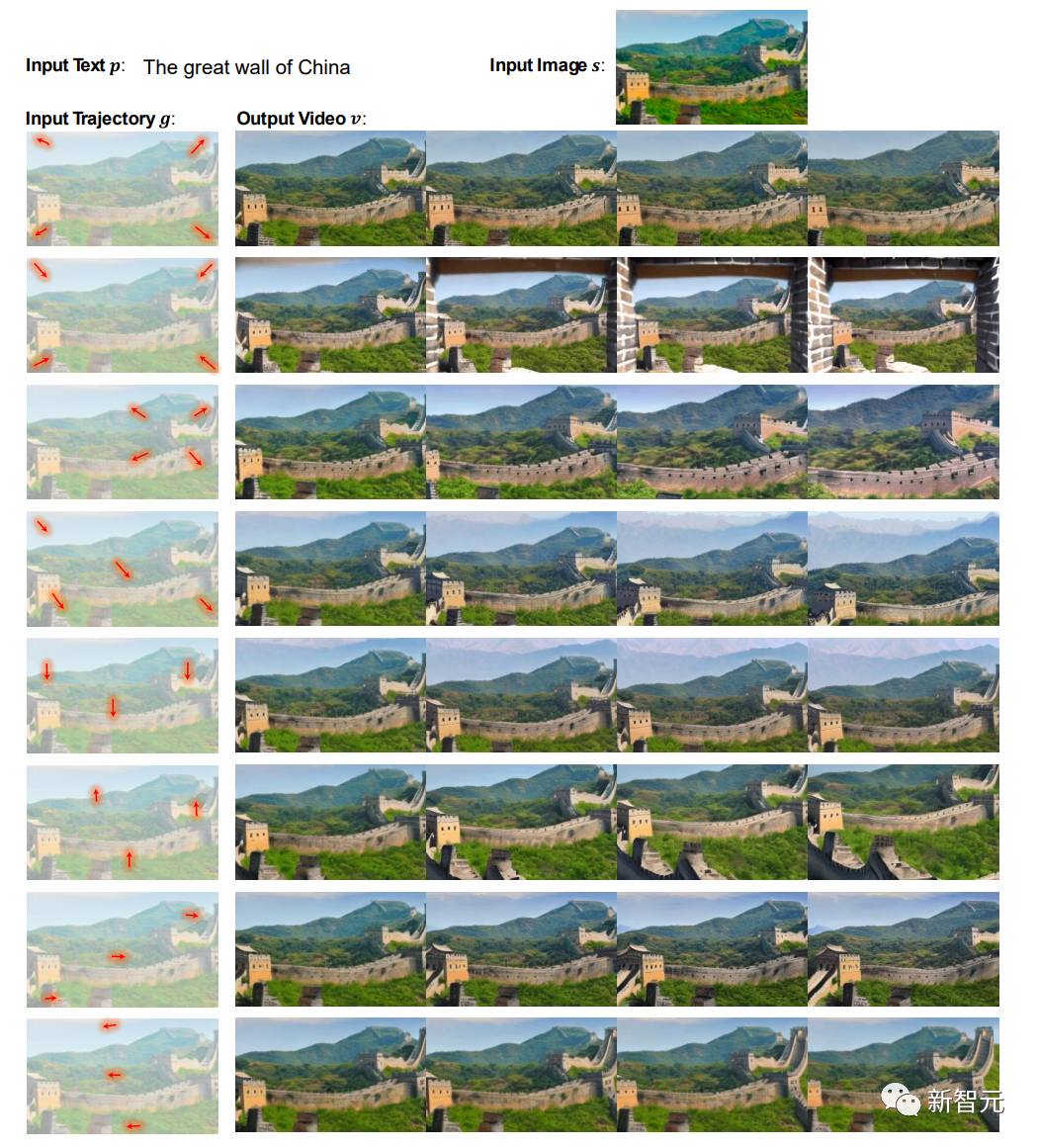

如下圖所示,DragNUWA雖然沒(méi)有明確對(duì)攝像機(jī)運(yùn)動(dòng)進(jìn)行建模,但它可以從開(kāi)放域軌跡建模中學(xué)習(xí)到各種攝像機(jī)運(yùn)動(dòng):

利用相同的文字和圖像,同時(shí)改變拖動(dòng)軌跡,可以實(shí)現(xiàn)各種攝像機(jī)移動(dòng)效果。例如,可通過(guò)在所需縮放位置繪制方向軌跡來(lái)表達(dá)放大和縮小效果。

視頻中的物體往往具有復(fù)雜的運(yùn)動(dòng)軌跡。面對(duì)多個(gè)運(yùn)動(dòng)物體、復(fù)雜的運(yùn)動(dòng)軌跡以及不同物體之間不同的運(yùn)動(dòng)幅度,視頻生成中的運(yùn)動(dòng)建模是一個(gè)巨大的挑戰(zhàn)。

研究人員通過(guò)使用相同的文字和圖片,同時(shí)改變拖動(dòng)軌跡,實(shí)現(xiàn)了各種復(fù)雜的軌跡效果。

這證明了DragNUWA具有復(fù)雜運(yùn)動(dòng)進(jìn)行精確建模的能力:支持復(fù)雜的曲線軌跡,允許軌跡長(zhǎng)度可變,并支持同時(shí)控制多個(gè)對(duì)象的軌跡。

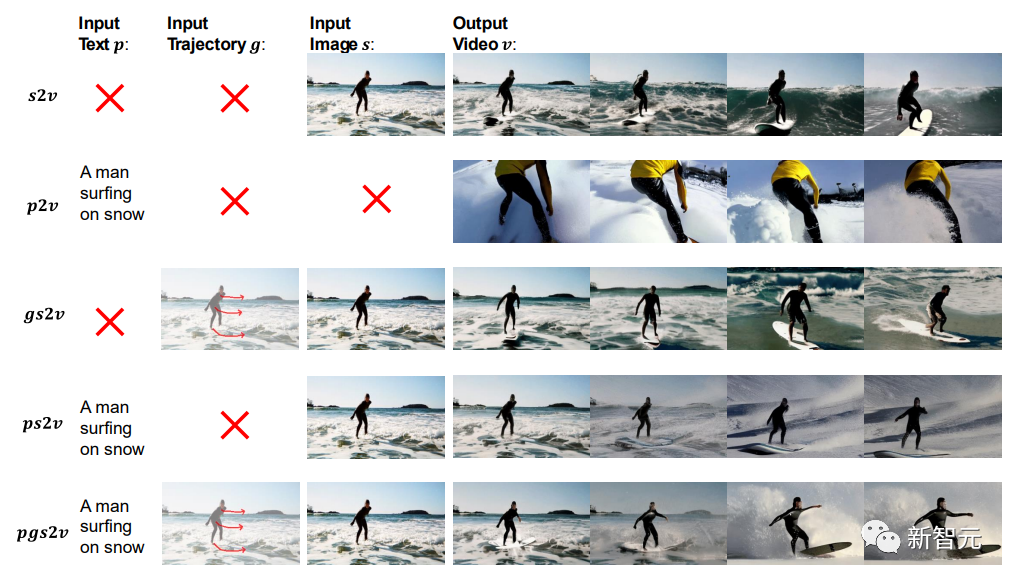

DragNUWA通過(guò)整合三個(gè)基本控制來(lái)實(shí)現(xiàn)精細(xì)視頻生成:文本、圖像和軌跡,分別對(duì)應(yīng)語(yǔ)義、空間和時(shí)間方面。

這三個(gè)條件是不可或缺的:

s2v和p2v說(shuō)明了圖像和文本控制作為單獨(dú)條件使用時(shí)的限制:

如s2v所示,雖然圖像本身提供了一些潛在的語(yǔ)義和動(dòng)力學(xué)信息,但它并不能實(shí)現(xiàn)對(duì)背景和角色運(yùn)動(dòng)的精確控制。

如p2v所示,當(dāng)只提供文本時(shí),模型能成功生成與文本相關(guān)的視頻,但外觀和動(dòng)態(tài)仍完全無(wú)法控制。

gs2v和ps2v強(qiáng)調(diào)了文本(p)和軌跡(g)的重要性。在沒(méi)有文本的情況下,無(wú)法確定模糊圖像 (s) 代表的是海上沖浪還是雪地沖浪。在沒(méi)有軌跡的情況下,模型會(huì)自動(dòng)假定人物正在向左移動(dòng)。

在三個(gè)基本條件都滿足時(shí),pgs2v中實(shí)現(xiàn)了在雪地上沖浪和向右移動(dòng)的控制。

數(shù)據(jù)集

在訓(xùn)練過(guò)程中,研究團(tuán)隊(duì)利用WebVid和VideoHD數(shù)據(jù)集來(lái)優(yōu)化 DragNU。

WAWebVid是一個(gè)龐大的數(shù)據(jù)集,由1000萬(wàn)個(gè)網(wǎng)絡(luò)視頻組成,涵蓋了現(xiàn)實(shí)世界中的各種場(chǎng)景,并配有相應(yīng)的標(biāo)題。其涵蓋了廣泛的運(yùn)動(dòng)模式,適用于基于軌跡的開(kāi)放域視頻生成。

VideoHD是研究團(tuán)隊(duì)基于網(wǎng)絡(luò)抓取的視頻建立的數(shù)據(jù)集。研究人員首先從互聯(lián)網(wǎng)上收集了75K高分辨率、高質(zhì)量的視頻片段。然后,使用BLIP2對(duì)這些片段進(jìn)行標(biāo)注。最后,手動(dòng)過(guò)濾掉了生成結(jié)果中的一些錯(cuò)誤。

作者簡(jiǎn)介

吳晨飛博士是微軟亞洲研究院的高級(jí)研究員。他的研究重心是大規(guī)模預(yù)訓(xùn)練、多模態(tài)理解和生成。主要研究工作包括多模態(tài)生成模型NUWA(女媧)系列(NUWA, NUWA-LIP, NUWA-Infinity, NUWA-3D, NUWA-XL)、多模態(tài)理解模型Bridge Tower(橋塔)系列(KD-VLP, Bridge-Tower)以及多模態(tài)對(duì)話系統(tǒng)Visual ChatGPT。在CVPR, NeurIPS, ACL, ECCV, AAAI, MM等會(huì)發(fā)表多篇論文。

段楠博士,微軟亞洲研究院資深首席研究員,自然語(yǔ)言計(jì)算團(tuán)隊(duì)研究經(jīng)理,中國(guó)科學(xué)技術(shù)大學(xué)、西安交通大學(xué)兼職博導(dǎo),天津大學(xué)兼職教授,主要從事自然語(yǔ)言處理、多模態(tài)基礎(chǔ)模型、代碼智能、機(jī)器推理等研究,多次擔(dān)任NLP/AI學(xué)術(shù)會(huì)議程序主席和領(lǐng)域主席,發(fā)表學(xué)術(shù)論文100余篇,Google Scholar引用10000余次,持有專利20余項(xiàng)。他被評(píng)為中國(guó)計(jì)算機(jī)協(xié)會(huì)(CCF)杰出會(huì)員、CCF-NLPCC青年科學(xué)家(2019年)、DeepTech中國(guó)智能計(jì)算科技創(chuàng)新人物(2022年)。