一文帶你解密 Large Language Model(大型語言模型)

在過去十年間,AI(人工智能)領(lǐng)域取得了令人矚目的突破,而其中的 NLP(自然語言處理)是其中一項(xiàng)重要的子領(lǐng)域。NLP 致力于開發(fā)各種技術(shù)和方法,用于處理和理解人類語言的文本數(shù)據(jù)。

NLP 的發(fā)展使得機(jī)器能夠更好地理解和處理人類語言,從而實(shí)現(xiàn)更加智能和自然的交互。這包括了諸如文本分類、情感分析、命名實(shí)體識(shí)別、機(jī)器翻譯、問答系統(tǒng)等多個(gè)任務(wù)和應(yīng)用領(lǐng)域。

NLP 技術(shù)的核心是建立起對語言的理解和表達(dá)的模型。LLM (大型語言模型)是其中一項(xiàng)關(guān)鍵技術(shù)。LLM 基于深度神經(jīng)網(wǎng)絡(luò)架構(gòu),通過學(xué)習(xí)大規(guī)模語料庫中的文本數(shù)據(jù),能夠捕捉到單詞、短語和句子之間的語義和語法規(guī)律。從而使得 LLM 能夠自動(dòng)生成連貫、自然的文本,增強(qiáng)了機(jī)器在處理自然語言任務(wù)時(shí)的表現(xiàn)。

隨著技術(shù)的不斷進(jìn)步,NLP 的應(yīng)用范圍也越來越廣泛。例如,在智能助手、智能客服、信息檢索、輿情分析、自動(dòng)摘要等領(lǐng)域都得到了廣泛應(yīng)用。然而,NLP 仍然面臨一些挑戰(zhàn),例如處理歧義、語義理解的準(zhǔn)確性、處理多語言和多模態(tài)數(shù)據(jù)等方面的問題。

一、什么是 Large Language Model ?

Language Model (語言模型)是一種統(tǒng)計(jì)模型,用于預(yù)測一系列單詞在文本序列中的概率。作為基于人工神經(jīng)網(wǎng)絡(luò)的一項(xiàng)重要人工智能技術(shù),Language Model 通過對大規(guī)模文本數(shù)據(jù)進(jìn)行訓(xùn)練,以理解語言并預(yù)測序列中的下一個(gè)單詞。 LLM (大型語言模型),后續(xù)簡稱為“LLM”,則是一種具備大量可調(diào)參數(shù)的神經(jīng)網(wǎng)絡(luò),使其能夠?qū)W習(xí)語言中的復(fù)雜模式和結(jié)構(gòu)。

通過訓(xùn)練大型語言模型,使得能夠?qū)W習(xí)到單詞之間的上下文關(guān)系、語法規(guī)則以及常見短語和句子結(jié)構(gòu),從而能夠根據(jù)指定的上下文生成連貫、自然的文本。

LLM ,也稱為預(yù)訓(xùn)練模型,是一種利用海量數(shù)據(jù)學(xué)習(xí)語言特征的人工智能工具。通過訓(xùn)練,這些模型能夠生成基于語言的數(shù)據(jù)集,可用于各種語言理解和生成任務(wù)。

其中一個(gè)重要特征是 LLM 能夠生成類似于人類文本的輸出。它們能夠生成連貫、符合語法規(guī)則的文本,有時(shí)甚至能夠表現(xiàn)出幽默感。此外,這些模型還具備將文本從一種語言翻譯成另一種語言的能力,并能夠根據(jù)給定的上下文回答問題。

LLM 的訓(xùn)練依賴于大量的文本數(shù)據(jù),其中包括互聯(lián)網(wǎng)上的網(wǎng)頁、書籍、新聞文章等。通過這些數(shù)據(jù)的學(xué)習(xí),模型能夠捕捉到語言中的各種模式和規(guī)律,從而提高對下一個(gè)單詞的預(yù)測準(zhǔn)確性。

LLM 的應(yīng)用非常廣泛,包括機(jī)器翻譯、文本生成、自動(dòng)摘要、對話系統(tǒng)等。例如,在機(jī)器翻譯任務(wù)中,模型可以根據(jù)源語言的上下文生成目標(biāo)語言的翻譯結(jié)果。在對話系統(tǒng)中,它可以根據(jù)用戶的輸入生成回應(yīng)。

二、領(lǐng)略 Large Language Model 全景觀

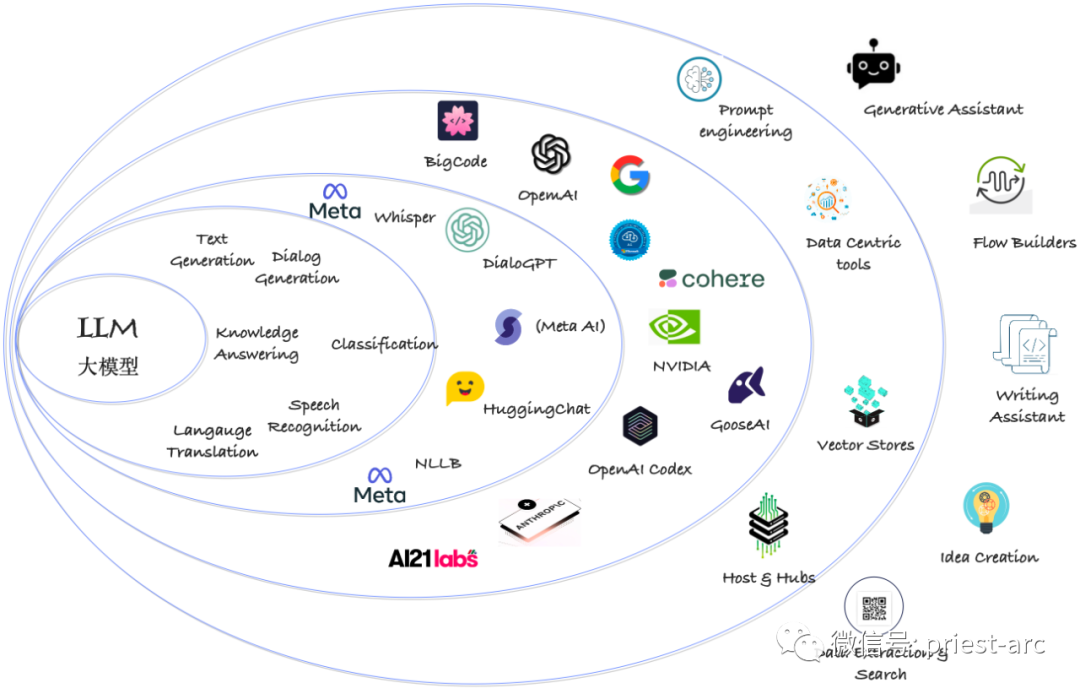

下圖顯示了 LLM (大型語言模型)的出現(xiàn)所衍射的漣漪效應(yīng),這個(gè)效應(yīng)可以在多個(gè)方面產(chǎn)生影響。具體而言,LLM 的出現(xiàn)可以被劃分為六個(gè)帶狀或區(qū)域,每個(gè)區(qū)域都代表著不同的需求和機(jī)會(huì)。

LLM (大型語言模型)全景觀鳥瞰

LLM (大型語言模型)全景觀鳥瞰

1、區(qū)域1—可用的大型語言模型

考慮到 LLM (大型語言模型)本質(zhì)上是針對語言處理任務(wù)的模型。然而,在處理圖像、音頻等多模態(tài)數(shù)據(jù)方面,引入了多模態(tài)模型或多模態(tài)方法。這種轉(zhuǎn)變使得我們需要一個(gè)更通用的術(shù)語來描述這些模型,即基礎(chǔ)模型。

基礎(chǔ)模型是指那些能夠處理多種類型數(shù)據(jù)(如文本、圖像、音頻等)的模型。它們集成了不同的組件和技術(shù),以便在多模態(tài)環(huán)境下進(jìn)行信息的融合和處理。這些基礎(chǔ)模型可以同時(shí)處理不同模態(tài)的輸入,并生成相應(yīng)的輸出結(jié)果。

除了引入多模態(tài)模型外,大型商業(yè)供應(yīng)商還提供了多個(gè)更加特定于任務(wù)的模型。這些模型針對特定的應(yīng)用場景和任務(wù)進(jìn)行了優(yōu)化和訓(xùn)練,以提供更高的性能和更準(zhǔn)確的結(jié)果。例如,針對圖像分類、語音識(shí)別、自然語言理解等任務(wù),商業(yè)供應(yīng)商提供了專門的模型,以滿足不同需求的客戶。

此外,還存在一系列開源模型可供使用。開源模型是由研究人員和開發(fā)者共享的模型,這些模型經(jīng)過訓(xùn)練并在特定任務(wù)上展現(xiàn)了良好的性能。這些開源模型可以作為起點(diǎn)或基礎(chǔ),為開發(fā)者提供一個(gè)快速開始的平臺(tái),同時(shí)也促進(jìn)了模型研究和知識(shí)的共享。

2、區(qū)域2—常見的應(yīng)用場景

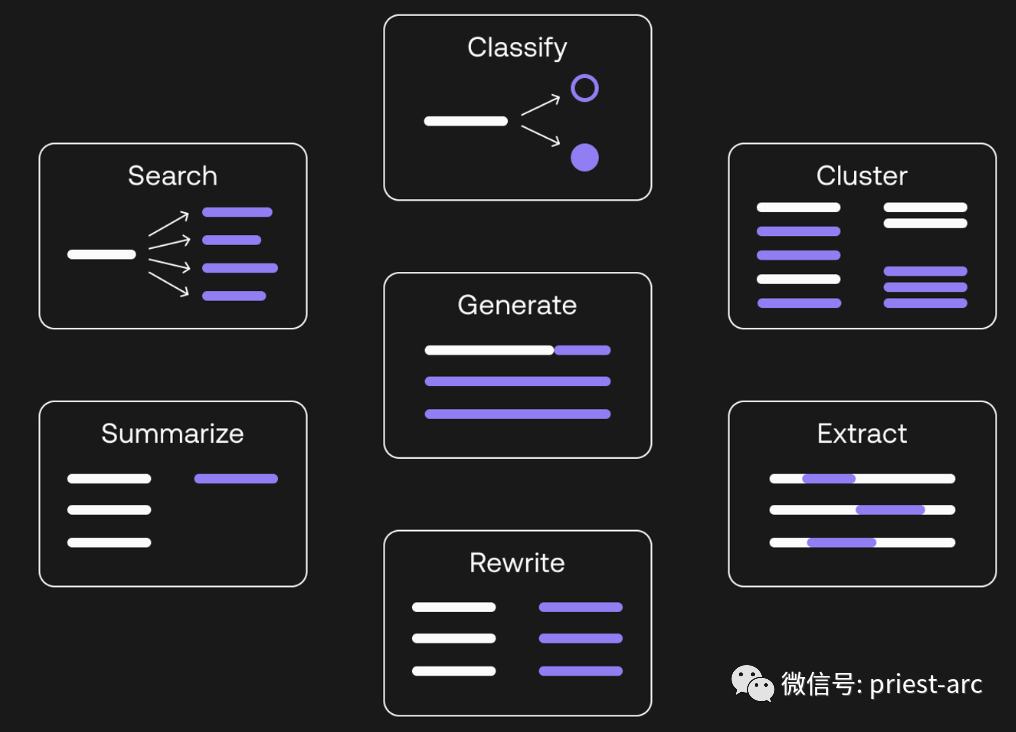

模型接受特定任務(wù)的訓(xùn)練,以提供更加專注和高效的解決方案。LLM 的最新發(fā)展采用了一種方法,即將這些特征結(jié)合在一起,允許模型使用不同的提示技術(shù)來提取出令人驚嘆的性能。

LLM 在文本生成任務(wù)方面表現(xiàn)出色,包括總結(jié)、重寫、關(guān)鍵字提取等任務(wù)。這些模型能夠生成準(zhǔn)確、連貫的文本,以滿足各種需求。

文本分析在當(dāng)前變得越來越重要,而將文本嵌入模型中對于實(shí)現(xiàn)這些任務(wù)至關(guān)重要。嵌入技術(shù)能夠?qū)⑽谋巨D(zhuǎn)換為向量表示,從而提供了更好的語義理解和語境感知能力。

另外,語音識(shí)別(ASR)也是 LLM 的關(guān)注領(lǐng)域之一,它是將音頻語音轉(zhuǎn)換為文本的過程。準(zhǔn)確性是評估任何 ASR 過程的重要指標(biāo),通常使用 Word 錯(cuò)誤率(WER)來衡量。ASR 技術(shù)為 LLM 培訓(xùn)和使用提供了大量記錄的語言數(shù)據(jù),使得文本轉(zhuǎn)換和分析更為便捷和高效。

3、區(qū)域3—具體基礎(chǔ)實(shí)施

此區(qū)域列出了一些特定用途的模型。實(shí)現(xiàn)已分為通用、強(qiáng)大的 LLM 和基于 LLM 的數(shù)字/個(gè)人助理,如 ChatGPT、HuggingChat 和 Cohere Coral。這些特定用途的模型為各行各業(yè)提供了定制化的解決方案,使得語言處理和法律應(yīng)用更加高效和精確。無論是通用模型還是專門針對法律領(lǐng)域的模型,它們都在不同領(lǐng)域中扮演著重要的角色,為用戶提供了更好的語言理解和問題解決能力。

4、區(qū)域4—模型分類

此區(qū)域列出了最著名的大型語言模型供應(yīng)商。大多數(shù) LLM 擁有內(nèi)置的知識(shí)和功能,包括人類語言翻譯、口譯和編寫代碼的能力、通過快速工程進(jìn)行對話和上下文管理。供應(yīng)商提供的 LLM 能夠滿足不同用戶的需求,從跨語言溝通到代碼編寫,從對話系統(tǒng)到上下文管理,為用戶提供了強(qiáng)大的語言處理和智能化服務(wù)。這些大型語言模型的發(fā)展受益于深度學(xué)習(xí)和自然語言處理的進(jìn)步,為人們提供了更多創(chuàng)新和便捷的工具。

5、區(qū)域5—基礎(chǔ)工具/平臺(tái)

此區(qū)域中提出的概念是以數(shù)據(jù)為中心的工具,這些工具專注于使 LLM (大型語言模型)的使用變得可重復(fù)且具有高價(jià)值。這意味著關(guān)注點(diǎn)放在如何有效地利用數(shù)據(jù)來提升 LLM 的性能和應(yīng)用價(jià)值上。

6、區(qū)域6—終端用戶

此區(qū)域中涌現(xiàn)了大量專注于流程構(gòu)建、創(chuàng)意生成、內(nèi)容創(chuàng)作和寫作輔助的應(yīng)用程序。這些產(chǎn)品致力于提供優(yōu)質(zhì)的用戶體驗(yàn),并在 LLM(大型語言模型)和用戶之間增加不同程度的價(jià)值。通過這些應(yīng)用程序,用戶能夠更好地利用 LLM 的潛力,實(shí)現(xiàn)更加出色和有影響力的工作和創(chuàng)作。

三、Large Language Model 是如何工作的呢?

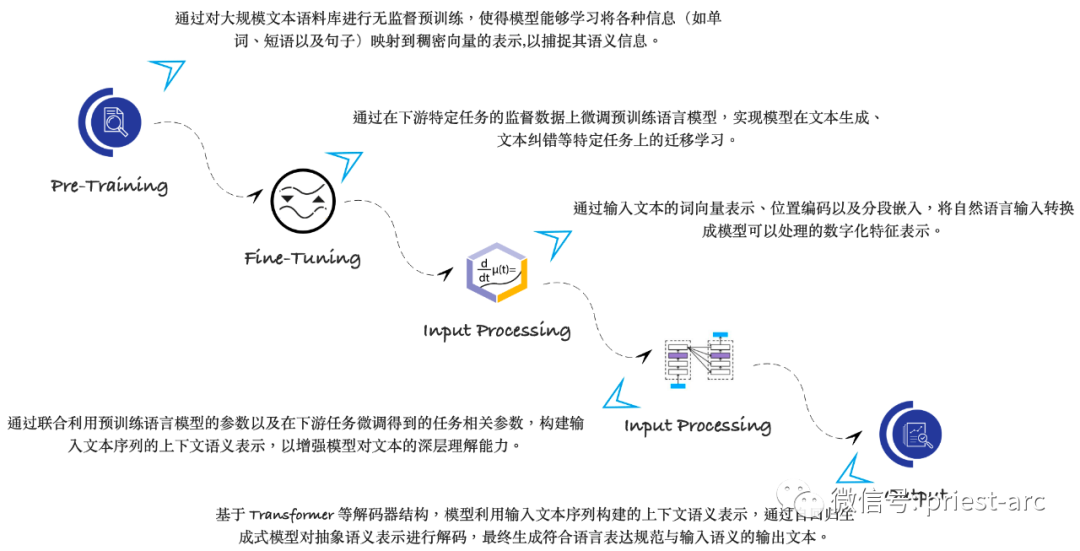

LLM 通過使用一種稱為無監(jiān)督學(xué)習(xí)的技術(shù)來進(jìn)行工作。在無監(jiān)督學(xué)習(xí)中,該模型在大量數(shù)據(jù)上進(jìn)行訓(xùn)練,沒有特定的標(biāo)簽或目標(biāo)。其目標(biāo)是學(xué)習(xí)數(shù)據(jù)的基本結(jié)構(gòu),并生成與原始數(shù)據(jù)結(jié)構(gòu)相似的新數(shù)據(jù)。

對于 LLM 而言,訓(xùn)練數(shù)據(jù)通常是大規(guī)模的文本語料庫。模型學(xué)習(xí)文本數(shù)據(jù)中的模式,并利用這些模式生成新的文本。訓(xùn)練過程涉及優(yōu)化模型參數(shù),以盡可能減少生成的文本與語料庫中實(shí)際文本之間的差異。

一旦模型經(jīng)過訓(xùn)練,就可以用于生成新的文本。為此,該模型被賦予一個(gè)起始單詞序列,并根據(jù)訓(xùn)練語料庫中單詞的概率來生成序列中的下一個(gè)單詞。重復(fù)這個(gè)過程,直到生成所需長度的文本。

這里,我們簡單了解一下 LLM 工作原理機(jī)制,具體可參考如下示意圖所示:

了解 LLM 的工作原理,以及了解可用的不同類型的語言模型是很重要的。最常見的語言模型類型包括循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)、卷積神經(jīng)網(wǎng)絡(luò)(CNN)和長短期記憶網(wǎng)絡(luò)(LSTM)。這些模型通常在大型數(shù)據(jù)集(如Penn Treebank)上進(jìn)行訓(xùn)練,并可用于生成基于語言的數(shù)據(jù)集。

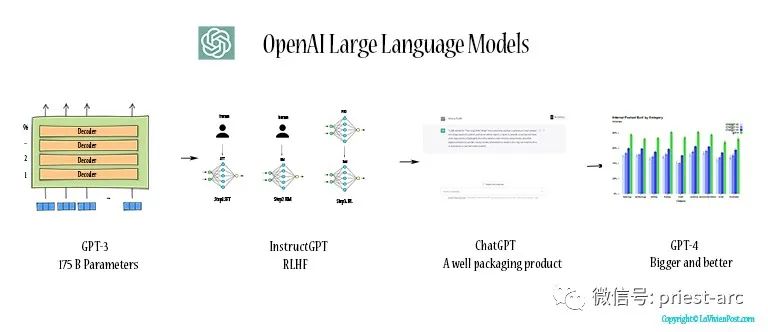

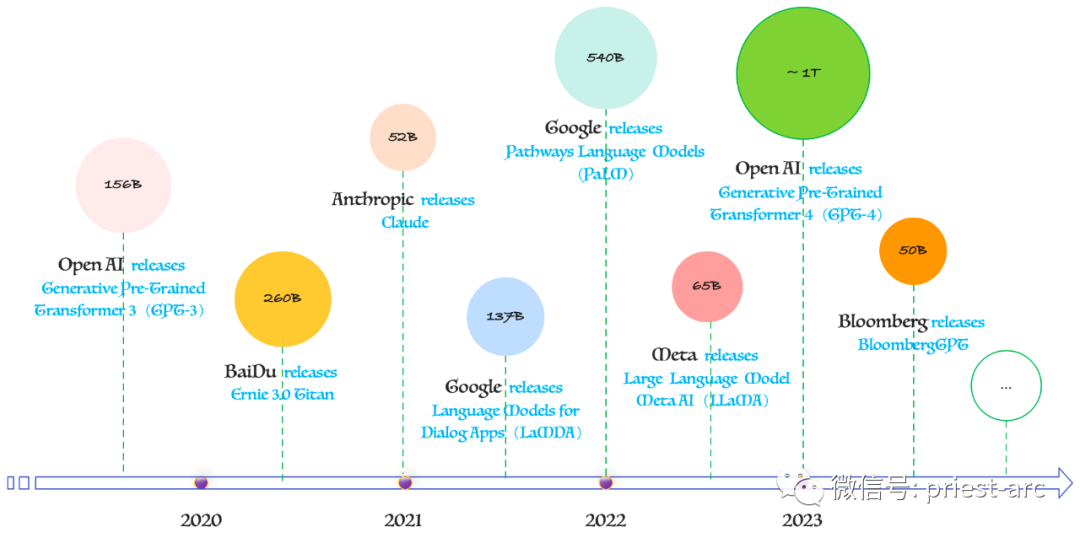

接下來,讓我們深入了解一些領(lǐng)先的 LLLM(大型語言模型),它們的創(chuàng)建者以及它們所訓(xùn)練的參數(shù)數(shù)量。這些模型代表了人工智能領(lǐng)域最前沿的技術(shù)發(fā)展。具體可參考如下示意圖所示:

基于上述模型參數(shù)圖,我們可以看到,現(xiàn)在有許多備受歡迎的 LLM(大型語言模型),具體如下:

OpenAI 是一家在 LLLM 領(lǐng)域具有重要地位的公司。他們的 ChatGPT 模型經(jīng)過了廣泛的研究和訓(xùn)練,是一種基于生成預(yù)訓(xùn)練變壓器模型(GPT)的強(qiáng)大語言模型。雖然具體的參數(shù)數(shù)量尚未披露,但根據(jù)之前的版本,可以合理地推測 ChatGPT 可能具有數(shù)百億到數(shù)千億的參數(shù)。

谷歌也在大型語言模型的研究和開發(fā)方面投入了大量資源。他們的 LaMDA 和 PaLM 模型分別具有數(shù)百億的參數(shù)量,這些模型通過在大規(guī)模數(shù)據(jù)集上進(jìn)行訓(xùn)練,展現(xiàn)了出色的語言理解和生成能力。同時(shí),谷歌還投資了 Anthropic 公司,該公司發(fā)布了具有數(shù)百億參數(shù)的 Claude 模型。

百度的 Ernie 3.0 Titan 模型是為其 ErnieBot 聊天機(jī)器人提供支持,擁有數(shù)千億的參數(shù)數(shù)量。以及中國的人工智能公司 SenseTime 開發(fā)了 SenseNova 模型,用于為其 SenseChat 聊天機(jī)器人和其他服務(wù)提供支持,該模型也具有數(shù)千億的參數(shù)。

此外,Bloomberg 公司建立了一個(gè)金融領(lǐng)域特定的模型,名為 BloombergGPT,它具有數(shù)百億的參數(shù),為金融相關(guān)任務(wù)提供強(qiáng)大的語言處理能力。

雖然上面沒有明顯標(biāo)注微軟公司,其實(shí),微軟也在 LLLM 領(lǐng)域也有著同樣重要的貢獻(xiàn),他們推出了 Bing AI搜 索所使用的 GPT 模型。該模型的參數(shù)數(shù)量可能與其他頂尖模型相當(dāng)。

這些領(lǐng)先的大型語言模型,通過龐大的參數(shù)量,使得它們能夠更好地理解和生成自然語言。它們代表了人工智能領(lǐng)域的最新成果,并在各個(gè)領(lǐng)域展現(xiàn)出巨大的潛力和應(yīng)用前景。

四、Large Language Model 應(yīng)用場景

近年來,由于大型數(shù)據(jù)集的可用性和 AI(人工智能)技術(shù)的進(jìn)步,大型語言模型的應(yīng)用顯著增加。隨著人工智能技術(shù)的不斷改進(jìn),大型語言模型的準(zhǔn)確性和能力也將不斷提高,使其在各種自然語言處理任務(wù)中變得更加有用。

通常情況下,大型語言模型在各個(gè)領(lǐng)域都有廣泛的應(yīng)用。它們可以應(yīng)用于自然語言處理、人工智能和數(shù)據(jù)科學(xué)等領(lǐng)域,為許多應(yīng)用程序提供強(qiáng)大的支持和功能。以下是一些典型的應(yīng)用領(lǐng)域和示例:

1、語言翻譯

語言翻譯是 LLM 的重要應(yīng)用之一。LLM 能夠快速將單詞從一種語言翻譯成另一種語言。它通過比較兩種語言,并試圖通過所謂的平行語料庫逐句進(jìn)行翻譯。LLM 使用兩種主要的翻譯技術(shù):直接翻譯和編碼器解碼器翻譯。

這兩種技術(shù)都利用深度學(xué)習(xí)方法來實(shí)現(xiàn)高質(zhì)量的翻譯。這些翻譯技術(shù)都依賴于深度學(xué)習(xí)方法,通過大規(guī)模訓(xùn)練數(shù)據(jù)和神經(jīng)網(wǎng)絡(luò)的學(xué)習(xí)能力,LLM 能夠?qū)崿F(xiàn)準(zhǔn)確和流暢的語言翻譯。隨著技術(shù)的不斷發(fā)展,LLM 在語言翻譯領(lǐng)域的應(yīng)用將進(jìn)一步提升翻譯質(zhì)量和效率,促進(jìn)跨語言交流和文化交流的便利性。

2、內(nèi)容生成

內(nèi)容生成是 LLM 的另一個(gè)重要應(yīng)用領(lǐng)域。LLM 生成的輸出可以用于產(chǎn)品的文本內(nèi)容創(chuàng)作。它可以生成各種類型的文本,例如文章、產(chǎn)品描述、小冊子和其他書面內(nèi)容。在這方面,ChatGPT 是一個(gè)非常強(qiáng)大的工具,它能夠生成高質(zhì)量的文本內(nèi)容,幾乎無法與人類創(chuàng)作的內(nèi)容區(qū)分開來。因此,如果您需要為用戶編寫內(nèi)容,考慮使用 LLM 和 ChatGPT 將會(huì)是一個(gè)理想的選擇。

需要注意的是,雖然 LLM 和 ChatGPT 在內(nèi)容創(chuàng)作方面具有很大的潛力,但仍然需要人工進(jìn)行審核和編輯。由于模型的自動(dòng)化性質(zhì),它可能會(huì)生成不準(zhǔn)確或有誤導(dǎo)性的信息。因此,在使用 LLM 生成的內(nèi)容之前,仍然需要人工的審查和修改,以確保內(nèi)容的準(zhǔn)確性和合適性。

3、聊天機(jī)器人及客戶支持

聊天機(jī)器人是 LLM 的一個(gè)主要應(yīng)用領(lǐng)域。LLM 被廣泛應(yīng)用于構(gòu)建聊天機(jī)器人,其中,ChatGPT 是一種常用的工具。許多公司已經(jīng)將 ChatGPT 作為客戶支持聊天機(jī)器人的一部分,通過提供準(zhǔn)確的回答來為客戶提供最佳的服務(wù)體驗(yàn)。隨著技術(shù)的發(fā)展,許多技術(shù)領(lǐng)導(dǎo)者正在考慮如何開發(fā)自己的語言模型,通過提供相關(guān)的內(nèi)部數(shù)據(jù)來滿足他們獨(dú)特的業(yè)務(wù)需求。

通過利用內(nèi)部數(shù)據(jù)和業(yè)務(wù)特定的培訓(xùn),企業(yè)可以創(chuàng)建定制化的聊天機(jī)器人,更好地適應(yīng)自己的業(yè)務(wù)場景和客戶需求。

4、情緒分析及輿情監(jiān)測

情緒分析是 LLM 的另一個(gè)重要應(yīng)用。這些模型可以用于分析文本的情緒,幫助確定文本是否具有積極或消極情緒。情緒分析在許多領(lǐng)域具有廣泛的應(yīng)用,包括社交媒體監(jiān)測、品牌聲譽(yù)管理、市場調(diào)研等。

LLM 在情緒分析領(lǐng)域具有廣泛的應(yīng)用前景。通過自動(dòng)化情緒分析,可以幫助企業(yè)和組織更好地理解用戶的情感態(tài)度,從而進(jìn)行更有針對性的決策和改進(jìn)。然而,仍需注意模型的局限性,并結(jié)合人工的審查和判斷,以確保情緒分析結(jié)果的準(zhǔn)確性和可靠性。

5、個(gè)性化推薦及廣告

個(gè)性化推薦和廣告是 LLM 的另一個(gè)重要應(yīng)用領(lǐng)域。這些模型可以基于用戶的興趣和行為模式,提供個(gè)性化的推薦和廣告內(nèi)容。通過深入理解用戶的需求和偏好,LLM 能夠提供更加精準(zhǔn)和定制化的推薦體驗(yàn),從而提升用戶滿意度和廣告效果。

五、Large Language Model 當(dāng)前面臨的挑戰(zhàn)

LLM(大型語言模型)在自然語言處理領(lǐng)域取得了重大的突破,但也面臨一些挑戰(zhàn)。以下是一些普遍認(rèn)為的 LLM 面臨的挑戰(zhàn):

1、訓(xùn)練成本和資源需求

通常而言,LLM 需要龐大的訓(xùn)練數(shù)據(jù)和計(jì)算資源來進(jìn)行訓(xùn)練。這樣的訓(xùn)練過程需要大量的時(shí)間、存儲(chǔ)和計(jì)算能力,以及海量的標(biāo)記數(shù)據(jù)。因此,構(gòu)建和訓(xùn)練 LLM 需要巨大的投入。

2、數(shù)據(jù)偏見和模型傾向性

LLM 會(huì)模仿其訓(xùn)練數(shù)據(jù)中的模式和偏見。如果訓(xùn)練數(shù)據(jù)存在偏見,例如,性別或種族偏見,模型可能會(huì)反映這些偏見,并在生成的文本中表現(xiàn)出來。這可能導(dǎo)致模型產(chǎn)生不公平或有害的結(jié)果。解決這個(gè)問題需要更加平衡和多樣化的訓(xùn)練數(shù)據(jù),以及對模型進(jìn)行有效的偏見檢測和修正。

3、知識(shí)和推理的不足

盡管 LLM 在語言生成和理解方面取得了顯著進(jìn)展,但它們?nèi)匀淮嬖趯τ谡鎸?shí)世界知識(shí)和推理的不足。這使得模型在處理復(fù)雜的現(xiàn)實(shí)場景、邏輯推理和常識(shí)推理時(shí)表現(xiàn)不佳。解決這個(gè)問題需要進(jìn)一步將外部知識(shí)和推理能力融入到模型中,以提高其真實(shí)世界的應(yīng)用能力。

4、解釋性和可控性

LLM 通常被認(rèn)為是黑盒模型,難以解釋其決策和生成文本的依據(jù)。這對于某些應(yīng)用場景來說是一個(gè)挑戰(zhàn),例如在法律、醫(yī)學(xué)等領(lǐng)域需要透明和可解釋的決策。因此,提高模型的解釋性和可控性是一個(gè)重要的方向。

5、虛假信息和濫用

LLM 可以被用于生成虛假信息、惡意攻擊和濫用行為。它們可以被誤用為網(wǎng)絡(luò)欺詐、網(wǎng)絡(luò)釣魚和虛假新聞等活動(dòng)。因此,確保模型的安全性和防范濫用的能力是一個(gè)重要的挑戰(zhàn)。

盡管,以上是 LLM 所面臨的一些挑戰(zhàn),然而,隨著技術(shù)的不斷演進(jìn),研究人員和開發(fā)者們正在努力解決這些問題,以提高模型的性能、可靠性和可用性。