腦電合成自然語音!LeCun轉發Nature子刊新成果,代碼開源

腦機接口最新進展登上Nature子刊,深度學習三巨頭之一的LeCun都來轉發。

這次是用神經信號進行語音合成,幫助因神經系統缺陷導致失語的人群重新獲得交流的能力。

具體來說,來自紐約大學的研究團隊開發了一個新型的可微分語音合成器,可以利用一個輕型的卷積神經網絡將語音編碼為一系列可解釋的語音參數(如音高,響度,共振峰頻率等),并通過可微分語音合成器重新合成語音。

通過將神經信號映射到這些語音參數,研究者構建了一個高度可解釋且可應用于小數據量情形的神經語音解碼系統,可生成聽起來自然的語音。

研究人員共收集了48位受試者的數據并嘗試進行語音解碼,對未來的高準確度的腦機接口應用提供了驗證。

結果表明,該框架能夠處理高低不同空間采樣密度,并且可以處理左、右半球的腦電信號,顯示出了強大的語音解碼潛力。

神經信號的語音解碼,難!

此前,馬斯克的Neuralink公司已經在一位受試者腦內成功植入電極,可以完成簡單的光標操控以實現打字等功能。

然而,神經-語音解碼通常被認為復雜度更高。

開發神經-語音解碼器和其他的高精度腦機接口模型的嘗試大多數依賴于一種特殊的數據:皮層電圖(ECoG)記錄的受試者數據,通常是從癲癇病人的治療過程中收集。

利用患有癲癇的患者植入的電極,在發音時收集大腦皮層數據,這些數據具有高時空分辨率,已經在語音解碼領域幫助研究者獲得了一系列很顯著的成果。

不過,神經信號的語音解碼還面臨著兩大挑戰。

- 用于訓練個性化神經到語音解碼模型的數據在時間上是非常有限的,通常只有十分鐘左右,而深度學習模型往往需要大量的訓練數據來驅動。

- 人類的發音非常多樣,哪怕是同一個人重復說出相同的單詞,語速、語調和音調等也會有變化,這給模型構建的表征空間增加了復雜性。

早期的解碼神經信號到語音的嘗試主要依賴于線性模型,模型通常不需要龐大的訓練數據集,可解釋性強,但是準確率很低。

近期的基于深度神經網絡,尤其是利用卷積和循環神經網絡架構,在模擬語音的中間潛在表示和合成后語音質量兩個關鍵維度上進行了很多的嘗試。例如,有研究將大腦皮層活動解碼成口型運動空間,然后再轉化為語音,雖然解碼性能強大,但重建的聲音聽起來不自然。

另一方面,一些方法通過利用wavenet聲碼器、生成對抗網絡(GAN)等,雖然成功重建了自然聽感的語音,但準確度有限。

最近一項發表在Nature的研究,在一個植入了設備的患者身上,通過使用量化的HuBERT特征作為中間表示空間和預訓練的語音合成器將這些特征轉換成語音,實現了既準確又自然的語音波形。

然而,HuBERT特征不能表示發音者特有的聲學信息,只能生成固定統一的發音者聲音,因此需要額外的模型將這種通用聲音轉換為特定患者的聲音。此外,這項研究和大多數先前的嘗試采用了非因果(non-causal)架構,這可能限制其在需要時序因果(causal)操作的腦機接口實際應用中的使用。

構建可微分語音合成器

紐約大學Video Lab和Flinker Lab的研究團隊介紹了一個新型的從腦電(ECoG)信號到語音的解碼框架,構建了一個低維度的中間表示(low dimension latent representation),該表示通過僅使用語音信號的語音編解碼模型生成。

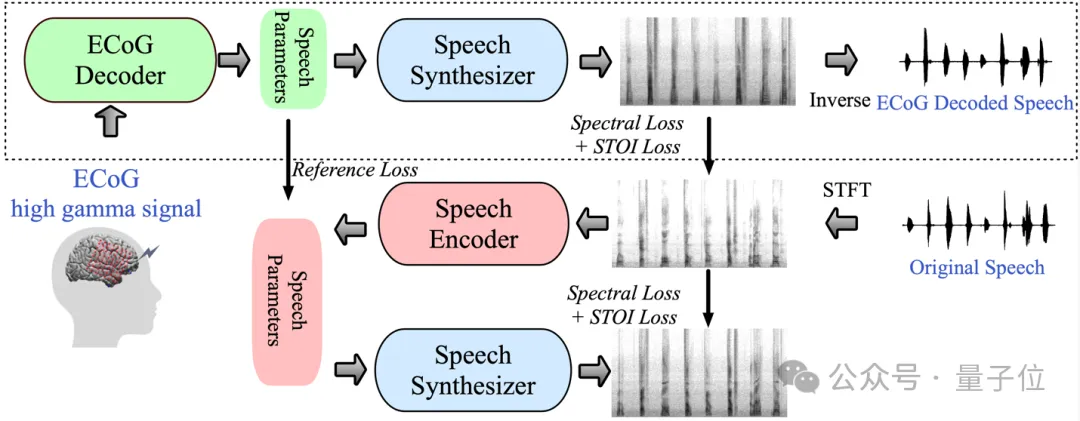

△神經語音解碼框架

具體來說,框架由兩部分組成:

一部分是ECoG解碼器,它能將ECoG信號轉化為我們可以理解的聲學語音參數(比如音高、是否發聲、響度、以及共振峰頻率等);

另一部分是語音合成器,它將這些語音參數轉化為頻譜圖。

研究人員構建了一個可微分語音合成器,這使得在訓練ECoG解碼器的過程中,語音合成器也可以參與訓練,共同優化以減少頻譜圖重建的誤差。

這個低維度的潛在空間具有很強的可解釋性,加上輕量級的預訓練語音編碼器生成參考用的語音參數,幫助研究者構建了一個高效的神經語音解碼框架,克服了神經語音解碼領域數據非常稀缺的問題。

該框架能產生非常接近說話人自己聲音的自然語音,并且ECoG解碼器部分可以插入不同的深度學習模型架構,也支持因果操作(causal operations)。

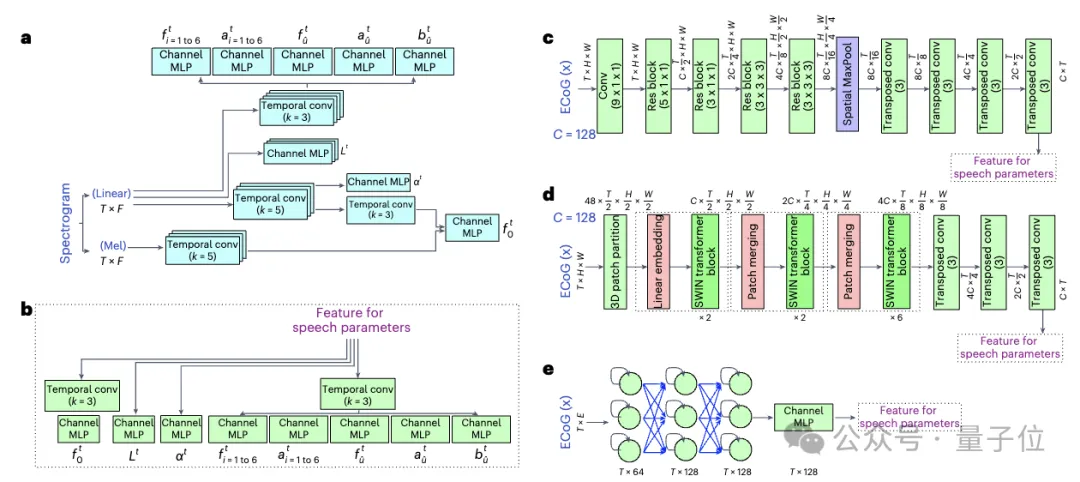

研究人員共收集并處理了48名神經外科病人的ECoG數據,使用多種深度學習架構(包括卷積、循環神經網絡和Transformer)作為ECoG解碼器。

該框架在各種模型上都展現出了高準確度,其中以卷積(ResNet)架構獲得的性能最好。本文研究人員提出的框架僅通過因果操作和相對較低的采樣率(low-density, 10mm spacing)就能實現高準確度。

他們還展示了能夠從大腦的左右半球都進行有效的語音解碼,將神經語音解碼的應用擴展到了右腦。

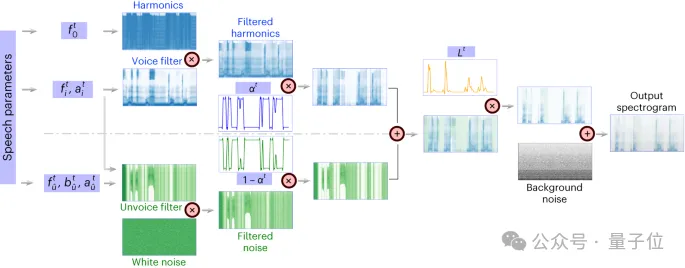

△可微分語音合成器架構

可微分語音合成器(speech synthesizer),使得語音的重合成任務變得非常高效,可以用很小的語音合成高保真的貼合原聲的音頻。

可微分語音合成器的原理借鑒了人的發生系統原理,將語音分為Voice(用于建模元音)和Unvoice(用于建模輔音)兩部分。

Voice部分可以首先用基頻信號產生諧波,由F1-F6的共振峰組成的濾波器濾波得到元音部分的頻譜特征。

對于Unvoice部分,研究人員則是將白噪聲用相應的濾波器濾波得到對應的頻譜,一個可學習的參數可以調控兩部分在每個時刻的混合比例,在此之后通過響度信號放大,加入背景噪聲來得到最終的語音頻譜。

△語音編碼器和ECoG解碼器

研究結果

一、具有時序因果性的語音解碼結果

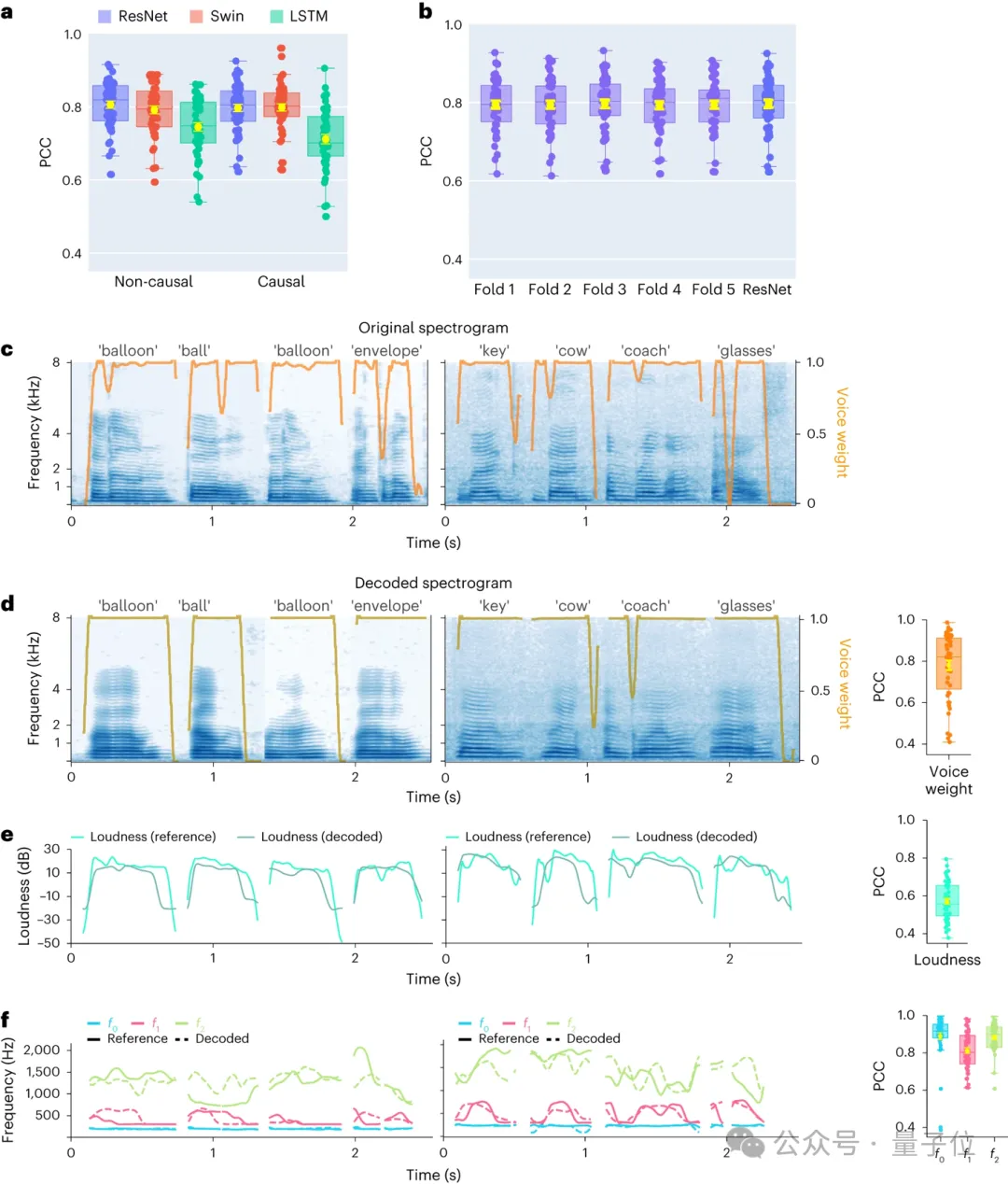

首先,研究人員直接比較不同模型架構卷積(ResNet)、循環(LSTM)和Transformer(3D Swin)在語音解碼性能上的差異。

值得注意的是,這些模型都可以執行時間上的非因果(non-causal)或因果操作。

解碼模型的因果性對大腦-計算機接口(BCI)應用具有重大意義:因果模型僅利用過去和當前的神經信號生成語音,而非因果模型還會使用未來的神經信號,這在實時應用中不可行。

因此,他們專注于比較相同模型在執行非因果和因果操作時的性能。

結果發現,即使是因果版本的ResNet模型也能與非因果版本媲美,二者之間沒有顯著差異。同樣,因果和非因果版本的Swin模型性能相近,但因果版本的LSTM模型性能顯著低于非因果版本。

研究人員展示了幾個關鍵語音參數的平均解碼準確率(N=48),包括聲音權重(用于區分元音和輔音)、響度、音高f0、第一共振峰f1和第二共振峰f2。準確重建這些語音參數,尤其是音高、聲音權重和前兩個共振峰,對于實現精確的語音解碼和自然地模仿參與者聲音的重建至關重要。

結果表明,無論是非因果還是因果模型,都能得到合理的解碼結果,這為未來的研究和應用提供了積極的指引。

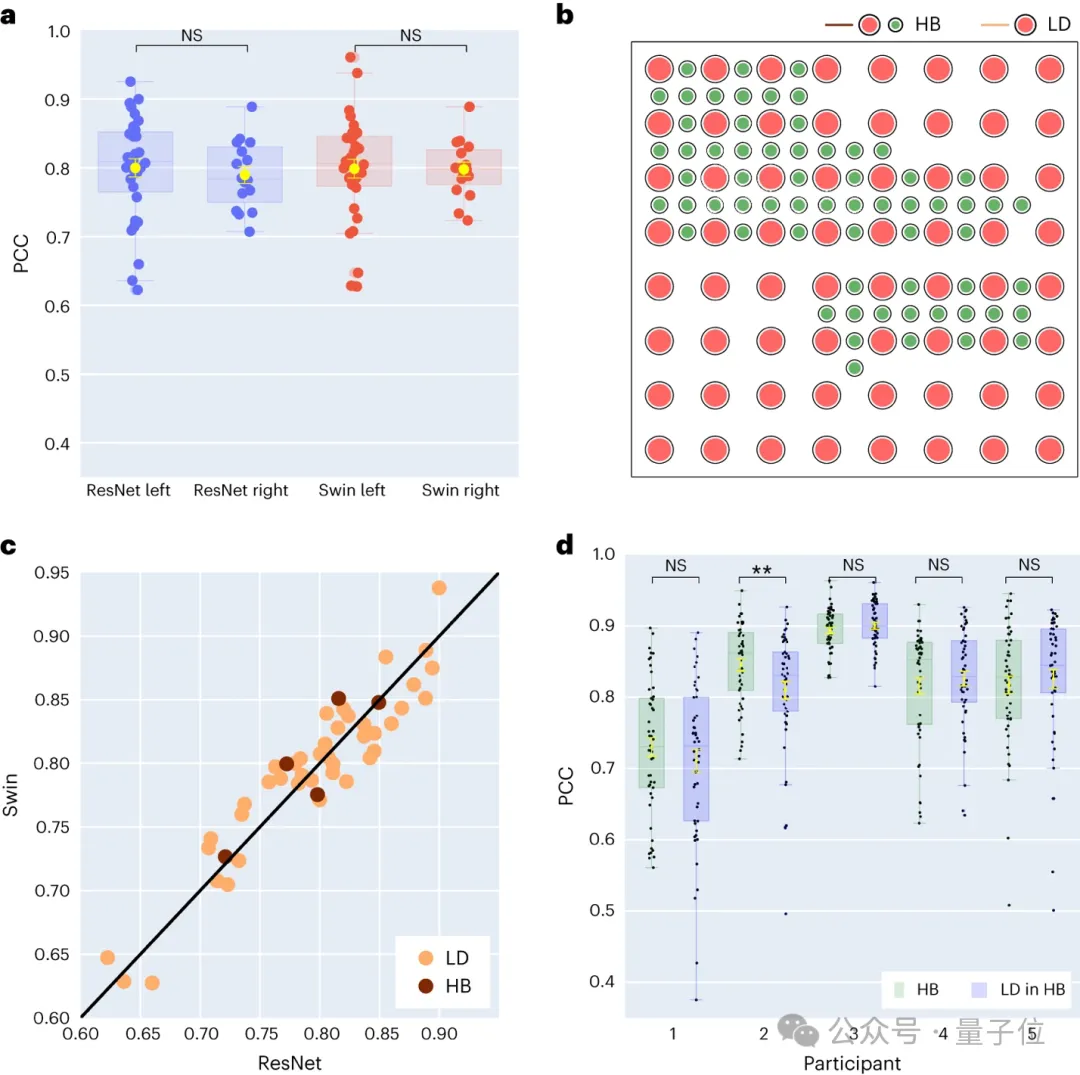

二、對左右大腦神經信號語音解碼以及空間采樣率的研究

研究人員進一步對左右大腦半球的語音解碼結果進行了比較。多數研究集中關注主導語音和語言功能的左腦半球,而對從右腦半球解碼語言信息的關注較少。

針對這一點,他們比較了參與者左右大腦半球的解碼表現,以此驗證使用右腦半球進行語音恢復的可能性。

在研究收集的48位受試者中,有16位受試者的ECoG信號采集自右腦。

通過對比 ResNet 和 Swin 解碼器的表現,發現右腦半球也能夠穩定地進行語音解碼,與左腦半球的解碼效果相差較小。

這意味著,對于左腦半球受損、失去語言能力的患者來說,利用右腦半球的神經信號恢復語言也許是一個可行的方案。

接著,他們還探討了電極采樣密度對語音解碼效果的影響。

之前的研究多采用較高密度的電極網格(0.4 mm),而臨床中通常使用的電極網格密度較低(LD 1 cm)。有五位參與者使用了混合類型(HB)的電極網格,這類網格雖然主要是低密度采樣,但其中加入了額外的電極。剩余的四十三位參與者都采用低密度采樣。這些混合采樣(HB)的解碼表現與傳統的低密度采樣(LD)相似。

這表明模型能夠從不同空間采樣密度的大腦皮層中學習到語音信息,這也暗示臨床通常使用的采樣密度對于未來的腦機接口應用也許是足夠的。

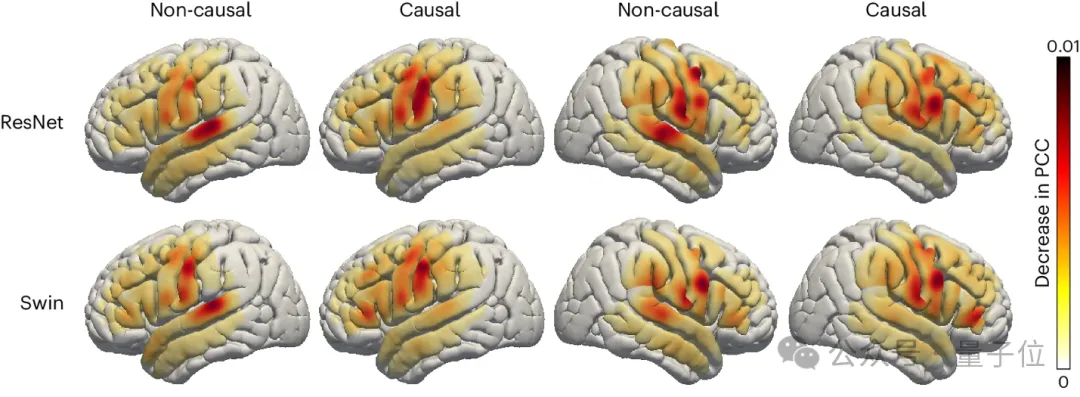

三、對于左右腦不同腦區對語音解碼貢獻度的研究

研究人員也考察了大腦的語音相關區域在語音解碼過程中的貢獻程度,這對于未來在左右腦半球植入語音恢復設備提供了重要的參考。

采用了遮擋技術(occlusion analysis)來評估不同大腦區域對語音解碼的貢獻度。

通過對比 ResNet 和 Swin 解碼器的因果與非因果模型,發現聽覺皮層在非因果模型中的貢獻更大,這側面佐證了在實時語音解碼應用中,必須使用因果模型,因為在實時語音解碼中,我們無法利用神經反饋信號。

此外,無論是在右腦還是左腦半球,傳感運動皮層尤其是腹部區域的貢獻度相似,這暗示在右半球植入神經假肢也許是一個可行的方案。

最后總結來說,該研究在腦機接口上面取得了一系列的進展,不過研究人員也提到了目前模型的一些限制,比如解碼流程需要有與ECoG記錄配對的語音訓練數據,這對失語患者可能不適用。

未來他們希望開發能處理非網格數據的模型架構,以及更好地利用多病人、多模態腦電數據。

對于腦機接口領域來說,目前的研究還處于相當早期的階段,伴隨著硬件技術的迭代和深度學習技術的快速進展,科幻電影中出現的腦機接口設想會愈發趨近實現。

論文鏈接:https://www.nature.com/articles/s42256-024-00824-8。

GitHub鏈接:https://github.com/flinkerlab/neural_speech_decoding。

更多生成的語音例子:https://xc1490.github.io/nsd/。