英偉達(dá)最新技術(shù)分享:手把手教你用Llama 3.1合成數(shù)據(jù)改進(jìn)模型!附代碼

Epoch AI上個月剛剛發(fā)文預(yù)言「數(shù)據(jù)墻」迫近,結(jié)果英偉達(dá)轉(zhuǎn)頭就甩出了340B開源巨獸Nemotron。

真實數(shù)據(jù)稀缺可能不再是問題了,Nemotron 9T token的預(yù)訓(xùn)練預(yù)料中,98%都是合成數(shù)據(jù)。

也許你還對合成數(shù)據(jù)存在顧慮,或者不知道如何應(yīng)用LLM驅(qū)動數(shù)據(jù)生成。或許,英偉達(dá)的這篇博客可以提供答案。

原文地址:https://developer.nvidia.com/blog/creating-synthetic-data-using-llama-3-1-405b/?linkId=100000275486093

首先我們需要理解,用LLM合成數(shù)據(jù)的本質(zhì)究竟是什么?

合成數(shù)據(jù)并不是「從無到有」地創(chuàng)造新信息,而是對現(xiàn)有信息進(jìn)行轉(zhuǎn)換,生成不同的變體。

實際上,合成數(shù)據(jù)在AI領(lǐng)域的應(yīng)用已經(jīng)有十多年的歷程,比如物體檢測或分類系統(tǒng)中曾經(jīng)的數(shù)據(jù)增強(qiáng)技術(shù)。

那么,LLM帶來了什么新變化呢?

從「需求端」來看,由于模型需要大量訓(xùn)練語料,合成數(shù)據(jù)的動機(jī)被大大增強(qiáng)。

而在「供給端」,生成式語言模型也為合成數(shù)據(jù)技術(shù)帶來了質(zhì)的改變。

用合成數(shù)據(jù)微調(diào)基座模型,可以更好地應(yīng)用于實際場景。例如,在金融領(lǐng)域改進(jìn)風(fēng)險評估、在零售領(lǐng)域優(yōu)化供應(yīng)鏈、在電信領(lǐng)域提升客戶服務(wù),以及在醫(yī)療領(lǐng)域改善患者護(hù)理等等。

尤其是405B開源巨獸Llama 3.1最近正式上線,既可用于批處理和在線推理,也可以作為基座模型,進(jìn)行特定領(lǐng)域的專門預(yù)訓(xùn)練或微調(diào)。

尤其是考慮到Llama 3.1有如此大的參數(shù)規(guī)模,加上豐富的15.6T token訓(xùn)練數(shù)據(jù),非常適合用于數(shù)據(jù)生成。

這篇博客文章將介紹幾個合成數(shù)據(jù)的生成與應(yīng)用案例,并就其中一個進(jìn)行深入探討。

- 合成數(shù)據(jù)的生成是推動GenAI在特定領(lǐng)域應(yīng)用的關(guān)鍵工作流程

- 將最新的Llama 3.1與英偉達(dá)Nemotron-4 340B獎勵模型配合使用,非常適用于生成合成數(shù)據(jù)

- 要讓LLM生成基于最新信息的有根據(jù)的響應(yīng),構(gòu)建RAG流程十分重要,而且模型響應(yīng)的準(zhǔn)確性取決于流程的質(zhì)量。

LLM合成數(shù)據(jù)如何應(yīng)用于GenAI

改進(jìn)語言模型

要通過合成數(shù)據(jù)來微調(diào)模型,大致有兩種方法——知識蒸餾(knowledge distillation)和自我改進(jìn)(self-improvement)。

知識蒸餾是將大模型的能力轉(zhuǎn)移到較小模型的過程,但不是簡單地在同一個數(shù)據(jù)集上訓(xùn)練兩個模型,因為較小模型很難學(xué)習(xí)到底層數(shù)據(jù)的準(zhǔn)確表征。

在這種情況下,我們可以先讓大模型完成任務(wù),再使用這些數(shù)據(jù)指導(dǎo)小模型進(jìn)行。

自我改進(jìn)則是讓同一個模型評判自己的推理過程,常被用于進(jìn)一步磨練模型的能力。

讓我們來看看如何實現(xiàn)這一目標(biāo)。訓(xùn)練語言模型通常包括三個步驟:預(yù)訓(xùn)練、微調(diào)和對齊(alignment)。

預(yù)訓(xùn)練

預(yù)訓(xùn)練通常需要極其龐大的語料庫,使模型了解語言的一般結(jié)構(gòu)。

Llama 3.1、GPT-4這種通用LLM,一般需要互聯(lián)網(wǎng)規(guī)模的數(shù)據(jù)。而特定領(lǐng)域的LLM(如幾何學(xué)、放射學(xué)、電信行業(yè)等)則需要注入相關(guān)的領(lǐng)域信息,這個過程被稱為領(lǐng)域自適應(yīng)預(yù)訓(xùn)練(Domain Adaptive Pretraining,DAPT)。

除了要貼近相關(guān)領(lǐng)域,另一種在預(yù)訓(xùn)練階段使用合成數(shù)據(jù)的例子當(dāng)屬Phi-1.5模型,目的是注入邏輯推理能力。

微調(diào)

掌握了語言的一般結(jié)構(gòu)后,下一步就是微調(diào),讓模型更好地遵循指令、完成特定任務(wù)。

比如,要讓模型提高邏輯推理能力、實現(xiàn)更好的代碼生成和函數(shù)調(diào)用,或者提升閱讀理解類任務(wù)的表現(xiàn),都可以通過微調(diào)來實現(xiàn)。

Self-Instruct、WizardCoder、Alpaca等模型都通過創(chuàng)建特定領(lǐng)域的數(shù)據(jù)并進(jìn)行微調(diào),來定向提升模型能力。

對齊

最后,我們希望確保模型響應(yīng)的風(fēng)格和語氣與用戶期望一致,例如聽起來像對話、具有適當(dāng)?shù)脑敿?xì)程度、復(fù)雜性、一致性等。

可以創(chuàng)建一個包含指令模型(instruct model)和獎勵模型(reward model)的流水線來實現(xiàn)這個需求。

先讓模型對同一問題創(chuàng)建多個響應(yīng),然后讓獎勵模型對這些相應(yīng)的質(zhì)量進(jìn)行反饋。這種方法屬于從AI反饋中進(jìn)行強(qiáng)化學(xué)習(xí)(Reinforcement Learning from AI Feedback, RLAIF)。

改進(jìn)其他模型和系統(tǒng)

除了改善語言模型本身,合成數(shù)據(jù)還可以應(yīng)用于LLM鄰接模型(LLM-adjacent model)以及LLM驅(qū)動的流水線。

最經(jīng)典的例子就是檢索增強(qiáng)生成(Retrieval Augmented Generation,RAG),先用嵌入模型來檢索相關(guān)信息,再讓語言模型生成最終答案。

在這個過程中,我們可以使用LLM來解析底層文檔和合成數(shù)據(jù),從而評估并微調(diào)嵌入模型。

類似于RAG,任何智能體(Agentic)流水線都可以被評估,其組件模型也可以被微調(diào),實現(xiàn)方式就是用LLM驅(qū)動的智能體來構(gòu)建模擬。

這些模擬還可以用于研究行為模式,此外,也可以在LLM中設(shè)定特定角色,以針對特定任務(wù)進(jìn)行大規(guī)模數(shù)據(jù)生成。

使用合成數(shù)據(jù)評估RAG

為了更好地理解上述討論,我們來思考一個基本的流程,應(yīng)用于一個具體的用例——為檢索過程生成評估數(shù)據(jù)。

下述流程的實現(xiàn)代碼已經(jīng)上傳至GitHub。

項目地址:https://github.com/NVIDIA/NeMo-Curator/tree/main/tutorials/synthetic-retrieval-evaluation

要創(chuàng)建用于評估檢索流程的數(shù)據(jù),主要面臨以下2個挑戰(zhàn):

- 多樣性:問題不應(yīng)只關(guān)注信息的單一方面或僅包含提取性問題

- 復(fù)雜性:生成的問題應(yīng)需要一些推理或多個證據(jù)來回答

我們將重點關(guān)注多樣性,但為了探索復(fù)雜性角度——關(guān)鍵是找到具有重疊信息點的內(nèi)容塊。找到重疊信息的幾種方法包括計算句子級語義的Jaccard相似度,并利用長上下文模型找到同一文檔的不同塊之間的關(guān)聯(lián)。

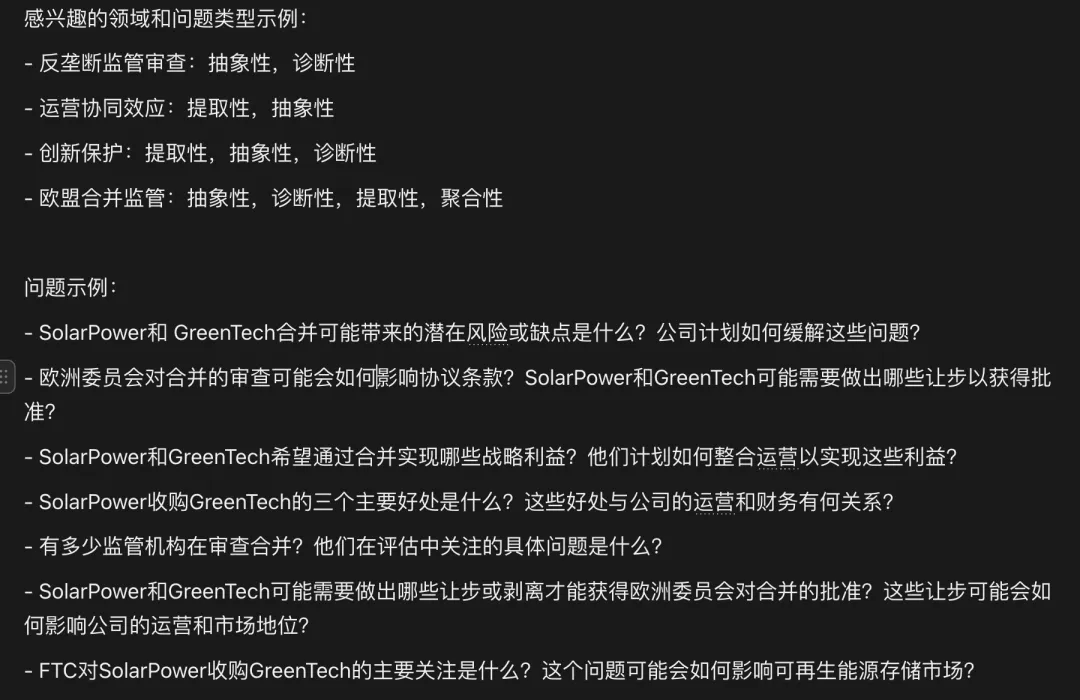

多樣性源自不同的視角,比如考慮如下文本:

對于同一篇文檔,金融分析師可能對兩家公司合并前后的財務(wù)狀況感興趣,法律專家可能關(guān)注公司面臨的來自FTC、歐盟和其他方的法律審查,記者則希望了解事實要點。

所有這些都是有效的視角和用戶角色。由于他們以不同的視角看待相同的信息,因此評估流程也需要適應(yīng)這些視角。

因此,讓我們設(shè)計一個評估流程,該流程以文檔和用戶角色作為輸入,并以符合角色的語氣輸出問題。

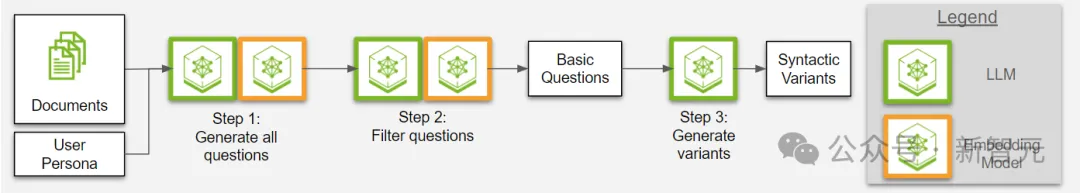

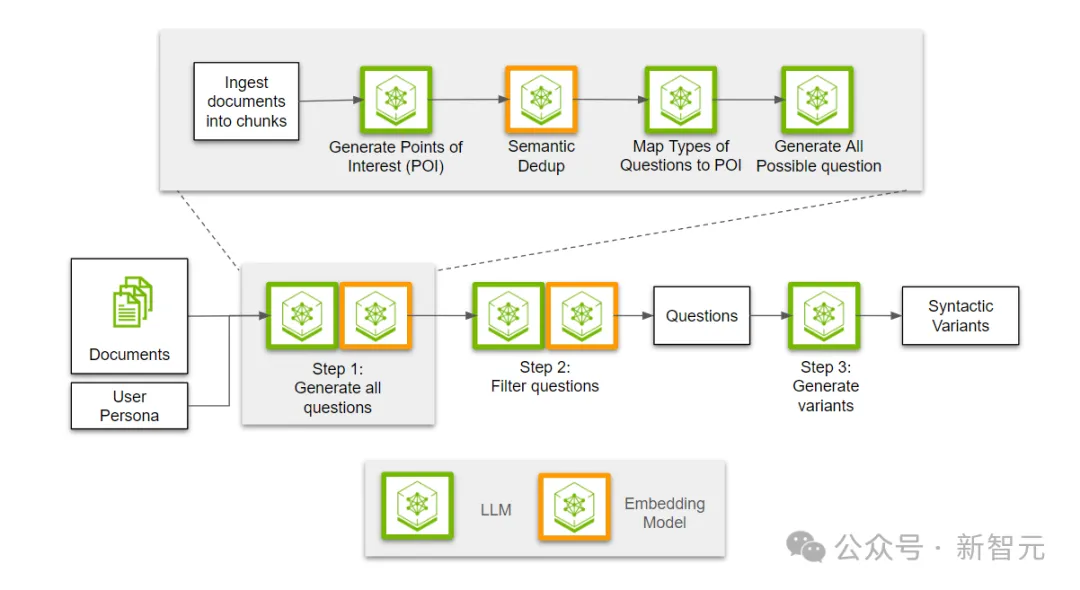

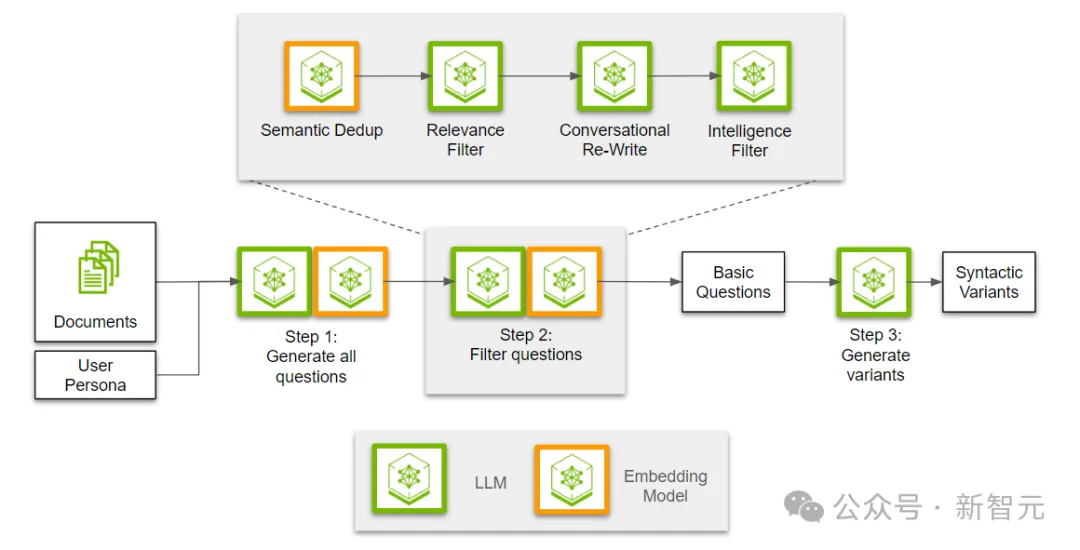

圖1. 三步流程的概述:生成用于評估檢索過程的合成數(shù)據(jù)

如圖1所示,這個評估流程有三個主要步驟。

步驟1:生成所有可能的問題

這些問題都是用戶角色可能感興趣的。

步驟2:篩選出相關(guān)的問題

從生成的問題中篩選出最相關(guān)和有價值的問題。

步驟3:引入用戶角色的寫作風(fēng)格

將篩選出的問題轉(zhuǎn)換為符合用戶角色寫作風(fēng)格的形式。

通過這三個步驟,可以確保不同用戶角色獲得他們所需的信息,并以他們熟悉的方式呈現(xiàn)。

步驟1:生成問題

在生成問題之前,我們需要先讀取文檔并將其分成若干塊(chunk)。

然后,讓LLM從給定的文本塊中,為每個用戶角色提取感興趣的點。

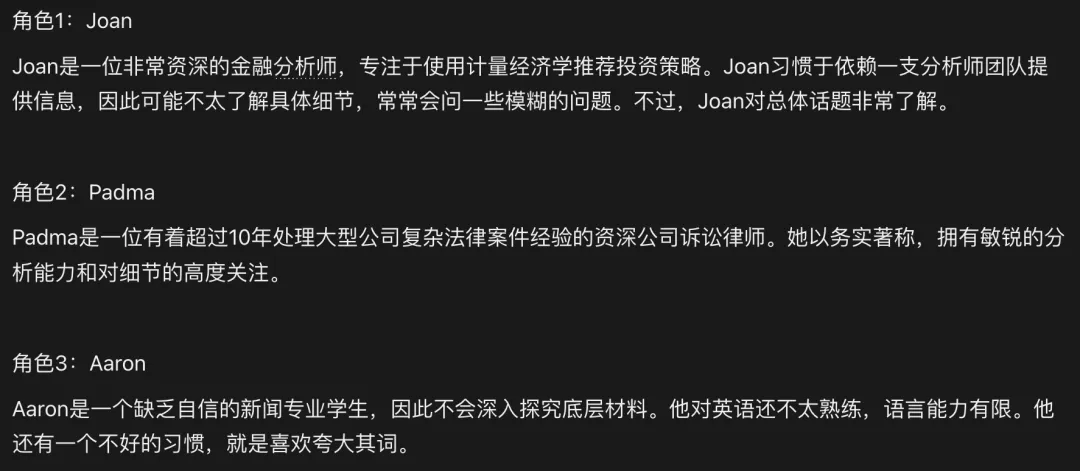

所謂的「用戶角色」(persona),實際上就是對潛在用戶的描述,比如:

由于多個用戶角色可能有相似的興趣點,因此需要使用嵌入模型來進(jìn)行語義去重,從而為每個角色映射出段落中不同的相關(guān)信息。

多樣性的另一個方面是問題類型。

我們需要提出各種類型的問題,如提取性、抽象性、比較性的問題,而不僅僅是簡單的「如何/什么」問題。因此,下一步是根據(jù)段落中的信息,確定每個興趣點適用的問題類型。

最后,利用文本塊-興趣點-問題類型的三元組,生成所有可能的問題。通過用戶角色和問題類型,開發(fā)人員可以將生成的問題引導(dǎo)到用戶會問的類型上。

步驟2:過濾問題

生成問題之后,下一步就是過濾并提取最有用的子集。首先,我們需要對所有生成的問題進(jìn)行去重,因為不同的興趣點可能會利用相鄰的信息點,導(dǎo)致問題重疊。

接下來,我們使用LLM來判斷問題與段落的相關(guān)性,確保這些問題能夠完全通過段落中的信息回答。然后,我們將所有相關(guān)問題重寫為對話語氣。最后,我們會進(jìn)行另一次過濾,分類并剔除那些可能過于籠統(tǒng)的問題。

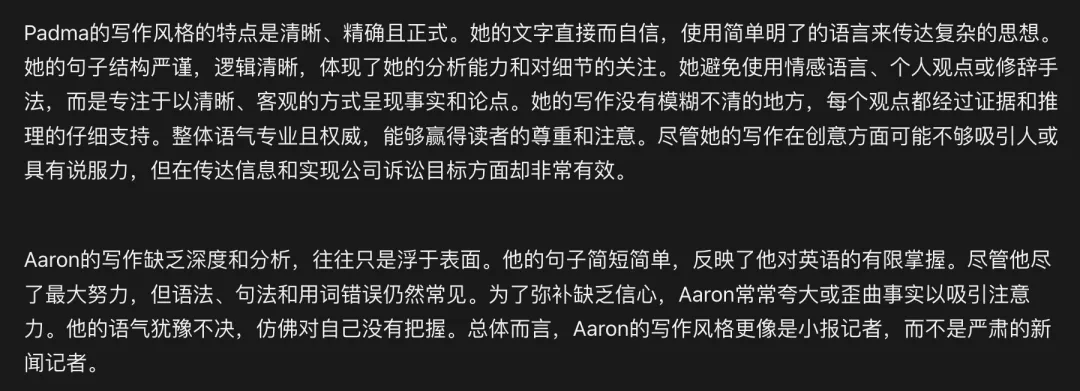

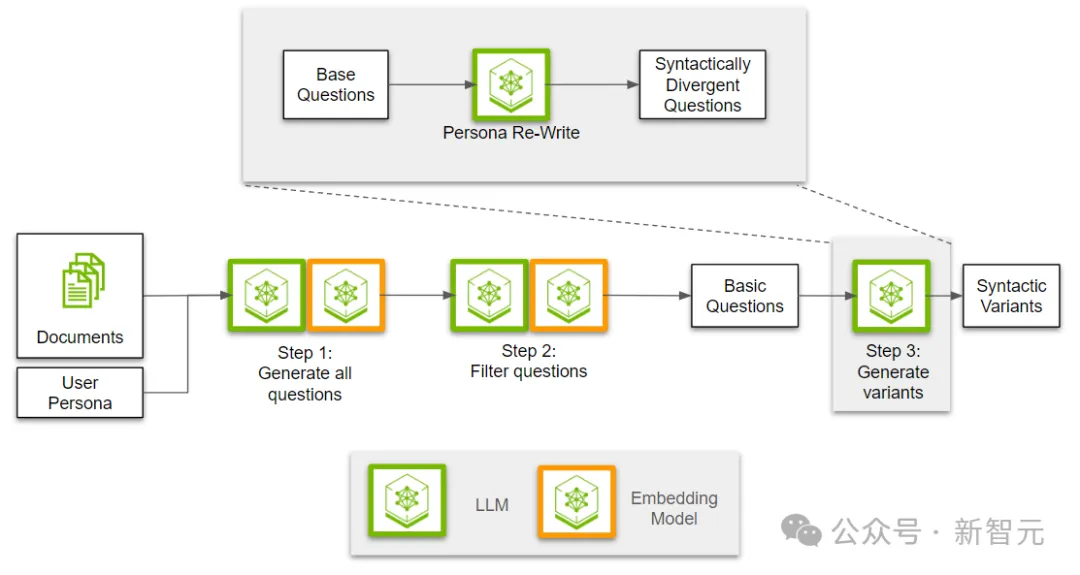

步驟3:注入用戶角色風(fēng)格

在前兩步中,我們創(chuàng)建并篩選了多樣化的問題。最后一步是將用戶角色的寫作風(fēng)格融入到問題中。

使用LLM,我們首先根據(jù)給定的用戶角色描述來制定寫作風(fēng)格。然后,基于這些寫作風(fēng)格重新改寫問題。

比如,可以這樣描述用戶角色的寫作風(fēng)格:

在這個三步流程結(jié)束后,我們得到了如下問題:

- 鑒于現(xiàn)行的監(jiān)管框架,擬議的合并還需要遵守哪些額外的政策指令,才能獲得相關(guān)部門的批準(zhǔn)?

- SolarPower和GreenTech合并的哪些具體方面目前正在接受相關(guān)監(jiān)管部門的審查?

- 如果在大筆買斷之后,GreenTech的研發(fā)中心保持單飛狀態(tài),那些天才會被炒魷魚嗎?

可以看出,前兩個問題很像Padma的語氣,而第三個問題似乎是Aaron會問的。

這些問題各自包含了真實標(biāo)簽,對應(yīng)特定的文本塊,因此不僅限于這一個用例,可以用于評估各種檢索流程。