ECCV 2024 | 新夢幻場景生成方法,高質量、視角一致、可編輯3D場景

數據空間研究中心是中國科學技術大學網絡空間安全學院布局建設的創新型科研平臺。中心于 2021 年 9 月 20 日正式揭牌成立,由吳曼青院士領銜、中青年教師為骨干,聚焦從數據到網絡空間(From Data to Cyberspace),以數據重構網絡空間為使命,瞄準網絡空間、智能感知、大數據等領域的前沿問題,探索打造一支結構合理、優勢互補的科技力量,服務國家重大需求。

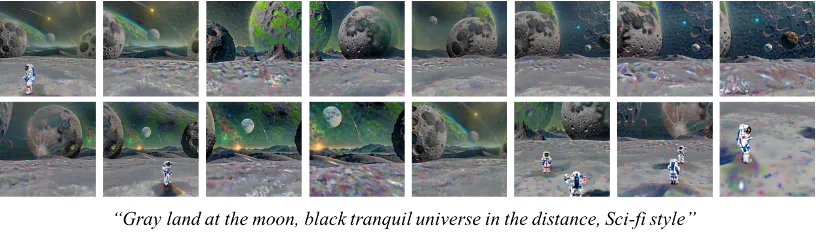

來自中國科學技術大學數據空間研究中心、香港科技大學、香港理工大學以及奧胡斯大學的研究者們提出一種新的場景生成方法 DreamScene,只需要提供場景的文本就可以生成高質量,視角一致和可編輯的 3D 場景。

- 項目主頁:https://dreamscene-project.github.io/

- 論文地址:https://arxiv.org/abs/2404.03575

- 代碼開源:https://github.com/DreamScene-Project/DreamScene

關鍵問題

基于蒸餾的文本生成 3D 方法通常采用預訓練的 2D 文本到圖像模型如 Stable Diffusion 作為先驗,通過朝向物體中心的相機渲染優化生成物體的可微分 3D 表示。而文本生成 3D 場景方法需要從預定義的相機位置向外渲染,以生成這些有限視角的場景。

目前的文本生成 3D 場景方法(如下圖所示)面臨幾個關鍵挑戰,包括:

- 低效的生成過程,常導致低質量的生成和較長的生成時間。

- 不一致的 3D 場景視角,僅在有限視角下有著良好的渲染結果。

- 無法將物體與環境分離,無法對單個物體進行靈活編輯。

技術方案

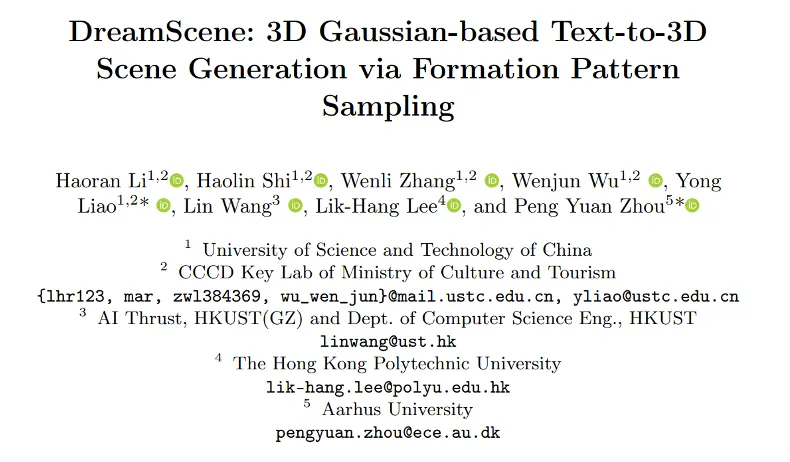

DreamScene 主要由形成模式采樣(Formation Pattern Sampling)和相機采樣 (Camera Sampling) 兩部分組成,其中形成模式采樣根據 3D 模型生成的規律由多時間步采樣(Multi-timestep Sampling)、3D 高斯過濾(3D Gaussian Filtering)以及重建式生成(Reconstructive Generation)三種操作組成;

相機采樣通過三階段的策略逐步生成 3D 環境,保證場景全局的視角一致性。總體的算法流程如圖所示,DreamScene 首先利用大語言模型(LLM)根據文本描述(prompt)分離出場景中的物體描述和環境描述。首先生成場景中的單個物體,DreamScene 利用 Point-E 得到相應的初始化點云,之后使用形成模式采樣方法生成對應文本的 3D 表示;再將生成的物體根據布局放置在對應的位置上;最后對四周環境進行生成,DreamScene 將室內場景初始化為長方體,將室外場景初始化為半球體,通過三階段優化,逐步優化遠處環境,近處地面和整體的場景。

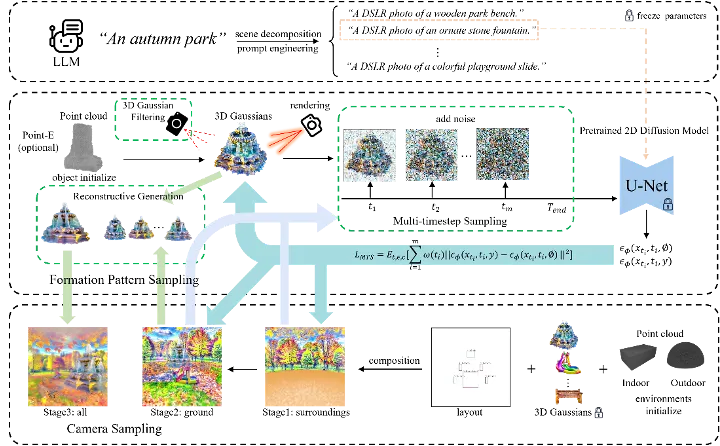

形成模式采樣(Formation Pattern Sampling)主要使用多時間步采樣(Multi-timestep Sampling),多時間步采樣每次迭代過程中混合了多個 2D 擴散模型時間步長提供的指導信息,而這些時間步長通過在一個線性遞減的滑動窗口上進行分層抽樣得到,這種優化策略不僅保證了在優化過程中對 3D 內容的形狀約束,同時可以豐富語義信息。

此外,生成的過量 3D 高斯會阻礙優化過程,因此 DreamScene 使用 3D 高斯過濾(3D Gaussian Filtering)在優化過程中過濾掉冗余的 3D 高斯,保留距離渲染平面較近且體積較大的 3D 高斯。在優化的后期階段,使用較小步長 t 的信息可以提供一致但是精細紋理的信息,所以 DreamScene 使用重建式生成(Reconstructive Generation)方法來加速生成 3D 內容的合理表面紋理。

對于場景中的環境,DreamScene 使用一個漸進式的三階段相機采樣(Camera Sampling)策略優化環境生成。在相機采樣的第一階段,DreamScene 在場景中心的一定范圍內進行相機位姿采樣以生成周圍環境(室內的墻壁、室外遠處環境)的粗略表示(MTS 指導優化);在第二階段,DreamScene 通過采樣一些特定區域的相機位姿來生成粗糙的地面,并且會盡可能保證地面與周圍環境接觸部分的連貫性;在第三階段,DreamScene 使用在前兩階段中所有的相機位姿來優化所有的的環境元素(MTS 指導優化),之后使用 3D 重建的方法以獲得更合理的紋理和細節。

實驗評估

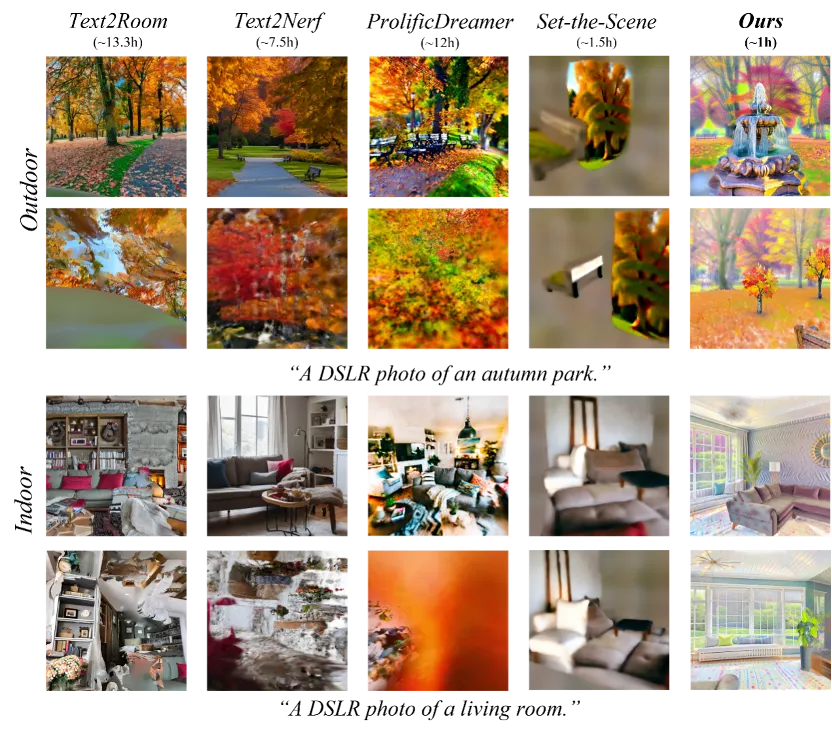

對比試驗 下圖展示了 DreamScene 場景生成的定性對比實驗,上半部分圖像采用生成時出現的相機位姿渲染的,下圖是在場景中隨機選擇的相機位姿渲染的。我們可以看到,Text2Room 和 Text2NeRF 只能在生成過程中遇到的相機位姿下生成令人滿意的結果,DreamScene 實現了最佳的 3D 一致性,同時有著很高的生成質量。

下圖展示了形成模式采樣可以在短時間內根據文本提示生成高質量的 3D 表示,DreamGaussian 的速度更快但生成質量太低。

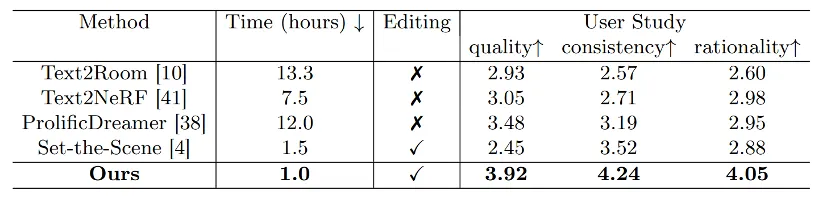

作者計算了環境生成階段的生成時間。如下表的左側顯示,具有編輯功能的環境生成方法中 DreamScene 的時間最短,右側顯示了用戶研究,其中 DreamScene 在一致性和合理性方面明顯優于其他 SOTA 方法,生成質量最高。

一致性 如下圖所示 DreamScene 的生成結果在較高生成質量的同時,保證了較好的 3D 一致性。

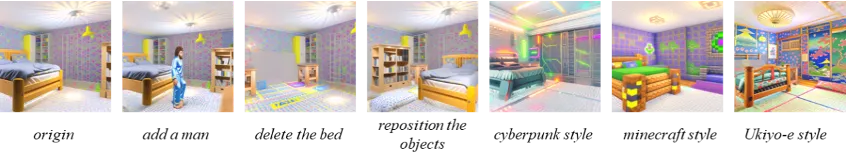

編輯性 DreamScene 可以添加或刪除對象或者通過調整對象的仿射變量的值來重新設計其在場景中的位置。在進行這些編輯時,用戶需要在物體的原始位置和新位置重新采樣相機姿勢,重新優化地面和周圍方向。此外,用戶還可以改變文本提示來改變場景中的環境或對象的樣式。

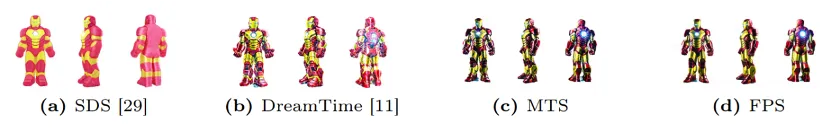

消融實驗 在 “A DSLR photo of Iron Man” 提示下,經過 30 分鐘優化后的結果。如下圖所示,與 DreamTime 和 DreamFusion 中提到的分數蒸餾采樣 (SDS) 相比,多時間步采樣形成了更好的幾何結構和紋理。形成模式采樣是在多時間步采樣的基礎上建立起來的,采用重建式生成的方法來創建更加合理的紋理結構,在指導 3D 內容優化方面十分具有優越性。

總結

本文介紹了一種新穎的文本到 3D 場景生成策略 DreamScene。通過生成模式采樣和相機采樣策略,將物體和環境整合在一起,解決了目前文本到 3D 場景生成方法中存在的低效、不一致和可編輯性有限等問題。廣泛的實驗證明,DreamScene 是三維場景生成領域的一項里程碑式成就,在眾多領域,如游戲、影視和房屋設計中有著巨大的應用潛力。