別再把o1滿血版當聊天模型了!SpaceX前工程師公開全新使用秘籍:從討厭它到每天依賴它

蘋果&SpaceX前工程師分享o1使用心得,奧特曼、Brockman都轉發了。

劃重點:

o1已經不是聊天模型了,需要全新的使用方法。

奧特曼還跑去挖墳作者Ben Hylak數天前的“自我打臉”評論,稱“觀察o1的口碑變化、以及人們學習如何使用它很有趣”。

Ben Hylak曾任SpaceX軟件工程師、蘋果VisionOS人機交互設計師,目前在創業為AI產品提供分析服務。

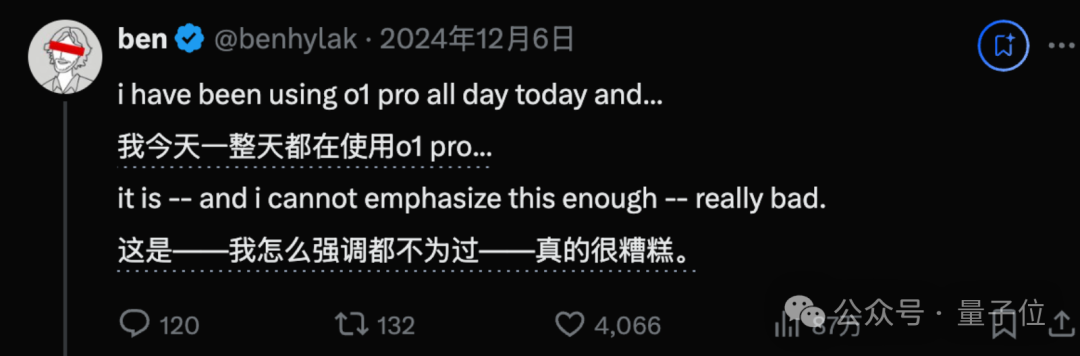

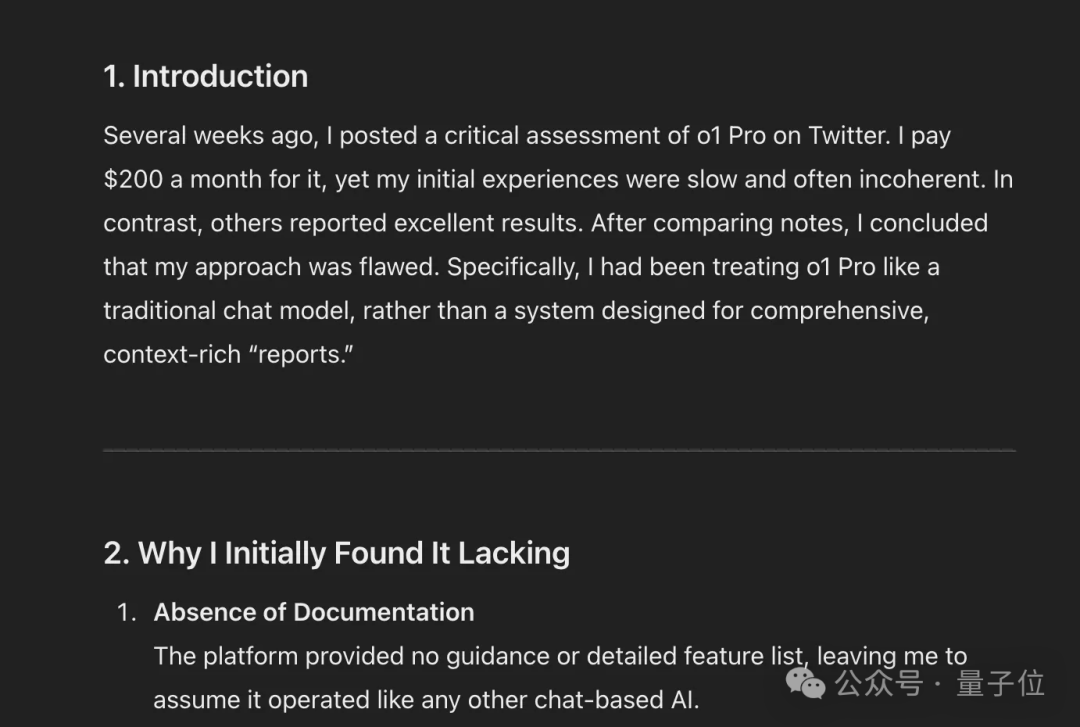

具體來說,Ben在o1 pro推出滿血$200/月版本的第一天就交錢了,整整測試了一天后得出結論:它真的很糟糕!

- 每次提問都要等待5分鐘

- 會輸出自相矛盾的建議

- 沒有要求但總是會回復架構圖+優勢/劣勢列表

Ben把糟糕的體驗發在網上后,很多人表示同感。但有趣的是,也有人強烈反對。

他開始與持不同觀點的討論,然后意識到原來是自己的方法完全錯了。

我還在把o1當聊天模型來用,但o1已經不是聊天模型了。

現在,Ben已經從討厭o1,轉變成了每天都在用它解決最重要的問題。

像對待新員工一樣對待o1

如果說o1不是聊天模型了,那它現在是什么?

Ben認為它就像一個“報告生成器”。如果你給它足夠的上下文,并告訴它你想要輸出什么,它通常會一次性找到解決方案。

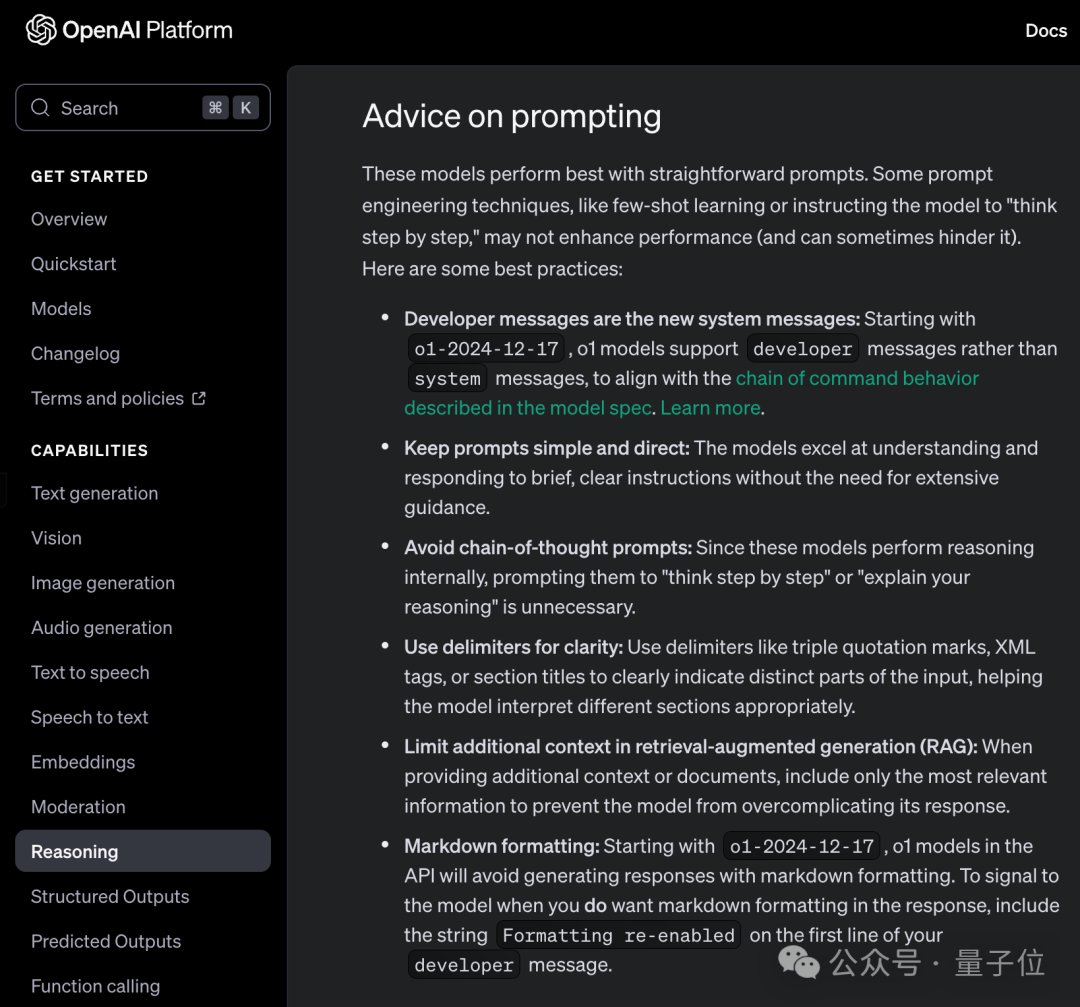

OpenAI官方其實給了一個簡單的o1使用建議,但并不完善。

Ben的建議包括:

提供海量背景信息

不管你現在是怎么理解“海量”的,再乘以10倍。

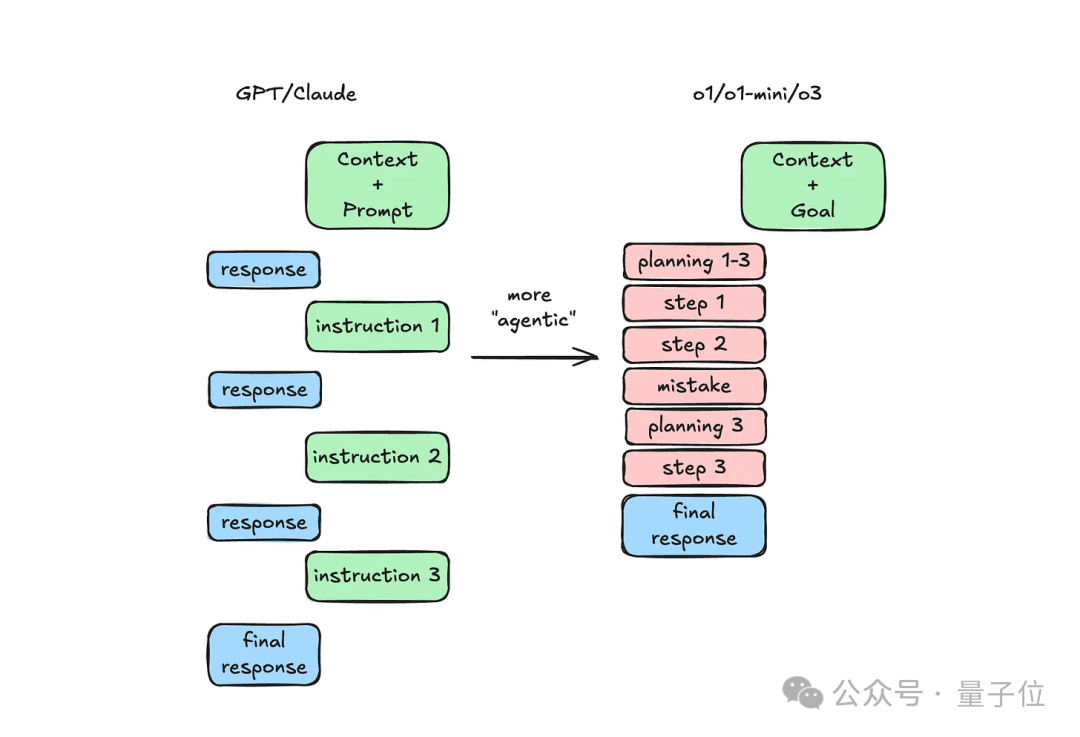

當使用GPT-4o或Claude 3.5等聊天模型時,通常會從一個簡單的問題和一些背景信息開始。如果模型需要更多背景信息,它通常會要求你繼續提供。

這就是聊天模型的本質,從一來一回的交互中不斷完善輸出。

但o1只會從表面上回答你提出的問題,不會試圖從你那里獲取背景信息。所以需要反過來將盡可能多的上下文主動發給它。

即使只是問一個簡單的代碼工程問題,應該提供:

- 解釋所有你嘗試過但不起作用的方案

- 一份完整的數據庫schemas

- 解釋一下你的公司是做什么的,規模多大,定義內部術語

總而言之,就像對待新員工一樣對待o1。

描述你想要什么,而不是指導它如何做

對于大多數聊天模型,我們都會告訴模型希望他如何回復模式,比如“扮演一位軟件工程專家,請仔細思考”。

但在o1上有效的方法正相反,告訴它你需要什么,而不是指導它如何去做。

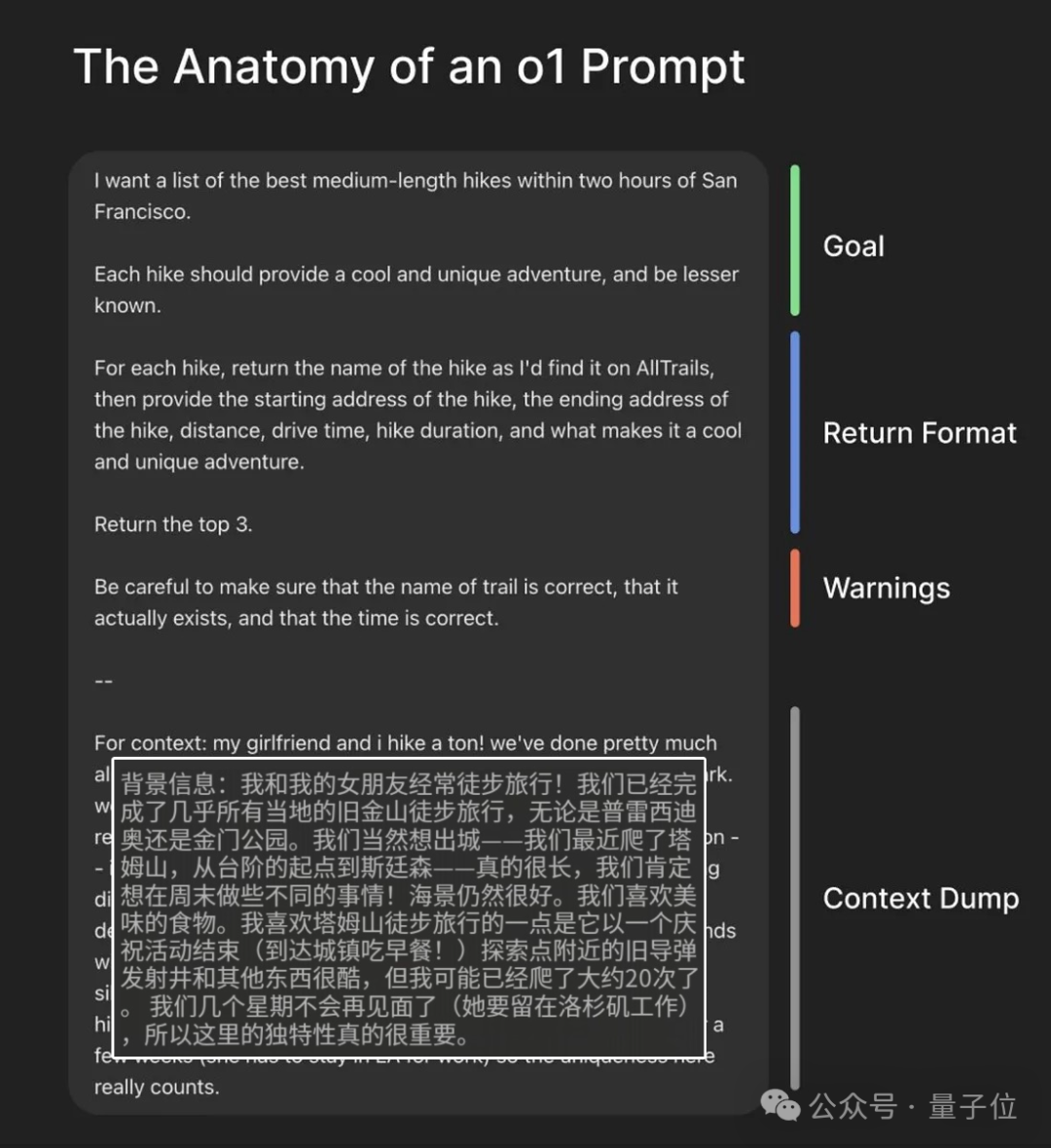

Ben把o1的提示詞模板分成4部分:

- 目標放在最前面

- 詳細指定輸出格式

- 可以附加需要檢查的注意事項

- 海量相關的背景信息

最后,o1的輸出有一種學術/商業報告的風格。Ben認為太多的推理token讓它很難擺脫這種風格

他曾試圖讓o1來完成這篇文章,但經過多次嘗試,只能得到非常平淡的學生作業。

One More Thing

在奧特曼的轉發推文中,有人套出了最新消息:

o3暫時還不會向用戶開放,o3-mini會先推出,而且時間不遠了。

o3-mini會先提供給Plus訂閱用戶使用,API的定價OpenAI內部還沒確定,但不會很貴。

參考鏈接:

[1]https://www.latent.space/p/o1-skill-issue。

[2]https://x.com/sama/status/1877814065088663763。

[3]https://x.com/gdb/status/1878489681702310392。