解密FedDAT:首個多模態異構聯邦學習高效微調框架,突破數據異構與通信瓶頸!

FedDAT: An Approach for Foundation Model Finetuning in Multi-Modal Heterogeneous Federated Learning

一、 一眼概覽

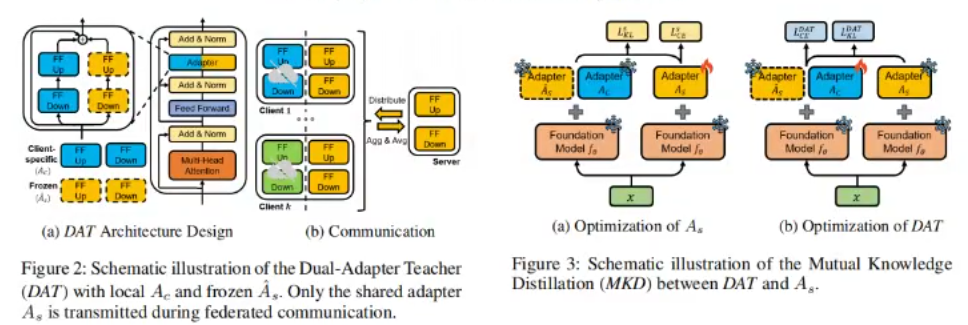

FedDAT提出了一種創新的雙適配器教師框架(Dual-Adapter Teacher, DAT),結合參數高效微調和互知識蒸餾,解決了多模態異構聯邦學習(FL)中的數據異構性問題,并在多個視覺-語言任務基準上取得了最優表現。

二、核心問題

如何在多模態聯邦學習環境中,在數據異構性和通信預算限制下,實現基礎模型的高效分布式微調,以提升視覺-語言任務的性能,是本研究的核心問題。

三、 技術亮點

1. 雙適配器教師框架 (DAT):引入凍結的全局適配器和本地優化適配器,以同時捕獲客戶端無關知識和客戶端特定知識,從而緩解數據異構性問題。

2. 互知識蒸餾 (MKD):通過雙向蒸餾在全局和本地適配器間高效傳遞知識,防止遺忘并增強泛化能力。

3. 跨基準任務驗證:在多種數據異構類型(視覺、文本、任務)基準上驗證,表現出優越的收斂速度和擴展性。

四、方法框架

FedDAT的核心方法框架如下:

1. 全局適配器初始化:服務器初始化共享適配器,并在每輪通信后更新全局參數。

2. 客戶端局部優化:

? 使用雙適配器(本地適配器+凍結的全局適配器)捕獲客戶端特定和無關知識。

? 通過互知識蒸餾(MKD)在全局適配器和雙適配器之間進行知識交換。

3. 聯邦聚合:每輪通信后,通過加權平均整合各客戶端的全局適配器參數。

五、實驗結果速覽

FedDAT在4個多模態FL基準上表現出顯著優越性:

? 在Domain基準上,FedDAT相較現有最佳方法Adapter,平均準確率提升 4.55%。

? 在Function、Scene、Task基準上,分別實現最高 6.02%、7.94%、1.09% 的提升。

? 通過通信輪次分析,FedDAT在僅完成 25%通信預算 時已取得明顯性能優勢。

六、實用價值與應用

FedDAT在實際應用中具有重要價值,尤其適用于以下場景:

1. 醫療領域:隱私敏感環境下的跨機構協作模型優化。

2. 工業制造:數據分布不一致的多工廠質量檢測。

- 3. 多模態智能:視覺與文本結合的復雜任務,例如視覺問答(VQA)。

七、開放問題

1. 若加入更大規模的客戶端或多模態任務,FedDAT的性能是否能保持穩定?

2. 互知識蒸餾機制在其他FL應用中(如時間序列分析)是否同樣適用?

3. 在極端數據異構性(如領域遷移任務)下,DAT框架的泛化能力是否受限?

其他

? 論文的官方期刊或會議來源:https://ojs.aaai.org/index.php/AAAI/article/view/29007

? 注:所有免費資料獲取鏈接:https://link3.cc/soragpt