高質(zhì)量3D生成最有希望的一集?GaussianCube在三維生成中全面超越NeRF

在三維生成建模的研究領(lǐng)域,現(xiàn)行的兩大類 3D 表示方法要么基于擬合能力不足的隱式解碼器,要么缺乏清晰定義的空間結(jié)構(gòu)難以與主流的 3D 擴散技術(shù)融合。來自中科大、清華和微軟亞洲研究院的研究人員提出了 GaussianCube,這是一種具有強大擬合能力的顯式結(jié)構(gòu)化三維表示,并且可以無縫應用于目前主流的 3D 擴散模型中。

GaussianCube 首先采用一種新穎的密度約束高斯擬合算法,該算法能夠?qū)?3D 資產(chǎn)進行高精度擬合,同時確保使用固定數(shù)量的自由高斯。隨后,借助最優(yōu)傳輸算法,這些高斯被重新排列到一個預定義的體素網(wǎng)格之中。得益于 GaussianCube 的結(jié)構(gòu)化特性,研究者無需復雜的網(wǎng)絡設(shè)計就能直接應用標準的 3D U-Net 作為擴散建模的主干網(wǎng)絡。

更為關(guān)鍵的是,本文提出的新型擬合算法極大地增強了表示的緊湊性,在 3D 表示擬合質(zhì)量相似的情況下所需的參數(shù)量僅是傳統(tǒng)結(jié)構(gòu)化表示所需參數(shù)量的十分之一或百分之一。這種緊湊性大幅降低了 3D 生成建模的復雜性。研究人員在無條件和條件性 3D 對象生成、數(shù)字化身創(chuàng)建以及文本到 3D 內(nèi)容合成等多個方面開展了廣泛的實驗。

數(shù)值結(jié)果表明,GaussianCube 相較之前的基線算法實現(xiàn)了最高達 74% 的性能提升。如下所示,GaussianCube 不僅能夠生成高質(zhì)量的三維資產(chǎn),而且還提供了極具吸引力的視覺效果,充分證明了其作為 3D 生成通用表示的巨大潛力。

圖 1. 無條件生成的結(jié)果。本文的方法可以生成高質(zhì)量、多樣化的三維模型。

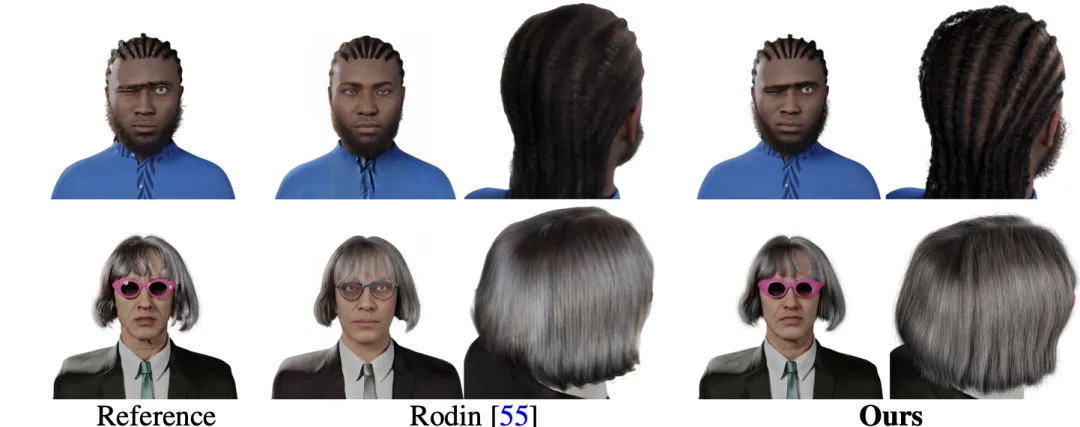

圖 2. 基于輸入肖像進行數(shù)字化身創(chuàng)建的結(jié)果。本文的方法可以極大程度上保留輸入肖像的身份特征信息,并且提供細致的發(fā)型、服裝建模。?

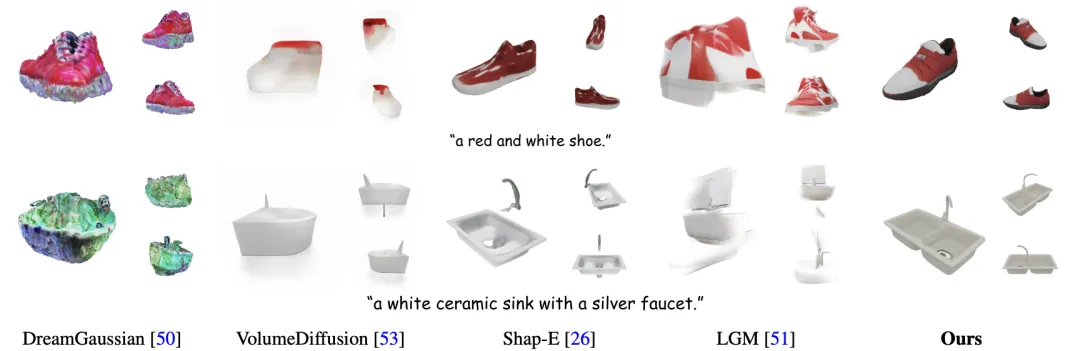

圖 3. 基于輸入文本創(chuàng)建三維資產(chǎn)的結(jié)果。本文的方法可以輸出與文本信息一致的結(jié)果,并且可以建模復雜的幾何結(jié)構(gòu)和細節(jié)材質(zhì)。

圖 4. 類別條件生成的結(jié)果。本文生成的三維資產(chǎn)語義明確,具有高質(zhì)量的幾何結(jié)構(gòu)和材質(zhì)。

- 論文名稱:GaussianCube: A Structured and Explicit Radiance Representation for 3D Generative Modeling

- 項目主頁:https://gaussiancube.github.io/

- 論文鏈接:https://arxiv.org/pdf/2403.19655

- 代碼開源:https://github.com/GaussianCube/GaussianCube

- 演示視頻:https://www.bilibili.com/video/BV1zy411h7wB/?

都什么年代了

還在用傳統(tǒng) NeRF 進行三維生成建模?

大多數(shù)先前的 3D 生成建模工作都使用了 Neural Radiance Field (NeRF) 的變體作為其底層的 3D 表示,這些表示通常結(jié)合了一個顯式的結(jié)構(gòu)化特征表示和一個隱式的特征解碼器。然而在三維生成建模中,所有三維物體不得不共享同一個隱式特征解碼器,這種做法在很大程度上削弱了 NeRF 的擬合能力。此外,NeRF 所依賴的體渲染技術(shù)具有非常高的計算復雜性,這導致了渲染速度緩慢,更需要消耗極高的 GPU 內(nèi)存。近期,另一種三維表示方法高斯濺射(3D Gaussian Splatting,簡稱 3DGS)備受矚目。雖然 3DGS 擬合能力強大、計算性能高效,還具備完全顯式的特性,在三維重建任務中得到了廣泛應用。但是,3DGS 缺乏一個明確定義的空間結(jié)構(gòu),這使得其在無法直接應用于目前主流生成建模框架中。

因此,研究團隊提出了 GaussianCube。這是一種創(chuàng)新的三維表示方法,它既結(jié)構(gòu)化又完全顯式,具備強大的擬合能力。本文介紹的方法首先確保通過固定數(shù)量的自由高斯實現(xiàn)高精度的擬合,然后將這些高斯有效地組織到一個結(jié)構(gòu)化的體素網(wǎng)格中。這種顯式且結(jié)構(gòu)化的表示方法讓研究者能夠無縫地采用標準的 3D 網(wǎng)絡架構(gòu),例如 U-Net,無需進行使用非結(jié)構(gòu)化或隱式解碼表示時所需的復雜和定制化的網(wǎng)絡設(shè)計。

同時,通過最優(yōu)傳輸算法進行的結(jié)構(gòu)化組織最大程度地保持了相鄰高斯核之間的空間結(jié)構(gòu)關(guān)系,使得研究者僅使用經(jīng)典的 3D 卷積網(wǎng)絡就能高效地提取特征。更為關(guān)鍵的是,鑒于先前研究中的發(fā)現(xiàn),擴散模型在處理高維數(shù)據(jù)分布時表現(xiàn)不佳,本文提出的 GaussianCube 在保持高質(zhì)量重建的同時,顯著減少了所需的參數(shù)量,極大地緩解了擴散模型在分布建模上的壓力,為 3D 生成建模領(lǐng)域帶來了顯著的建模能力和效率提升。

方法

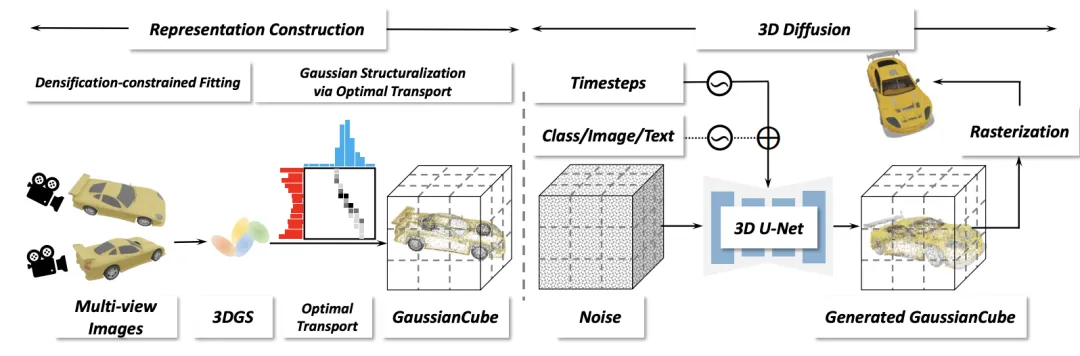

圖 5. GaussianCube 框架總覽

本文的框架包括兩個主要階段:表示構(gòu)建和三維擴散。在表示構(gòu)建階段,給定三維資產(chǎn)的多視角渲染圖,對其進行密度約束的高斯擬合,以獲得具有固定數(shù)量的三維高斯。隨后,通過最優(yōu)化傳輸將三維高斯結(jié)構(gòu)化為 GaussianCube。在三維擴散階段,研究人員對三維擴散模型進行訓練,以便從高斯噪聲中生成 GaussianCube。

圖 6. 密度約束的高斯擬合算法示意圖

在表示構(gòu)建階段,研究人員需要為每個三維資產(chǎn)創(chuàng)建適合生成建模的表示。考慮到生成領(lǐng)域往往需要建模的數(shù)據(jù)有統(tǒng)一的固定長度,而原始 3DGS 擬合算法中的自適應密度控制會導致擬合不同物體所使用的高斯核數(shù)量不同,這給生成建模帶來了極大挑戰(zhàn)。一種非常簡單的解決方案是直接去除自適應密度控制,但研究人員發(fā)現(xiàn)這會嚴重降低擬合的精度。本文提出了一種新穎的密度約束擬合算法,保留原始自適應密度控制中的剪枝操作,但對其中的分裂和克隆操作進行了新的約束處理。

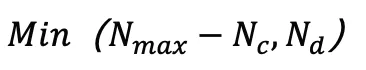

具體來說,假設(shè)當前迭代包括

個高斯,研究人員通過選擇那些在視角空間位置梯度幅度超過預定義閾值 τ 的高斯來識別分裂或克隆操作的候選對象,這些候選對象的數(shù)量記為

。為了防止超出預定義的最大值

個高斯,從候選對象中選擇

個具有最大視角空間位置梯度的高斯進行分裂或克隆。在完成擬合過程后,研究人員用 α=0 的高斯填充以達到目標計數(shù)

而不影響渲染結(jié)果。得益于此策略,可以實現(xiàn)了與類似質(zhì)量的現(xiàn)有工作相比參數(shù)量減少了幾個量級的高質(zhì)量表示,顯著降低了擴散模型的建模難度。

圖 7. 密度約束的高斯擬合算法示意圖

盡管如此,通過上述擬合算法得到的高斯仍然沒有明確的空間排列結(jié)構(gòu),這使得后續(xù)的擴散模型無法高效地對數(shù)據(jù)進行建模。為此,研究人員提出將高斯映射到預定義的結(jié)構(gòu)化體素網(wǎng)格中來使得高斯具有明確的空間結(jié)構(gòu)。直觀地說,這一步的目標是在盡可能保持高斯的空間相鄰關(guān)系的同時,將每個高斯 “移動” 到一個體素中。

研究人員將其建模為一個最優(yōu)傳輸問題,使用 Jonker-Volgenant 算法來得到對應的映射關(guān)系,進而根據(jù)最優(yōu)傳輸?shù)慕鈦斫M織將高斯組織到對應的體素中得到 GaussianCube,并且用當前體素中心的偏移量替換了原始高斯的位置,以減少擴散模型的解空間。最終的 GaussianCube 表示不僅結(jié)構(gòu)化,而且最大程度上保持了相鄰高斯之間的結(jié)構(gòu)關(guān)系,這為 3D 生成建模的高效特征提取提供了強有力的支持。

在三維擴散階段,本文使用三維擴散模型來建模 GaussianCube 的分布。得益于 GaussianCube 在空間上的結(jié)構(gòu)化組織關(guān)系,無需復雜的網(wǎng)絡或訓練設(shè)計,標準的 3D 卷積足以有效提取和聚合鄰近高斯的特征。于是,研究者利用了標準的 U-Net 網(wǎng)絡進行擴散,并直接地將原始的 2D 操作符(包括卷積、注意力、上采樣和下采樣)替換為它們的 3D 實現(xiàn)。

本文的三維擴散模型也支持多種條件信號來控制生成過程,包括類別標簽條件生成、根據(jù)圖像條件創(chuàng)建數(shù)字化身和根據(jù)文本生成三維數(shù)字資產(chǎn)。基于多模態(tài)條件的生成能力極大地擴展了模型的應用范圍,并為未來的 3D 內(nèi)容創(chuàng)造提供了強大的工具。

實驗結(jié)果

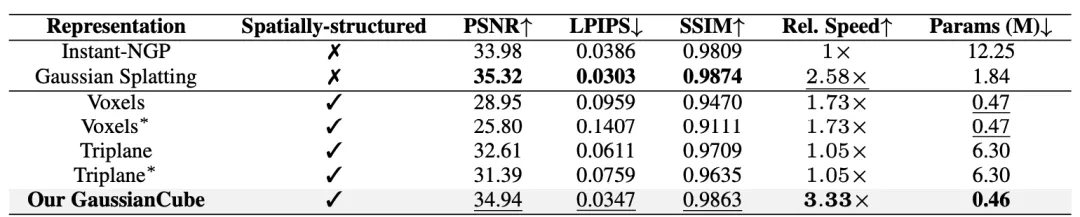

研究人員首先在 ShapeNet Car 數(shù)據(jù)集上驗證了 GaussianCube 的擬合能力。實驗結(jié)果表明,與基線方法相比,GaussianCube 可以以最快的速度和最少的參數(shù)量實現(xiàn)高精度的三維物體擬合。

表 1. 在 ShapeNet Car 上不同的三維表示關(guān)于空間結(jié)構(gòu)、擬合質(zhì)量、相對擬合速度、使用參數(shù)量的數(shù)值比較。? 表示不同物體共享隱式特征解碼器。所有方法均以 30K 次迭代進行評估。

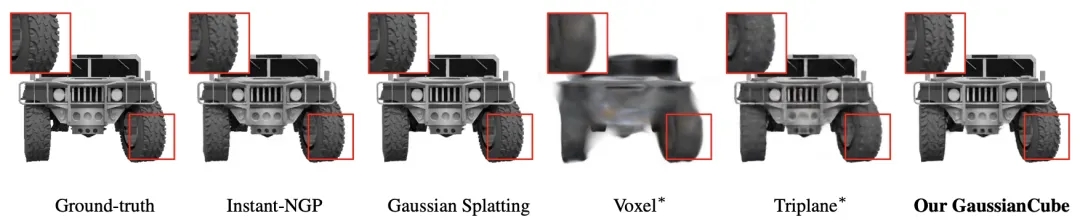

圖 8. 在 ShapeNet Car 上不同的三維表示擬合能力的視覺比較。? 表示不同物體共享隱式特征解碼器。所有方法均以 30K 次迭代進行評估。

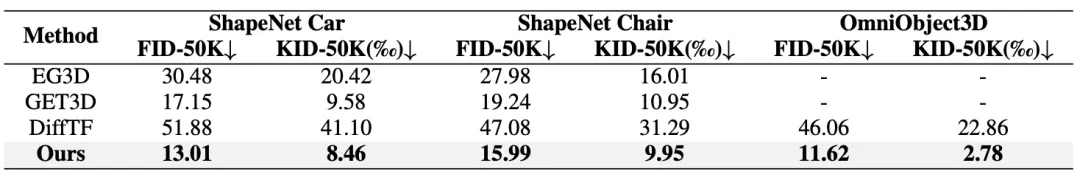

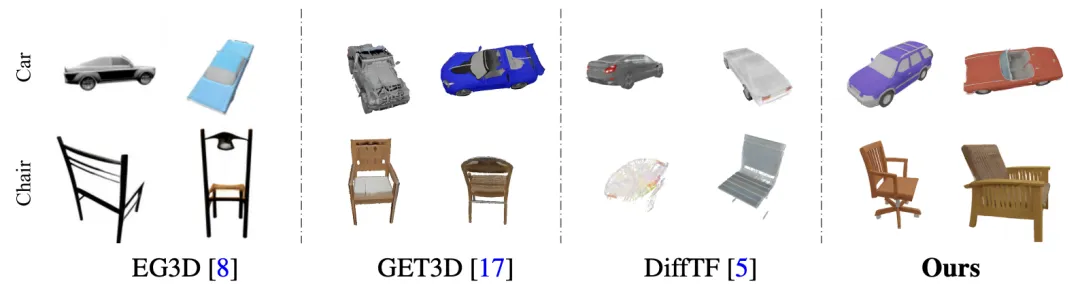

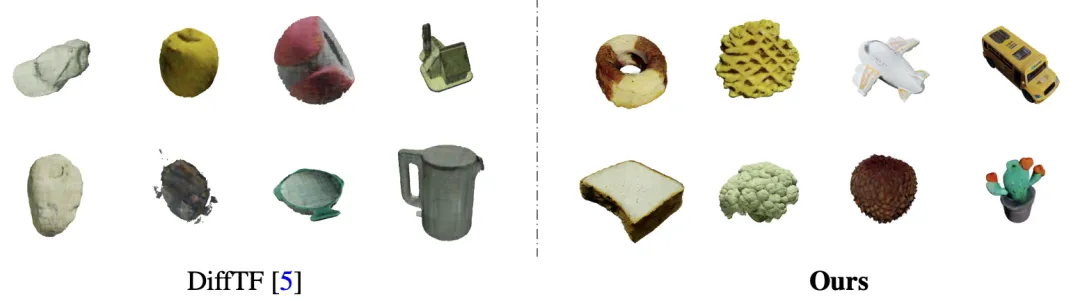

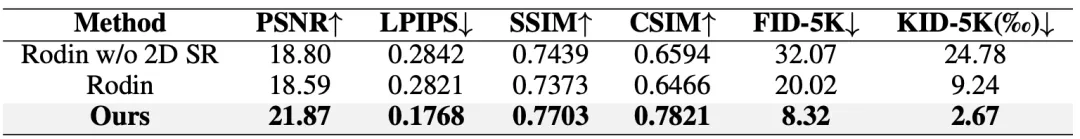

研究人員其次在大量數(shù)據(jù)集上驗證了基于 GaussianCube 的擴散模型的生成能力,包括 ShapeNet、OmniObject3D、合成數(shù)字化身數(shù)據(jù)集和 Objaverse 數(shù)據(jù)集。實驗結(jié)果表明,本文的模型在無條件和類別條件的對象生成、數(shù)字化身創(chuàng)建以及文本到 3D 合成從數(shù)值指標到視覺質(zhì)量都取得了領(lǐng)先的結(jié)果。特別地,GaussianCube 相較之前的基線算法實現(xiàn)了最高達 74% 的性能提升。

表 2. 在 ShapeNet Car、Chair 上進行無條件生成和在 OmniObject3D 上進行類別條件生成的定量比較。

圖 9. 在 ShapeNet Car、Chair 上進行無條件生成的定性比較。本文的方法可以生成精確幾何和細節(jié)材質(zhì)。

圖 10. 在 OmniObject3D 上進行類別條件生成的定性比較。本文方法可以生成明確語義的復雜物體。

表 3. 基于輸入肖像進行數(shù)字化身創(chuàng)建的定量比較。

圖 11. 基于輸入肖像進行數(shù)字化身創(chuàng)建的定性比較。本文的方法能夠更準確地還原輸入肖像的身份特征、表情、配飾和頭發(fā)細節(jié)。

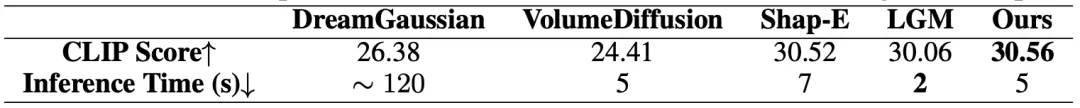

表 4. 基于輸入文本創(chuàng)建三維資產(chǎn)的定量比較。推理時間使用單張 A100 進行測試。Shap-E 和 LGM 與本文方法取得了相似的 CLIP Score,但它們分別使用了數(shù)百萬的訓練數(shù)據(jù)(本文僅使用十萬三維數(shù)據(jù)訓練),和二維文生圖擴散模型先驗。

圖 12. 基于輸入文本創(chuàng)建三維資產(chǎn)的定性比較。本文的方法可以根據(jù)輸入文本實現(xiàn)高質(zhì)量三維資產(chǎn)生成。

本文轉(zhuǎn)自 機器之心 ,作者:機器之心