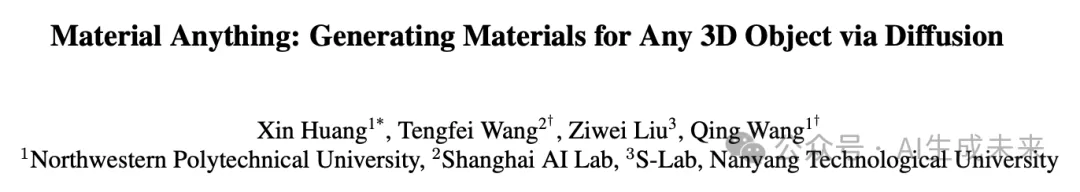

革新3D材質生成!Material Anything:端到端打造任意3D物體的高質量材質!

論文鏈接: https://arxiv.org/pdf/2411.15138

亮點直擊

- 提出了一種完全自動化、穩定且通用的模型,用于為多種3D對象生成物理材料,并達到了最先進性能水平。

- 提出了一種具有光照置信度的材料擴散模型,以便用一個模型處理各種光照條件。

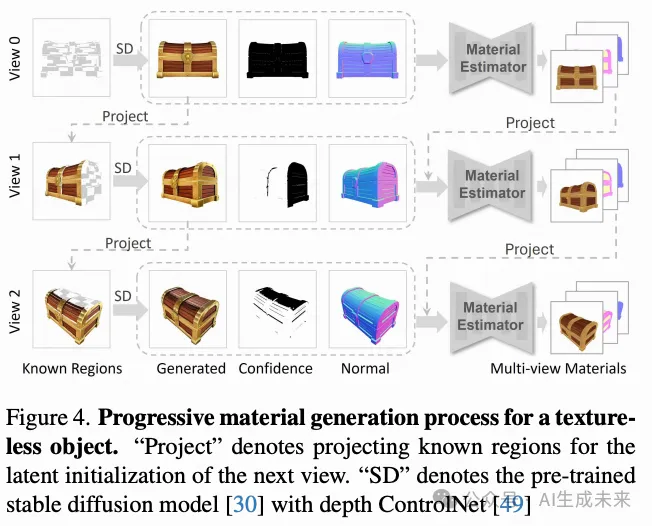

- 提出了一種由置信度 mask 引導的漸進材料生成方案,以及一種UV空間材料擴散模型,以生成一致且UV就緒的材料。

總結速覽

解決的問題

現有的3D對象材料生成方法通常依賴復雜的流程或特定案例的優化,難以在各種光照條件下穩定工作。需要一種能夠自動生成基于物理的材料,并在不同光照條件下表現優異的解決方案。

提出的方案

提出了Material Anything,這是一種全自動的統一擴散框架,能夠為3D對象生成基于物理的材料。該框架通過三頭架構和渲染損失來增強穩定性和材料質量,并引入置信度 mask 作為動態切換器,以處理不同光照條件下的有紋理和無紋理對象。

應用的技術

- 預訓練的圖像擴散模型

- 三頭架構與渲染損失

- 置信度 mask 作為動態切換器

- 由置信度 mask 引導的漸進材料生成策略

- UV空間材料精煉器

達到的效果

Material Anything 提供了一種穩定、通用的端到端解決方案,能夠在各種光照條件下生成高質量的物理材料。大量實驗表明,該方法在廣泛的對象類別和光照條件下優于現有方法,確保了輸出材料的一致性和UV就緒性。

方法

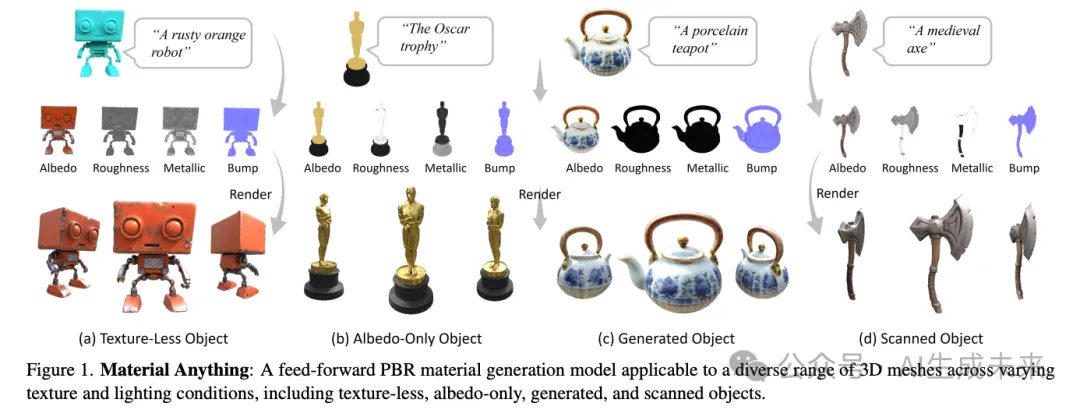

Material Anything,如下圖2所示,是一個為3D對象生成高質量物理材料的統一框架,能夠適應各種光照和紋理場景。它有效地處理以下情況:(1) 無紋理對象,(2) 僅有反照率的對象(無光照效果),(3) 掃描對象(真實光照),以及 (4) 生成對象(非真實光照)。與現有方法將這些場景視為獨立任務不同,我們的方法將它們統一在一個框架下。為此,我們將3D材料生成重新表述為基于圖像的材料估計任務,從而能夠使用預訓練的圖像擴散模型并簡化整體流程。

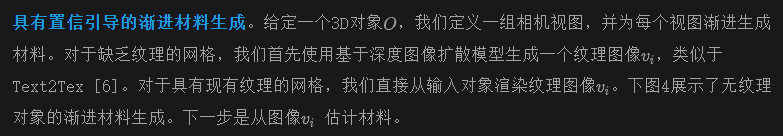

我們的框架圍繞兩個核心組件展開。首先,我們采用一個基于擴散的材料估計器,配備置信度 mask ,為輸入對象的每個視圖生成材料。接下來,我們引入了一種漸進材料生成策略,利用置信度 mask 確保生成材料在各視圖之間的一致性,并進一步集成了用于材料細化的UV空間擴散模型。最后,我們提供了Material3D數據集的構建細節。

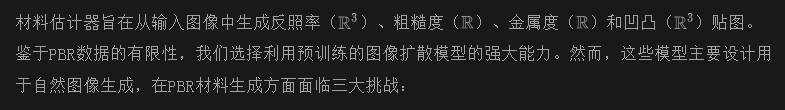

基于圖像的材料擴散

- 通道差距:圖像擴散模型通常在三個通道(RGB)上運行,而PBR材料需要超過三個通道(在我們的方法中為八個通道)。這種差異可能導致材料表示不準確,因為模型必須適應生成更復雜的輸出集。

- 域差距:PBR材料貼圖與自然圖像不同。這種顯著差異導致訓練不穩定和性能次優。

- 多樣化光照:最后,我們的材料估計器必須在具有不同光照條件的圖像中保持穩健,以確保一致的性能。

為了解決這些挑戰,我們引入了幾個關鍵組件。

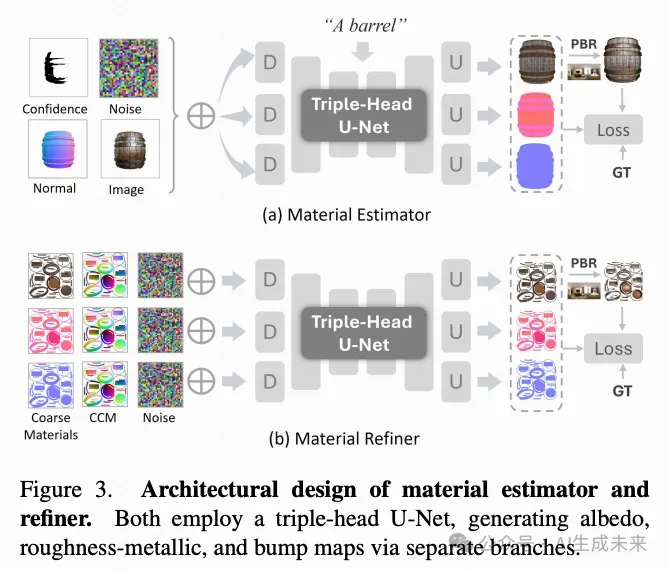

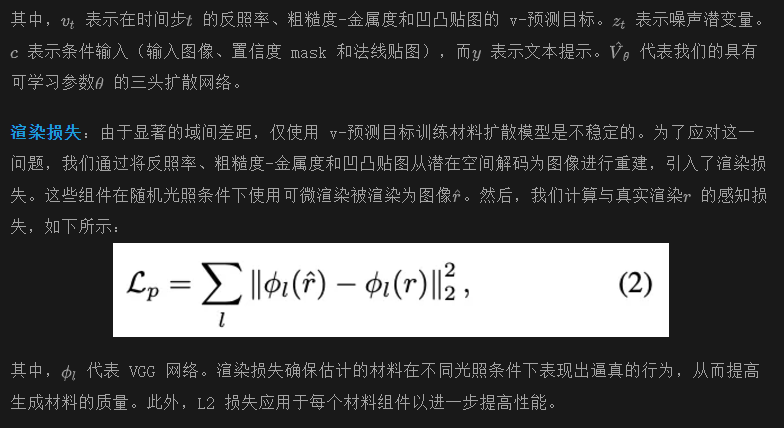

三頭擴散:為了使三通道擴散模型能夠處理多種材料特定通道,一種解決方案是訓練一個材料VAE。然而,這種方法可能會丟棄擴散模型的預訓練先驗,并且在我們有限的PBR數據上訓練定制的材料VAE具有挑戰性。受之前工作的啟發,我們設計了一個三頭U-Net架構,如下圖3(a)所示。U-Net架構包括初始卷積層和第一個下采樣塊的三個不同分支,隨后是共享的中間層,支持材料模態的并行去噪。最終的上采樣塊和輸出卷積層也分成三個分支。每個輸出頭生成一個特定的材料貼圖:一個反照率貼圖,一個組合的粗糙度-金屬度貼圖(R通道設為1,G為粗糙度,B為金屬度),以及一個凹凸貼圖。與將所有材料合并為一個輸出不同,這種三頭結構確保每個材料貼圖在生成時不相互干擾,同時保持它們之間的一致性。

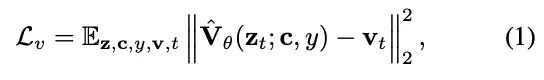

置信度自適應生成:為了管理具有各種光照條件的輸入,我們將這些條件分為兩大類:高置信度(例如,掃描對象)和低置信度(例如,無光照和生成光照)。為了指導模型,我們引入了一個表示光照置信度的確定性 mask 。對于具有真實光照的輸入,置信度值設為1,鼓勵擴散模型利用光照線索進行材料估計。相反,對于缺乏光照或具有生成光照的輸入,置信度設為0,引導模型專注于材料生成而非估計。需要注意的是,對于具有生成光照的圖像, mask 可以在已知材料區域選擇性地分配值1,而在其他地方分配0,以增強多視圖材料一致性,如逐步材料生成中詳細說明的。置信度 mask 使擴散模型能夠在材料估計和生成之間無縫過渡,有效管理真實和合成光照場景。學習目標是v-預測。

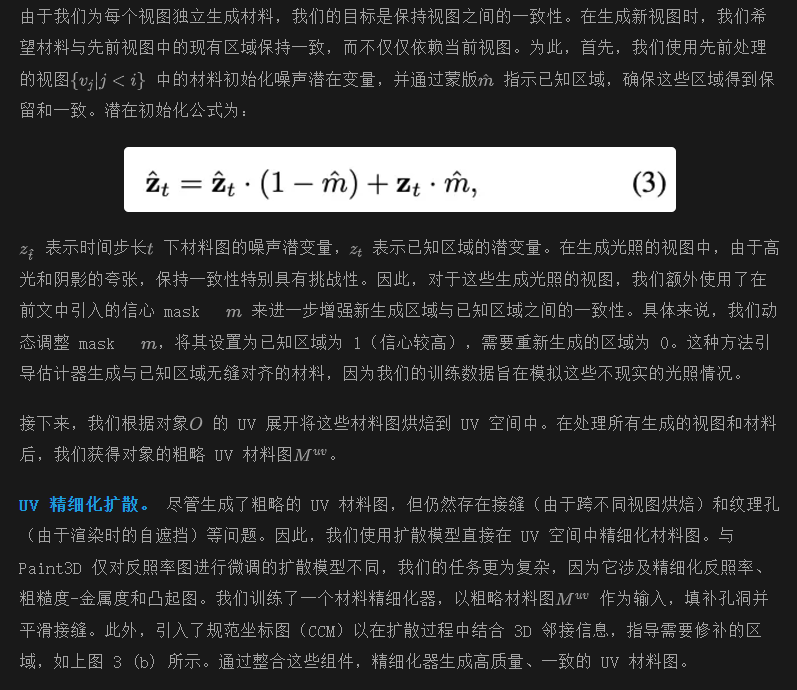

3D 對象的材料生成

雖然我們已經成功地為圖像估計了材料,但將材料估計器應用于3D對象的多個視圖會導致明顯的不一致。一個解決方案是訓練一個材料估計器,以同時預測多個視圖的材料,類似于多視圖擴散。然而,增加的視圖和通道數量對生成高分辨率材料構成了挑戰。為了使我們的2D材料估計器適應3D對象,我們提出了一種漸進生成策略,該策略基于前面提到的置信蒙版動態估計不同視點的材料。我們進一步將多視圖材料投影到UV空間,并應用一個細化擴散模型,該模型完成被遮擋區域并細化材料,確保無縫且一致的材料貼圖。

Material3D 數據集

為了訓練Material Anything模型,我們構建了一個名為Material3D的數據集,該數據集由從Objaverse 精選的80,000個高質量3D對象組成。數據集構建的詳細信息在補充材料中提供。對于每個模型,我們從10個固定的相機位置渲染了多視角材料圖像(反照率、粗糙度、金屬度、凸起)和法線貼圖。此外,還渲染了UV材料圖和CCM,以便于材料精煉器的訓練。為了使模型能夠處理多樣的光照場景,我們在渲染輸入圖像時加入了多種光照條件,包括點光源、區域光源、環境光照和無光照。此外,我們設計了一種策略來模擬推理過程中常見的不完善和不一致的光照條件。

模擬不一致的光照:我們隨機選擇在不同光照條件下拍攝的兩張圖像,用于一個相機視角,并在訓練過程中將每張圖像的一部分拼接成一個復合圖像。這使得單張圖像能夠展示兩種不同的光照類型,模擬多視角材料中的不一致性。此外,我們對其中一張圖像引入了降質效果,應用諸如模糊和色彩偏移等效果。使用信心 mask 來劃定降質區域。材料估計器的最終輸入包括拼接圖像、信心 mask 和法線貼圖。為了訓練材料精煉器,我們隨機遮蓋UV材料圖的某些區域,并將這些被遮蓋的材料圖作為輸入。CCM是從3D點坐標的UV映射中導出的,也包含在內。這些圖幫助指導需要修復的區域,并在擴散過程中促進3D鄰接信息的整合。

實驗

我們將我們的方法與紋理生成方法進行比較,包括 Text2Tex、SyncMVD 和 Paint3D 。此外,我們還將我們的方法與基于優化的材料生成方法進行評估,如 NvDiffRec 和 DreamMat ,以及一種基于檢索的方法 Make-it-Real 。最后,我們也包括與閉源方法 Rodin Gen-1 和 Tripo3D 的比較。

定性評估

與紋理生成方法的比較。 我們在下圖5中將Material Anything與各種紋理生成方法進行了比較。這些方法采用相似的策略,使用預訓練的圖像擴散模型為無紋理的網格上色。然而,擴散模型生成的光照信息通常導致紋理中出現顯著的偽影,因為它們受到多個生成圖像中復雜光照條件的影響。相比之下,我們的方法生成的紋理更加清晰,并且固有地包含材料屬性,從而為下游應用提供了強有力的支持。

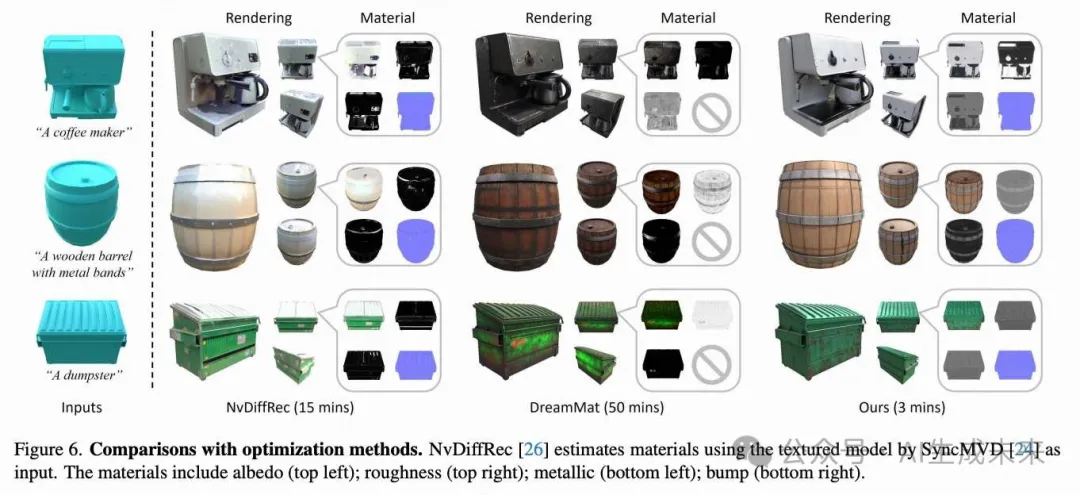

與優化方法的比較。 我們在下圖6中將我們的方法與優化方法進行了比較。這些方法需要為每個對象進行大量的優化時間,并且難以準確識別對象的材料。相比之下,我們的方法能夠有效地區分材料,如在桶的示例中,它準確地表示了金屬箍和木板。這一能力突顯了我們的方法在生成逼真且多樣的材料圖方面的優越性。

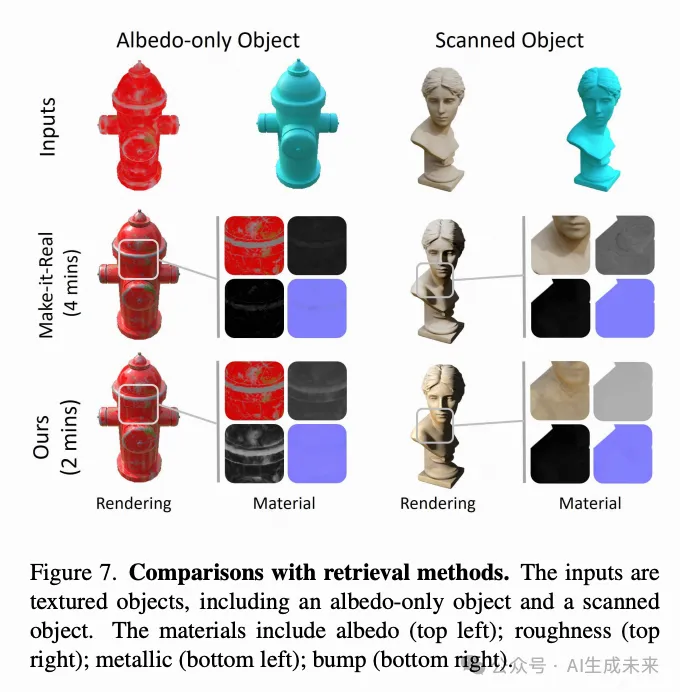

與檢索方法的比較。 對于已有紋理的輸入對象,我們與檢索方法Make-it-Real進行了比較,如下圖7所示。Make-it-Real基于初始紋理的分割來檢索材料,這存在若干局限性。首先,分割過程難以準確捕捉小區域,例如消防栓上的剝落油漆。此外,它在去除初始紋理中的陰影時遇到困難,如雕塑示例中陰影反照率所示。相比之下,我們的方法生成的材料更為準確,更好地保留了細節,并去除了諸如陰影之類的偽影。

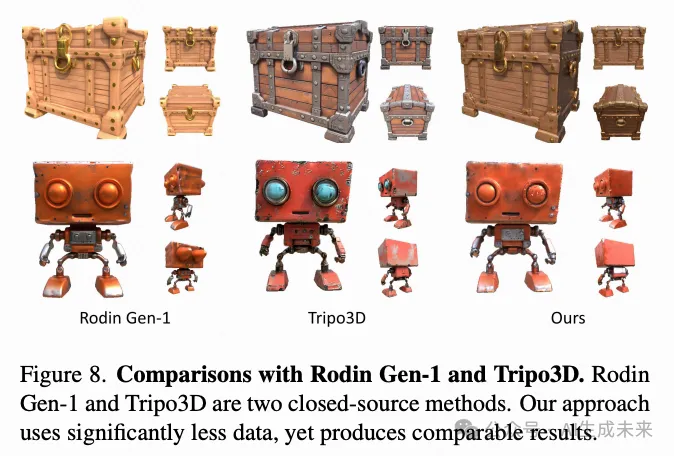

與Tripo3D和Rodin Gen-1的比較。 我們在下圖8中將我們的方法與兩個閉源方法Tripo3D和Rodin Gen-1進行了比較。我們使用Tripo3D生成的無紋理網格作為材質生成的輸入。此外,我們通過圖像擴散模型為Rodin Gen-1提供正視圖圖像,以確保生成相同的3D對象。盡管Tripo3D和Rodin Gen-1利用了顯著更大規模的訓練數據集,我們的方法仍能產生可比的結果。

定量評估

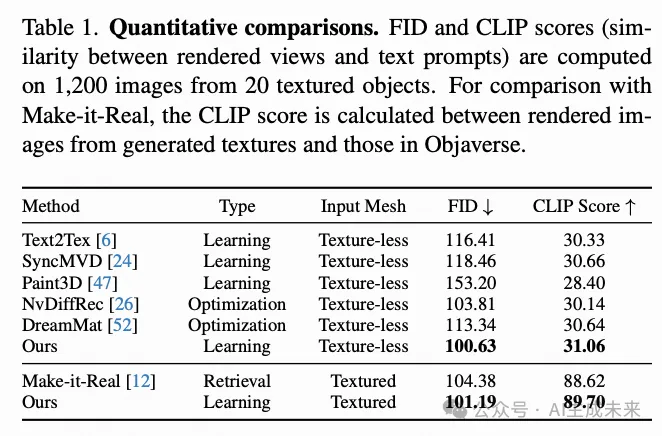

我們的方法的定量評估結果如下表1所示。正如所示,我們的方法實現了更低的FID分數,這表明我們生成的紋理在分布上更接近Objaverse中的紋理。此外,我們方法的更高CLIP分數顯示了其生成紋理與提示更準確對齊的能力。

消融研究

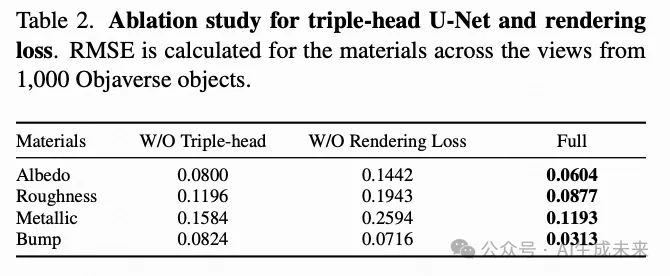

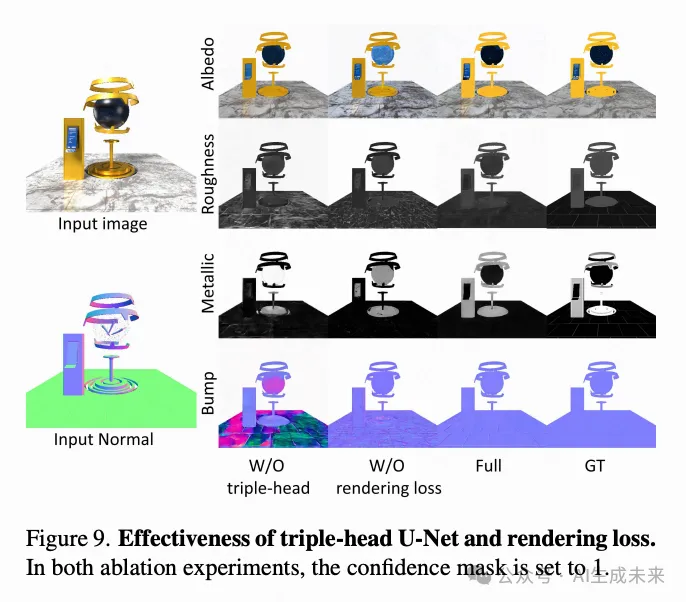

三頭U-Net的有效性。 我們評估了使用普通U-Net架構的方法性能,該架構直接生成所有材料作為12通道潛變量,而不是使用三頭U-Net。如下表2所示,由于在輸出單個12通道潛變量時材料之間的耦合效應,性能下降。在下圖9中,這種耦合效應很明顯,凸起由于反射率的干擾被錯誤上色。相比之下,三頭U-Net有效地解耦了材料。此外,三個頭共享的主干網絡確保了不同材料圖之間的一致性。

渲染損失的有效性。 在上表2中,我們展示了在沒有渲染損失的情況下訓練的方法的定量結果。值得注意的是,與包含渲染損失的變體相比,此消融實驗中的性能更差。如上圖9所示,沒有渲染損失的版本表現出明顯的細節退化,材料視圖中出現可見的偽影。渲染損失作為圖像空間中的附加約束,確保了在不同光照條件下的一致性,提高了訓練的穩定性,并有助于捕捉更細微的材料特性。結果突顯了渲染損失在增強材料估計器的保真度和穩定性方面的關鍵作用。

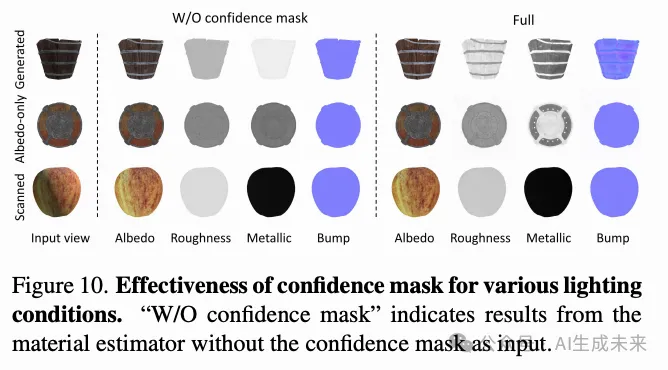

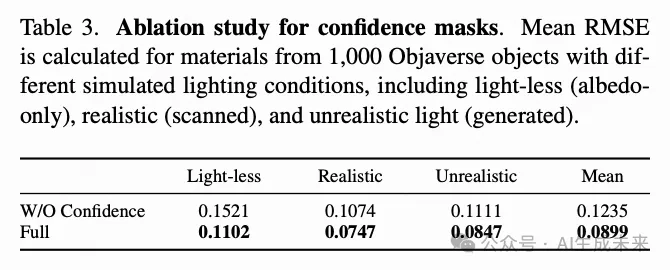

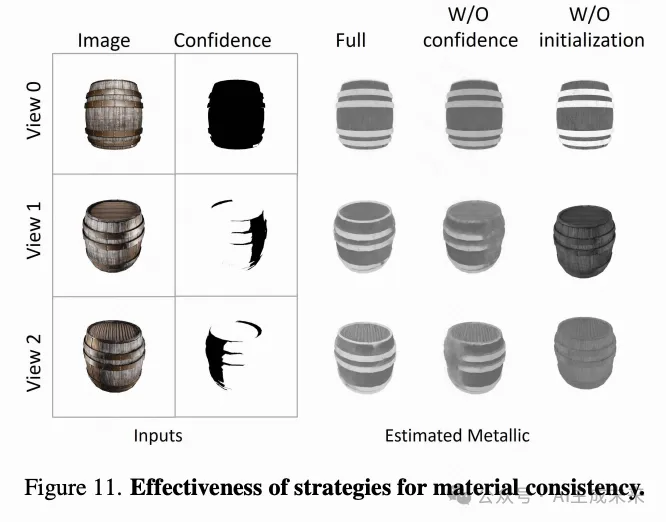

信心 mask 的有效性。 如下圖10所示,沒有信心 mask 的材料估計器在不同光照條件下難以生成高質量的材料。相反,在信心 mask 的指導下,模型能夠很好地適應這些輸入變化。下表3展示了在不同光照條件下,模型在Objaverse對象上沒有信心 mask 的定量結果,揭示了材料準確度的顯著下降。此外,對于具有生成光照的對象,缺乏信心 mask 的漸進生成也在材料圖中顯示出明顯的不一致,如下圖11所示。相反,使用信心 mask 后,模型能夠區分用于估計和生成的區域。通過引導訓練過程專注于相關區域,我們的方法實現了更加一致、無偽影的材料。這些結果表明,信心 mask 改善了材料的一致性,并解決了光照變化問題。

已知材料初始化的有效性。 上圖11展示了未使用其他視圖的已知材料進行初始化的方法結果。如圖所示,預測的金屬特性在不同視圖中顯示出明顯的變化。相比之下,通過基于已知材料的漸進生成,我們的方法在多個視圖中生成了更一致的材料。

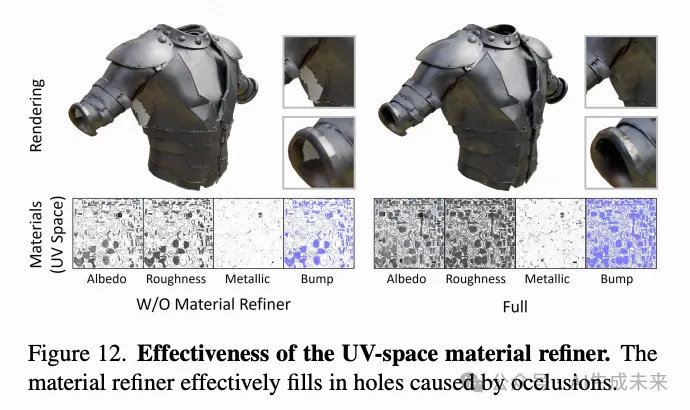

UV空間材料精細化器的有效性。 在下圖12中,展示了沒有UV精細化的結果。如圖所示,由于自遮擋,預測的材料中出現了幾個孔洞,導致材料圖不完整。在應用我們的材料精細化器后,這些孔洞被有效填補,結果是更加無縫和完整的材料表示。我們的材料精細化器能夠處理遮擋并提高整體材料生成質量。

結論

Material Anything,這是一個統一的框架,用于生成各種3D對象的PBR材質,包括無紋理、僅反照率、生成的和掃描的網格。通過利用精心設計的材質擴散模型,方法可以以前饋的方式生成高保真材質。為了解決復雜光照條件下的各種輸入對象的統一性,引入了一種 mask 來指示不同光照的置信水平,這也增強了多視角材質的一致性。大量實驗表明,我們的方法可以為各種對象生成高質量的PBR材料,并且明顯優于現有方法。

本文轉自AI生成未來 ,作者:AI生成未來