OpenAI的o1是萬金油嗎?專家為思維鏈“潑冷水”!研究發現:這三種任務不適合讓AI“想太多” 原創

出品 | 51CTO技術棧(微信號:blog51cto)

別想太多!這句勸解有一定道理,在很多問題上過度思考反而會適得其反!

AI是否也會這樣呢?

自 OpenAI 的 o1 推出后,思維鏈成為了 AI 能力升級的一個新方向。

掌握了“慢思考”的 AI ,通過思維鏈的逐步推理,大幅提高了模型理解問題的深度和準確性。o1在國際數學奧林匹克(IMO)資格考試中取得了 83% 的驚人準確率,讓人直呼逆天。

圖片

圖片

這種提升,正來源于 AI 對人類解決問題時逐步思考過程的模仿。

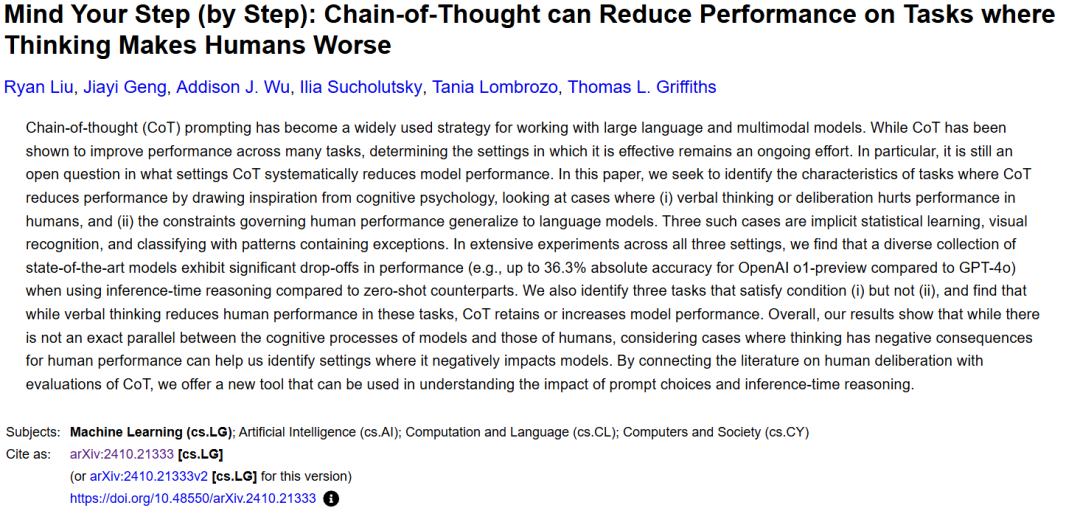

受到人類認知心理學的啟發,普林斯敦大學和紐約大學的團隊合作,希望驗證在哪些特定任務中,思維鏈會對 AI 的任務表現起到負面作用。

圖片

圖片

先甩個結論:在人類不能“想太多”的任務上,有半數任務中思維鏈同樣起到了負向作用,分別是:隱式統計學習(Implicit Statistical Learning, ISL)、面部識別(Face Recognition, FR)和含有例外的數據分類(Classification of Data with Exceptions, CDE)。

1.6個人類不適合過度思考的任務,AI中了三個

過度思考降低人類能力的任務,也可能是CoT損害模型性能的任務。

順著這個思路,該研究團隊找到了6個人類不能“想太多”的任務。

圖片

圖片

根據論文,人類不適合的過度思考的六種任務可以分為兩類:

1. 隱式統計學習(上圖中:ISL):分類由人工語法生成的字符串。在這項任務中,人如果過度思考,反而會干擾潛意識中的統計規律學習,導致表現下降。

2. 面部識別(上圖中:FR):從一組具有相似描述的面孔中識別特定的臉。若過度思考,會破壞直覺性的視覺識別過程,影響識別準確率。

3. 含有例外的數據分類(上圖中:CDE):在存在例外的情況下學習標簽。過度思考會導致對規則的過度概括,忽略例外情況,從而降低準確性。

4. 自然語言推理(上圖中:NLI):識別邏輯上的不一致。過度思考可能使人們更容易忽視邏輯不一致性。

5. 空間直覺(上圖中:SI):傾斜水杯的判斷。若人過度思考,則可能干擾直覺性的空間判斷。

6. 工作記憶(上圖中:WM):聚合文本中描述的多個特征以做出決策。過度思考容易使人信息過載,影響決策質量。

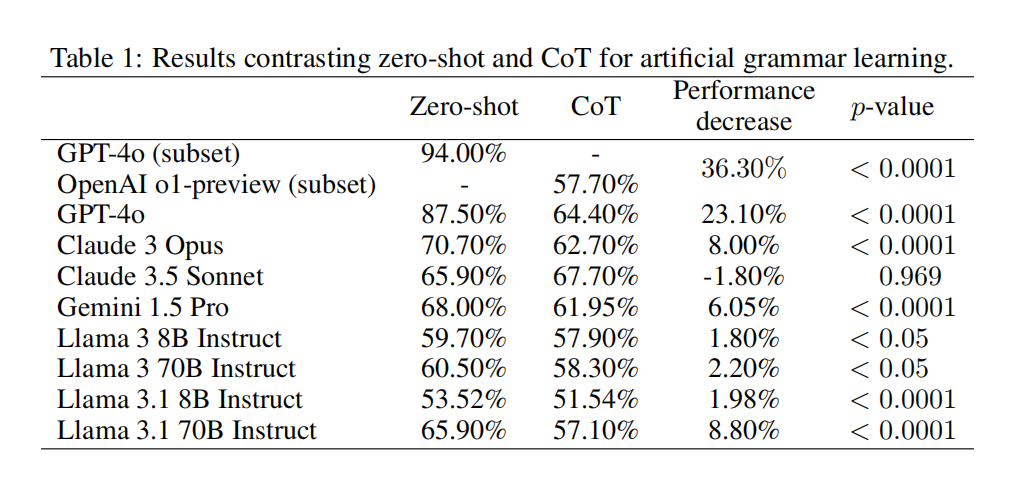

在實驗中,除了 o1 以外, GPT-4o, Claude 3.5 Sonnet, Claude 3 Opus, Gemini 1.5 Pro 等主流模型也都被測到了。除了 o1 自帶思維鏈,其他的模型則使用了一句簡單的Prompt“Please reason about your answer before answering “Yes” or “No”(請在回答是或否前進行推理)”,人為配置了思考過程。

結果表明,在前三項任務中,模型性能都同人一樣,出現了下降。

圖片

圖片

上圖:任務一結果,OpenAIo1預覽版,與GPT-4o 直給答案相比,絕對精度降低了36.3%。

不過,也有三個任務 AI 并未受到思考過度的干擾,這體現了人類與 AI 能力的不同。

2.AI不受影響的任務,以及為什么?

在自然語言推理任務中,CoT通常使得模型能力不降反升。

尤其在GPT-4o中,CoT對MNLI和SNLI(數據集名)的性能提高了40%以上。然而,在直給答案的Prompt引導下表現最好的模型——Gemini 1.5 Pro中,研究卻看到了CoT造成的性能下降。

這說明,在自然語言推理任務下,思維鏈能幫助推理“底子”較弱的模型提升邏輯推理能力。

第二,在空間直覺任務上,CoT對模型性能的影響未有統計學的意義。原因很簡單:LLM沒有直覺!在如何傾斜水杯,水杯中的水會溢出來的這個問題上,模型不具有人類所有的運動模擬能力,物理模型仍然留待突破。

最后,在工作記憶任務上,CoT 也通常使得模型的性能得到提升。

在這個任務中,參與者被展示了48個有關公寓的描述,其中這些陳述描述了四個公寓選擇中的一個積極、消極或中性的方面。在要求人類進行選擇時,大多數人會做出糟糕的判斷。

不過,由于模型記憶容量遠超人類,不易出現信息過載現象,因此逐步思考后,保持了良好的決策水平。

??http://www.ekrvqnd.cn/aigc/??