OpenAI o1引發(fā)的思維鏈思考:思維鏈提示啟發(fā)大模型推理

摘要:

我們探索了生成一個(gè)思維鏈(一系列中間推理步驟)可以怎樣顯著提高大型語言模型執(zhí)行復(fù)雜推理的能力。特別是,我們展示了這種推理能力是如何通過一種稱為思維鏈提示的簡單方法,在足夠大的語言模型中自然出現(xiàn)的,其中提供了一些思維鏈演示作為提示的示例。

在三個(gè)大型語言模型上的實(shí)驗(yàn)表明,思維鏈提示可以提高一系列算術(shù)、常識(shí)和符號(hào)推理任務(wù)的性能。經(jīng)驗(yàn)收益可能是驚人的。例如,用只有八個(gè)思維鏈?zhǔn)纠齺硖崾綪aLM 540B在數(shù)學(xué)應(yīng)用題集GSM8K基準(zhǔn)測試上達(dá)到了非常先進(jìn)的精度,甚至超過了帶有驗(yàn)證器微調(diào)過的GPT-3。

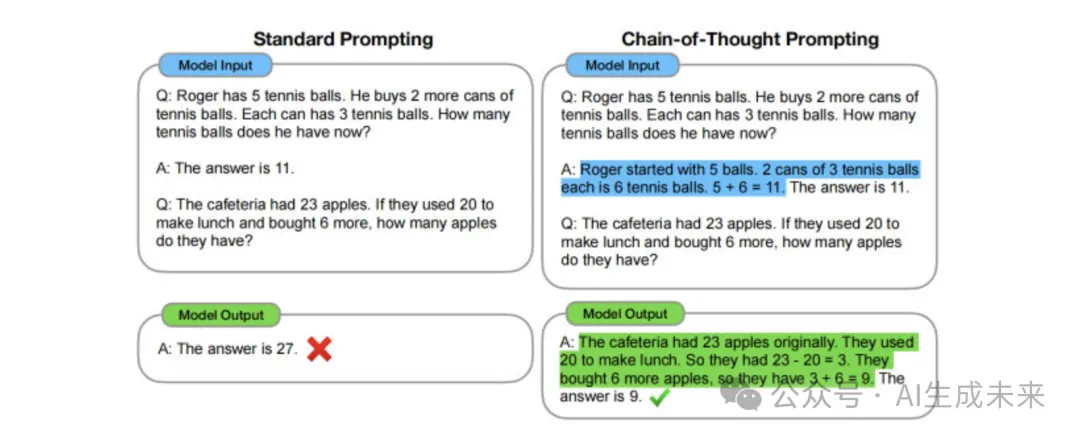

圖1:思維鏈提示使大型語言模型能夠處理復(fù)雜的算法、常識(shí)和符號(hào)推理任務(wù)。思維鏈推理過程已被高亮顯示。

1、簡介

NLP領(lǐng)域最近被語言模型徹底改變了。擴(kuò)大語言模型的規(guī)模已被證明可以帶來一系列好處,例如提升的性能和樣本效率。然而,僅擴(kuò)大模型尺寸還不足以在具有挑戰(zhàn)性的任務(wù)中取得更好的表現(xiàn),例如算術(shù)、常識(shí)和符號(hào)推理方面。

這項(xiàng)工作探討了如何通過一種由兩個(gè)想法驅(qū)動(dòng)的簡單方法來解鎖大型語言模型的推理能力。首先,算術(shù)推理技術(shù)可以從生成自然語言基本原理(產(chǎn)生最終答案)中受益。先前的工作使模型能夠具有通過從頭開始訓(xùn)練或微調(diào)預(yù)訓(xùn)練模型來生成自然語言的中間步驟的能力,此外還有使用形式語言而不是自然語言的神經(jīng)符號(hào)方法。其次,大型語言模型提供了令人興奮的可能性,可以通過提示進(jìn)行上下文少樣本學(xué)習(xí)。也就是說,可以簡單地用幾個(gè)演示任務(wù)的輸入-輸出示例“提示”模型,替代掉為每個(gè)新任務(wù)微調(diào)單獨(dú)的語言模型檢查點(diǎn)。值得注意的是,這在一系列簡單的問答任務(wù)中取得了成功。

然而,上述兩種想法都有嚴(yán)重的局限性。對(duì)于基本原理,增強(qiáng)訓(xùn)練和微調(diào)方法,創(chuàng)建大量高質(zhì)量的基本原理成本很高,這比普通機(jī)器學(xué)習(xí)中使用的簡單輸入輸出對(duì)更復(fù)雜。對(duì)于Brown等人使用的傳統(tǒng)少量樣本提示方法,它在需要推理能力的任務(wù)上效果不佳,并且通常不會(huì)隨著語言模型規(guī)模的增加而顯著提高. 在本文中,我們結(jié)合了這兩種觀點(diǎn)的優(yōu)點(diǎn),避免了它們的局限性。

具體來說,我們探索了語言模型在給定由三元組組成的提示(輸入、思維鏈、輸出)的情況下,對(duì)推理任務(wù)執(zhí)行少量樣本提示的能力。思維鏈?zhǔn)且幌盗袑?dǎo)致最終輸出的中間自然語言推理步驟,我們將這種方法稱為思維鏈提示。示例提示如圖1所示。

我們對(duì)算術(shù)、常識(shí)和符號(hào)推理基準(zhǔn)進(jìn)行了實(shí)證評(píng)估,表明思維鏈提示優(yōu)于標(biāo)準(zhǔn)提示,有時(shí)甚至達(dá)到了驚人的程度。

圖2:PaLM 540B使用思維鏈提示在GSM8K數(shù)學(xué)應(yīng)用題題基準(zhǔn)上實(shí)現(xiàn)了最先進(jìn)的性能。Cobbe等人(2021)對(duì)GPT-3進(jìn)行了微調(diào),并得出了之前的最佳結(jié)果。

圖2展示了一個(gè)這樣的結(jié)果——在數(shù)學(xué)應(yīng)用題GSM8K基準(zhǔn)測試中,使用PaLM 540B的思維鏈提示優(yōu)于標(biāo)準(zhǔn)提示,并達(dá)到了新的最先進(jìn)的性能。僅僅提示的方法就很重要,因?yàn)樗恍枰笮陀?xùn)練數(shù)據(jù)集,也因?yàn)閱蝹€(gè)模型檢查點(diǎn)可以執(zhí)行許多任務(wù)而不失一般性。這項(xiàng)工作重點(diǎn)說明大型語言模型可以通過幾個(gè)例子學(xué)習(xí)關(guān)于任務(wù)的自然語言數(shù)據(jù)(通過大型訓(xùn)練數(shù)據(jù)集作為輸入和輸出基礎(chǔ)的自動(dòng)學(xué)習(xí)模式)。

2、思維鏈提示

在解決復(fù)雜的推理任務(wù)時(shí)(如多步驟數(shù)學(xué)應(yīng)用題),考慮一下自己的思考過程。通常會(huì)將問題分解為多個(gè)中間步驟并在給出最終答案之前解決每個(gè)步驟的問題:“簡給媽媽2朵花后,她有10朵花……然后給爸爸3朵花后,他會(huì)有7朵花……所以答案是7。”

本文的目標(biāo)是賦予語言模型生成類似思維鏈的能力——一系列連貫的產(chǎn)生問題最終答案的中間環(huán)節(jié)推理步驟。我們將證明,如果在示例中為少樣本提示提供了思維鏈推理的演示,那么足夠大的語言模型可以生成思維鏈。

圖1顯示了一個(gè)模型的示例,該模型產(chǎn)生了一個(gè)思維鏈來解決一個(gè)數(shù)學(xué)應(yīng)用題,否則它會(huì)出錯(cuò)。在這種情況下,思維鏈類似于解決方案,可以被解釋為一個(gè)解決方案,但我們?nèi)匀贿x擇稱之為思維鏈,以更好地捕捉到它模仿了一個(gè)循序漸進(jìn)的思維過程來得出答案的想法(而且,解決方案/解釋通常在最終答案之后出現(xiàn))。

思維鏈提示作為一種促進(jìn)語言模型推理的方法具有幾個(gè)吸引人的特性:

1.首先,原則上,思維鏈允許模型將多步問題分解為多個(gè)中間步驟,這意味著可以將額外的計(jì)算分配給需要更多推理步驟的問題。

2.其次,思維鏈為模型的行為提供了一個(gè)可解釋的窗口,表明它是如何得出特定答案的,并提供了調(diào)試出錯(cuò)的推理路徑的機(jī)會(huì)(盡管充分描述模型的支持答案的計(jì)算仍然是一個(gè)懸而未決的問題)。

3.第三,思維鏈推理可用于數(shù)學(xué)應(yīng)用題、常識(shí)推理和符號(hào)操縱等任務(wù),并且潛在的適用于(至少在原則上)人類可以通過語言解決的任何任務(wù)。

4.最后,在足夠大的現(xiàn)成語言模型中,只需將思維鏈序列的示例包含在少樣本提示的示例中,就可以很容易地引出思維鏈推理。

在實(shí)證實(shí)驗(yàn)中,我們將觀察思維鏈提示對(duì)算術(shù)推理(第3節(jié))、常識(shí)推理(第4節(jié))和符號(hào)推理(第5節(jié))的效用。

3、算術(shù)推理

我們首先考慮圖1中形式的數(shù)學(xué)應(yīng)用題,它衡量了語言模型的算術(shù)推理能力。雖然對(duì)人類來說很簡單,但算術(shù)推理是一項(xiàng)語言模型經(jīng)常遇到困難的任務(wù)。引人注目的是,當(dāng)與540B參數(shù)語言模型一起使用時(shí),思維鏈提示在多個(gè)任務(wù)上的表現(xiàn)與特定任務(wù)的微調(diào)模型相當(dāng),甚至在具有挑戰(zhàn)性的GSM8K基準(zhǔn)測試上達(dá)到了新的技術(shù)水平。

3.1 實(shí)驗(yàn)設(shè)置

我們在多個(gè)基準(zhǔn)上探索了各種語言模型的思維鏈提示。

基準(zhǔn):

我們考慮以下五個(gè)數(shù)學(xué)單詞問題基準(zhǔn):

(1)GSM8K數(shù)學(xué)應(yīng)用題的基準(zhǔn)測試,

(2)具有不同結(jié)構(gòu)的數(shù)學(xué)題的SVAMP數(shù)據(jù)集,

(3)各種數(shù)學(xué)題的ASDiv數(shù)據(jù)集,

(4)代數(shù)題的AQuA數(shù)據(jù)集,

以及(5)MAWPS基準(zhǔn)測試。附錄表12中給出了示例問題。

標(biāo)準(zhǔn)提示:

對(duì)于基線,我們考慮Brown等人推廣的標(biāo)準(zhǔn)少樣本提示,其中在輸出測試時(shí)間示例的預(yù)測之前,給大語言模型輸入-輸出對(duì)的上下文示例。示例的格式為問題和答案。該模型直接給出了答案,如圖1(左)所示。

思維鏈提示:

我們提出的方法是用一個(gè)思維鏈來增強(qiáng)提示中每個(gè)示例,以獲得相關(guān)答案,如圖1(右)所示。由于大多數(shù)數(shù)據(jù)集只有一個(gè)評(píng)估分割,我們手動(dòng)組合了一組八個(gè)帶有思維鏈的示例用于提示——圖1(右)顯示了一個(gè)思維鏈?zhǔn)纠戒洷?0給出了全套示例。(這些特定的示例沒有經(jīng)過及時(shí)的工程設(shè)計(jì);穩(wěn)健性在第3.4節(jié)和附錄A.2中進(jìn)行了研究。)為了調(diào)查這種形式的思維鏈提示是否可以成功地引發(fā)一系列數(shù)學(xué)應(yīng)用題的成功推理,我們將這八個(gè)思維鏈?zhǔn)纠糜谒谢鶞?zhǔn)測試,除了AQuA(它是多項(xiàng)選擇而不是自由反應(yīng))。對(duì)于AQuA,我們使用了訓(xùn)練集中的四個(gè)示例和解決方案,如附錄表21所示。

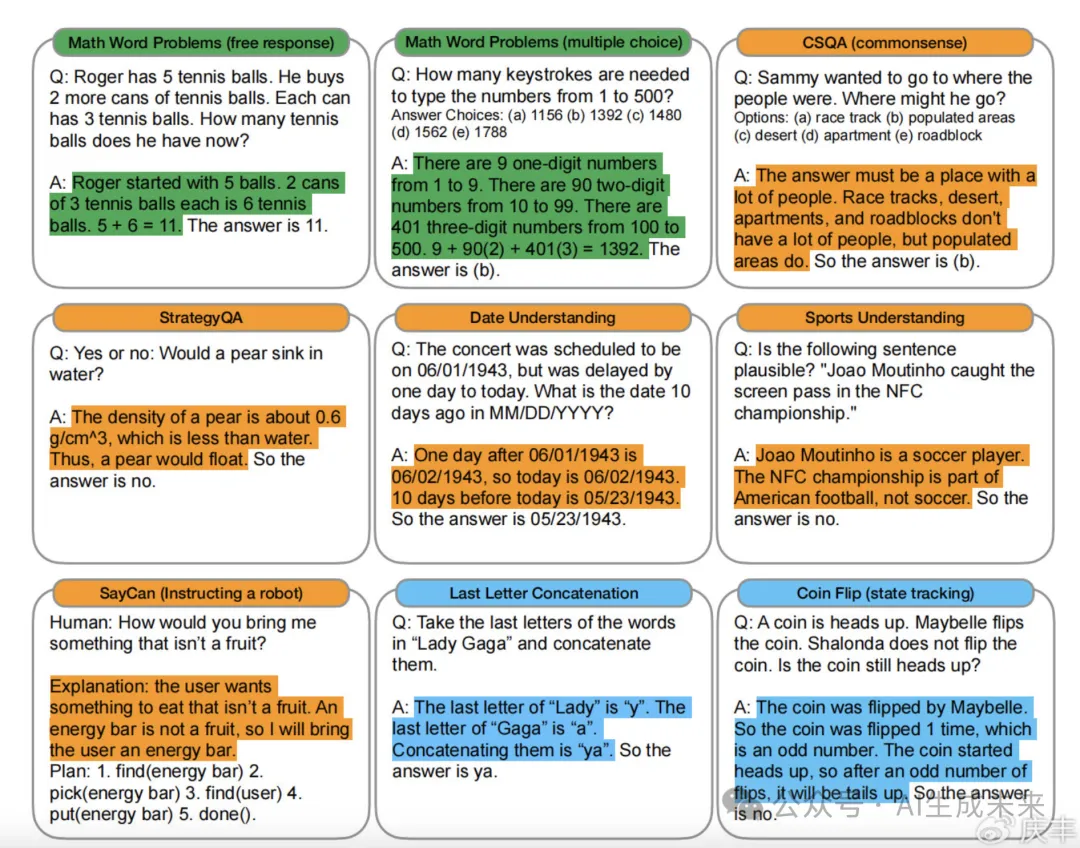

圖3:算術(shù)、常識(shí)和符號(hào)推理基準(zhǔn)的輸入、思維鏈、輸出三元組示例。思維鏈被高亮顯示。附錄G中的完整提示。

語言模型:

我們評(píng)估了五種大型語言模型。

第一個(gè)是GPT-3,我們使用text-ada-001、text-babbage-001、text-curie-001和text-davinci-002,它們可能對(duì)應(yīng)于350M、1.3B、6.7B和175B參數(shù)的InstructGPT模型。第二個(gè)是LaMDA,它有422M、2B、8B、68B和137B參數(shù)的模型。第三個(gè)是PaLM,它有8B、62B和540B參數(shù)的模型。第四個(gè)是UL2 20B,第五個(gè)是Codex。

我們通過貪婪解碼從模型中采樣(盡管后續(xù)工作表明,通過在許多采樣代中獲得多數(shù)最終答案,可以改善思維鏈提示)。對(duì)于LaMDA,我們報(bào)告了五個(gè)隨機(jī)種子的平均結(jié)果,其中每個(gè)種子具有不同的隨機(jī)混洗的示例順序。由于LaMDA實(shí)驗(yàn)在不同種子之間沒有顯示出很大的差異,為了節(jié)省計(jì)算,我們報(bào)告了所有其他模型的單個(gè)樣本順序的結(jié)果。

3.2、結(jié)果

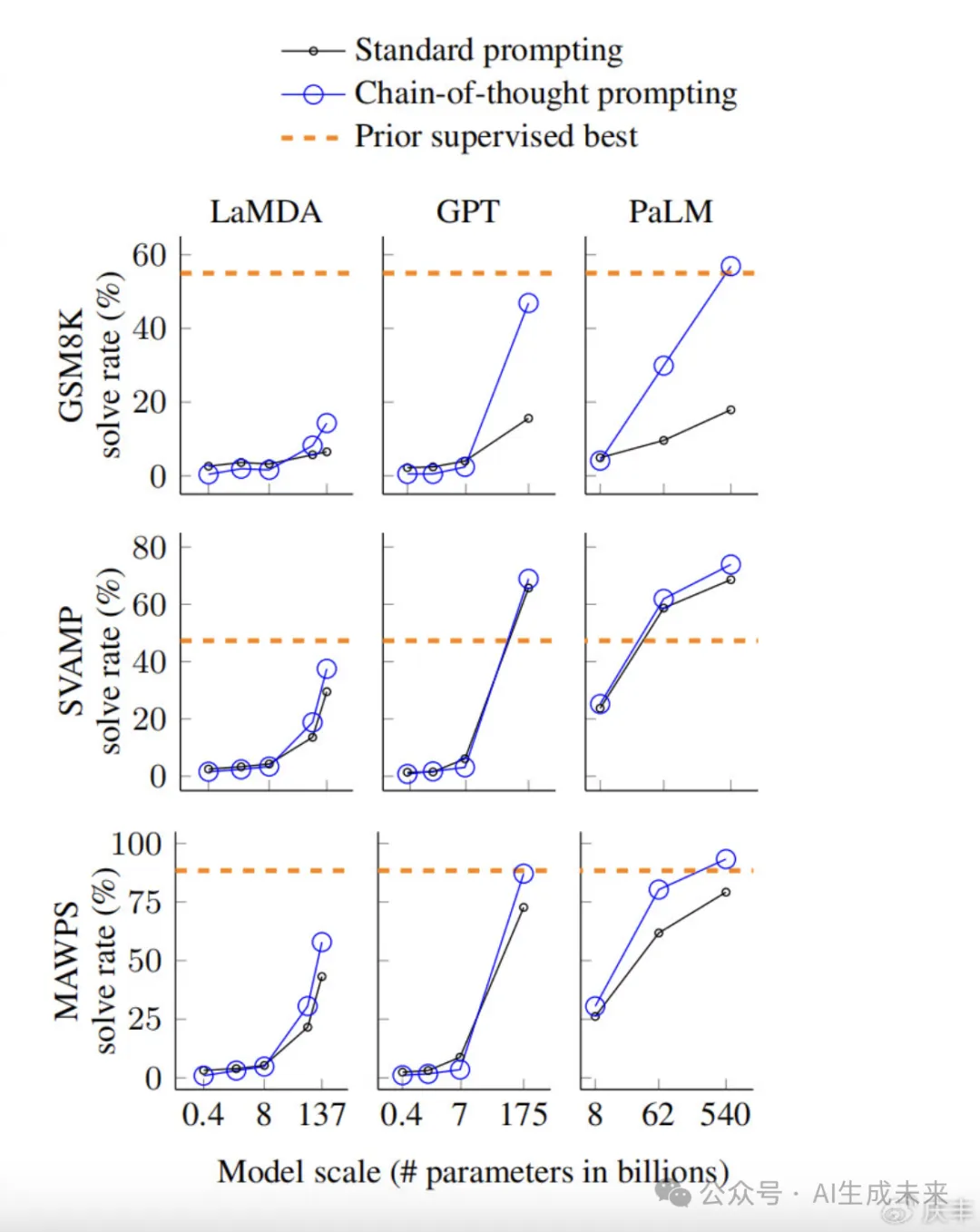

圖4總結(jié)了思維鏈提示的最強(qiáng)結(jié)果,每個(gè)模型集合、模型大小和基準(zhǔn)的所有實(shí)驗(yàn)輸出如附錄表2所示。

有三個(gè)關(guān)鍵要點(diǎn)。

圖4:思維鏈提示使大型語言模型能夠解決具有挑戰(zhàn)性的數(shù)學(xué)問題。值得注意的是,思維鏈推理是一種增加模型規(guī)模的新興能力。之前的最佳數(shù)字來自Cobbe等人(2021年)的GSM8K、Jie等人(2022年)的SVAMP和Lan等人(2021)的MAWPS。

首先,圖4顯示,思維鏈提示是一種模型尺度的涌現(xiàn)能力。也就是說,思維鏈提示對(duì)小型模型的性能沒有積極影響,只有在與參數(shù)為100B及以上的模型一起使用時(shí)才能提高性能。我們確定的發(fā)現(xiàn),較小規(guī)模的模型產(chǎn)生了流暢但不合邏輯的思維鏈,導(dǎo)致其表現(xiàn)低于標(biāo)準(zhǔn)提示。

其次,對(duì)于更復(fù)雜的問題,思維鏈提示具有更大的性能提升。例如,對(duì)于GSM8K(基線性能最低的數(shù)據(jù)集),最大的GPT和PaLM模型的性能翻了一番多。另一方面,對(duì)于MAWPS中最簡單的子集SingleOp(只需要一步即可解決),性能改進(jìn)要么是負(fù)面的,要么是非常小的(見附錄表3)。

第三,通過GPT-3 175B和PaLM 540B的思維鏈提示與現(xiàn)有技術(shù)相比具有優(yōu)勢,現(xiàn)有技術(shù)通常在標(biāo)記的訓(xùn)練數(shù)據(jù)集上微調(diào)特定任務(wù)的模型。

圖4顯示了PaLM 540B如何使用思維鏈提示在GSM8K、SVAMP和MAWPS上實(shí)現(xiàn)新的技術(shù)水平(盡管請(qǐng)注意,標(biāo)準(zhǔn)提示已經(jīng)通過了SVAMP的先前最佳水平)。在另外兩個(gè)數(shù)據(jù)集上,AQuA和ASDiv、PaLM的思維鏈提示超過了最先進(jìn)水平的2%以內(nèi)(附錄表2)。

為了更好地理解為什么思維鏈提示有效,我們手動(dòng)檢查了LaMDA 137B為GSM8K生成的模型思維鏈。在模型返回正確最終答案的50個(gè)隨機(jī)例子中,除了兩個(gè)巧合地得出正確答案的例子外,所有生成的思維鏈在邏輯和數(shù)學(xué)上都是正確的(正確模型生成的思考鏈的例子見附錄D.1和表8)。我們還隨機(jī)檢查了50個(gè)模型給出錯(cuò)誤答案的隨機(jī)樣本。這項(xiàng)分析的總結(jié)是,除了小錯(cuò)誤(計(jì)算器錯(cuò)誤、符號(hào)映射ping錯(cuò)誤或缺少一個(gè)推理步驟)外,46%的思維鏈幾乎是正確的,另外54%的思維鏈在語義理解或連貫性方面存在重大錯(cuò)誤(見附錄D.2)。為了深入了解為什么縮放可以提高思維鏈推理能力,我們對(duì)PaLM 62B的錯(cuò)誤進(jìn)行了類似的分析,并分析了這些錯(cuò)誤是否通過縮放到PaLM 540B而得到修復(fù)。總結(jié)來看,將PaLM擴(kuò)展到540B可以修復(fù)62B模型中很大一部分步驟缺失和語義理解錯(cuò)誤(見附錄a.1)。

3.3、消融研究

使用思維鏈提示的觀察到的好處提出了一個(gè)自然的問題,即是否可以通過其他類型的提示來提高同樣的績效。

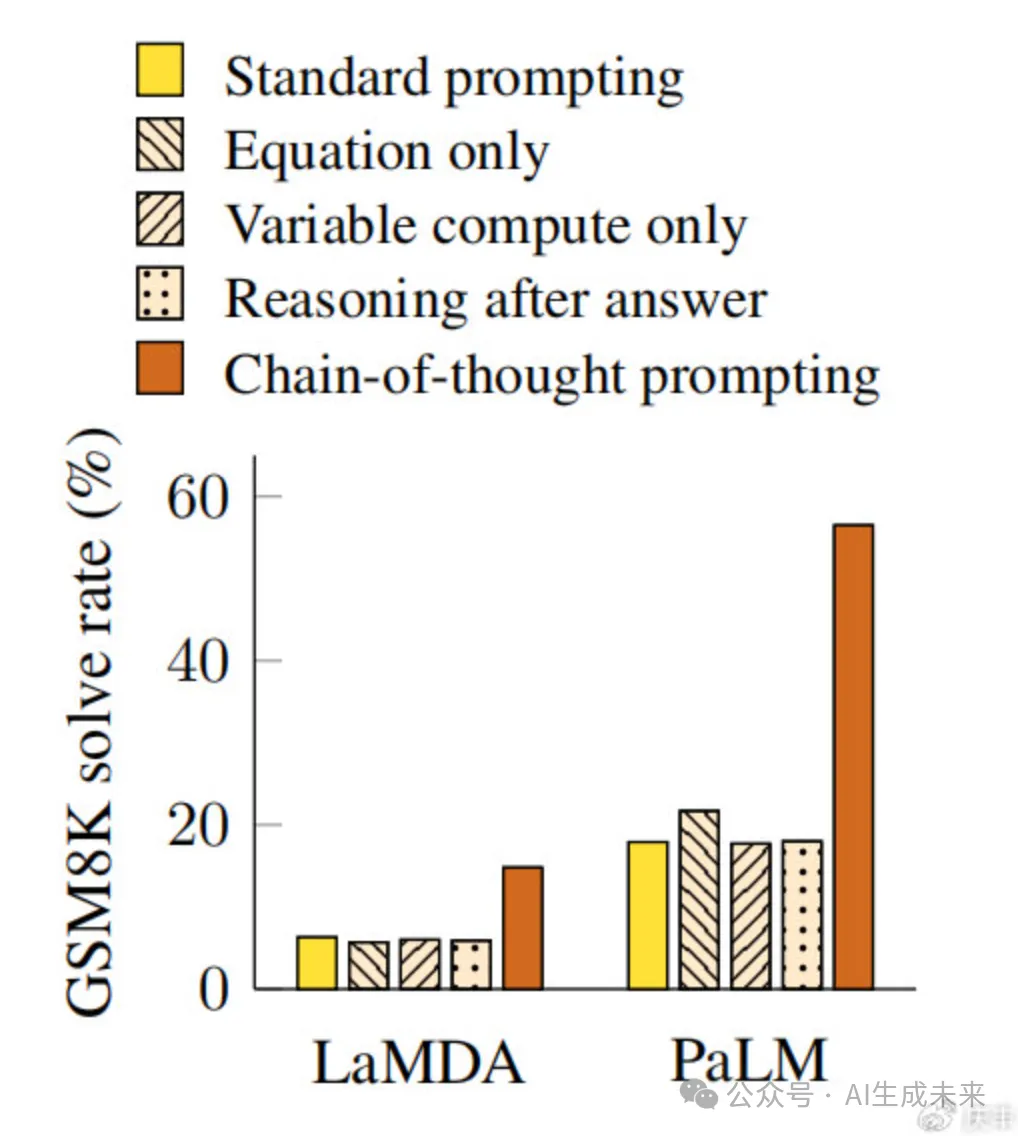

圖5:LaMDA 137B和PaLM 540B不同刺激變化的消融研究。其他數(shù)據(jù)集的結(jié)果見附錄表6和表7

圖5顯示了一項(xiàng)消融研究,其中有三種不同的思路,如下所述。

僅方程式:

思維鏈提示可能有所幫助的一個(gè)原因是,它產(chǎn)生了要評(píng)估的數(shù)學(xué)方程,因此我們測試了一種變體,在這種變體中,模型在給出答案之前只被提示輸出一個(gè)數(shù)學(xué)方程。圖5顯示,僅提示方程式對(duì)GSM8K沒有多大幫助,這意味著問題的語義在GSM8K中,如果沒有思維鏈中的自然語言推理步驟,直接翻譯成方程式太具有挑戰(zhàn)性了。然而,對(duì)于一步或兩步問題的數(shù)據(jù)集,我們發(fā)現(xiàn)僅提示方程式確實(shí)可以提高性能,因?yàn)榉匠淌娇梢院苋菀椎貜膯栴}中推導(dǎo)出來(見附錄表6)。

僅變量計(jì)算:

另一種直覺是,思維鏈允許模型在更難的問題上花費(fèi)更多的計(jì)算(即中間令牌)。為了將變量計(jì)算的影響與思維鏈推理隔離開來,我們測試了一種配置,在這種配置中,模型被提示輸出一個(gè)點(diǎn)序列(…),該點(diǎn)序列等于解決問題所需的方程中的字符數(shù)。這種變體的表現(xiàn)與基線大致相同,這表明變量計(jì)算本身并不是思維鏈提示成功的原因,而且通過自然語言表達(dá)中間步驟似乎是有用的。

答案后的思考鏈:

思維鏈提示的另一個(gè)潛在好處可能是,這種提示使模型能夠更好地獲取預(yù)訓(xùn)練期間獲得的相關(guān)知識(shí)。因此,我們測試了一種替代配置,在這種配置中,思維鏈提示僅在答案之后給出,從而隔離模型是否真正依賴于產(chǎn)生的思維鏈來給出最終答案。這種變體的表現(xiàn)與基線大致相同,這表明思維鏈中體現(xiàn)的順序推理不僅有助于激活知識(shí)。

3.4、思維鏈的穩(wěn)健性

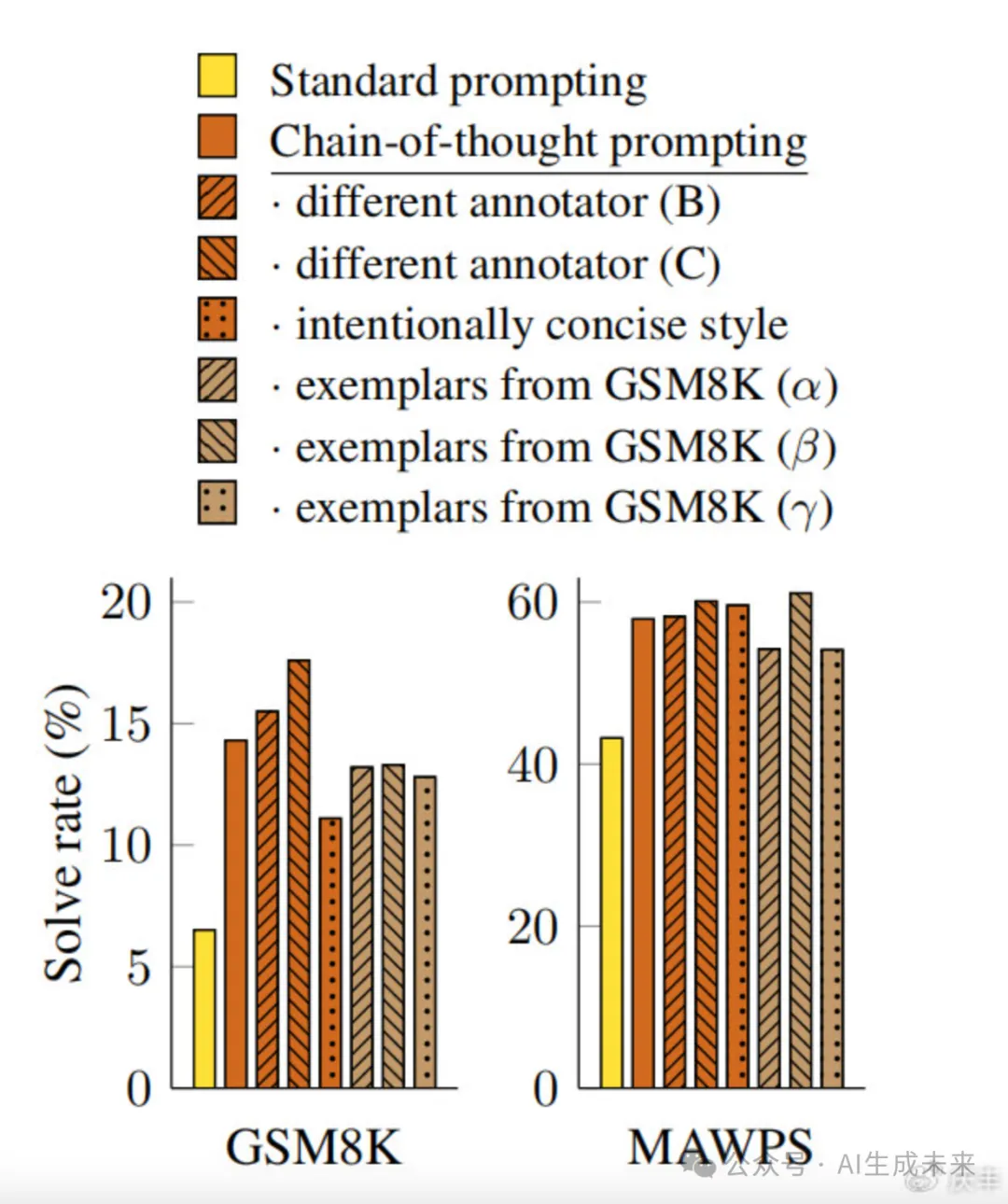

對(duì)樣本的敏感性是提示方法的關(guān)鍵考慮因素。例如,改變少數(shù)樣本的排列可能會(huì)導(dǎo)致GPT-3在SST-2上的準(zhǔn)確度從接近機(jī)會(huì)(54.3%)到接近現(xiàn)有技術(shù)(93.4%)(趙等人,2021)。在最后一小節(jié)中,我們評(píng)估了對(duì)不同注釋者編寫的思維鏈的魯棒性。除了上述使用注釋者A編寫的思維鏈的結(jié)果外,本文的另外兩位合著者(注釋者B和C)還獨(dú)立地為相同的少數(shù)鏡頭示例編寫了思維鏈(如附錄H所示)。注釋者A還按照Cobbe等人(2021)給出的解決方案風(fēng)格,寫了另一條比原文更簡潔的思路。

圖6顯示了GSM8K和MAWPS上LaMDA 137B的這些結(jié)果(其他數(shù)據(jù)集的消融結(jié)果見附錄表6/表7)。盡管不同的思維鏈注釋之間存在差異,正如使用基于范例的提示時(shí)所預(yù)期的那樣(Le Scao和Rush,2021;Reynolds和McDonnell,2021;趙等人,2021),但所有的思維鏈提示都大大超出了標(biāo)準(zhǔn)基線。這一結(jié)果表明,思維鏈的成功使用并不取決于特定的語言風(fēng)格。

圖6:思維鏈提示對(duì)于不同的提示檢查樣本(如預(yù)期的那樣)有差異,但對(duì)于各種注釋者和不同的示例,其表現(xiàn)優(yōu)于標(biāo)準(zhǔn)提示。

為了確認(rèn)成功的思維鏈提示對(duì)其他樣本集也有效,我們還對(duì)從獨(dú)立來源GSM8K訓(xùn)練集中隨機(jī)抽取的三組八個(gè)樣本進(jìn)行了實(shí)驗(yàn)(該數(shù)據(jù)集中的樣本已經(jīng)包括了像思維鏈這樣的推理步驟)。圖6顯示,這些提示的表現(xiàn)與我們手動(dòng)編寫的示例相當(dāng),也大大優(yōu)于標(biāo)準(zhǔn)提示。

除了對(duì)注釋器、獨(dú)立編寫的思維鏈、不同的示例和各種語言模型的魯棒性外,我們還發(fā)現(xiàn),算術(shù)推理的思維鏈提示對(duì)不同的示例順序和不同數(shù)量的示例具有魯棒性(見附錄A.2)。

4、常識(shí)推理

雖然思維鏈特別適合數(shù)學(xué)應(yīng)用題,但思維鏈基于語言的本質(zhì),實(shí)際上使其適用于廣泛的常識(shí)推理問題,這些問題涉及在一般背景知識(shí)的假設(shè)下對(duì)物理和人類交互的推理。常識(shí)推理是與世界互動(dòng)的關(guān)鍵,仍然超出了當(dāng)前自然語言理解系統(tǒng)的能力范圍。

基準(zhǔn):

我們考慮了五個(gè)數(shù)據(jù)集,涵蓋了各種常識(shí)推理類型。流行的CSQA(Talmor等人,2019)提出了關(guān)于世界的常識(shí)性問題,涉及復(fù)雜的語義,通常需要先驗(yàn)知識(shí)。StrategyQA(Geva等人,2021)要求模型推斷出多跳策略來回答問題。我們從BIG bench合作中選擇了兩個(gè)專門的評(píng)估集(2021年):日期理解,涉及從給定的上下文中推斷日期,以及運(yùn)動(dòng)理解,涉及確定與運(yùn)動(dòng)相關(guān)的句子是合理的還是不合理的。最后,SayCan數(shù)據(jù)集(Ahn等人,2022)涉及將自然語言指令映射到離散集合中的機(jī)器人動(dòng)作序列。圖3顯示了所有數(shù)據(jù)集的思維鏈注釋示例。

提示:

我們遵循與前一節(jié)相同的實(shí)驗(yàn)設(shè)置。對(duì)于CSQA和StrategyQA,我們從訓(xùn)練集中隨機(jī)選擇示例,并手動(dòng)構(gòu)建思維鏈,讓他們使用盡可能少的樣本示例。這兩個(gè)大型工作臺(tái)任務(wù)沒有訓(xùn)練集,因此我們選擇了前十個(gè)示例作為評(píng)估集中的示例,作為評(píng)估集中其余部分的少量樣本示例和報(bào)告編號(hào)。對(duì)于SayCan,我們使用了Ahn等人(2022)使用的訓(xùn)練集中的六個(gè)例子,以及手動(dòng)組成的思維鏈。

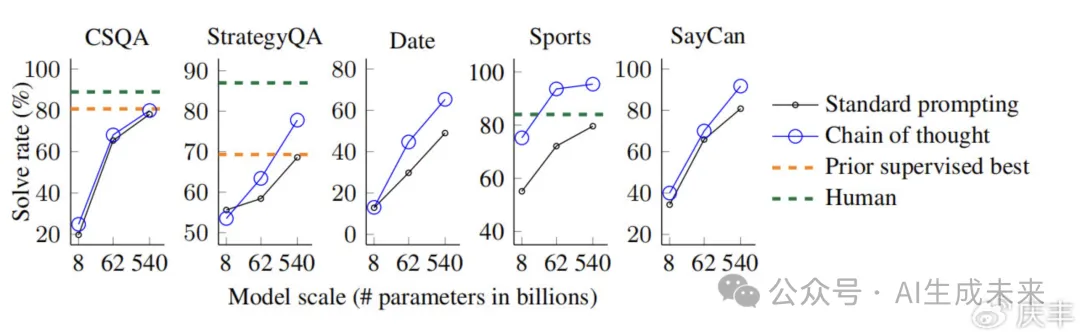

結(jié)果:

圖7突出顯示了PaLM的這些結(jié)果(LaMDA、GPT-3和不同模型量表的完整結(jié)果如表4所示)。對(duì)于所有任務(wù),擴(kuò)大模型大小可以提高標(biāo)準(zhǔn)提示的性能;思維鏈提示帶來了進(jìn)一步的收益,其中PaLM 540B的改進(jìn)似乎是最大的。在思維鏈的推動(dòng)下,PaLM 540B相對(duì)于基線取得了強(qiáng)勁的表現(xiàn),在StrategyQA上超越了先前的技術(shù)水平(75.6%對(duì)69.4%),在運(yùn)動(dòng)理解方面超越了獨(dú)立的體育愛好者(95.4%對(duì)84%)。

圖7:思維鏈提示也提高了語言模型的常識(shí)推理能力。這里顯示的語言模型是PaLM。之前的最佳數(shù)字來自CSQA(Talmor等人,2019)和StrategyQA(Geva等人,2021)的排行榜(截至2022年5月5日,僅限單一型號(hào))。使用不同大小的LaMDA、GPT-3和PaLM的其他結(jié)果如表4所示。

這些結(jié)果表明,思維鏈提示也可以提高需要一系列常識(shí)推理能力的任務(wù)的性能(盡管請(qǐng)注意,CSQA的收益很小)。

5、符號(hào)推理

我們的最終實(shí)驗(yàn)評(píng)估考慮了符號(hào)推理,這對(duì)人類來說很簡單,但對(duì)語言模型來說可能具有挑戰(zhàn)性。我們表明,思維鏈提示不僅使語言模型能夠執(zhí)行符號(hào)推理任務(wù)(這在標(biāo)準(zhǔn)提示設(shè)置中具有挑戰(zhàn)性),而且有助于對(duì)推理時(shí)間輸入進(jìn)行長度泛化,比少數(shù)示例中看到的更長。

任務(wù):

我們使用以下兩個(gè)玩具任務(wù):

?最后一個(gè)字母連接。

此任務(wù)要求模型連接名稱中單詞的最后一個(gè)字母(例如,“Amy Brown”→“yn”)。這是一個(gè)更具挑戰(zhàn)性的首字母連接版本,語言模型已經(jīng)可以在沒有思維鏈的情況下執(zhí)行。

我們通過隨機(jī)連接姓名普查數(shù)據(jù)中前一千個(gè)名字和姓氏中的名字來生成全名。

?硬幣翻轉(zhuǎn)。

這項(xiàng)任務(wù)要求模型回答,在人們拋硬幣或不拋硬幣后,硬幣是否仍然朝上(例如,“硬幣朝上。菲比拋硬幣。奧斯瓦爾多沒有拋硬幣。硬幣還在漲嗎?”→ “否”)。

由于這些符號(hào)推理任務(wù)的構(gòu)造是明確的,對(duì)于每項(xiàng)任務(wù),我們考慮一個(gè)域內(nèi)測試集和一個(gè)域外(OOD)測試集,域內(nèi)測試集中的示例的步驟數(shù)與訓(xùn)練/少鏡頭示例相同,域外測試集的評(píng)估示例的步數(shù)比示例中的多。對(duì)于最后一個(gè)字母連接,該模型只看到包含兩個(gè)單詞的名稱示例,然后對(duì)包含3個(gè)和4個(gè)單詞的姓名執(zhí)行最后一個(gè)字符連接。我們對(duì)拋硬幣任務(wù)中的潛在翻轉(zhuǎn)次數(shù)也做了同樣的操作。我們的實(shí)驗(yàn)裝置使用與前兩節(jié)相同的方法和模型。我們再次手動(dòng)為每個(gè)任務(wù)的幾個(gè)鏡頭示例構(gòu)建思維鏈,如圖3所示。

結(jié)果:

PaLM的域內(nèi)和OOD評(píng)估結(jié)果如圖8所示,LaMDA的結(jié)果如附錄表5所示。使用PaLM 540B,思維鏈提示導(dǎo)致幾乎100%的解決率(請(qǐng)注意,標(biāo)準(zhǔn)提示已經(jīng)解決了PaLM 540的拋硬幣問題,但不適用于LaMDA 137B)。請(qǐng)注意,這些領(lǐng)域內(nèi)評(píng)估是“玩具任務(wù)”,因?yàn)樵谏贁?shù)示例中,思維鏈已經(jīng)提供了完美的解決方案結(jié)構(gòu);模型所要做的就是對(duì)測試時(shí)間示例中的新符號(hào)重復(fù)相同的步驟。然而,小模型仍然失敗了——對(duì)這三個(gè)任務(wù)中看不見的符號(hào)進(jìn)行抽象操作的能力只出現(xiàn)在100B模型參數(shù)的規(guī)模上。

對(duì)于OOD評(píng)估,標(biāo)準(zhǔn)提示對(duì)這兩個(gè)任務(wù)都失敗了。在思維鏈提示下,語言模型實(shí)現(xiàn)了向上縮放曲線(盡管性能低于域內(nèi)設(shè)置)。因此,思維鏈提示有助于對(duì)足夠規(guī)模的語言模型進(jìn)行超越可見思維鏈的長度泛化。

6、討論

我們探索了思維鏈提示作為一種在大型語言模型中引發(fā)多步推理行為的簡單機(jī)制。我們首先看到,思維鏈提示在算術(shù)推理方面大大提高了性能,產(chǎn)生的改進(jìn)比消融強(qiáng)得多,對(duì)不同的注釋器、示例和語言模型也很穩(wěn)健(第3節(jié))。

接下來,常識(shí)推理實(shí)驗(yàn)強(qiáng)調(diào)了思維鏈推理的語言性質(zhì)如何使其普遍適用(第4節(jié))。最后,我們表明,對(duì)于符號(hào)推理,思維鏈提示有助于OOD泛化到更長的序列長度(第5節(jié))。在所有實(shí)驗(yàn)中,思維鏈推理都是通過提示現(xiàn)成的語言模型來引發(fā)的。在撰寫本文的過程中,沒有對(duì)語言模型進(jìn)行微調(diào)。

由于模型規(guī)模而出現(xiàn)的思維鏈推理一直是一個(gè)流行的主題(Wei等人,2022b)。對(duì)于許多標(biāo)準(zhǔn)提示具有平坦縮放曲線的推理任務(wù),思維鏈提示會(huì)導(dǎo)致縮放曲線急劇增加。思維鏈提示似乎擴(kuò)展了大型語言模型可以成功執(zhí)行的任務(wù)集——換句話說,我們的工作強(qiáng)調(diào)了標(biāo)準(zhǔn)提示只提供了大型語言模塊能力的下限。這一觀察結(jié)果可能提出的問題比它回答的問題更多——例如,隨著模型規(guī)模的進(jìn)一步擴(kuò)大,我們還能期望推理能力提高多少?還有哪些提示方法可以擴(kuò)展語言模型可以解決的任務(wù)范圍?

至于局限性,我們首先要證明,盡管思維鏈模仿了人類推理者的思維過程,但這并不能回答神經(jīng)網(wǎng)絡(luò)是否真的是“推理”,這是一個(gè)懸而未決的問題。第二,盡管在少數(shù)搜索設(shè)置中,用思想鏈?zhǔn)謩?dòng)擴(kuò)充樣本的成本是最小的,但這種注釋成本可能會(huì)阻礙微調(diào)(盡管這可能會(huì)通過合成數(shù)據(jù)生成或零樣本泛化來克服)。第三,不能保證正確的推理路徑,這可能會(huì)導(dǎo)致正確和錯(cuò)誤的答案;改進(jìn)語言模型的事實(shí)世代是未來工作的一個(gè)開放方向。最后,只有在大模型尺度上才出現(xiàn)思維鏈推理,這使得在現(xiàn)實(shí)世界的應(yīng)用中服務(wù)成本很高;進(jìn)一步的研究可以探索如何在較小的模型中誘導(dǎo)推理。

7、相關(guān)工作

這項(xiàng)工作受到了許多研究領(lǐng)域的啟發(fā),我們在擴(kuò)展的相關(guān)工作部分詳細(xì)介紹了這些領(lǐng)域。在這里,我們描述了兩個(gè)可能最相關(guān)的方向和相關(guān)論文。第一個(gè)相關(guān)方向是使用中間步驟來解決推理問題。Ling等人(2017)率先提出了通過一系列中間步驟使用自然語言推理來解決數(shù)學(xué)應(yīng)用題的想法。他們的作品與使用正式語言進(jìn)行推理的文學(xué)形成了鮮明的對(duì)比。Cobbe等人(2021)通過創(chuàng)建更大的數(shù)據(jù)集并使用它來微調(diào)預(yù)訓(xùn)練的語言模型,而不是從頭開始訓(xùn)練模型,對(duì)Ling等人(2017)進(jìn)行了擴(kuò)展。在程序綜合領(lǐng)域,Nye等人(2021)利用語言模型通過第一行到第行預(yù)測中間計(jì)算結(jié)果來預(yù)測Python程序的最終輸出,并表明他們的逐步預(yù)測方法比直接預(yù)測最終輸出表現(xiàn)更好。

當(dāng)然,本文也與最近關(guān)于提示的大量工作密切相關(guān)。自從Brown等人(2020)提出的少鏡頭提示普及以來,有幾種通用的方法 提高了模型的提示能力,例如自動(dòng)學(xué)習(xí)提示(Lester等人,2021)或?yàn)槟P吞峁┟枋鋈蝿?wù)的指令(Wei等人,2022a;Sanh等人,2022;Ouyang等人,2022)。盡管這些方法改進(jìn)或增強(qiáng)了提示的輸入部分(例如,添加到輸入前的指令),但我們的工作采用了用思維鏈增強(qiáng)語言模型輸出的正交方向。

8、結(jié)論

我們探索了思維鏈提示作為一種簡單且廣泛適用的方法來增強(qiáng)語言模型中的推理。通過對(duì)算術(shù)、符號(hào)和常識(shí)推理的實(shí)驗(yàn),我們發(fā)現(xiàn)思維鏈推理是模型尺度的一種涌現(xiàn)特性,它允許足夠大的語言模型執(zhí)行原本具有平坦尺度曲線的推理任務(wù)。

拓寬語言模型可以執(zhí)行的推理任務(wù)的范圍,將有望激發(fā)基于語言的推理方法的進(jìn)一步研究。

本文轉(zhuǎn)自 AI生成未來 ,作者:慶豐