19款模型大PK!李飛飛團隊發布首個世界生成基準WorldScore:曝出世界生成三大致命傷

文章鏈接:https://arxiv.org/pdf/2504.00983

開源地址:https://haoyi-duan.github.io/WorldScore/

亮點直擊

- 提出了首個世界生成基準WorldScore,支持對3D、4D、圖像到視頻(I2V)和文本到視頻(T2V)等多種方法進行統一評估。

- 為基準測試精心構建了一個高質量、多樣化的數據集,涵蓋不同類別的靜態與動態場景,并包含多種視覺風格。

- 提出了WorldScore 評估指標,綜合衡量世界生成模型的關鍵性能,包括可控性、質量和動態性。

- 通過對17 個開源模型和2 個閉源模型的全面評估,揭示了當前世界生成方法的關鍵洞見與挑戰,為未來研究提供了寶貴指導。

風格化圖像示例:預定義的風格集合包含7種不同的視覺藝術風格

當現有視頻評估基準(如VBench)基于單場景視頻質量對模型A和B給出相似評分時,WorldScore基準通過識別模型B在生成新場景和執行指定攝像機運動方面的失敗,有效區分了兩者的世界生成能力

總結速覽

解決的問題

- 缺乏統一評估標準:現有基準主要針對視頻生成或單場景生成,缺乏對大規模、多樣化世界生成的系統性評估。

- 控制能力不足:現有方法難以滿足用戶對多場景無縫集成和精確空間布局控制的需求。

- 兼容性局限:現有基準無法兼容3D/4D場景生成方法所需的相機軌跡和參考圖像輸入。

提出的方案

- WorldScore 基準:首個統一的世界生成評估框架,將世界生成分解為一系列“下一場景生成”任務,每個任務包含三元組(當前場景、下一場景、布局)。

- 多樣化數據集:涵蓋靜態與動態世界、室內與室外場景、寫實與風格化視覺域,共3000個高質量測試樣本。

- 多維度評估指標(WorldScore):

- 可控性(Controllability):生成結果對輸入控制(如相機軌跡、文本描述)的遵循程度。

- 質量(Quality):生成內容的逼真性和一致性。

- 動態性(Dynamics):運動的準確性和穩定性。

應用的技術

- 任務分解:通過“下一場景生成”任務統一評估3D/4D場景生成、文本/圖像到視頻生成等多種方法。

- 統一輸出格式:將所有模型的輸出轉換為視頻格式,實現跨方法直接對比。

- 多模態輸入支持:同時提供圖像+文本描述作為當前場景輸入,以及相機矩陣+文本描述作為布局輸入,兼容不同模型需求。

達到的效果

- 全面評估:對19個代表性模型(開源/閉源)進行測試,涵蓋圖像到視頻(5個)、文本到視頻(7個)、3D場景生成(6個)和4D生成(1個)四大類。

- 關鍵洞見:揭示每類模型在世界生成中的優勢與挑戰,例如:

- 視頻生成模型在動態性上表現較好,但可控性不足;

- 3D/4D生成模型在布局控制上更優,但動態場景生成能力有限。

- 推動領域發展:為世界生成任務提供標準化評估框架,促進多模態生成技術的融合與改進。

WorldScore 基準測試

設計概述

目標是建立一個統一不同方法論的世界生成評估基準。WorldScore 基準包含三個關鍵組成部分:

- 標準化的世界規范;

- 精心策劃的數據集;

- 多維度的評估指標。

整體框架如下圖2所示。將世界生成任務分解為一系列下一場景生成任務,其中每一步由一個包含空間布局和語義內容的世界規范定義(圖2左上角)。該世界規范使得我們能夠指導從3D/4D場景生成到視頻生成等不同類型的模型。生成的輸出結果統一以視頻形式呈現(圖2右下角),并通過WorldScore指標(圖2右上角)評估三個關鍵方面:可控性、質量和動態性。這種統一的評估方法確保了不同方法論范式之間的公平比較。

世界規范

靜態與動態世界

由于動態特性與可控性、質量評估的本質差異,我們明確將動態評估與其他兩方面解耦。為此定義兩類任務:

- 靜態世界生成:要求模型生成可變長度的場景序列以評估可控性和質量。此時下一場景文本描述N指向新場景內容,布局L描述大幅相機運動。

- 動態世界生成:要求模型生成場景內運動以評估動態性。此時N描述與當前場景C相同內容但含動態變化(如動物移動),布局L明確指定固定相機位姿且無相機運動。

數據集構建

數據集包含3000個世界規范樣本(2000靜態/1000動態),詳細統計見表S4。

當前場景C的構建

- 靜態世界:定義10類場景(5室內/5室外),從開源數據集[8,38,42,57,62,67,69,74,98]和Unsplash采集圖像,經嚴格篩選獲得約5000張照片級圖像(真實照片或物理渲染圖)。通過視覺語言模型GPT-4o生成描述 并進行10分類,每類保留前100張高質量圖像,最終獲得1000組 。

- 風格化擴展:為每組真實風格樣本隨機選擇7種風格之一,通過風格控制文本到圖像模型[55]生成對應風格化圖像 (示例見圖3前兩行)。

- 動態世界:定義5類運動類型,從Unsplash手動篩選每類100張圖像,采用相同流程生成描述及風格化版本,最終1000組樣本(示例見圖3末行)。

下一場景文本描述 的構建

每個世界生成任務包含連續的下一場景生成步驟,N分為兩種情形:

- 小世界:N僅含1個新場景

- 大世界: N含3個新場景

為保證場景序列的連貫性,采用自回歸式描述生成方法[90]:指導大語言模型生成與當前所有場景描述不同的下一場景文本。例如對小世界任務,模型需生成與當前場景P語義不同但合理的后續描述(如從"客廳"切換到"廚房")。

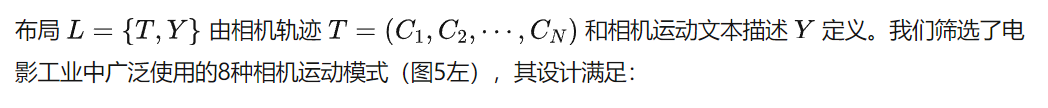

布局L的構建

- 覆蓋所有空間方向

- 適配文本到視頻模型——因多數模型基于含此類運動描述的電影片段訓練

這些運動既包含場景內運動(如鏡頭推進),也包含場景間轉場(如鏡頭拉出)。每個靜態場景生成樣本隨機分配一個布局 L(示例見圖5右)。若分配布局為場景內運動,則將N替換為P 。

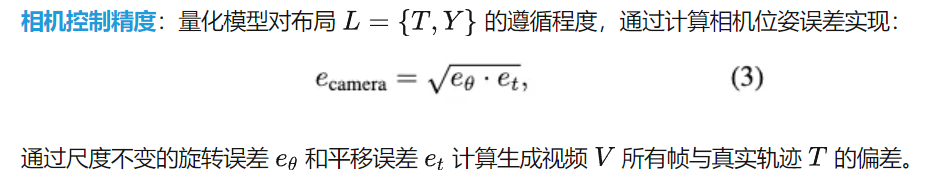

WorldScore評估指標

WorldScore包含兩個綜合得分:

- WorldScore-Static:僅評估靜態世界生成能力

- WorldScore-Dynamic:額外評估動態世界生成能力

二者均通過三大關鍵維度的子指標聚合而成:

可控性

包含三項指標:

物體控制準確率

使用開集目標檢測模型[44]檢測下一場景描述N中指定的物體是否出現:

- 從N提取1-2個物體描述

- 計算檢測結果與描述的匹配成功率

內容對齊度

采用CLIPScore評估生成場景與整個文本描述N的語義對齊程度(物體描述通常僅占文本長度的1/4)。

質量指標

3D一致性靜態世界視頻的幾何穩定性評估:

- 使用DROID-SLAM逐幀估計稠密深度

- 計算連續幀共視像素的重投影誤差(示例見圖6)

典型示例如下: 頂部:3D一致性右側。不良示例出現幾何形狀突變,而非平滑過渡。中部:光度一致性。不良示例中山地草場的紋理發生嚴重偏移。底部:運動準確性。優秀示例中章魚運動而水母保持靜止(左),右側不良示例則出現水母移動而章魚靜止的情況。

光度一致性

檢測外觀(如紋理)的穩定性:

- 計算連續幀光流的平均端點誤差(AEPE)

- 有效識別紋理閃爍等問題(圖6中排山脈的草紋理偏移)

風格一致性

通過Gram矩陣比較單次場景生成任務首尾幀的F-范數差異。

主觀質量

結合CLIP-IQA+與CLIP審美評分的混合指標,經200人實驗驗證其與人類偏好最佳匹配。

動態性指標

運動準確性

量化指定區域運動的精確性:

- 對比目標區域(如汽車)與非目標區域(如行人)的光流差異

- 消除非預期相機運動帶來的全局光流干擾(圖6末行示例)

運動幅度

通過連續幀光流估計模型生成大幅運動的能力。

運動平滑度

利用視頻插幀模型[93]生成平滑基準,評估生成視頻 的時間連續性。

分數歸一化與聚合

- 各指標線性歸一化至[0,1]區間后乘以100

- WorldScore-Static:可控性與質量維度得分的算術平均

- WorldScore-Dynamic:額外加入動態性三個維度得分

- 不支持動態任務的3D生成模型,動態指標強制賦0

實驗結果

評估模型

在WorldScore基準測試中評估了19個世界生成模型,包括:

- 12個視頻生成模型:

- 2個領先閉源I2V模型:Gen-3、Hailuo

- 6個開源I2V模型:DynamiCrafter、VideoCrafter1/2、EasyAnimate、CogVideoX-I2V 、Allegro

- 4個開源T2V模型:VideoCrafter1-T2V、T2v-Turbo、Vchitect-2.0、CogVideoX-T2V

- 6個3D場景生成模型:SceneScape、Text2Room、LucidDreamer、WonderJourney、InvisibleStitch、WonderWorld

- 1個4D生成模型:4D-fy (完整模型細節見下表S1)

關鍵發現與挑戰

表2的基準測試結果揭示了以下結論:

3D模型在靜態世界生成中占優

- WorldScore-Static前三名均為3D模型:WonderWorld(72.69)、LucidDreamer(70.40),顯著優于最佳視頻模型CogVideoX-T2V(62.15)。

- 優勢來源:3D模型天生具備更高的相機控制精度(通過顯式3D表征)和內容對齊能力(可生成更大空間),以及優異的3D與光度一致性。

- 局限性:無法生成動態世界,擴展至4D的4D-fy表現欠佳(動態生成本身難度較高)。

視頻模型的相機控制短板

- 最佳視頻模型CogVideoX-T2V的相機控制得分(40.22)仍遠低于任何3D/4D模型。

- 改進方向:近期相機條件注入方法[20,81]可能提供解決方案。

開源視頻模型媲美閉源模型

- CogVideoX-I2V在WorldScore-Static(62.15)和WorldScore-Dynamic(59.12)上均超過閉源模型Gen-3與Hailuo。

- 細節差異:CogVideoX-I2V相機控制更強,但物體控制與內容對齊稍弱。

運動幅度與平滑度的權衡

- 運動幅度大的模型(如Allegro)往往伴隨更低的運動平滑度,反映當前視頻模型難以兼顧大幅運動與自然過渡。

運動幅度≠運動準確性

- 運動幅度與準確性相關性弱(R<0.3),表明大運動模型可能產生非指令要求的相機運動或無關物體運動。

視頻模型的場景局限性

- 長序列生成:視頻模型在"大世界"任務(多場景序列)中表現顯著下降(圖7)。

- 室外場景:視頻模型與3D模型的性能差距在室外場景中更大(室內場景差距較小)。

T2V vs I2V的控制差異

- T2V模型:更易控制(可控性得分高+運動幅度大),但傾向于生成更大相機運動。

- I2V模型:質量得分更高,但受輸入圖像視角限制,生成新場景內容的能力較弱。

結論

總之,WorldScore基準測試揭示了當前各類世界生成方法的局限性。對于3D場景生成模型,雖然它們在靜態世界生成方面表現出色,但將其擴展到4D表征并融入動態性仍然具有挑戰性。對于視頻生成模型,主要挑戰包括可控性、長序列生成以及室外場景的生成。這些發現為未來研究指明了清晰方向:彌合3D與4D表征之間的差距、開發更魯棒的可控性機制、以及設計能夠處理長場景序列的架構。我們相信WorldScore基準將成為衡量這些方向進展的有價值工具,最終推動該領域發展出更強大、更通用的世界生成系統。

本文轉自AI生成未來 ,作者:AI生成未來