借助神經結構光,浙大實現動態三維現象的實時采集重建

對于煙霧等動態三維物理現象的高效高質量采集重建是相關科學研究中的重要問題,在空氣動力學設計驗證,氣象三維觀測等領域有著廣泛的應用前景。通過采集重建隨時間變化的三維密場度序列,可以幫助科學家更好地理解與驗證真實世界中的各類復雜物理現象。

圖 1:觀測動態三維物理現象對科學研究至關重要。圖為全球最大風洞 NFAC 對商用卡車實體開展空氣動力學實驗 [1]。

然而,從真實世界中快速獲取并高質量重建出動態三維密度場相當困難。首先,三維信息難以通過常見的二維圖像傳感器(如相機)直接測量。此外,高速變化的動態現象對物理采集能力提出了很高的要求:需要在很短的時間內完成對單個三維密度場的完整采樣,否則三維密度場本身將發生變化。這里的根本挑戰是如何解決測量樣本和動態三維密度場重建結果之間的信息量差距。

當前主流研究工作通過先驗知識彌補測量樣本信息量不足,計算代價高,且當先驗條件不滿足時重建質量不佳。與主流研究思路不同,浙江大學計算機輔助設計與圖形系統全國重點實驗室的研究團隊認為解決難題的關鍵在于提高單位測量樣本的信息量。

該研究團隊不僅利用 AI 優化重建算法,還通過 AI 幫助設計物理采集方式,實現同一目標驅動的全自動軟硬件聯合優化,從本質上提高單位測量樣本關于目標對象的信息量。通過對真實世界中的物理光學現象進行仿真,讓人工智能自己決定如何投射結構光,如何采集對應的圖像,以及如何從采樣樣本中重建出動態三維密度場。最終,研究團隊僅使用包含單投影儀和少量相機(1 或者 3 臺)的輕量級硬件原型,把建模單個三維密度場(空間分辨率 128x128x128)的結構光圖案數量降到 6 張,實現每秒 40 個三維密度場的高效采集。

值得一提的是,團隊在重建算法中創新性地提出輕量級一維解碼器,將局部入射光作為解碼器輸入的一部分,在不同相機所拍攝的不同像素下共用了解碼器參數,大幅降低網絡的復雜程度,提高計算速度。為融合不同相機的解碼結果,又設計結構簡單的 3D U-Net 聚合網絡。最終重建單個三維密度場僅需 9.2ms,相對于 SOTA 研究工作 [2,3],重建速度提升 2-3 個數量級,實現三維密度場的實時高質量重建。相關研究論文《Real-time Acquisition and Reconstruction of Dynamic Volumes with Neural Structured Illumination》已被計算機視覺頂級國際學術會議 CVPR 2024 接收。

- 論文鏈接:https://svbrdf.github.io/publications/realtimedynamic/realtimedynamic.pdf

- 研究主頁:https://svbrdf.github.io/publications/realtimedynamic/project.html

相關工作

根據采集過程中是否控制光照可以把相關工作分為以下兩大類。

第一類基于非可控光照的工作不需要專門的光源,在采集過程中不控制光照,因此對采集條件要求較寬松 [2,3]。由于單視角相機拍攝到的是三維結構的二維投影,因此難以高質量區分不同的三維結構。對此,一種思路是增加采集視角采樣數,如使用密集相機陣列或光場相機,這會導致高昂的硬件成本。另一種思路仍然在視角域稀疏采樣,通過各類先驗信息來填補信息量缺口,如啟發式先驗、物理規則或從現有數據中學習的先驗知識。一旦先驗條件在實際中不滿足,這類方法的重建結果會質量下降。此外,其計算開銷過于昂貴,無法支持實時重建。

第二類工作采用可控光照,在采集過程中對光照條件進行主動控制 [4,5]。此類工作對光照進行編碼以更主動地探測物理世界,還減少對先驗的依賴,從而獲得更高的重建質量。根據同時使用單燈還是多燈,相關工作可以進一步分類為掃描方法和光照多路復用方法。對于動態的物理對象,前者必須通過使用昂貴的硬件來達到高掃描速度,或者犧牲結果的完整性來減少采集負擔。后者通過同時對多個光源進行編程,顯著提高了采集效率。但是對于高質量的快速實時密度場,已有方法的采樣效率仍然不足 [5]。

浙大團隊的工作屬于第二類。和大多數現有工作不同的是,本研究工作利用人工智能來聯合優化物理采集(即神經結構光)與計算重建,從而實現高效高質量動態三維密度場建模。

硬件原型

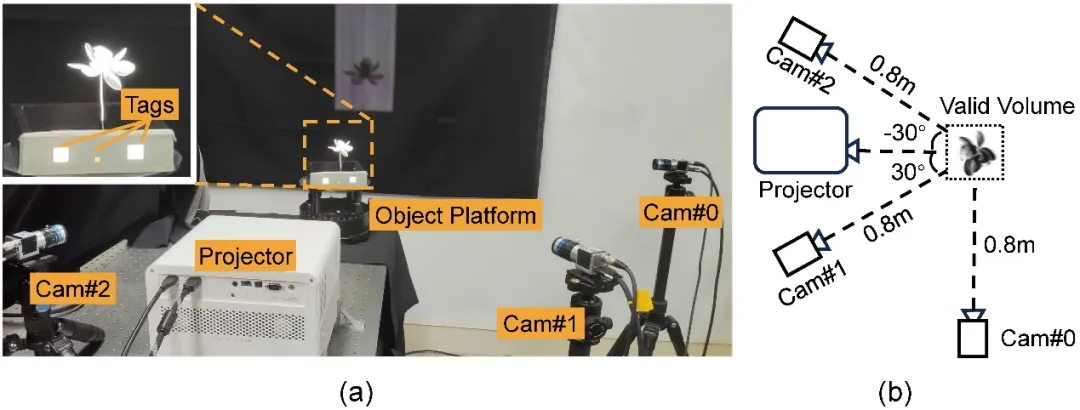

研究團隊搭建由單個商用投影儀(BenQ X3000:分辨率 1920×1080, 速度 240fps)和三個工業相機(Basler acA1440-220umQGR:分辨率 1440×1080, 速度 240fps)組成的簡單硬件原型(如圖 3 所示)。通過投影儀循環投射 6 個預訓練得到的結構光圖案,三個相機同步進行拍攝,并基于相機采集到的圖像進行動態三維密度場重建。四個設備相對于采集對象的角度是由不同仿真實驗模擬后所選出的最優排布。

圖 3:采集硬件原型。(a)硬件原型實拍圖,其中載物臺上的三個白色標記(tags)用于同步相機和投影儀。(b)相機、投影儀與拍攝對象之間幾何關系的示意圖(頂部視角)。

軟件處理

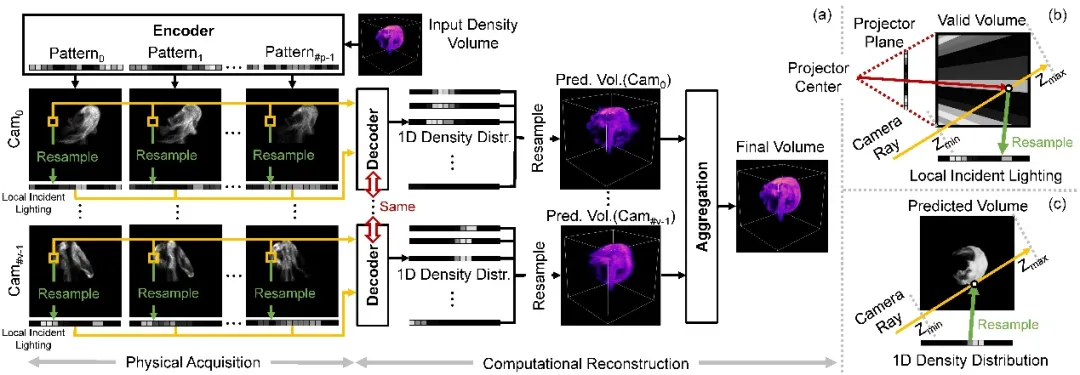

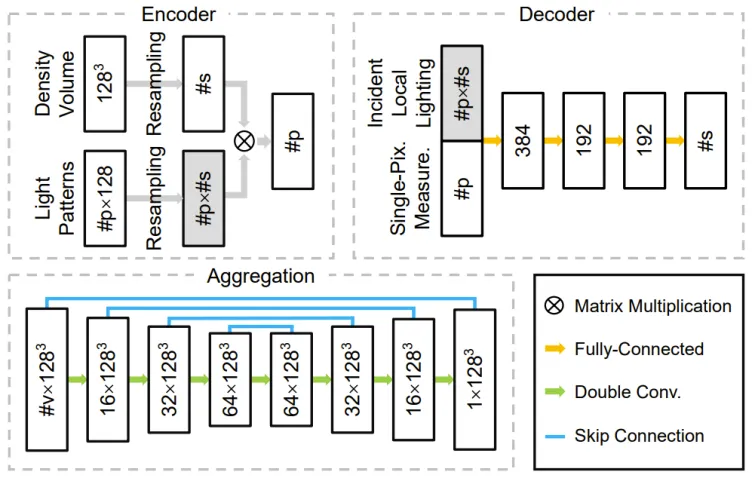

研發團隊設計由編碼器、解碼器和聚合模塊組成的深度神經網絡。其編碼器中的權重直接對應采集期間的結構光照亮度分布。解碼器以單像素上測量樣本為輸入,預測一維密度分布并插值到三維密度場。聚合模塊將每個相機所對應解碼器預測的多個三維密度場組合成最終的結果。通過使用可訓練結構光以及和輕量級一維解碼器,本研究更容易學習到結構光圖案,二維拍攝照片和三維密度場三者之間的本質聯系,不容易過擬合到訓練數據中。以下圖 4 展示整體流水線,圖 5 展示相關網絡結構。

圖 4:整體采集重建流水線 (a),以及從結構光圖案到一維局部入射光 (b) 和從預測的一維密度分布回到三維密度場 (c) 的重采樣過程。該研究從仿真 / 真實的三維密度場開始,首先將預先優化的結構光圖案(即編碼器中的權重)投影到該密度場。對于每個相機視圖中的每個有效像素,將其所有測量值以及重采樣的局部入射光送給解碼器,以預測對應相機光線上的一維密度分布。然后收集一臺相機的所有密度分布并將其重采樣到單個三維密度場中。在多相機情況下,該研究融合每臺相機的預測密度場以獲得最終結果。

圖 5:網絡 3 個主要部件的架構:編碼器、解碼器和聚合模塊。

結果展示

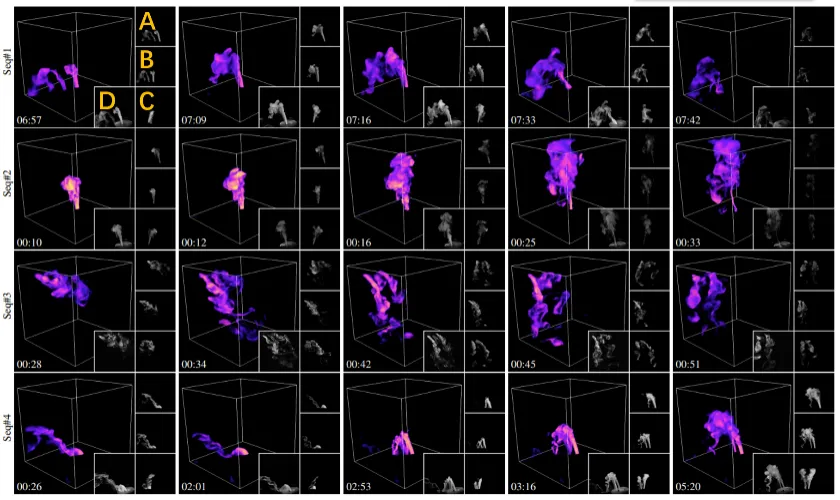

圖 6 展示本方法對四個不同動態場景的部分重建結果。為生成動態水霧,研究人員將干冰添加到裝有液態水的瓶子中制造水霧,并通過閥門控制流量,并使用橡膠管將其進一步引導至采集裝置。

圖 6:不同動態場景的重建結果。每一行是某水霧序列中選取部分重建幀的可視化結果,從上到下場景水霧源個數分別為:1,1,3 和 2。如左上方的橙色標注所示,A,B,C 分別對應三個輸入相機所采集的圖像,D 為和重建結果渲染視角類似的實拍參考圖像。時間戳在左下角展示。詳細的動態重建結果請參見論文視頻。

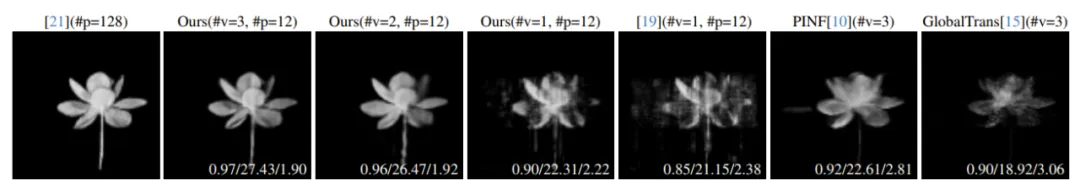

為了驗證本研究的正確性和質量,研究團隊在真實靜態物體上把本方法和相關 SOTA 方法進行對比(如圖 7 所示)。圖 7 也同時對不同相機數量下的重建質量進行對比。所有重建結果在相同的未采集過的新視角下繪制,并由三個評價指標進行定量評估。由圖 7 可知,得益于對采集效率的優化,本方法的重建質量優于 SOTA 方法。

圖 7:不同技術在真實靜態物體上的比較。從左到右是光學層切方法 [4],本方法(三相機),本方法(雙相機),本方法(單相機),單相機下使用手工設計的結構光 [5],SOTA 的 PINF [3] 和 GlobalTrans [2] 方法的重建結果可視化。以光學層切結果為基準,對于所有其他結果,其定量誤差列在相應圖像的右下角,用三種指標 SSIM/PSNR/RMSE (×0.01) 來評估。所有重建密度場均使用非輸入視圖進行渲染,#v 表示采集的視圖數量,#p 表示所用結構光圖案的數量。

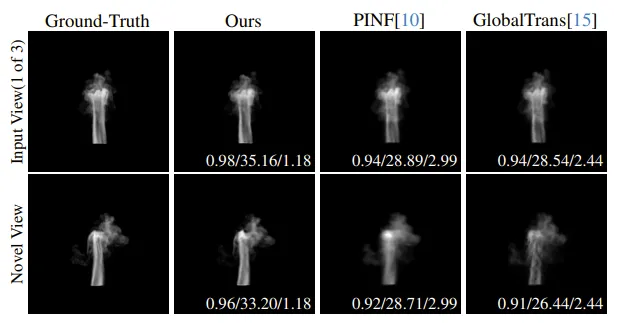

研究團隊也在動態仿真數據上對不同方法的重建質量進行定量對比。圖 8 展示仿真煙霧序列的重建質量對比。詳細的逐幀重建結果請參見論文視頻。

圖 8:仿真煙霧序列上不同方法的比較。從左到右依次為真實值,本方法,PINF [3] 和 GlobalTrans [2] 重建結果。輸入視圖和新視圖的渲染結果分別顯示在第一行和第二行中。定量誤差 SSIM/PSNR/RMSE (×0.01) 展示在相應圖像的右下角。整個重建序列的誤差平均值請參考論文補充材料。另外,整個序列的動態重建結果請參見論文視頻。

未來展望

研究團隊計劃在更先進的采集設備(如光場投影儀 [6])上應用本方法開展動態采集重建。團隊也期望通過采集更豐富的光學信息(如偏振狀態),從而進一步減少采集所需的結構光圖案數量和相機數量。除此之外,將本方法與神經表達(如 NeRF)結合也是團隊感興趣的未來發展方向之一。最后,讓 AI 更主動地參與對物理采集與計算重建的設計,不局限于后期軟件處理,這可能能為進一步提升物理感知能力提供新的思路,最終實現不同復雜物理現象的高效高質量建模。

本文轉自 機器之心 ,作者:機器之心

原文鏈接:??https://mp.weixin.qq.com/s/TB0PNPfrL4NsKG0NkGdvIQ??