不用SMOTE算法,我們如何處理多類不平衡數據?

本文轉載自公眾號“讀芯術”(ID:AI_Discovery)。

機器學習中的一個常見問題是處理不平衡數據,其中目標類中比例嚴重失調,存在高度不成比例的數據。

什么是多類不平衡數據?

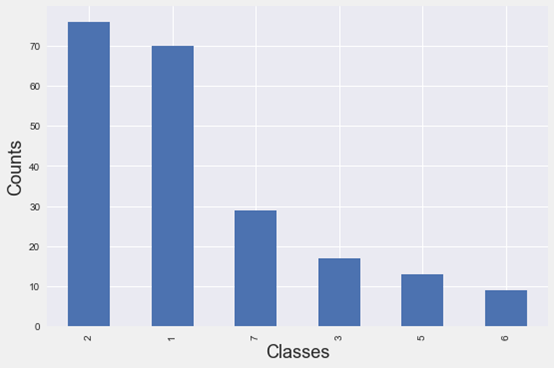

當分類問題的目標類(兩個或兩個以上)不均勻分布時,稱為不平衡數據。如果不能處理好這個問題,模型將會成為災難,因為使用類不平衡數據建模會偏向于大多數類。處理不平衡數據有不同的方法,最常見的是過采樣(Oversampling)和創建合成樣本。

什么是SMOTE算法?

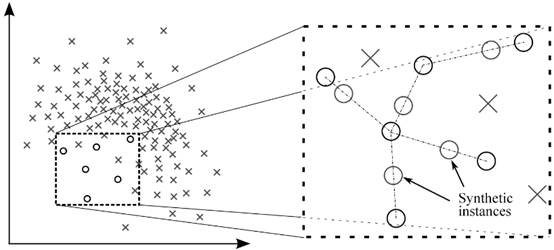

SMOTE是一種從數據集生成合成算例的過采樣技術,它提高了對少數類的預測能力。雖然沒有信息損失,但它有一些限制。

合成樣本

限制:

- SMOTE不適用于高維數據。

- 可能會發生類的重疊,并給數據帶來更多干擾。

因此,為了跳過這個問題,可以使用'class_weight '參數手動為類分配權重。

為什么使用類別權重(Class weight)?

類別權重通過對具有不同權重的類進行懲罰來直接修改損失函數,有目的地增加少數階級的權力,減少多數階級的權力。因此,它比SMOTE效果更好。本文將介紹一些最受歡迎的獲得數據的權重的技術,它們對不平衡學習問題十分奏效。

(1) Sklearn utils

可以使用sklearn來獲得和計算類權重。在訓練模型的同時將這些權重加入到少數類別中,可以提高類別的分類性能。

- from sklearn.utils import class_weightclass_weightclass_weight =class_weight.compute_class_weight('balanced,

- np.unique(target_Y),

- target_Y)model = LogisticRegression(class_weightclass_weight = class_weight)

- model.fit(X,target_Y)# ['balanced', 'calculated balanced', 'normalized'] arehyperpaameterswhic we can play with.

對于幾乎所有的分類算法,從邏輯回歸到Catboost,都有一個class_weight參數。但是XGboost對二進制分類使用scale_pos_weight,對二進制和多類問題使用樣本權重。

(2) 數長比

非常簡單明了,用行數除以每個類的計數數,然后

- weights = df[target_Y].value_counts()/len(df)

- model = LGBMClassifier(class_weight = weights)model.fit(X,target_Y)

(3) 平和權重技術(Smoothen Weights)

這是選擇權重的最佳方法之一。labels_dict是包含每個類的計數的字典對象,對數函數對不平衡類的權重進行平和處理。

- def class_weight(labels_dict,mu=0.15):

- total = np.sum(labels_dict.values()) keys = labels_dict.keys() weight = dict()for i in keys:

- score =np.log(mu*total/float(labels_dict[i])) weight[i] = score if score > 1else 1return weight# random labels_dict

- labels_dict = df[target_Y].value_counts().to_dict()weights =class_weight(labels_dict)model = RandomForestClassifier(class_weight = weights)

- model.fit(X,target_Y)

(4) 樣本權重策略

下面的函數不同于用于為XGboost算法獲取樣本權重的class_weight參數。它為每個訓練樣本返回不同的權重。樣本權重是一個與數據長度相同的數組,包含應用于每個樣本的模型損失的權重。

- def BalancedSampleWeights(y_train,class_weight_coef):

- classes = np.unique(y_train, axis =0)

- classes.sort()class_samples = np.bincount(y_train)total_samples = class_samples.sum()n_classes = len(class_samples) weights = total_samples / (n_classes* class_samples * 1.0)

- class_weight_dict = {key : value for (key, value) in zip(classes, weights)}

- class_weight_dict[classes[1]] = class_weight_dict[classes[1]] *

- class_weight_coefsample_weights = [class_weight_dict[i] for i in y_train]

- return sample_weights#Usage

- weight=BalancedSampleWeights(target_Y,class_weight_coef)

- model = XGBClassifier(sample_weight = weight)

- model.fit(X, target_Y)

(5) 類權重與樣本權重:

樣本權重用于為每個訓練樣本提供權重,這意味著應該傳遞一個一維數組,其元素數量與訓練樣本完全相同。類權重用于為每個目標類提供權重,這意味著應該為要分類的每個類傳遞一個權重。

以上是為分類器查找類權重和樣本權重的幾種方法,所有這些技術都對筆者的項目有效,你可以試試這些技巧,絕對大有幫助。