用于精確目標檢測的多網格冗余邊界框標注

本文經計算機視覺研究院公眾號授權轉載,轉載請聯系出處。

一、前言

現在領先的目標檢測器是從基于深度CNN的主干分類器網絡重新調整用途的兩級或單級網絡。YOLOv3就是這樣一種眾所周知的最先進的單級檢測器,它接收輸入圖像并將其劃分為大小相等的網格矩陣。具有目標中心的網格單元負責檢測特定目標。

今天分享的,就是提出了一種新的數學方法,該方法為每個目標分配多個網格,以實現精確的tight-fit邊界框預測。研究者還提出了一種有效的離線復制粘貼數據增強來進行目標檢測。新提出的方法顯著優于一些當前最先進的目標檢測器,并有望獲得更好的性能。

二、背景

目標檢測網絡旨在使用緊密匹配的矩形邊界框在圖像上定位對象并正確標記它。如今,有兩種不同的方法可以實現這一目的。第一個也是性能方面,最主要的方法是兩階段目標檢測,最好的代表RCNN及其衍生物[Faster r-cnn: Towards real-time object detection with region proposal networks]、[Fast r-cnn]。相比之下,第二組目標檢測實現因其出色的檢測速度和輕量級而廣為人知,被稱為單階段網絡,代表性示例為[You only look once: Unified, real-time object detection]、[Ssd: Single shot multibox detector]、[Focal loss for dense object detection]。兩階段網絡依賴于一個潛在的區域建議網絡,該網絡生成可能包含感興趣對象的圖像的候選區域,第二個檢測頭處理分類和邊界框回歸。在單階段目標檢測中,檢測是一個單一的、完全統一的回歸問題,它在一個完整的前向傳遞中同時處理分類和定位。因此,通常,單階段網絡更輕、更快且易于實現。

今天的研究依然是堅持YOLO的方法,特別是YOLOv3,并提出了一種簡單的hack,可以同時使多個網格單元預測目標坐標、類別和目標置信度。每個對象的多網格單元分配背后的基本理論是通過強制多個單元在同一對象上工作來增加預測緊密擬合邊界框的可能性。

多網格分配的一些優點包括:

(a)為目標檢測器提供它正在檢測的對象的多視角視圖,而不是僅依靠一個網格單元來預測對象的類別和坐標;

(b ) 較少隨機和不穩定的邊界框預測,這意味著高精度和召回率,因為附近的網格單元被訓練來預測相同的目標類別和坐標;

(c) 減少具有感興趣對象的網格單元與沒有感興趣對象的網格之間的不平衡。

此外,由于多網格分配是對現有參數的數學利用,并且不需要額外的關鍵點池化層和后處理來將關鍵點重新組合到其對應的目標,如CenterNet和CornerNet,可以說它是一個更實現無錨或基于關鍵點的目標檢測器試圖實現的自然方式。除了多網格冗余注釋,研究者還引入了一種新的基于離線復制粘貼的數據增強技術,用于準確的目標檢測。

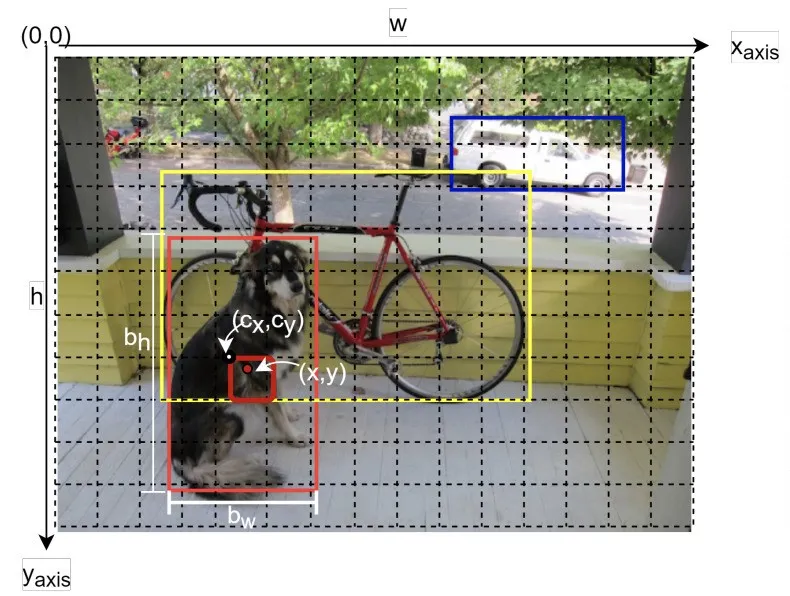

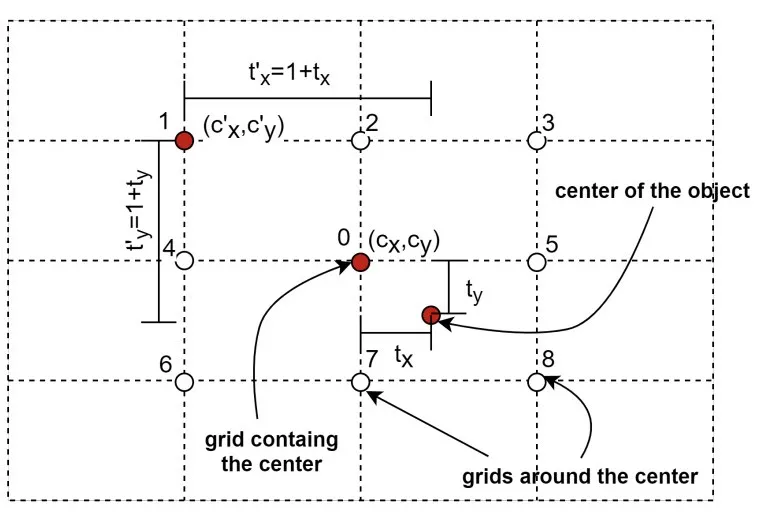

三、MULTI-GRID ASSIGNMENT

上圖包含三個目標,即狗、自行車和汽車。為簡潔起見,我們將解釋我們在一個對象上的多網格分配。上圖顯示了三個對象的邊界框,其中包含更多關于狗的邊界框的細節。下圖顯示了上圖的縮小區域,重點是狗的邊界框中心。包含狗邊界框中心的網格單元的左上角坐標用數字0標記,而包含中心的網格周圍的其他八個網格單元的標簽從1到8。

到目前為止,我已經解釋了包含目標邊界框中心的網格如何注釋目標的基本事實。這種對每個對象僅一個網格單元的依賴來完成預測類別的困難工作和精確的tight-fit邊界框引發了許多問題,例如:

(a)正負網格之間的巨大不平衡,即有和沒有對象中心的網格坐標

(b)緩慢的邊界框收斂到GT

(c)缺乏要預測的對象的多視角(角度)視圖。

所以這里要問的一個自然問題是,“顯然,大多數對象包含一個以上網格單元的區域,因此是否有一種簡單的數學方法來分配更多這些網格單元來嘗試預測對象的類別和坐標連同中心網格單元?”。這樣做的一些優點是(a)減少不平衡,(b)更快的訓練以收斂到邊界框,因為現在多個網格單元同時針對同一個對象,(c)增加預測tight-fit邊界框的機會(d) 為YOLOv3等基于網格的檢測器提供多視角視圖,而不是對象的單點視圖。新提出的多重網格分配試圖回答上述問題。

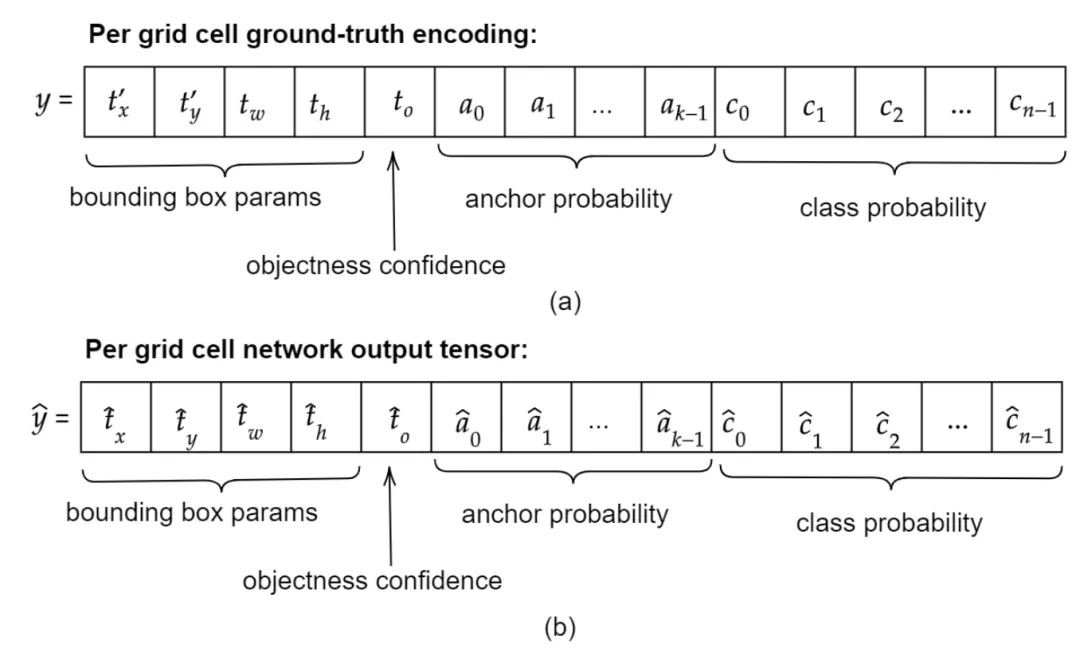

Ground-truth encoding

四、訓練

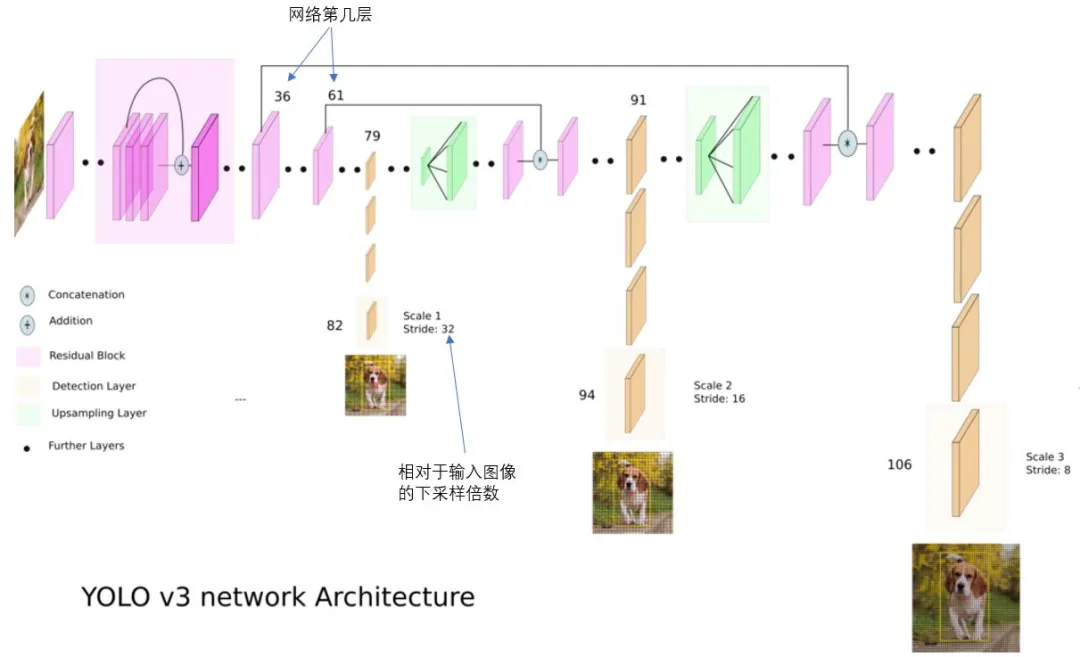

A. The Detection Network: MultiGridDet

MultiGridDet是一個目標檢測網絡,通過從YOLOv3中刪除六個darknet卷積塊來使其更輕、更快。一個卷積塊有一個Conv2D+Batch Normalization+LeakyRelu。移除的塊不是來自分類主干,即Darknet53。相反,將它們從三個多尺度檢測輸出網絡或頭中刪除,每個輸出網絡兩個。盡管通常深度網絡表現良好,但太深的網絡也往往會快速過度擬合或大幅降低網絡速度。

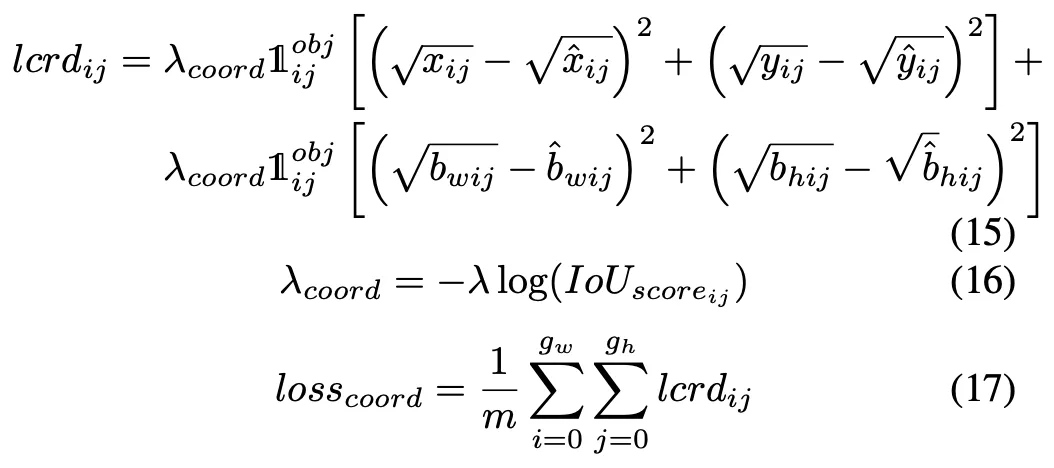

B. The Loss function

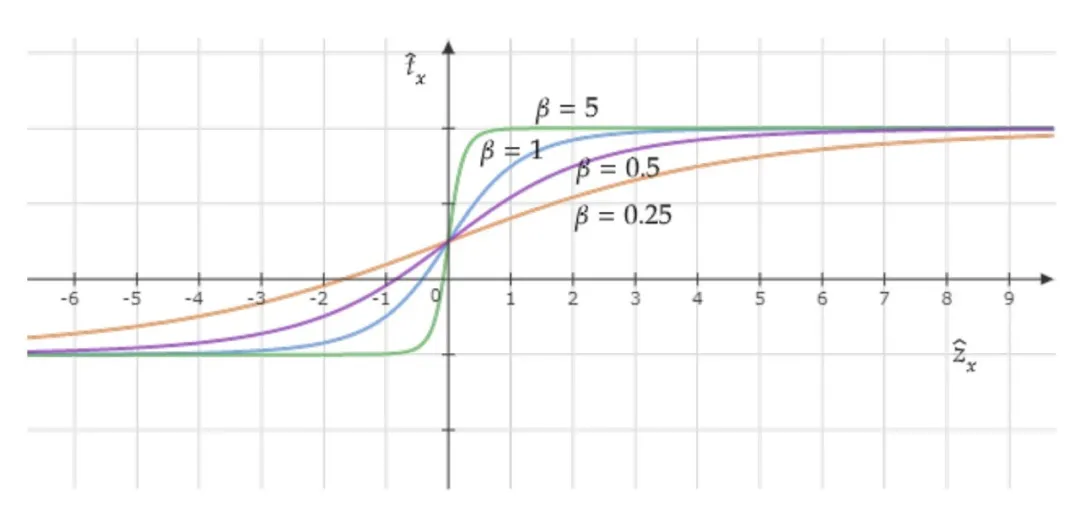

Coordinate activation function plot with different β values

C. Data Augmentation

離線復制粘貼人工訓練圖像合成工作如下:首先,使用簡單的圖像搜索腳本,使用地標、雨、森林等關鍵字從谷歌圖像下載數千張背景無對象圖像,即沒有我們感興趣的對象的圖像。然后,我們從整個訓練數據集的隨機q個圖像中迭代地選擇p個對象及其邊界框。然后,我們生成使用它們的索引作為ID選擇的p個邊界框的所有可能組合。從組合集合中,我們選擇滿足以下兩個條件的邊界框子集:

- if arranged in some random order side by side, they must fit within a given target background image area

- and should efficiently utilize the background image space in its entirety or at least most part of it without the objects overlap.

五、實驗及可視化

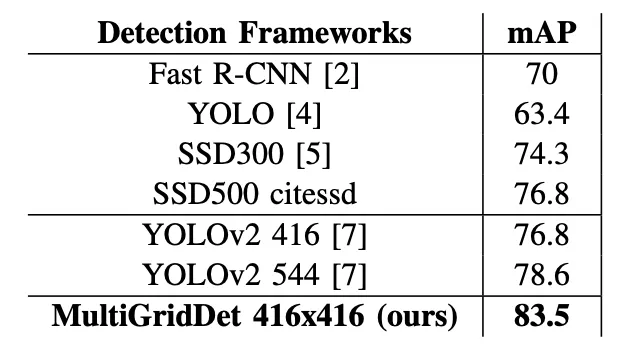

Pascal VOC 2007上的性能比較

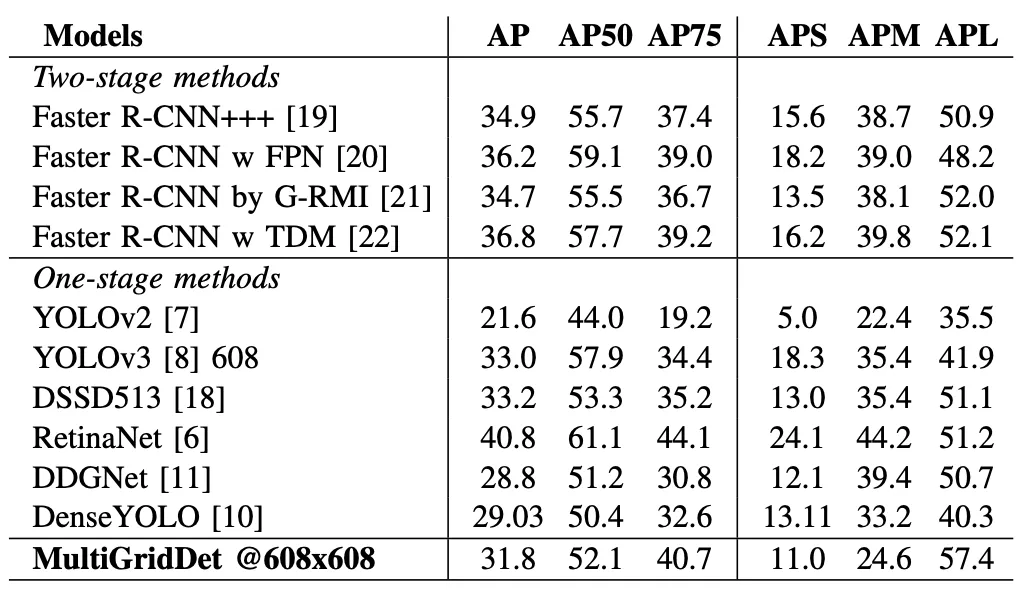

coco數據集上的性能比較

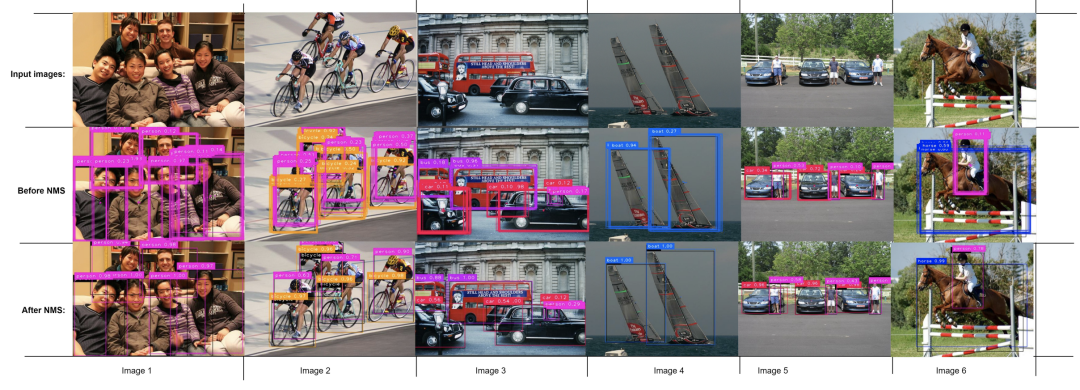

從圖中可以看出,第一行顯示了六個輸入圖像,而第二行顯示了網絡在非極大抑制(NMS)之前的預測,最后一行顯示了MultiGridDet在NMS之后對輸入圖像的最終邊界框預測。