神經(jīng)網(wǎng)絡(luò)可能不再需要激活函數(shù)?Layer Normalization也具有非線性表達!

本文作者均來自北京航空航天大學(xué)人工智能學(xué)院和復(fù)雜關(guān)鍵軟件環(huán)境全國重點實驗室黃雷副教授團隊。一作倪云昊為研一學(xué)生,二作郭宇芯為大三學(xué)生,三作賈俊龍為研二學(xué)生,通訊作者為黃雷副教授(主頁:https://huangleibuaa.github.io/)

神經(jīng)網(wǎng)絡(luò)通常由三部分組成:線性層、非線性層(激活函數(shù))和標(biāo)準(zhǔn)化層。線性層是網(wǎng)絡(luò)參數(shù)的主要存在位置,非線性層提升神經(jīng)網(wǎng)絡(luò)的表達能力,而標(biāo)準(zhǔn)化層(Normalization)主要用于穩(wěn)定和加速神經(jīng)網(wǎng)絡(luò)訓(xùn)練,很少有工作研究它們的表達能力,例如,以Batch Normalization為例,它在預(yù)測階段可以認為是線性變換,從表達上并未引入非線性。因此研究人員普遍認為Normalization并不能夠提升模型的表達能力。

然而,最近由北京航空航天大學(xué)人工智能學(xué)院黃雷老師團隊發(fā)表在ICML2024上的論文《On the Nonlinearity of Layer Normalization》指出,層標(biāo)準(zhǔn)化(Layer Normlization,LN)以及其計算退化版本RMSNorm具有非線性表達能力,并詳細討論了LN的萬能近似分類能力。

- 論文地址:https://arxiv.org/abs/2406.01255

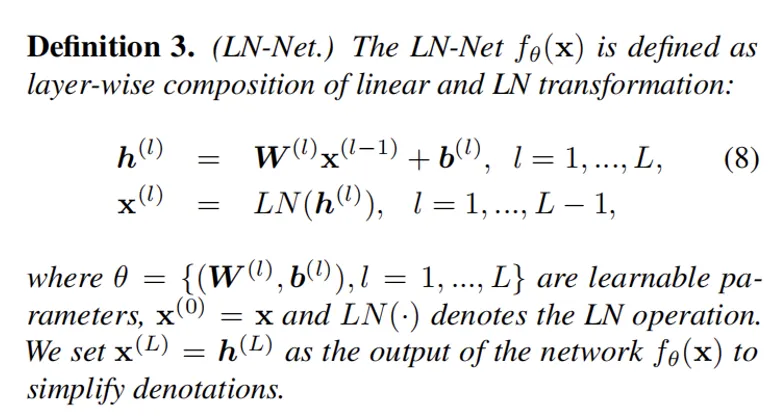

該論文對LN的非線性進行了數(shù)學(xué)證明。并且提出了僅含線性層和LN的簡單神經(jīng)網(wǎng)絡(luò)LN-Net,在足夠深的情況下,理論上,可以任意分類給定的樣本和樣本類別。這一發(fā)現(xiàn)打破了人們將各種Normalization視為不具有擬合能力的線性變換的慣性認知,而非線性層和標(biāo)準(zhǔn)化層也不再是互不相交的神經(jīng)網(wǎng)絡(luò)模塊。

目前,隨著transformer的廣泛使用,LN作為其中的固定組成部分,已經(jīng)成為了一種普遍使用的技術(shù),該研究在未來可能為神經(jīng)網(wǎng)絡(luò)架構(gòu)提供新的理論依據(jù),在這個方向上,具有開創(chuàng)性意義。

LN非線性的數(shù)學(xué)發(fā)現(xiàn)

對于非線性研究,文章并沒有直接討論LN本身的分析性質(zhì),而是更具有實用意義地探究了LN與數(shù)據(jù)之間的交互。

作者首先提出了統(tǒng)計量SSR(Sum of Squares Ratio),描述兩個類別下樣本的線性可分性。當(dāng)對樣本進行線性變換時,SSR也會發(fā)生變化。因此,定義樣本在所有線性變換下對應(yīng)的最小的SSR為LSSR。文章指出,當(dāng)LSSR越小時,樣本之間的線性可分性越強。

然而,當(dāng)對樣本施加的線性變化替換為“線性變換-LN-線性變換”的結(jié)構(gòu)時,發(fā)現(xiàn)得到的新的SSR有可能低于LSSR,這驗證了LN的非線性表達——如果LN是線性的,那么“線性變換-LN-線性變換”也是線性的,得到的新SSR不可能會低于LSSR。

LN在分類問題中的任意可分性

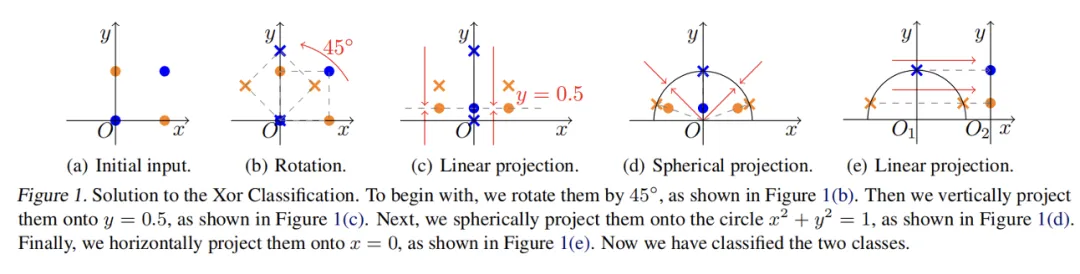

為了進一步研究,作者將LN拆分為兩個步驟:中心化(centering)和尺度縮放(scaling)。中心化從數(shù)學(xué)上是一個線性變換,因此LN的非線性主要存在于尺度縮放操作當(dāng)中(文章中也稱之為球面投影,是RMSNorm執(zhí)行的操作)。作者以最為簡單的線性不可分的異或數(shù)據(jù)為例,通過線性變換和球面投影將這四個點進行了正確分類。

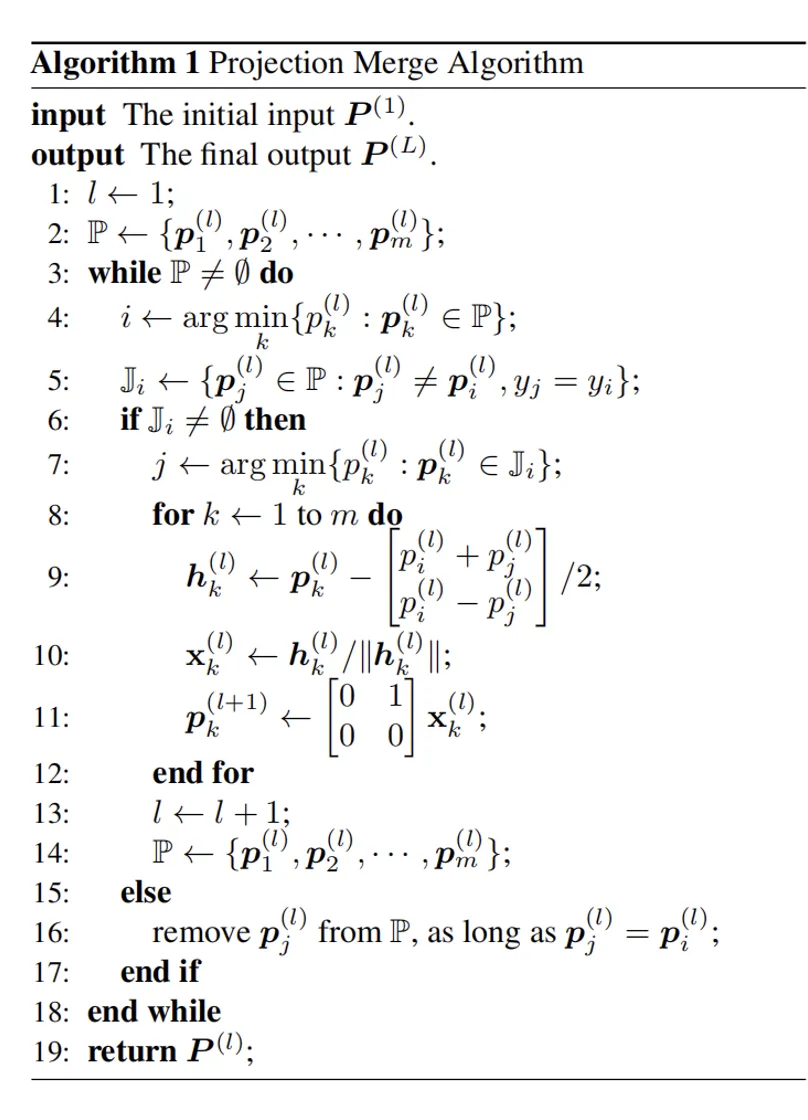

更一般地,作者提出了使用LN和線性層對任意數(shù)目樣本進行正確分類的算法,探究了LN-Net的萬能近似能力。

通過構(gòu)造算法步驟,將神經(jīng)網(wǎng)絡(luò)的逐層變換轉(zhuǎn)換為同類樣本合并問題,將萬能近似分類問題轉(zhuǎn)換為樣例歸并問題,并指出——對于任意標(biāo)簽的m個樣本,都可以構(gòu)造一個O(m)層的LN-Net,對這m個樣本進行正確分類。這一構(gòu)造方法為計算神經(jīng)網(wǎng)絡(luò)的VC維也提供了新的思路。作者指出,在此基礎(chǔ)上,可以推斷出有L個層標(biāo)準(zhǔn)化層的LN-Net,VC維至少有L+2。

LN非線性加強與實際應(yīng)用

作者在證明了LN非線性的基礎(chǔ)上,為進一步加強LN的非線性以便于實際應(yīng)用,提出了分組層標(biāo)準(zhǔn)化技術(shù)(LN-G)。作者在數(shù)學(xué)上從海森矩陣的角度預(yù)測分組能強化LN的非線性,并從實驗上初步探測了LN-G的表達能力。

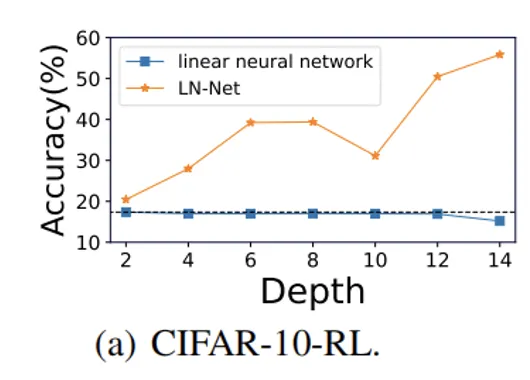

作者指出,在CIFAR-10隨機標(biāo)簽數(shù)據(jù)集上,對于通常的線性層模型,其準(zhǔn)確率不超過20%;而使用線性層和LN-G構(gòu)成的神經(jīng)網(wǎng)絡(luò)(不引入傳統(tǒng)的激活函數(shù)作為非線性單元)能夠取得55.85%的準(zhǔn)確率。

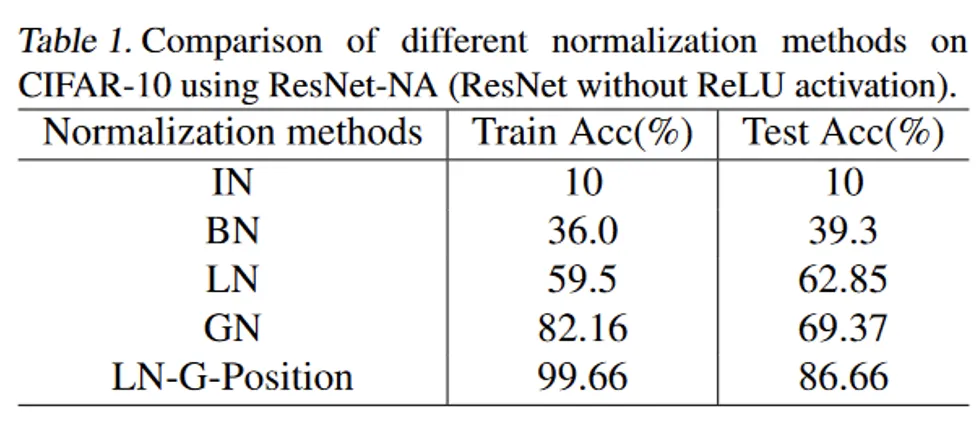

作者進一步探究了LN-G在無激活函數(shù)的卷積神經(jīng)網(wǎng)絡(luò)的分類效果,并實驗上證明了這種沒有激活函數(shù)的神經(jīng)網(wǎng)絡(luò)的確有著強大的擬合能力。此外,作者類比MLP上GN作用于整個樣本上(將單個樣本拉伸成一維向量,再進行GN),提出了LN-G-Position。在沒有非線性層的ResNet網(wǎng)絡(luò)上使用LN-G-Position方法在CIFAR-10數(shù)據(jù)集上能夠取得86.66%的準(zhǔn)確率,體現(xiàn)了LN-G-Position強大的表達能力。

作者接下來在Transformer上進行了實驗探究,將原本的LN替換為LN-G,根據(jù)實驗結(jié)果發(fā)現(xiàn)了分組層標(biāo)準(zhǔn)化能有效性提升Transformer網(wǎng)絡(luò)的性能,證明了真實網(wǎng)絡(luò)中,該理論的可行性。

結(jié)論與展望

作者在《On the Nonlinearity of Layer Normalization》論文中,理論上首次證明了僅含有線性層和LN的模型的萬能分類能力以及給定特定深度的模型的VC維下界,這里面最重要的意義是將傳統(tǒng)深度神經(jīng)網(wǎng)絡(luò)的表達能力的分析朝廣泛使用的現(xiàn)代真實網(wǎng)絡(luò)邁出了一大步,這一點可能為未來的神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)設(shè)計提供新的思路。