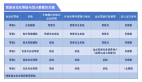

18k個(gè)視頻、專為自動(dòng)駕駛世界模型設(shè)計(jì),DrivingDojo數(shù)據(jù)集來了

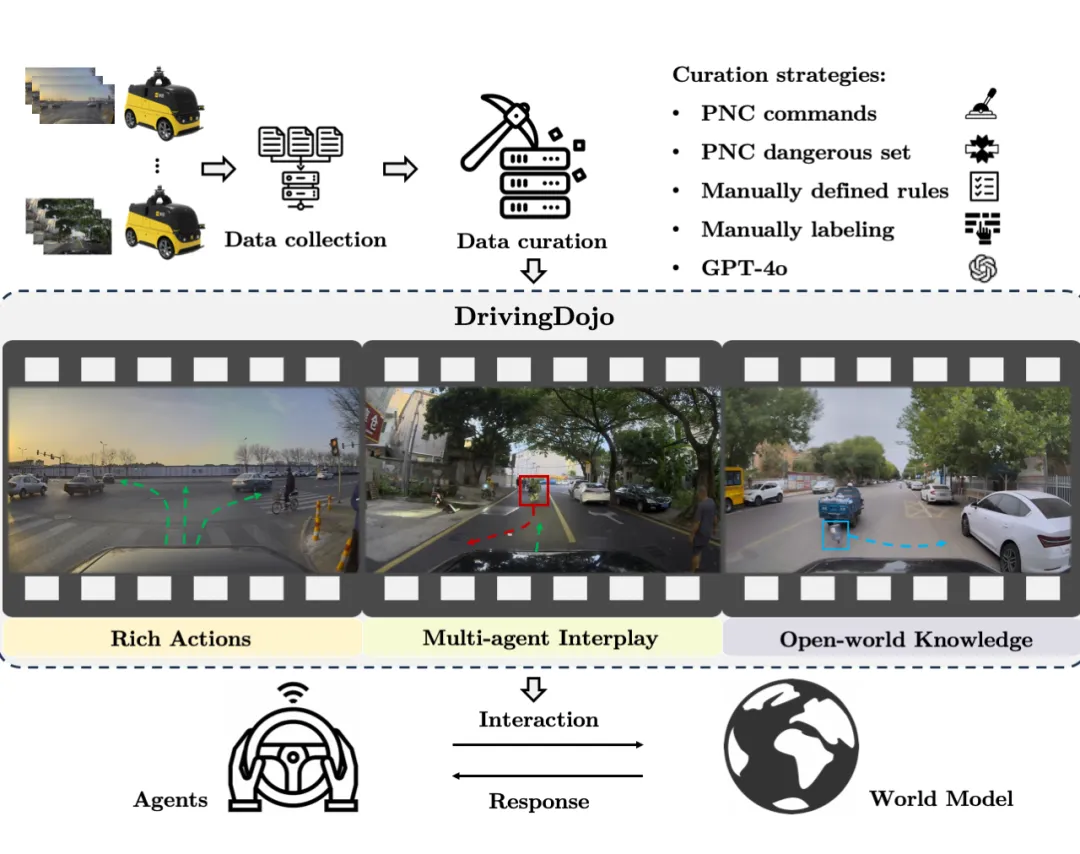

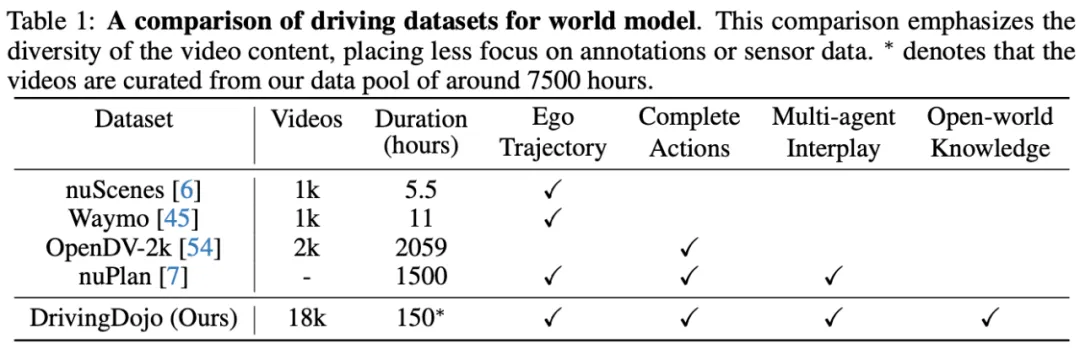

世界模型被廣泛認(rèn)為是實(shí)現(xiàn)通用人工智能的關(guān)鍵技術(shù),其核心能力在于模擬真實(shí)世界的動(dòng)態(tài)變化,并為決策提供精準(zhǔn)的未來狀態(tài)預(yù)測(cè)。在自動(dòng)駕駛領(lǐng)域,世界模型的應(yīng)用尤為引人注目。然而,現(xiàn)有數(shù)據(jù)集在視頻多樣性和行為復(fù)雜性方面的不足,限制了世界模型潛力的全面發(fā)揮。為了解決這一瓶頸,中國(guó)科學(xué)院自動(dòng)化研究所聯(lián)合美團(tuán)無人車團(tuán)隊(duì)推出了 DrivingDojo 數(shù)據(jù)集 —— 全球規(guī)模最大、專為自動(dòng)駕駛世界模型研究設(shè)計(jì)的高質(zhì)量視頻數(shù)據(jù)集。該數(shù)據(jù)集已被 NeurIPS 2024 的 Dataset Track 接收。

- 網(wǎng)站:https://drivingdojo.github.io/

- 論文:https://arxiv.org/pdf/2410.10738

- 代碼:https://github.com/Robertwyq/Drivingdojo

世界模型的核心在于交互、知識(shí)以及泛化

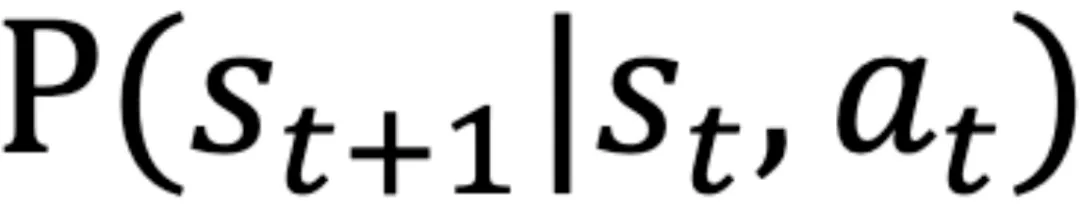

世界模型刻畫了智能體在當(dāng)前狀態(tài) 下采取特定動(dòng)作

下采取特定動(dòng)作 之后環(huán)境狀態(tài)所有可能的變化的分布

之后環(huán)境狀態(tài)所有可能的變化的分布 。相比于單純關(guān)注于

。相比于單純關(guān)注于 生成的圖像質(zhì)量,我們認(rèn)為其他道路參與者的行為(other agents behavior)以及整體的世界動(dòng)態(tài)(general world dynamics)也同樣值得關(guān)注,即世界模型的交互、知識(shí)以及泛化能力。

生成的圖像質(zhì)量,我們認(rèn)為其他道路參與者的行為(other agents behavior)以及整體的世界動(dòng)態(tài)(general world dynamics)也同樣值得關(guān)注,即世界模型的交互、知識(shí)以及泛化能力。

交互:世界模型應(yīng)具備合理預(yù)測(cè)動(dòng)態(tài)交互行為的能力。例如,在自動(dòng)駕駛場(chǎng)景中,系統(tǒng)需要準(zhǔn)確預(yù)測(cè)自車與行人或其他道路使用者之間的交互。除了理解靜態(tài)環(huán)境的變化,更重要的是能夠提供動(dòng)態(tài)反饋,以支持系統(tǒng)在復(fù)雜場(chǎng)景中的應(yīng)對(duì)。

知識(shí):世界模型應(yīng)具備對(duì)環(huán)境中世界知識(shí)的深刻理解。例如,在自動(dòng)駕駛場(chǎng)景中,系統(tǒng)需要能夠理解紅綠燈、升降桿等關(guān)鍵場(chǎng)景元素,以便作出恰當(dāng)?shù)鸟{駛決策。然而,僅通過像素級(jí)重建是否能準(zhǔn)確建模這些知識(shí)仍然存在疑問,因此引入語言模型成為提升系統(tǒng)理解能力的關(guān)鍵手段。

泛化:世界模型的預(yù)測(cè)能力應(yīng)能夠擴(kuò)展到新的未知場(chǎng)景,尤其是各種長(zhǎng)尾場(chǎng)景,如稀有事件或極端環(huán)境下的駕駛表現(xiàn)。這種泛化能力是確保模型在真實(shí)世界中穩(wěn)定運(yùn)行的關(guān)鍵。

DrivingDojo 數(shù)據(jù)集

DrivingDojo 數(shù)據(jù)集相較于傳統(tǒng)的感知數(shù)據(jù)集,經(jīng)過精心的挖掘與篩選,更加注重視頻多樣性的設(shè)計(jì)。從掉落的水桶、倒下的柵欄,到突然竄出的動(dòng)物、夜晚的篝火、路上的羊群,包含了海量的長(zhǎng)尾駕駛場(chǎng)景,為世界模型的研究提供了堅(jiān)實(shí)的基礎(chǔ)。

DrivingDojo 數(shù)據(jù)集包含大約 18k 個(gè)視頻,平均時(shí)長(zhǎng)約為 20 秒。整個(gè)數(shù)據(jù)集可以劃分為三個(gè)子集,分別聚焦于駕駛行為、動(dòng)態(tài)交互和世界知識(shí)的探索。

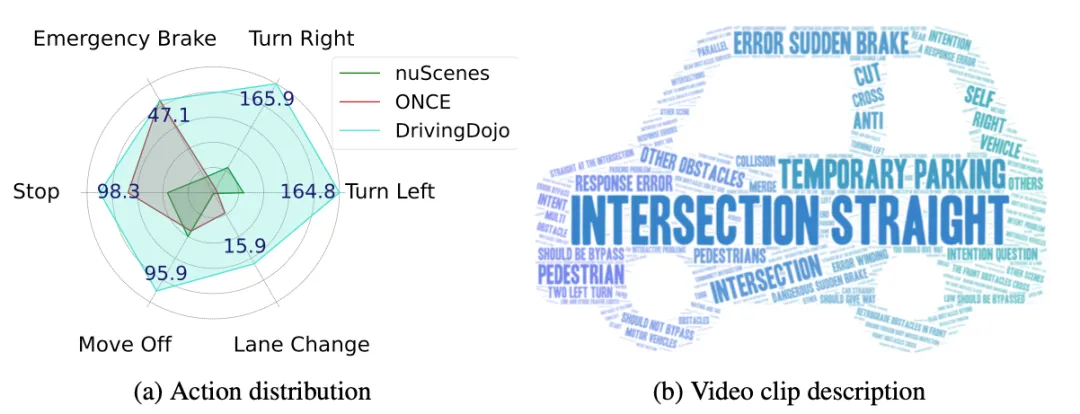

駕駛行為:還原真實(shí)駕駛操作的多樣性

我們精心構(gòu)建了一個(gè)名為 DrivingDojo-Action 的子集,全面覆蓋駕駛操作的多樣化場(chǎng)景,呈現(xiàn)縱向與橫向行為的均衡分布:

- 縱向操作:包含加速、減速、緊急剎車和起停駕駛,精準(zhǔn)展現(xiàn)車輛在速度調(diào)控中的動(dòng)態(tài)表現(xiàn)。

- 橫向操作:涵蓋變道和車道保持,細(xì)致描繪車輛在空間選擇和路徑優(yōu)化中的決策能力。

動(dòng)態(tài)交互:捕捉復(fù)雜交通中的行為模式

除了在靜態(tài)道路網(wǎng)絡(luò)環(huán)境中進(jìn)行導(dǎo)航外,建模多智能體之間的動(dòng)態(tài)交互(如并入和讓行)也是世界模型的一個(gè)關(guān)鍵任務(wù)。我們精心挖掘了這一子集,比如并線、會(huì)車、被阻擋、超車、被超車。這一子集為世界模型提供了豐富的交互場(chǎng)景,助力其更好地應(yīng)對(duì)復(fù)雜的交通環(huán)境。

世界知識(shí):賦能開放世界的智能理解

不同于感知和預(yù)測(cè)模型通過將高維傳感器輸入壓縮為低維向量表示,世界模型在像素空間中運(yùn)行,展現(xiàn)出更強(qiáng)的場(chǎng)景建模能力。這種增強(qiáng)的能力使得世界模型能夠有效捕捉開放世界駕駛場(chǎng)景中的復(fù)雜動(dòng)態(tài),例如動(dòng)物突然橫穿馬路或貨物從車輛后備廂掉落等意外情況。通過在像素層面上的深度理解,世界模型為處理復(fù)雜交通情境提供了更可靠的基礎(chǔ)。

推動(dòng)智能交互與知識(shí)驅(qū)動(dòng)的自動(dòng)駕駛世界模型

真實(shí)多樣的駕駛場(chǎng)景生成

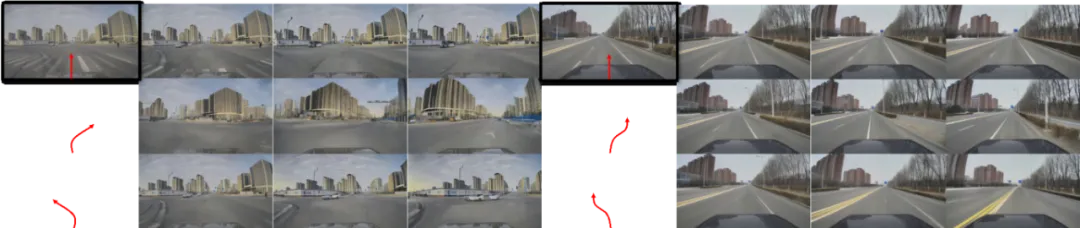

軌跡控制的視頻生成

給定初始幀和軌跡,世界模型預(yù)測(cè)未來的情景

預(yù)測(cè)不同的未來情景

我們提出了運(yùn)動(dòng)指令跟隨的視頻預(yù)測(cè)任務(wù),這也是世界模型的核心。以往的研究主要依賴于定性觀察,而在實(shí)際駕駛中,控制精度需要通過定量指標(biāo)進(jìn)行評(píng)估。由于生成視頻中缺少真實(shí)軌跡,我們采用了 COLMAP 重建方法對(duì)生成的軌跡進(jìn)行重建,從而實(shí)現(xiàn)粗略的定量評(píng)測(cè)。

利用 COLMAP 估計(jì)生成視頻的軌跡

生成能力的泛化

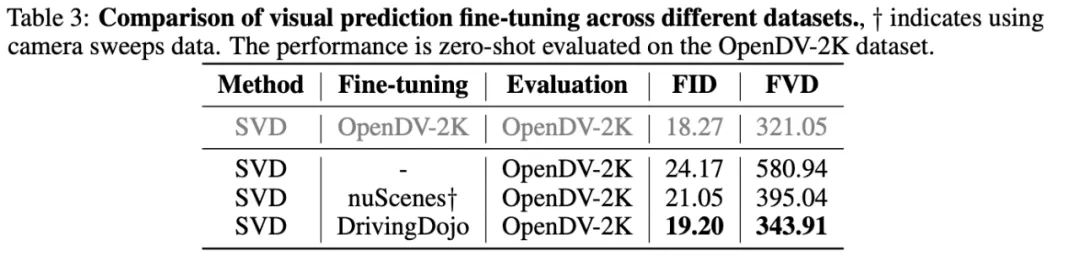

與以往在同一數(shù)據(jù)集上進(jìn)行的生成測(cè)試相比,我們認(rèn)為跨數(shù)據(jù)集的測(cè)試更為重要,這更好地體現(xiàn)了模型的泛化生成能力。在測(cè)試過程中,我們選擇了 OpenDV 的子集來進(jìn)行評(píng)估。

我們也期望模型具備良好的泛化能力:如運(yùn)動(dòng)行為的泛化,以及跨數(shù)據(jù)集的運(yùn)動(dòng)行為泛化。

1. 異常行為生成 2. 在 nuScenes 數(shù)據(jù)集實(shí)現(xiàn)倒車

交互行為的預(yù)測(cè)

這一部分的核心在于探索世界模型是否能夠根據(jù)不同行為的輸入預(yù)測(cè)智能體之間的交互動(dòng)態(tài)。以下示例中,當(dāng)自車選擇停車時(shí),模型預(yù)測(cè)右前方的車輛會(huì)搶占道路進(jìn)行超車;而當(dāng)自車選擇繼續(xù)前行時(shí),模型則預(yù)測(cè)右前方的車輛會(huì)等待自車先通過。

長(zhǎng)時(shí)間高質(zhì)量駕駛視頻生成