細粒度對齊無需仔細標注了!淘天提出視覺錨定獎勵,自我校準實現多模態對齊

核心作者包括顧紀豪,王瑛瑤。工作由淘天集團算法技術 - 未來生活實驗室團隊主要完成。為了建設面向未來的生活和消費方式,進一步提升用戶體驗和商家經營效果,淘天集團集中算力、數據和頂尖的技術人才,成立未來生活實驗室。實驗室聚焦大模型、多模態等 AI 技術方向,致力于打造大模型相關基礎算法、模型能力和各類 AI Native 應用,引領 AI 在生活消費領域的技術創新。

近年來,視覺大模型(Large Vision Language Models, LVLMs)領域經歷了迅猛的發展,這些模型在圖像理解、視覺對話以及其他跨模態任務中展現出了卓越的能力。然而,隨著 LVLMs 復雜性和能力的增長,「幻覺現象」的挑戰也日益凸顯。

為有效緩解 LVLMs 中的幻覺現象,團隊提出了一種創新的令牌級偏好對齊方法(Token Preference Optimization,TPO),針對性設計了一個能夠自我校準的視覺錨定獎勵信號。

該方法首次在多模態偏好對齊領域實現了自動校準獎勵,優化每個令牌生成時與視覺信息的相關性。同時,它也是多模態領域首個無需人工細粒度標注的令牌級偏好優化方法,從而提升了模型的優化效率和自動化水平。

- 論文標題:Token Preference Optimization with Self-Calibrated Visual-Anchored Rewards for Hallucination Mitigation

- 作者單位:阿里巴巴淘天集團 & MBZUAI

- 論文鏈接:https://arxiv.org/pdf/2412.14487

背景

現如今的 DPO 方法通過直接對齊人類偏好,在緩解大型視覺語言模型幻覺問題方面取得了顯著成效。然而它仍然面臨兩個問題:

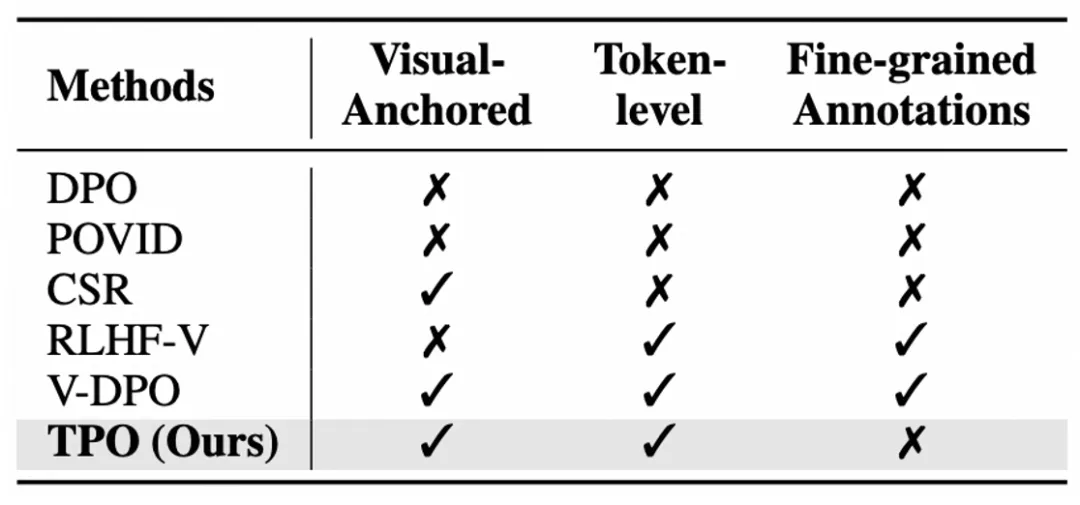

- 缺少高效和可擴展的 token-level 的獎勵信號:如圖 1 所示,現有的多模態偏好對齊方法要么使用 sequence-level 的獎勵,要么需要通過細粒度標注獲得 token- level 的監督信號。因此,設計一個高效且可擴展的 token-level 的監督信號非常重要。

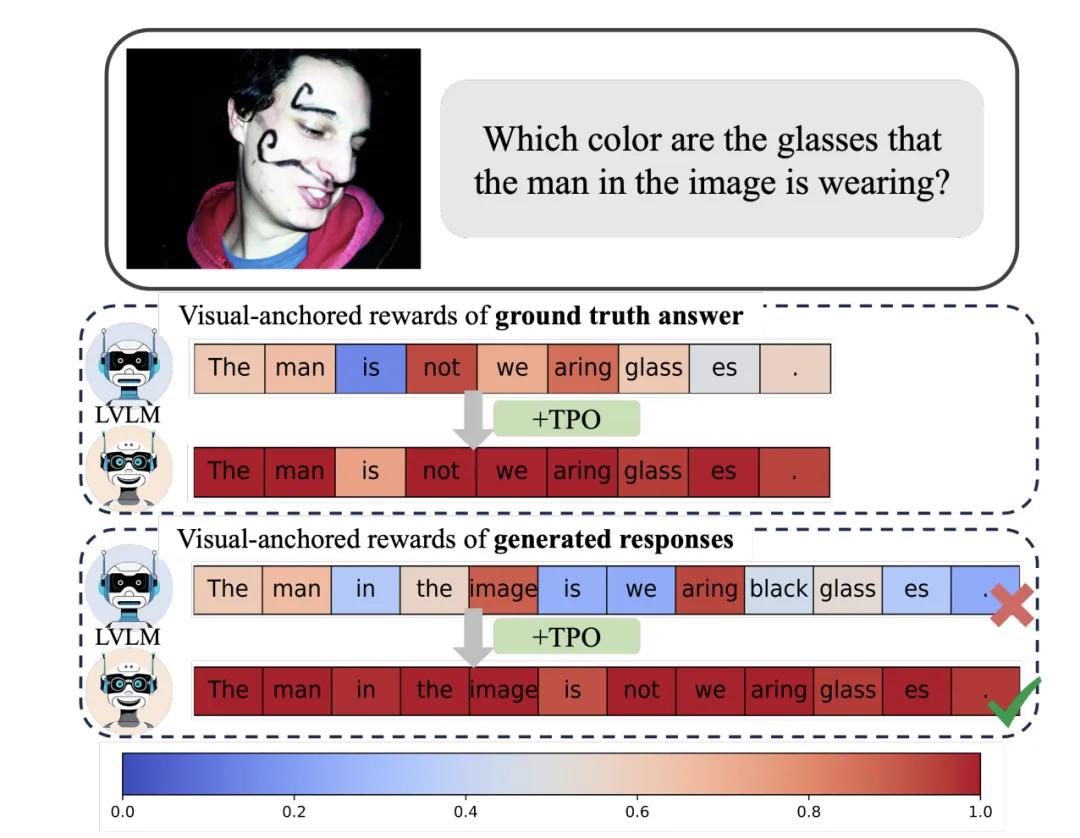

- 在訓練的過程中忽略了視覺錨定的 tokens(visual-anchored tokens)對所有 token 分配相同的獎勵是低效的,依賴視覺信息生成的 tokens 更容易產生幻覺并需要重點對待(如圖 2 中的 glass)。

圖 1:TPO 方法和其它消除幻覺的 DPO 改進方法的對比。比較了是否關注視覺錨定信息,是否生成 token-level 的監督信號和是否需要細粒度標注。比較的方法包括 DPO、POVID、CSR、RLHF-V、V-DPO 和論文中的方法 TPO。

為了解決上述問題,TPO 具有如下特點:

- 自動識別偏好數據中的視覺錨定 token,無需人工細粒度標注。

- 在每個訓練步自動地分配 token-level 的獎勵,該獎勵可以反映當前 token 對圖片信息的依賴程度。

圖 2 可視化了 TPO 訓練前后的 ground truth 及模型回復的視覺錨定獎勵。可以看到,我們的方法有效地找到了視覺錨定的 tokens,并能夠在訓練之后增強模型對視覺信息的關聯。

圖 2:一個視覺 QA 對的例子以及 TPO 對視覺信息錨定程度的打分可視化,上面的框是 GT_answer,下面的框是 LVLM 在使用 TPO 訓練前后的回復。在每一個框中,上方是 TPO 訓練前的打分,下方則是訓練后的打分。

方法

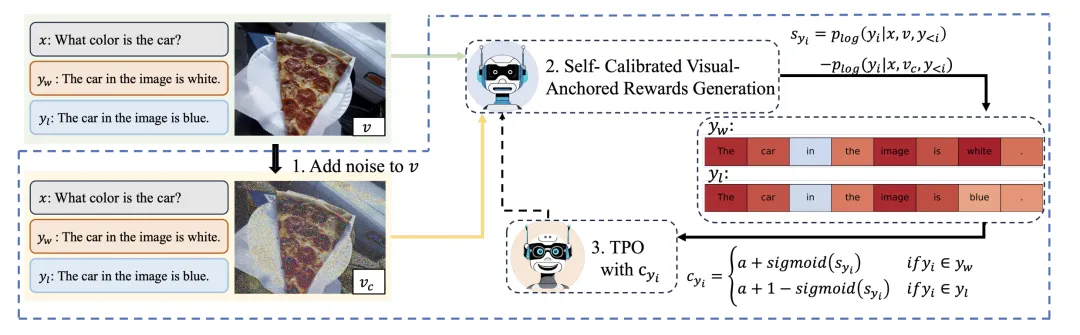

圖 3:TPO 的整體流程

TPO 整體流程

(以下步驟中的數據包含輸入 x,圖像 v 和正負樣本 y_w,y_l。當不強調正樣本或負樣本時,統稱為 y.)

1. 自校準的視覺錨定獎勵生成

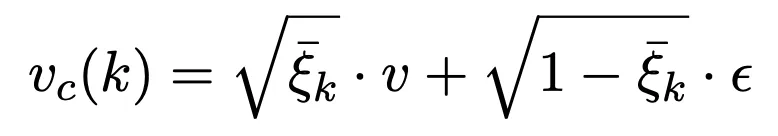

TPO 通過捕捉在圖像是否加噪時每個生成 token 的生成概率差的變化來衡量其視覺錨定程度,首先對輸入圖像進行加噪處理:

這里 ε ∈ N(0,1), ,

, 是提前設置好的噪聲參數,是含有 1000 個元素呈等差數列的列表。k 代表加噪步數。

是提前設置好的噪聲參數,是含有 1000 個元素呈等差數列的列表。k 代表加噪步數。

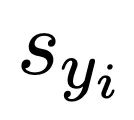

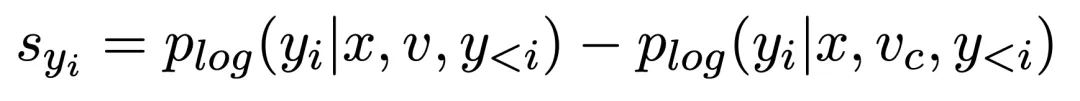

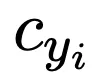

在獲得了加噪圖像之后,計算 ,用來反映每個 token 的視覺錨定程度。它可以在每個訓練步中的自動更新,對于 y 中的每一個 token

,用來反映每個 token 的視覺錨定程度。它可以在每個訓練步中的自動更新,對于 y 中的每一個 token :

:

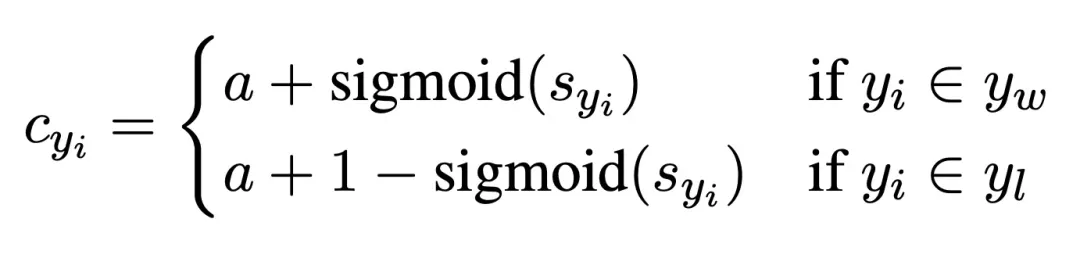

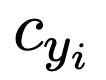

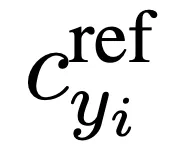

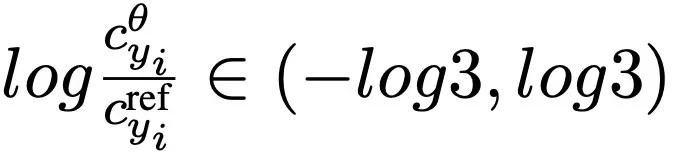

進一步地,在此引入自我校準的過程獲得最終的監督信號。這一步的目的是為正負樣本分配相應獎勵的同時,能夠對二者中所有視覺錨定 token 進行視覺信息關聯度的優化。最終的視覺監督信號被定義為:

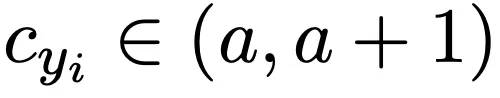

通過 sigmoid 歸一化, 。可以看出,對于正樣本,監督信號 c 隨 s 的增大而增大,對于負樣本則相反。由于當

。可以看出,對于正樣本,監督信號 c 隨 s 的增大而增大,對于負樣本則相反。由于當  時,該 token 沒有錨定視覺信息,無監督信號,此時設置 a=0.5, s=0,則 c=1,監督信號將不發揮作用。

時,該 token 沒有錨定視覺信息,無監督信號,此時設置 a=0.5, s=0,則 c=1,監督信號將不發揮作用。

TPO 訓練

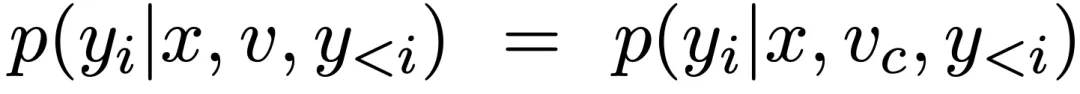

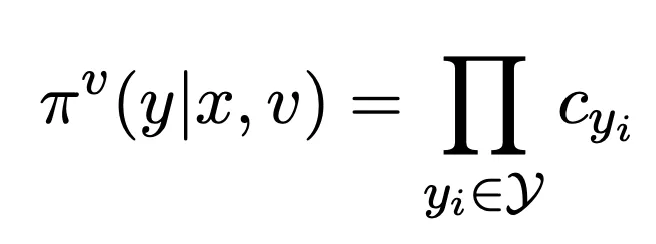

在獲得了自校準的視覺錨定信號 之后,可以根據 DPO 方式定義新的視覺錨定分布:

之后,可以根據 DPO 方式定義新的視覺錨定分布:

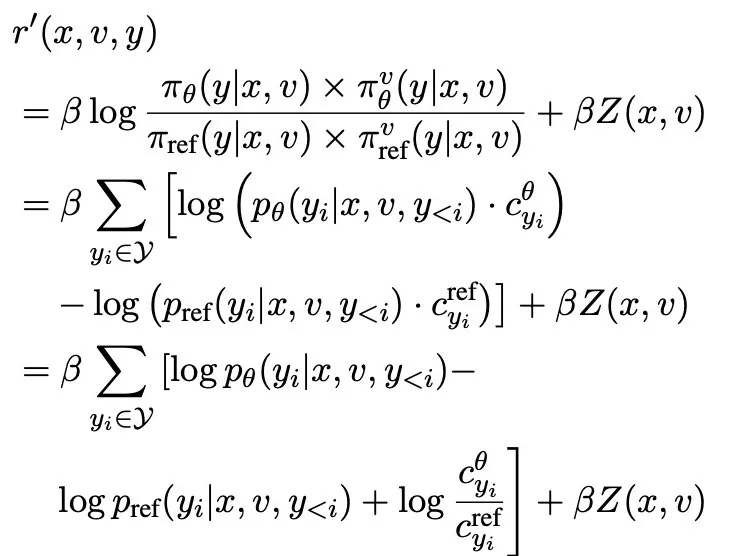

則反饋函數為:

其中 和

和 分別代表來自 policy 模型和 reference 模型的反饋信號。可以看到,相對于原始的 DPO,該團隊在此基礎上為每一個 token 加入了監督信號

分別代表來自 policy 模型和 reference 模型的反饋信號。可以看到,相對于原始的 DPO,該團隊在此基礎上為每一個 token 加入了監督信號 ,而且

,而且 可以在訓練過程中的每一個 step 中迭代,達到自我校準的目的。

可以在訓練過程中的每一個 step 中迭代,達到自我校準的目的。

TPO 在反饋函數中引入了 ,該項可以推導出合理的上下界。由于正負樣本不同的

,該項可以推導出合理的上下界。由于正負樣本不同的 計算方法,在訓練過程中會讓

計算方法,在訓練過程中會讓 不斷增大,讓模型輸出錨定更多的視覺信息。

不斷增大,讓模型輸出錨定更多的視覺信息。

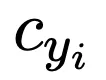

最終得到 TPO 的優化目標為:

實驗結果

實驗設置

- 基礎模型:LLaVA-1.5(7B)/(13B)。

- 數據:RLHF-V(5k)。

- Benchmark:幻覺評測集 AMBER、MMHal、HallusionBench,通用評測集 SeedBench、MMBench、LLaVA-Bench 及 MM-Vet。

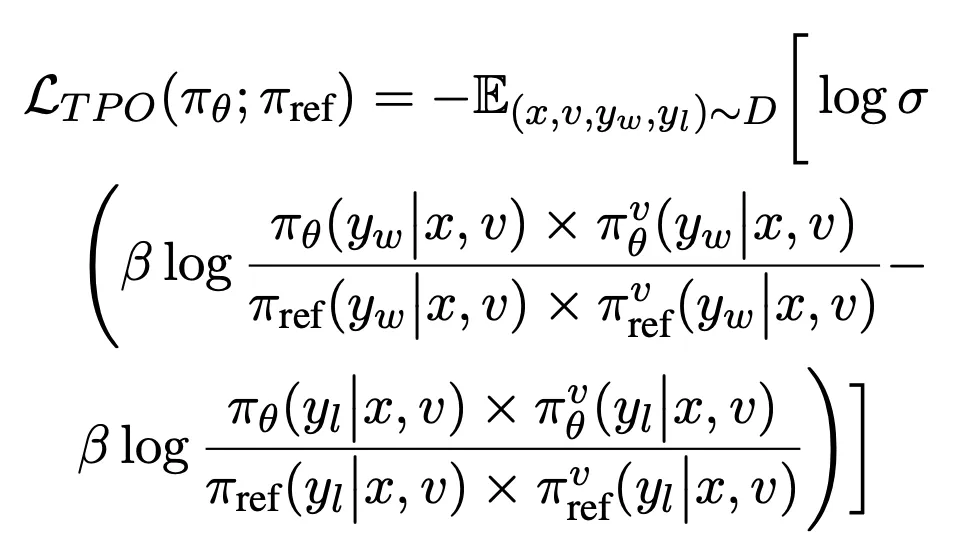

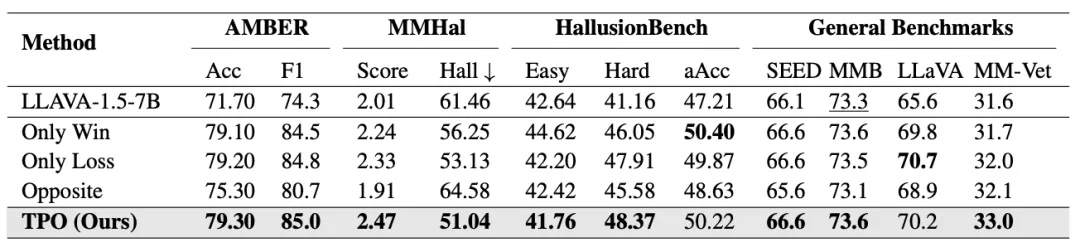

主實驗結果

圖 4:各種強化學習方法在 LLaVA-1.5 上測試的在幻覺和通用 benchmarks 上的實驗效果,其中 POVID 和 CSR 方法的結果是根據開源的模型權重測試的效果,V-DPO 的結果來自該文章的結果。

- TPO 在 LLaVA-1.5(7B)/(13B)模型上均帶來非常顯著的幻覺緩解效果,在大部分幻覺指標上超越了現有的偏好對齊幻覺緩解方法。

- 在 HallusionBench 中,easy 代表基于原圖問答,hard 代表基于人工編輯的反事實圖片問答。我們的方相較于初始模型在 hard 問題上取得了更顯著的提高,說明在 TPO 后,答案生成更依賴于視覺信息而非語言模型先驗知識。

消融實驗

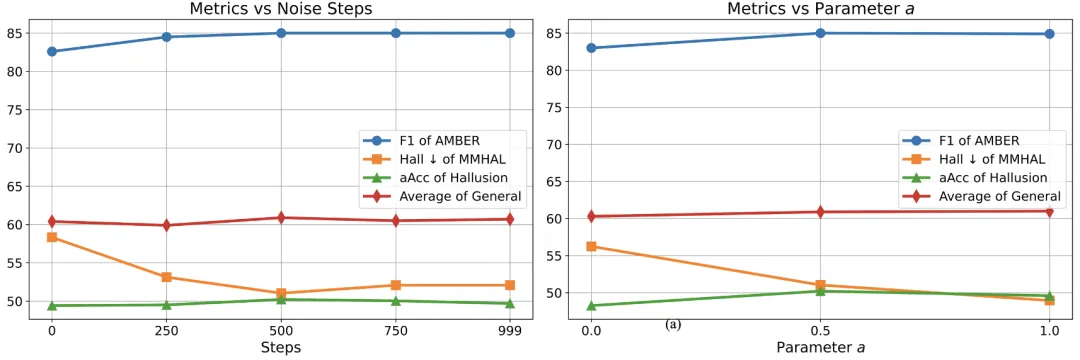

- 圖像加噪的 steps 數量:如圖 5 顯示,加噪步數設置為 500 最優。

- 獎勵自校準中的 a: a=0.5 最優,即當 s=0 時,c=1 時,不分配獎勵信號。

圖 5: 各指標隨著加入噪聲步數和參數 a 的變化趨勢

- 獎勵分配方式:只為正樣本或負樣本單獨引入 TPO 的獎勵,也可取得較優的對齊效果,但同時分配獲得最優表現。調換正負樣本中 token 獲取的獎勵和其視覺錨定程度的相關性,TPO 表現變差。

圖 6: 消融實驗

分析實驗

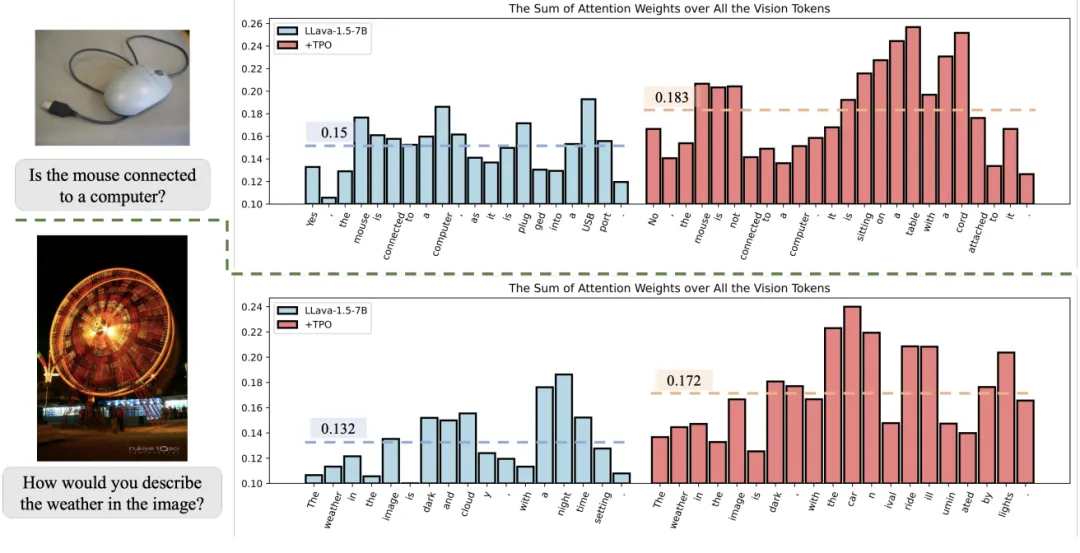

- Attention 分析:圖 7 展示了在 TPO 訓練前后,模型回復中每個 token 對圖像 token 的 attention 分數加和的分布。可以看到,TPO 訓練可以拉高模型回復對圖像信息的關聯程度,錨定更多圖像信息,進而緩解幻覺問題。

圖 7:attention weights 對比圖,左邊藍色的是訓練前模型回答錯誤的回復,右邊紅色的是訓練后模型回答正確的回復。

圖 7:attention weights 對比圖,左邊藍色的是訓練前模型回答錯誤的回復,右邊紅色的是訓練后模型回答正確的回復。

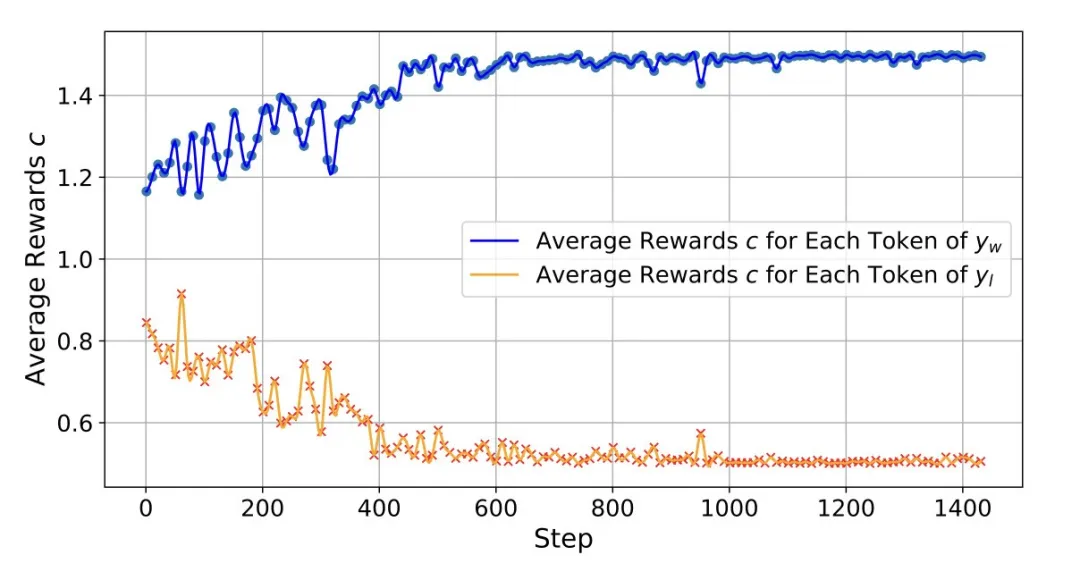

- 獎勵自校準分析:圖 8 展示了正負樣本的監督信號 c 隨訓練 step 的變換,證明了 TPO 在不斷自我校準獎勵的過程中,讓模型逐漸關注到更多的圖像信息。

圖 8: 正負樣本的 c 隨訓練 step 得變化過程

淘天集團算法技術 - 未來生活實驗室團隊將持續深耕強化學習領域,為解決多模態幻覺問題貢獻力量。