東京大學 | Adobe 提出InstructMove,可通過觀察視頻中的動作來實現基于指令的圖像編輯

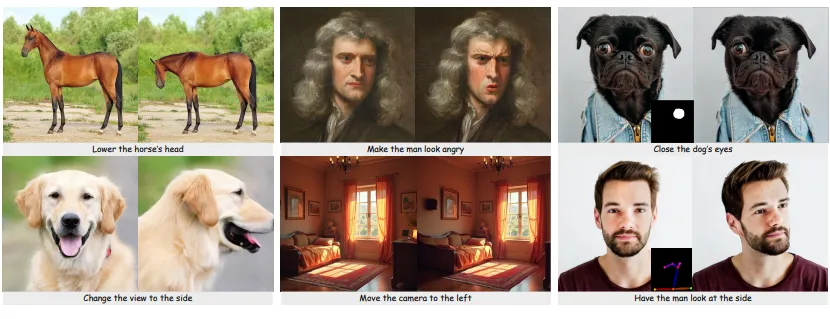

InstructMove是一種基于指令的圖像編輯模型,使用多模態 LLM 生成的指令對視頻中的幀對進行訓練。該模型擅長非剛性編輯,例如調整主體姿勢、表情和改變視點,同時保持內容一致性。此外,該方法通過集成蒙版、人體姿勢和其他控制機制來支持精確的局部編輯。

相關鏈接

- 論文:http://arxiv.org/abs/2412.12087v1

- 主頁:https://ljzycmd.github.io/projects/InstructMove/

論文介紹

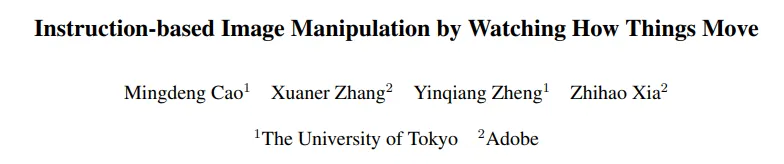

通過觀察事物如何移動的基于指令的圖像操作

摘要

本文介紹了一種新穎的數據集構建流程,該流程從視頻中抽取幀對并使用多模態大型語言模型 (MLLM) 生成編輯指令,以訓練基于指令的圖像處理模型。視頻幀本質上保留了主體和場景的身份,確保在編輯過程中內容保存的一致性。此外,視頻數據捕捉了各種自然動態(例如非剛性主體運動和復雜的相機運動),否則很難建模,使其成為可擴展數據集構建的理想來源。使用這種方法,我們創建了一個新數據集來訓練 InstructMove,該模型能夠進行基于指令的復雜操作,而這些操作很難通過合成生成的數據集實現。我們的模型在調整主體姿勢、重新排列元素和改變相機視角等任務中表現出最先進的性能。

方法

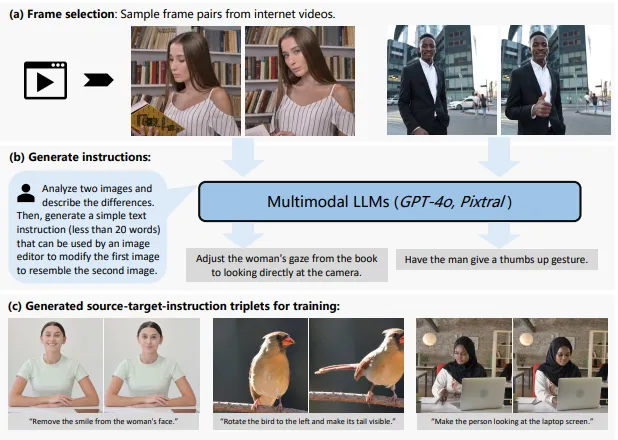

數據構建管道:

- 首先從視頻中采樣合適的幀對,確保轉換逼真且適度。

- 這些幀對用于提示多模態大型語言模型 (MLLM) 生成詳細的編輯指令。

- 此過程會產生一個具有逼真圖像對和精確編輯指令的大規模數據集。

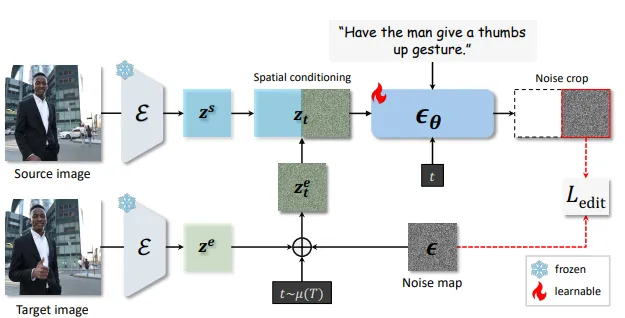

基于指令的圖像編輯的模型架構概述。首先使用預訓練編碼器將源圖像和目標圖像編碼為潛在表示 zs和 ze。然后通過前向擴散過程將目標潛在 z e轉換為噪聲潛在 zet。沿寬度維度連接源圖像潛在和噪聲目標潛在以形成模型輸入,該輸入被輸入到去噪 U-Net ?θ 中以預測噪聲圖。輸出的右半部分(對應于噪聲目標輸入)被裁剪并與原始噪聲圖進行比較。

結果

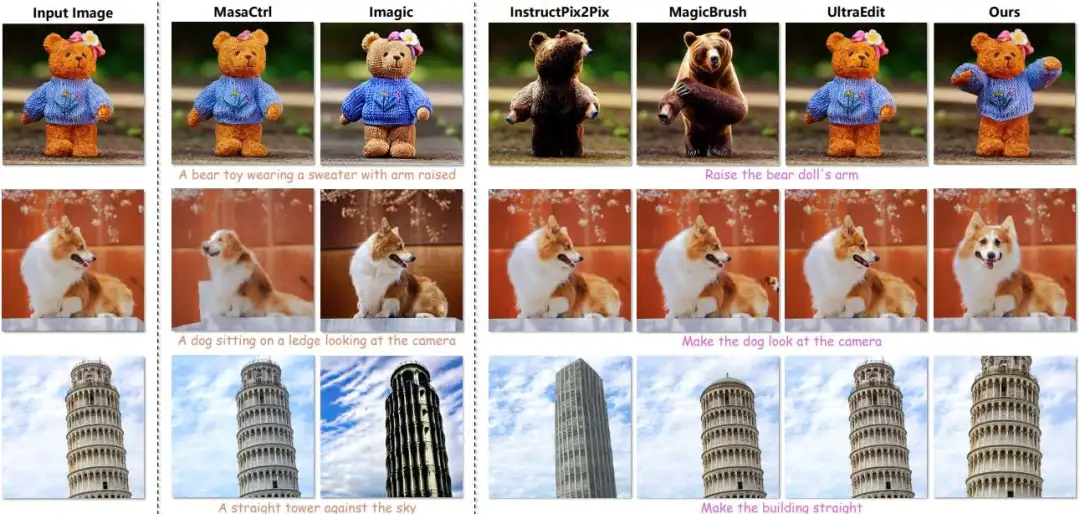

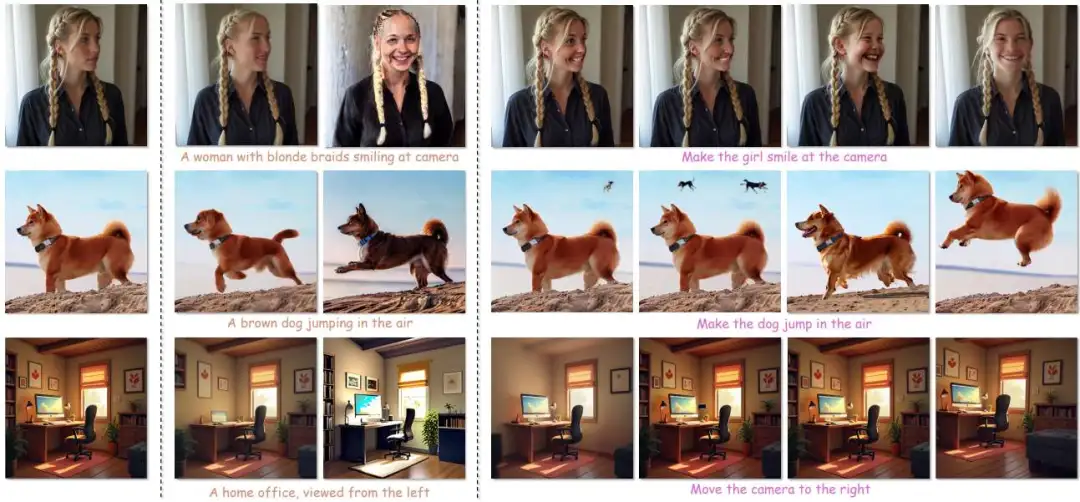

與最先進的圖像編輯方法進行定性比較,包括基于描述和基于指令的方法。現有方法難以處理復雜的編輯,例如非剛性變換(例如姿勢和表情的變化)、對象重新定位或視點調整。它們通常要么無法遵循編輯說明,要么產生不一致的圖像,例如身份轉變。相比之下,論文的方法在具有自然變換的真實視頻幀上進行訓練,成功處理了這些編輯,同時保持了與原始輸入圖像的一致性。

與最先進的圖像編輯方法進行定性比較,包括基于描述和基于指令的方法。現有方法難以處理復雜的編輯,例如非剛性變換(例如姿勢和表情的變化)、對象重新定位或視點調整。它們通常要么無法遵循編輯說明,要么產生不一致的圖像,例如身份轉變。相比之下,論文的方法在具有自然變換的真實視頻幀上進行訓練,成功處理了這些編輯,同時保持了與原始輸入圖像的一致性。

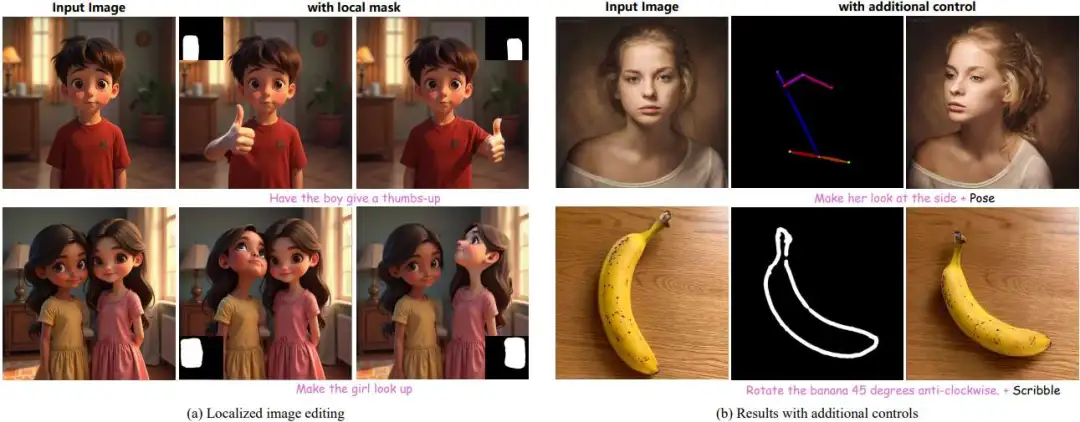

該方法與附加控制的定性結果。

該方法與附加控制的定性結果。

- 模型可以利用掩碼來指定要編輯圖像的哪個部分,從而實現局部調整并解決指令中的歧義。

- 與 ControlNet 結合使用時,該模型可以接受其他輸入,例如人體姿勢或草圖,以實現對主體姿勢或物體定位的精確編輯。 以前的方法無法實現這種級別的控制。

結論

文章提出了一種對視頻幀進行采樣并利用 MLLM 生成編輯指令以訓練基于指令的圖像處理模型的方法。與依賴于合成生成的目標圖像的現有數據集不同,該方法利用來自視頻和 MLLM 的監督信號來支持復雜的編輯,例如非剛性變換和視點變化,同時保持內容一致性。未來的工作可以集中在改進過濾技術上,無論是通過改進 MLLM 還是結合人機交互過程,以及將視頻數據與其他數據集集成以進一步增強圖像編輯功能。