2024年大模型LLM還有哪些可研究的方向?聽聽大佬怎么說

問:

2024年大模型LLM還有哪些可研究的方向?

答:

前言

純屬brainstorm,歡迎大家一起探討。想到哪里說到哪里,有遺漏的點歡迎大家在評論區中指出。

個人認為現在LLM能做的點還很多,這個行業距離飽和還有一段距離。這里通過“輸入、模型/范式、輸出、其他”幾個方面來展開,個人覺得比較看好的方向加粗標出:

- 輸入

- 數據優化

- RAG

- 模型/范式

- LLM + Robotics-Agent-統一模態生成-Vision-Language Models-架構設計

- 輸出

- 生成內容安全問題

- 評測問題

- 其他

- NLP經典任務

- 垂類大模型

- 交叉學科

輸入

這一節就跟pre-training、instruction tuning、RLHF的經典三階段比較相關了,其實也可以叫數據,而數據的重要性自然不用多說。

數據優化

目前的工作基本都是“大規模語料 + 人工高質量數據集” 的方式進行暴力求解,在輸入上通過設計進行優化還是有一定可行之處的。

其實CV這邊還是有很多類似做法可以參考的,尤其是做diffusion models的,同樣也是做生成,有很多方面有一定共通之處。比方說最經典的Stable Diffusion,從最早的v1.4到v2.0,再到v2.1,也是通過在256×256、512×512、768×768分辨率上遞進式的fine-tune完成的。

遷移到LLM這一塊,對于pre-training的時候語料的處理,可以做ranking,包括fine-tune的時候做continual learning、active learning等等,理論上可做的事以及相應的效果應該也是相近的。

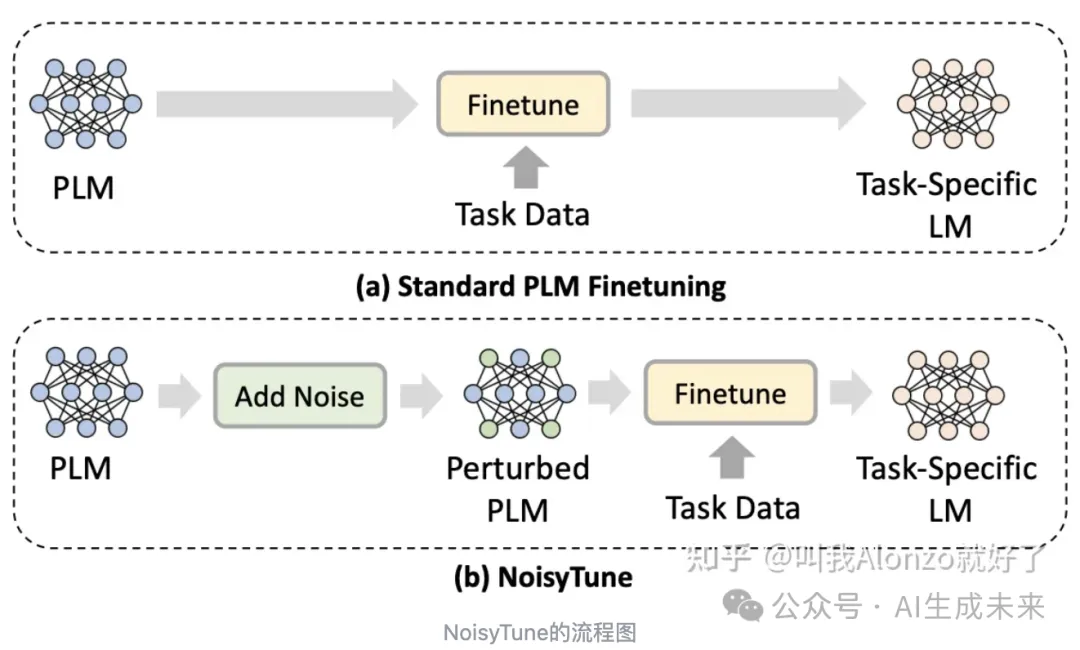

關于data augmentation方面,之前看過一篇在LLM訓練過程中往intermediate feature加高斯噪聲的工作,證明了能夠帶來性能提升。結論其實是比較有趣的,往intermediate feature加入噪聲的做法可以理解為一種latent space上的data augmentation但如此簡單的做法恰好證明了其有效性,說明在數據增強這一塊可做的設計還有很多。感興趣的朋友可以移步原文:《NoisyTune: A Little Noise Can Help You Finetune Pretrained Language Models Bette》,https://zhuanlan.zhihu.com/p/523865674。

相關回答可以參考:大模型微調技巧-在Embedding上加入噪音提高指令微調效果,https://zhuanlan.zhihu.com/p/662024086

RAG

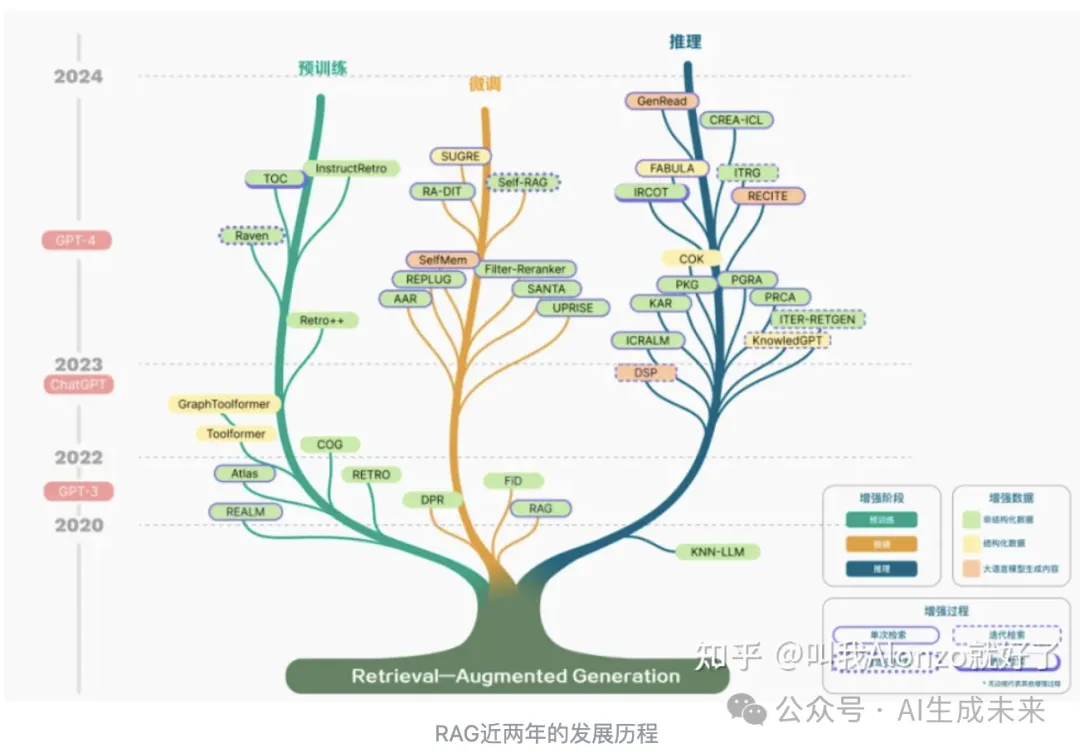

RAG這一塊屬于是去年比較火的一個點了,尤其是針對大模型“幻覺”的這個痛點,個人認為還可以做,但屬于比較卷的方向,今年的研究應該會有數量上的驟增。可以看下RAG的近幾年的文章情況:

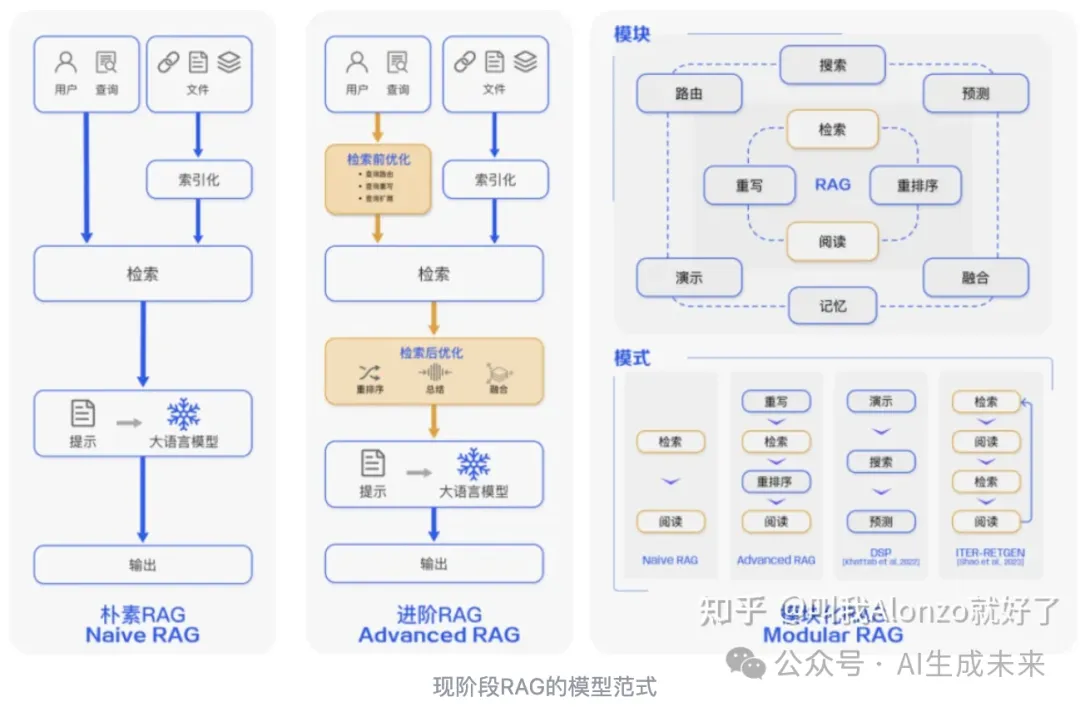

可以看到,2023年RAG的工作已經出現了明顯的大幅增加,而大多數還是集中在做推理,也就是說,預訓練和微調還有研究空間。可以參考下圖匯總目前RAG的研究范式展開:

另一方面可以考慮的是模態信息上的拓展。目前看來做Vision-Language Models(VLM)已經是一個必然趨勢了,而RAG方法主要用于檢索文本證據,檢索其他模態信息來增強生成還是有研究空間的。

模型/范式

“模型/范式”這一方面是個人比較看好的方向。 目前AI巨頭的動作也集中于這一塊,預計2024年這一塊可研究的方向比較多,當然估計也會快速地卷起來。

LLM + Robotics

前段時間OpenAI發布了Figure 01,雖然說熱度可能沒有Sora那么高,不過說明LLM在做planning這件事上已經有了初步的成果,想必這件事情的公布勢必會帶動很多的相關研究。具體的分析可以參考我的往期回答:如何看待與Open AI合作的最新機器人成果Figure 01? https://www.zhihu.com/question/648483312/answer/3432436569

Agent

Figure 01的意義其實不僅限于robotics,其實也證明了agent的想法確實可行,agent勢必會成為今年的一大熱點。其實早在去年,各大廠商都紛紛開始入場agent了.

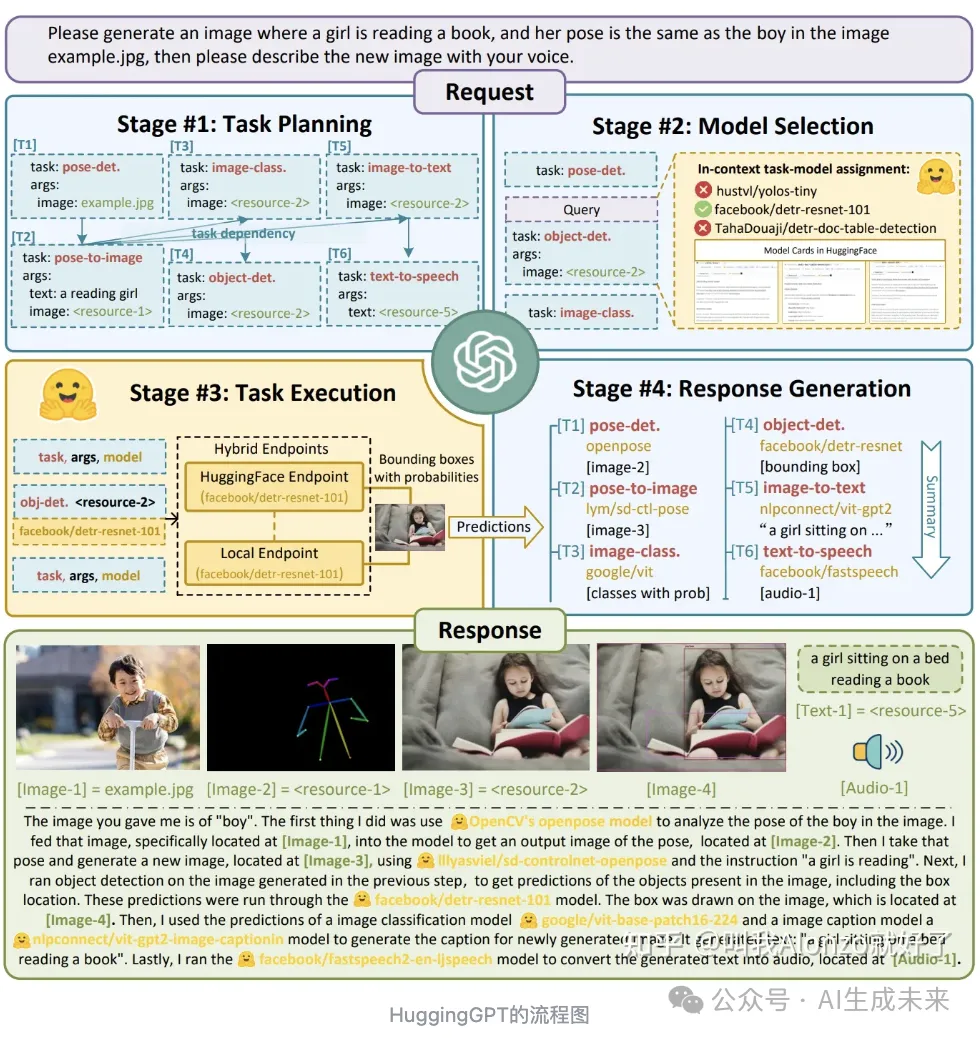

學術界也不例外,這里舉一些比較經典的例子:比方說早期的HuggingGPT,出自《HuggingGPT: Solving AI Tasks with ChatGPT and its Friends in Hugging Face》,https://arxiv.org/pdf/2303.17580.pdf。

ToolFormer,出自《Toolformer: Language Models Can Teach Themselves to Use Tools》,https://arxiv.org/pdf/2302.04761.pdf。

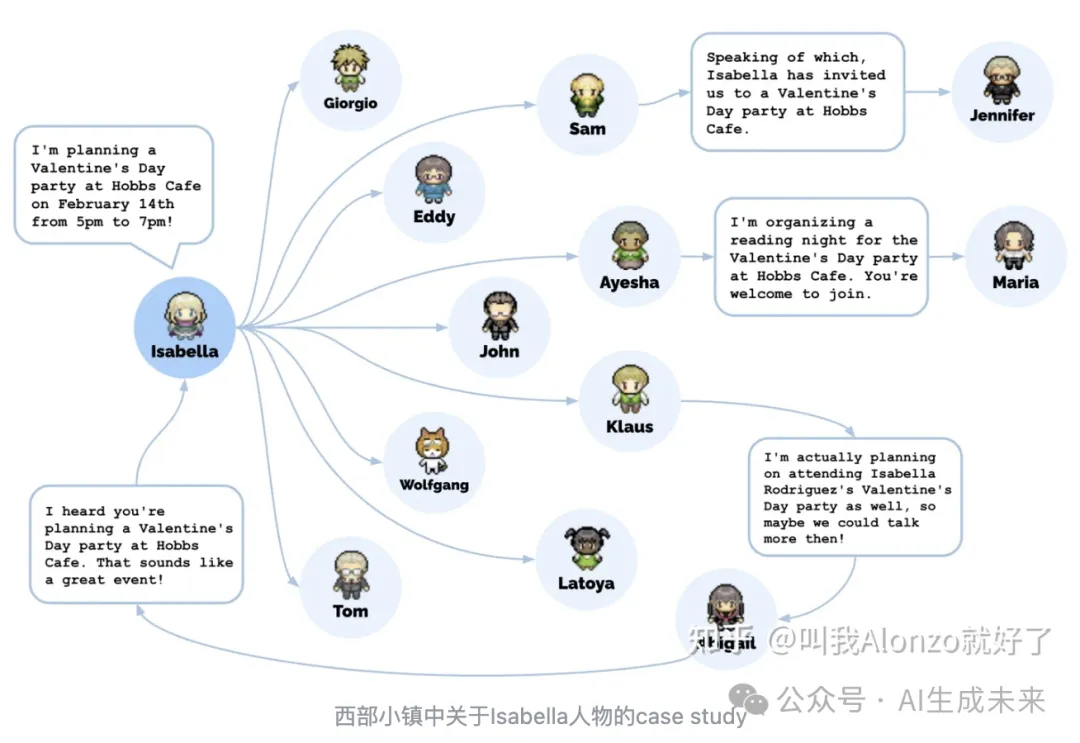

尤其是去年Stanford的西部小鎮,出自《Generative Agents: Interactive Simulacra of Human Behavior》,https://arxiv.org/pdf/2304.03442.pdf,給人的印象非常深刻:

統一模態生成信息

這一點其實是長久以來CV和NLP研究者關注的問題, 也就是多模態大一統的問題。而在生成這個角度上其實已經有一些統一范式了,無論是Diffusion-Based還是LLM-Based。而LLM-Based的解決方案中,真正的難點在于如何通過token這個概念表征其他模態的數據。

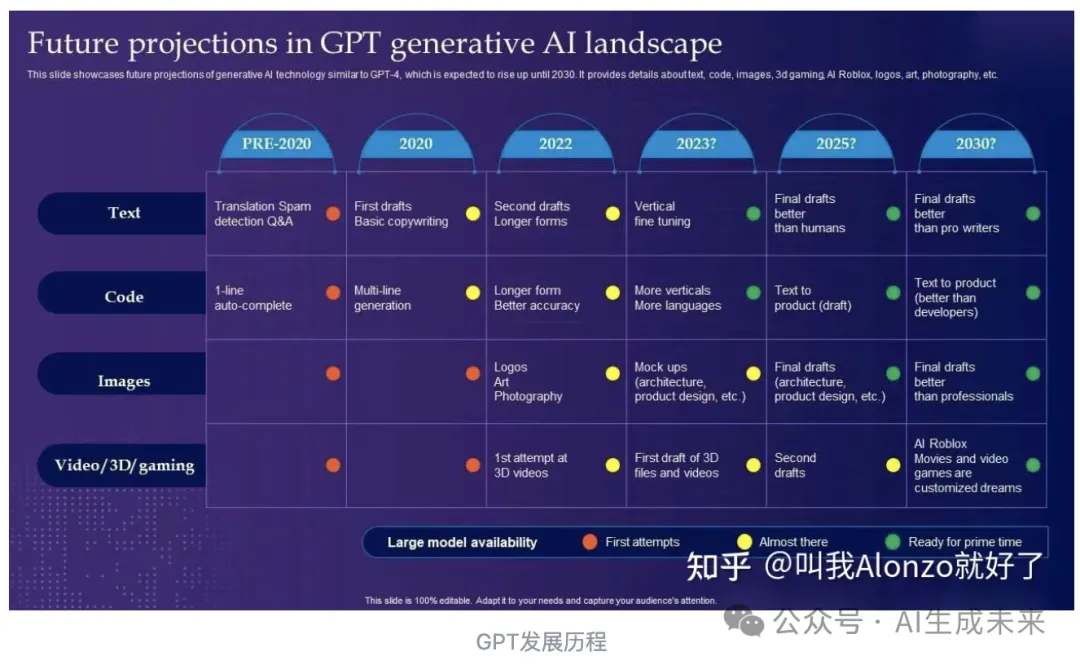

目前統一文本、圖像模態的工作已經有很多,解決方案也很自然,采用VQ-VAE系列的壓縮模型將圖像表征為image token,LLM只需要學會怎么預測image token即可。而下一步的生成面向的必然是視頻和3D。如果能解決好video和3D的token representation問題,那么統一模態生成就能進一步拓展,這其中還是有較大難度的,非常值得深挖。另外結合我個人非常有感觸的一張圖,也同樣能說明這個問題:

Vision-Language Models

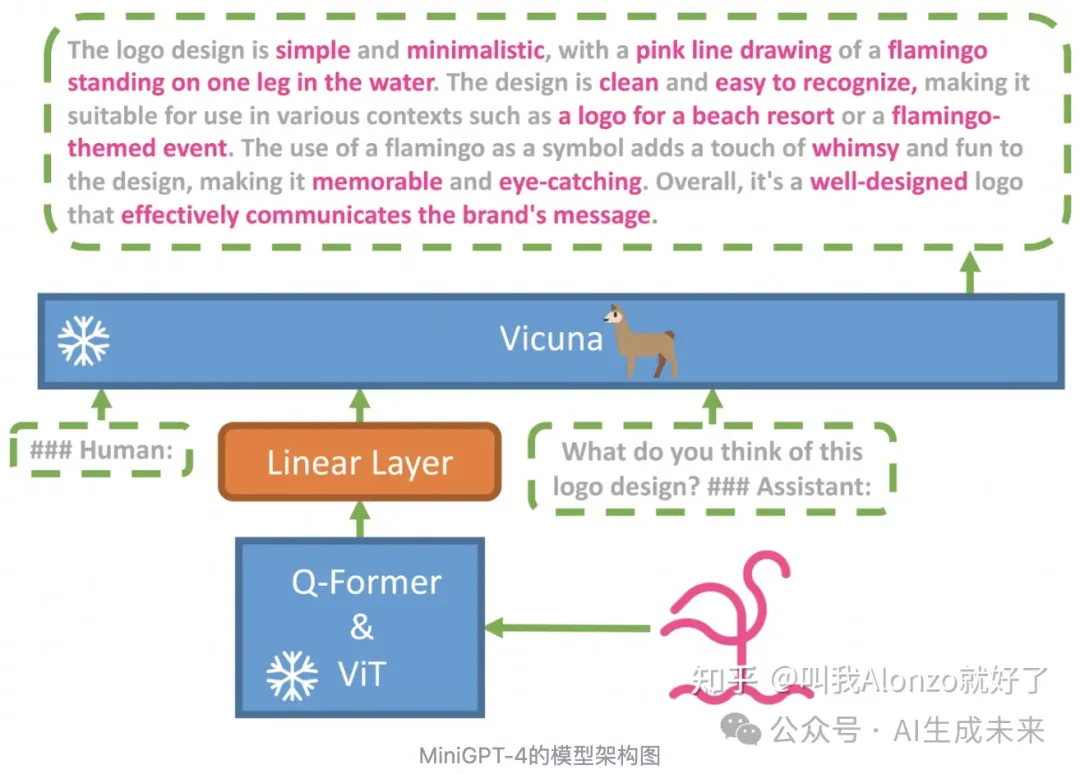

對于VLM來說,圖像相關的工作已經日趨飽和了,類似MiniGPT-4、LLaVA、mPlug-owl、CogVLM的經典工作已經有不少了,大多采用“Visual Encoder + LLM”的橋接形式,例如最經典的MiniGPT-4:

而前面說到,視頻和3D必定是下一波熱點的研究方向。將LLM與更多的模態信息“橋接”,肯定是可以做的,不過這樣的idea也很容易想到,個人認為VLM應該會非常卷。加上還要面對OpenAI這個大魔王,應該會有一定的研究壓力。

另外一個比較值得研究的問題是:跨模態信息對齊之后能做什么?其實去年一些工作已經證明,LLM除了常見的Visual QA、captioning這些任務,也能一定程度完成vision-oriented的任務,例如有些研究會用VLM在object detection上做驗證,以此體現VLM的visual understanding能力,這其實說明LLM的應用并不局限于text-oriented的下游任務。

架構設計

架構設計方面,其實近段時間的一些工作動向也證明了目前LLM在架構設計上還有較大創新空間。比方說去年比較驚艷的Mistral-7b,包括前不久馬斯克宣布開源的Grok-1等等,基本都采用MoE的架構在做,個人覺得這其實是一個比較好的開始。LLM的模型架構自2022年以來就雷打不動,絕大部分研究都在沿用前人的默認設定,而對于這些默認設定上存在的問題,絕對是有研究可做的。

?

其實反觀diffusion models的發展也類似,從2020年DDPM推出以來,4年時間絕大部分的研究都在沿用U-Net的默認架構,今年的Sora,包括Stable Diffusion 3中首次不約而同用到了Diffusion Transformer,證明了模型架構上確實是有值得創新之處。類比到LLM上也同理。

關于Diffusion Transformer相關的講解,可以參考我的往期文章:Diffusion Transformer Family:關于Sora和Stable Diffusion 3你需要知道的一切,??https://zhuanlan.zhihu.com/p/684448966。??

另一方面,Scaling Law肯定是一個值得研究的方向。 類似的還有關于LLM的可解釋性,目前LLM大部分研究都是靠數據和算力的堆積來暴力求解,如果能夠摸索出一定的理論依據,對于工業界或者是學術界來說都會是非常難得的研究。類似的方向還有LLM幻覺問題上的相關研究。

輸出

生成內容安全問題

生成內容的安全問題其實也在逐漸受到近期研究的關注了,比方說LLaMa 2中就有特別關注這個問題。其實生成內容的安全問題涉及很多其他的應用,比方說垂類應用。無論是金融、法律、醫療,這些特定領域在內容安全性上都會比general domain的要求要更高。能給出安全性問題的一定解決方案,對于整個社區來說肯定是有貢獻的。

具體解決安全問題其實跟前面提到的幾個點有一定交叉,例如從數據層面上做優化、微調階段做優化、RAG,等等,這里就不再展開了。

評測問題

個人認為evaluation其實是LLM研究中最值得研究的一個點,但是同時也是很難的一點。無論是現在的打榜、human evaluation、GPT打分,其實都很難全面去評價LLM,導致LLM在實際應用過程中并沒有指標體現出來的那樣好用。

而如果能有一個自動化的評測指標,最好能夠結合LLM的理論基礎進行設計,我覺得是目前社區比較需要的一個方向。 當然,前面也說到,LLM的可解釋性也是一個待解決的問題,相關指標的設計也同樣具有挑戰。

其他

NLP經典任務

這可能是一個比較小眾的點。其實也是個人一直在思考的一個問題,LLM時代下究竟怎么樣做NLP的經典任務? 比方說parsing、句法相關的任務,LLM的設計跟這些任務之間肯定是存在一些gap的,而怎樣將language models在大規模數據上獲得的能力遷移在這些經典任務上,其實相關的工作仍比較少。

垂類大模型

無論是工業界還是學術界,垂類大模型一直以來都是研究熱點之一。垂類大模型中與前面說到的數據優化、內容安全、評測問題都高度耦合。對于不同的垂直領域,垂類大模型面臨的最大問題還是domain gap。具體來說就包括很多方面了,例如特定領域數據上的問題,通常具有領域特性,但數據量有限;內容安全上,比方說金融、法律、醫療大模型,對安全性的需求都比通用大模型要高;評測問題,就拿醫療大模型舉例,還需要跟專業的醫療知識結合才能有效評測,等等;技術上還涉及LLM fine-tuning、domain adaptation,等等,甚至一些領域對于context length、memory、continual learning、active learning等技術有特定需求。可做的點還是比較豐富的。

交叉學科

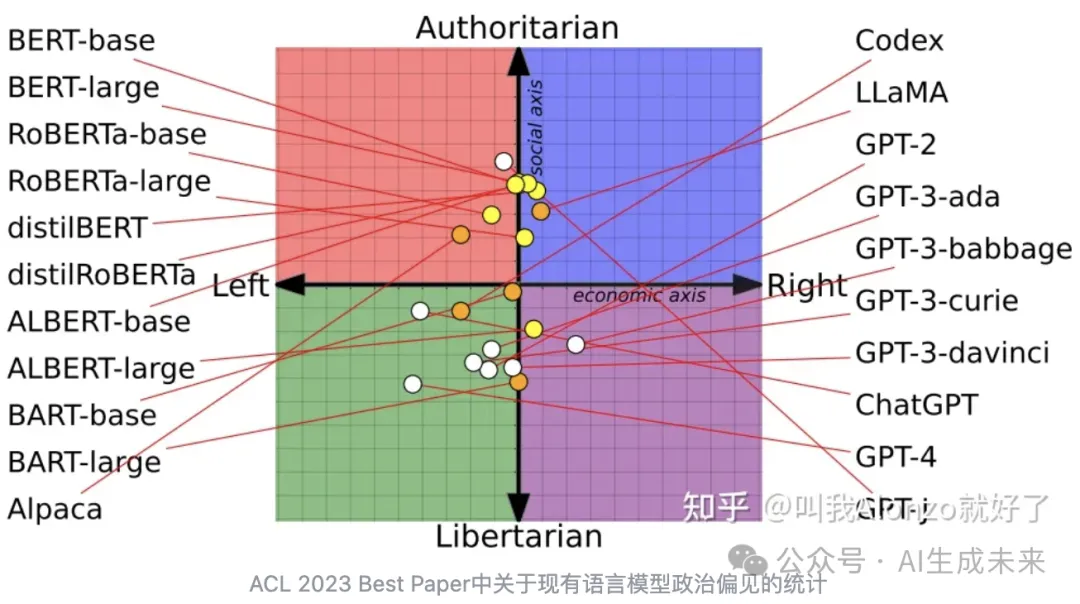

這點其實也是比較有“學術味道”的一類研究,文章工作本身更傾向于分析類而并非實驗。通常將LLM與其他學科交叉進行分析,例如語言學、政治學、社會學、心理學,等等。這類分析文章實驗代價通常相對較小,更側重統計、可視化、消融實驗等分析性質的實驗,但同時也需要掌握相關學科的專業知識,有一定的門檻。

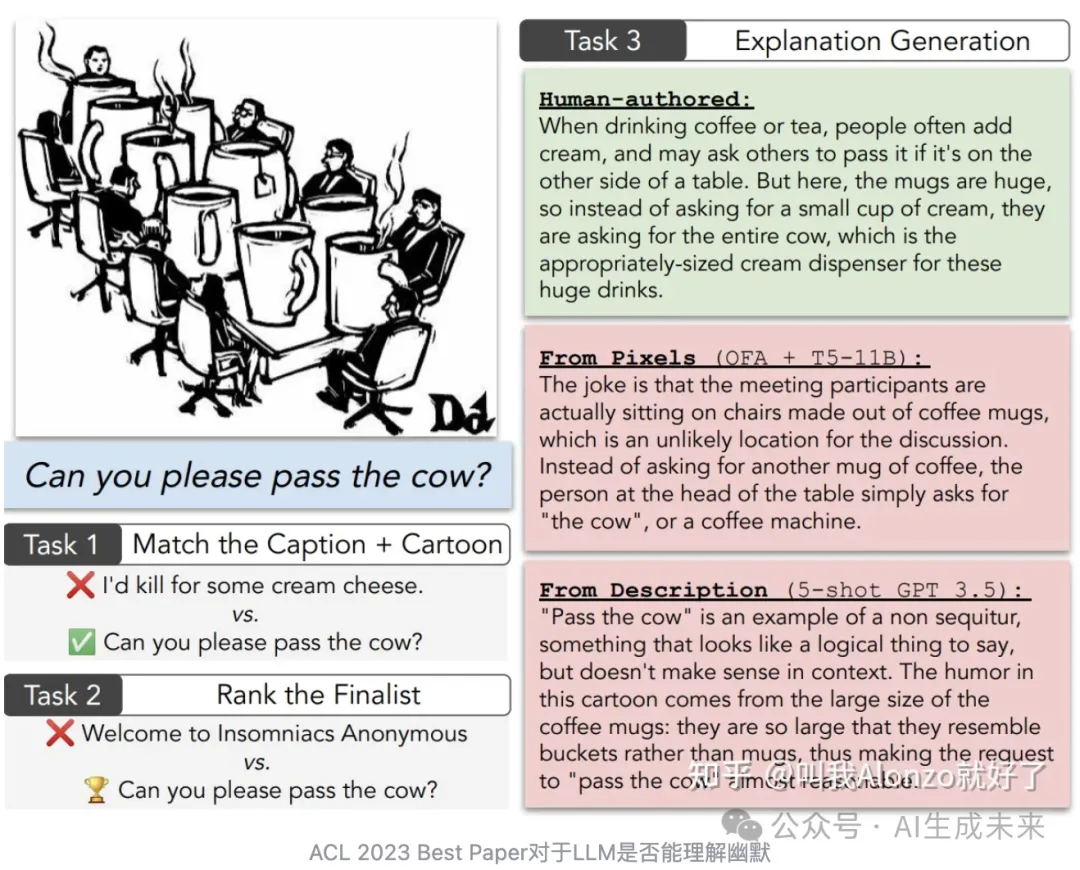

比較有代表性的工作在ACL 2023的best paper就有,例如《Do Androids Laugh at Electric Sheep? Humor “Understanding” Benchmarks from The New Yorker Caption Contest》,https://aclanthology.org/2023.acl-long.41.pdf.研究LLM是否能理解幽默:

ACL 2023 best paper的另一篇則是對LLM的政治偏見進行研究,出自《From Pretraining Data to Language Models to Downstream Tasks: Tracking the Trails of Political Biases Leading to Unfair NLP Models》,https://aclanthology.org/2023.acl-long.656.pdf,雖然小眾但是還挺有意思的:

值得一提的是,ACL 2023 best paper剩下一篇文章是對Stable Diffusion Cross-Attenion機制的研究。 包括Stanford西部小鎮 《Generative Agents: Interactive Simulacra of Human Behavior》,https://arxiv.org/pdf/2304.03442.pdf,中也有關于AI agents交互與社會傳播學的研究,例如下圖中就是關于特定任務的一個case study:

本文轉自 AI生成未來 ,作者:叫我Alonzo就好了

原文鏈接:???https://mp.weixin.qq.com/s/LJ4bcsrhUWBFvXSi-LcoQw?????